Clear Sky Science · es

Estabilización intrínseca de la plasticidad sináptica mejora el aprendizaje y la robustez en redes neuronales artificiales

Cómo el cerebro inspira un aprendizaje más estable en las máquinas

Cuando aprendemos una habilidad nueva, nuestros cerebros mantienen cierta flexibilidad para captar información fresca y, al mismo tiempo, la estabilidad necesaria para no olvidar lo ya aprendido. La inteligencia artificial moderna a menudo lucha por este equilibrio: aprende rápido pero a veces se vuelve frágil o inestable. Este estudio se inspira en las señales de retroalimentación del cerebro para diseñar una nueva manera de que las redes neuronales artificiales aprendan con mayor eficiencia y permanezcan robustas frente al ruido, a tareas cambiantes y a ejemplos engañosos.

Una nueva señal guía dentro de las máquinas de aprendizaje

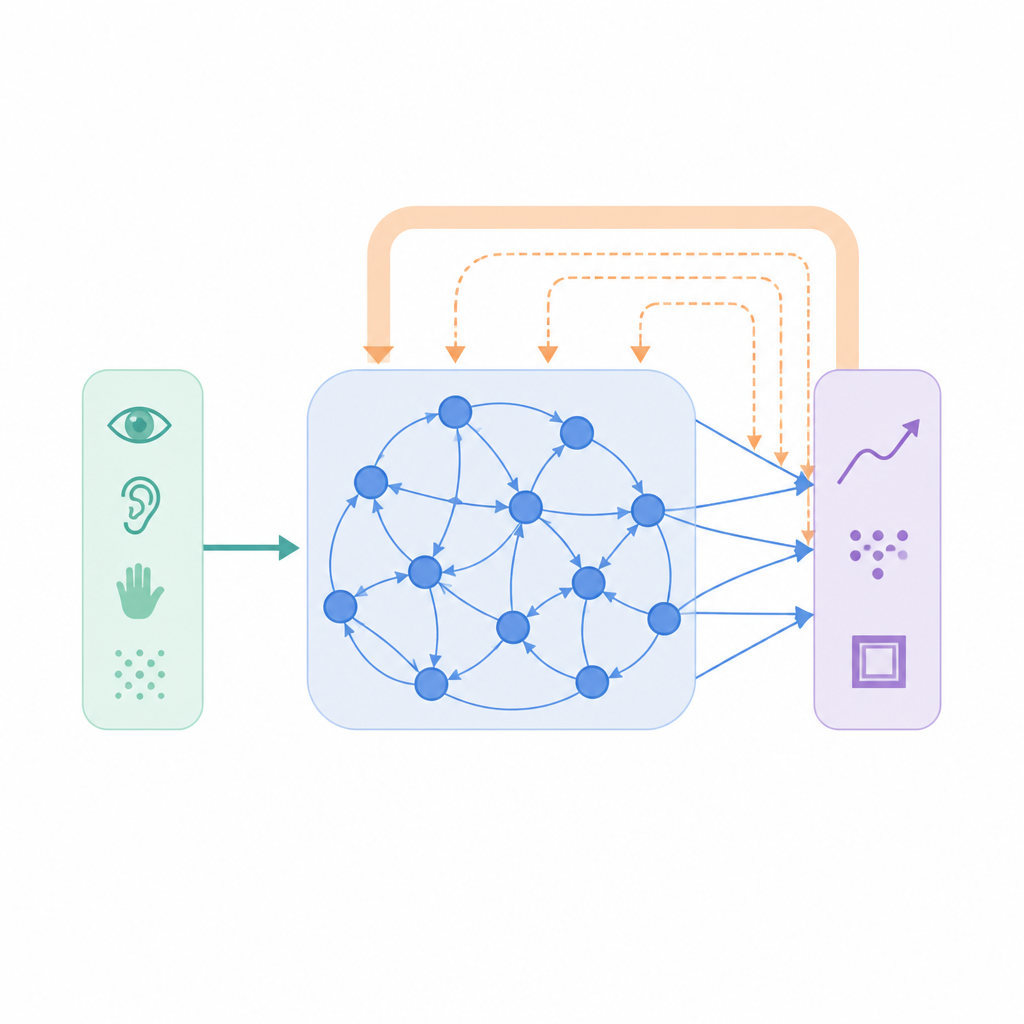

La mayoría de los sistemas de aprendizaje automático siguen una receta simple: comparar lo que la red predice con la respuesta correcta y ajustar sus conexiones para reducir esa diferencia. Este enfoque ascendiente funciona bien, pero ignora las ricas señales descendientes que recorren los cerebros reales, portando expectativas, contexto y predicciones. Los autores introducen un ingrediente adicional llamado Estabilización Intrínseca de Arriba hacia Abajo (iTDS). En lugar de perseguir solo la respuesta correcta, la red también aprende una señal interna más lenta que rastrea su propia salida pasada. Esta señal de cambio suave se retroalimenta en la regla de aprendizaje, de modo que cada conexión se moldea no solo por el error externo, sino también por cómo tiende a comportarse la red a lo largo del tiempo.

Enseñar a las redes a recordar sus propios hábitos

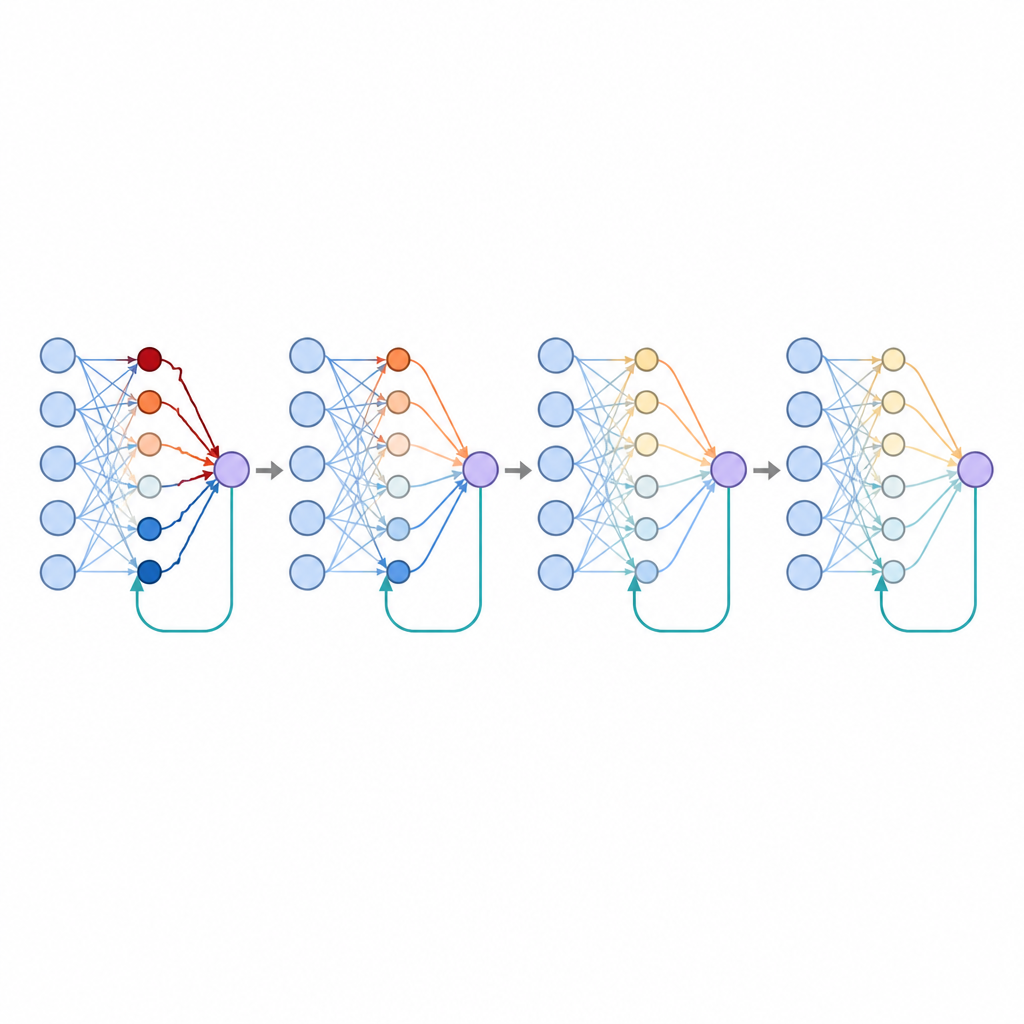

En iTDS, la red mantiene un registro corriendo y suavizado de su actividad de salida reciente. Esta traza interna no intenta predecir datos futuros ni la entrada sensorial cruda; simplemente se convierte en un eco filtrado de lo que la red ya ha producido. Durante el entrenamiento, el término de error habitual empuja las conexiones hacia el objetivo correcto, mientras que el término descendiente compara la salida actual con este eco. Cuando la actividad de la red es muy variable, estas dos influencias tienden a apuntar en direcciones similares, reforzándose entre sí y acelerando el aprendizaje. A medida que avanza el entrenamiento y la red se asienta en un patrón más consistente, la influencia descendiente se debilita gradualmente, actuando más como un estabilizador que como un impulsor del cambio.

Mejor sincronización, categorización y manejo del caos

Los investigadores probaron iTDS en varios tipos de redes neuronales, incluidas modelos recurrentes, feedforward y de reservorio, en dieciséis tareas. Estas iban desde el seguimiento de señales suaves en el tiempo, hasta el reconocimiento de dígitos manuscritos y la resolución de problemas lógicos simples. En muchos casos, añadir iTDS condujo a un entrenamiento más rápido y a un error menor que el aprendizaje supervisado estándar, incluso cuando la dinámica subyacente de la red era caótica. El método fue particularmente efectivo cuando las redes tenían muchas unidades activas o cuando las señales de salida fluctuaban con fuerza, condiciones comunes tanto en entornos biológicos como artificiales.

Aprender a partir de ejemplos ruidosos y engañosos

Los datos del mundo real rara vez están limpios. Para evaluar la robustez, los autores añadieron deliberadamente ruido a las entradas, rotaron imágenes fuera de su orientación habitual e incluso introdujeron “contraensayos” donde ejemplos iban emparejados con la respuesta equivocada. Bajo estas condiciones estresantes, las redes que usaban solo aprendizaje estándar tendían a sobrerreaccionar, remodelando sus conexiones de maneras poco útiles. Con iTDS, la señal descendiente lenta actuó como un freno: cuando aparecía un ejemplo sorprendente o contradictorio, las dos influencias de aprendizaje se cancelaban parcialmente, reduciendo el tamaño del cambio en los pesos. Como resultado, las redes con iTDS fueron más resistentes tanto a distorsiones aleatorias como a perturbaciones diseñadas que normalmente engañarían a los clasificadores.

Por qué importa separar la retroalimentación positiva y negativa

El estudio también exploró qué sucede cuando algunas conexiones se especializan en rastrear solo errores positivos y otras solo errores negativos, en eco de cómo ciertas células cerebrales responden de forma diferente a recompensas y contratiempos. Esta separación produjo naturalmente patrones de conectividad más dispersos, donde muchas conexiones permanecían cerca de cero mientras un subconjunto menor cargaba la mayor parte de la influencia. Tal esparcidad se sabe que mejora la generalización y aquí redujo aún más las tasas de error. Los autores mostraron que simplemente forzar a muchos pesos a permanecer en cero imitaba gran parte de este beneficio, lo que sugiere que la retroalimentación especializada puede ser una vía biológica para lograr representaciones dispersas y eficientes.

Qué significa esto para futuros cerebros y máquinas

En conjunto, el marco iTDS demuestra que dar a las máquinas de aprendizaje una sensación lenta de su propio comportamiento reciente puede hacerlas aprendices más rápidos y solucionadores de problemas más estables. En lugar de depender únicamente del desajuste inmediato con la respuesta correcta, las redes que combinan correcciones rápidas con una estabilización suave de arriba hacia abajo manejan el ruido, la confusión y el cambio con más soltura. Para la ciencia del cerebro, el modelo ofrece predicciones concretas sobre cómo las vías de retroalimentación podrían moldear el aprendizaje. Para la inteligencia artificial, sugiere que incorporar señales de autorregistros en múltiples escalas temporales podría ser un camino práctico hacia sistemas que aprenden más como nosotros y fallan con menos frecuencia cuando el mundo se vuelve desordenado.

Cita: Pilzak, A., Pennington, B. & Thivierge, JP. Intrinsic stabilization of synaptic plasticity improves learning and robustness in artificial neural networks. Nat Commun 17, 4164 (2026). https://doi.org/10.1038/s41467-026-70920-3

Palabras clave: plasticidad sináptica, retroalimentación de arriba hacia abajo, redes neuronales recurrentes, aprendizaje robusto, resiliencia al ruido