Clear Sky Science · ru

Внутренняя стабилизация синаптической пластичности улучшает обучение и устойчивость в искусственных нейронных сетях

Как мозг вдохновляет более устойчивое обучение в машинах

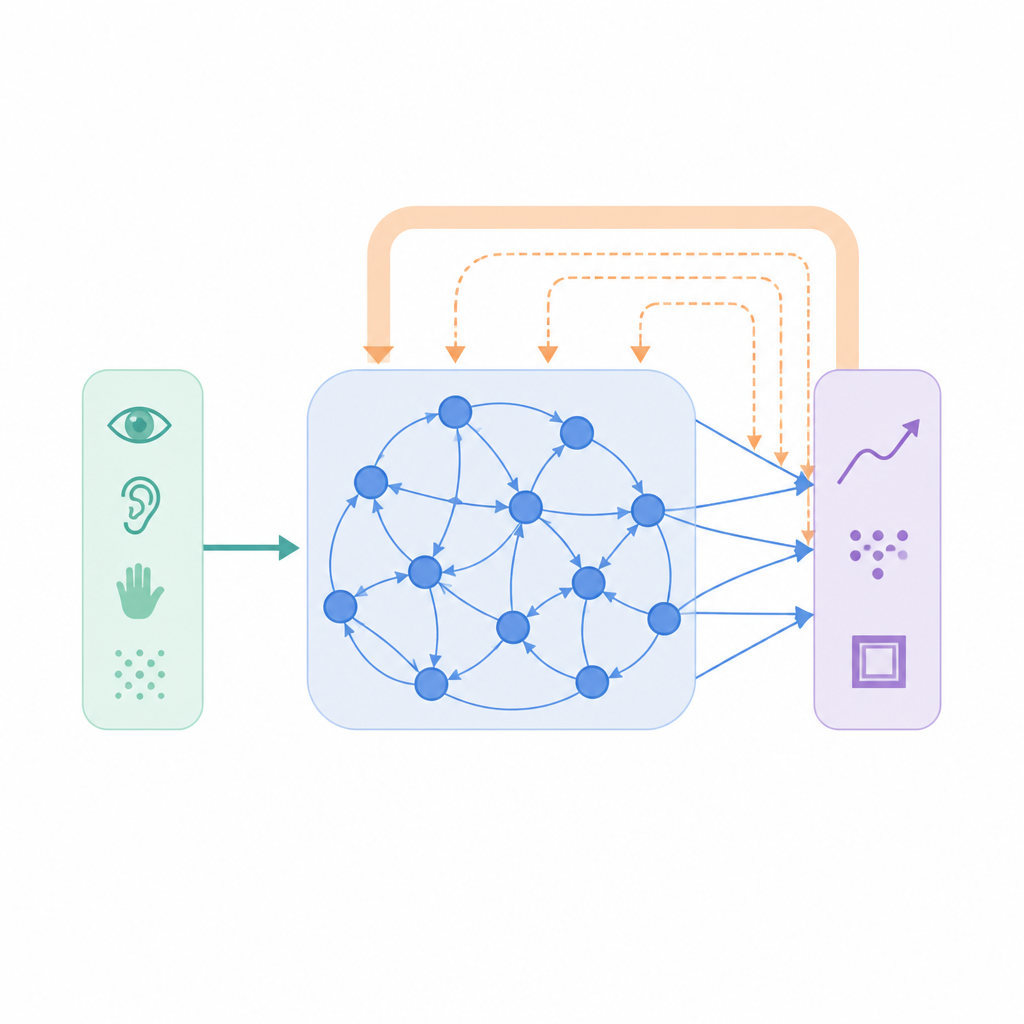

Когда мы осваиваем новый навык, наш мозг остаётся достаточно гибким, чтобы усваивать новую информацию, и в то же время достаточно стабильным, чтобы не забывать уже выученное. Современный искусственный интеллект часто испытывает трудности с поддержанием этого баланса: он быстро учится, но порой становится хрупким или нестабильным. В этой работе авторы черпают идею из мозговых сигналов обратной связи и предлагают новый подход, который позволяет искусственным нейронным сетям учиться эффективнее и оставаться устойчивыми при наличии шума, изменения задач и вводящих в заблуждение примеров.

Новый направляющий сигнал внутри обучающих машин

Большинство систем машинного обучения опираются на простую формулу: сравнить предсказание сети с правильным ответом и чуть-чуть подправить связи, чтобы сократить разрыв. Этот «снизу вверх» подход работает, но игнорирует богатые «сверху вниз» сигналы, которые циркулируют в реальных мозгах, принося ожидания, контекст и предсказания. Авторы вводят дополнительный компонент, названный внутренняя верхняя стабилизация (iTDS). Вместо того чтобы гнаться лишь за правильным ответом, сеть также обучает более медленный внутренний сигнал, который отслеживает её собственный прошлый вывод. Этот медленно меняющийся сигнал подаётся обратно в правило обучения, так что каждая связь формируется не только внешней ошибкой, но и тем, как сеть ведёт себя со временем.

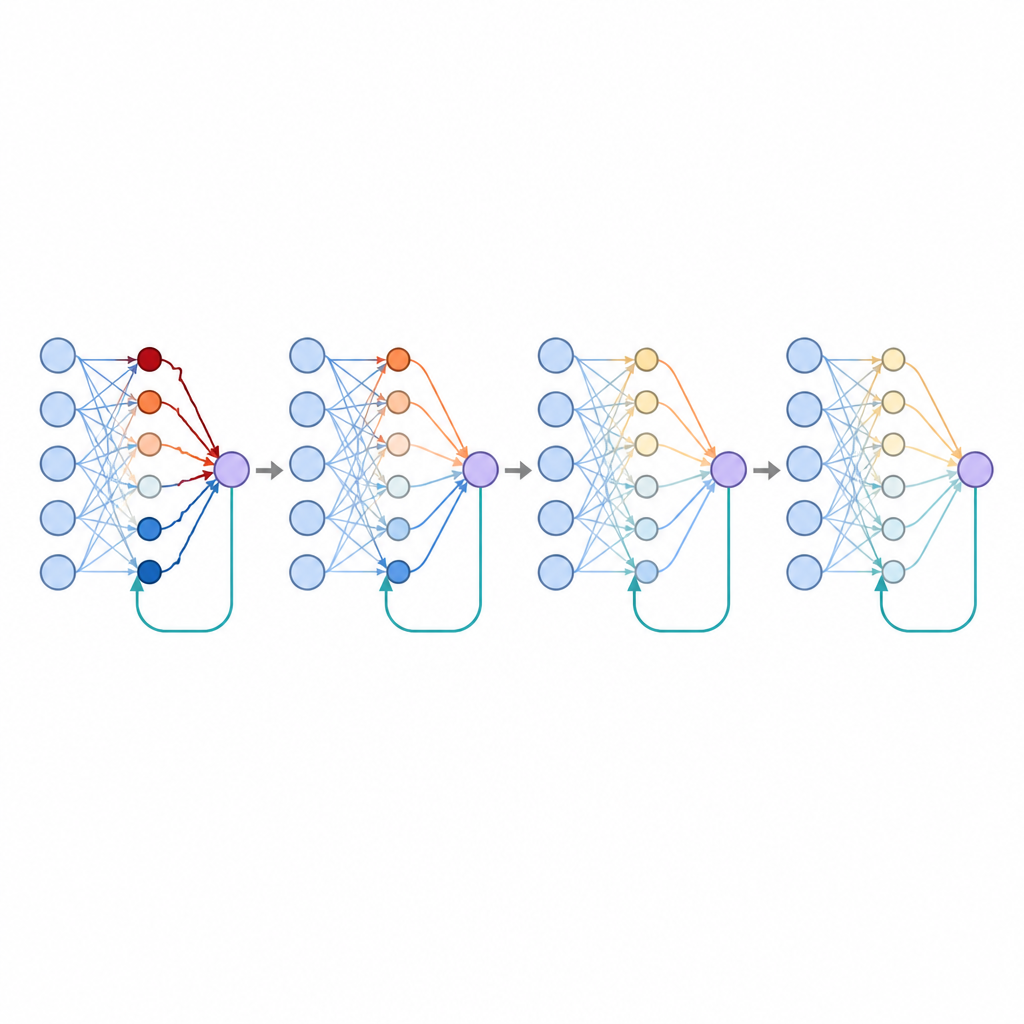

Обучение сетей запоминать собственные привычки

В iTDS сеть ведёт сглаженную запись своей недавней активности на выходе. Этот внутренний след не пытается предсказывать будущие данные или сырые сенсорные сигналы; он просто является фильтрованным эхом того, что сеть уже произвела. Во время обучения обычный член ошибки тянет связи к правильной цели, а верхний член сравнивает текущий вывод с этим эхом. Когда активность сети сильно варьируется, эти два влияния обычно указывают в похожем направлении, усиливая друг друга и ускоряя обучение. По мере обучения, когда сеть устаканивается и переходит к более постоянной схеме работы, верхнее влияние постепенно ослабевает, действуя скорее как стабилизатор, чем как драйвер изменений.

Лучшее времяобозначение, категоризация и сопротивляемость хаосу

Исследователи протестировали iTDS в нескольких типах нейронных сетей, включая рекуррентные, прямого распространения и резервуарные модели, на шестнадцати задачах. Они варьировались от отслеживания сглаженных сигналов во времени до распознавания рукописных цифр и решения простых логических задач. Во многих случаях добавление iTDS приводило к более быстрому обучению и меньшей ошибке по сравнению со стандартным супервизированным обучением, даже когда динамика сети была хаотичной. Метод оказался особенно эффективен при большом числе активных единиц или при сильных флуктуациях выходных сигналов — условиях, общих для биологических и искусственных систем.

Обучение на шумных и вводящих в заблуждение примерах

Реальные данные редко бывают чистыми. Чтобы проверить устойчивость, авторы целенаправленно добавляли шум во входы, поворачивали изображения от привычной ориентации и даже подмешивали «контртриалы», где примеры сопровождались неверным ответом. В таких стрессовых условиях сети, обучающиеся только стандартным способом, склонялись к чрезмерным реакциям, деформируя соединения не в ту сторону. С iTDS медленный верхний сигнал действовал как тормоз: когда появлялся неожиданный или противоречивый пример, два влияния обучения частично компенсировали друг друга, уменьшая величину изменения весов. В результате сети с iTDS лучше сопротивлялись как случайным искажениям, так и тщательно подобранным возмущениям, которые обычно обманывают классификаторы.

Почему важно разделение положительной и отрицательной обратной связи

В работе также рассмотрели, что происходит, когда некоторые соединения специализируются на учёте только положительных ошибок, а другие — только отрицательных, напоминая о том, как отдельные клетки мозга по-разному реагируют на вознаграждение и неудачу. Такое разделение естественно приводило к более разреженным паттернам связности, где множество связей оставались близкими к нулю, а небольшая часть несло основное влияние. Известно, что разреженность улучшает способность к обобщению, и здесь она дополнительно снижала уровень ошибок. Авторы показали, что простое принуждение многих весов оставаться нулевыми повторяло большую часть этого эффекта, что указывает на то, что специализированная обратная связь может быть одним биологическим путем к получению разрежённых, эффективных представлений.

Что это значит для будущих мозгов и машин

В целом, рамки iTDS демонстрируют, что предоставление обучающимся машинам медленно меняющегося чувства собственной недавней активности может сделать их быстрее обучающимися и более стабильными в решении задач. Вместо опоры лишь на немедленное несоответствие с правильным ответом, сети, сочетающие быстрые коррекции с мягкой верхней стабилизацией, лучше справляются с шумом, путаницей и изменениями. Для нейронауки модель даёт конкретные предсказания о том, как пути обратной связи могут формировать обучение. Для искусственного интеллекта это предлагает практический путь: внедрение самоконтролирующих сигналов на разных временных масштабах может помочь создавать системы, которые учатся более похоже на нас и реже терпят неудачу, когда мир становится беспорядочным.

Цитирование: Pilzak, A., Pennington, B. & Thivierge, JP. Intrinsic stabilization of synaptic plasticity improves learning and robustness in artificial neural networks. Nat Commun 17, 4164 (2026). https://doi.org/10.1038/s41467-026-70920-3

Ключевые слова: синаптическая пластичность, верхняя обратная связь, рекуррентные нейронные сети, надёжное обучение, устойчивость к шуму