Clear Sky Science · pt

Estabilização intrínseca da plasticidade sináptica melhora aprendizagem e robustez em redes neurais artificiais

Como cérebros inspiram um aprendizado mais estável em máquinas

Quando aprendemos uma nova habilidade, nossos cérebros permanecem de algum modo flexíveis o bastante para assimilar informação nova e, ao mesmo tempo, estáveis o suficiente para não esquecer o que já sabemos. A inteligência artificial moderna muitas vezes luta com esse equilíbrio: aprende rápido, mas por vezes se torna frágil ou instável. Este estudo toma como inspiração os sinais de retroalimentação do cérebro para projetar uma nova forma de fazer redes neurais artificiais aprenderem de maneira mais eficiente, mantendo-se robustas diante de ruído, tarefas mutantes e exemplos enganosos.

Um novo sinal orientador dentro das máquinas de aprendizagem

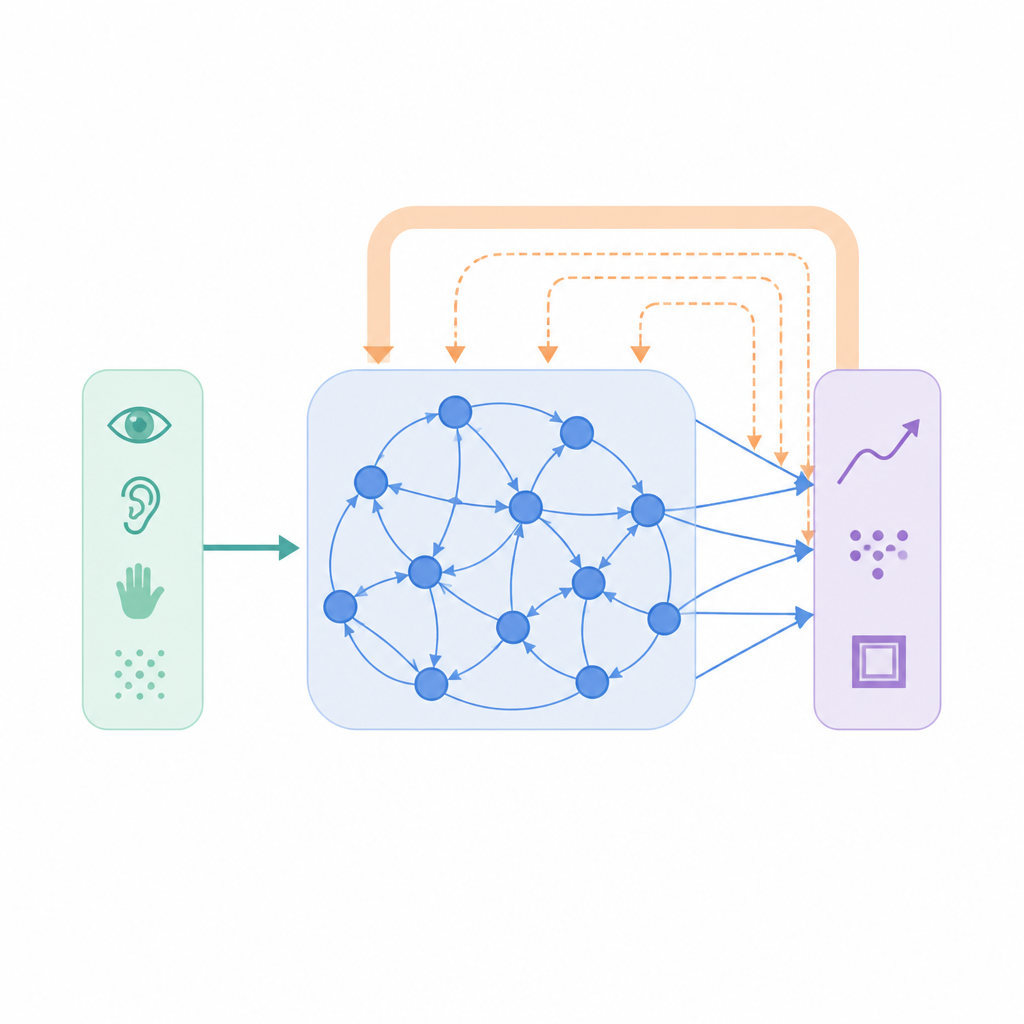

Grande parte dos sistemas de aprendizado de máquina segue uma receita simples: comparar a previsão da rede com a resposta correta e ajustar suas conexões para reduzir essa diferença. Essa abordagem bottom-up funciona bem, mas ignora os ricos sinais top-down que percorrem cérebros reais, carregando expectativas, contexto e previsões. Os autores introduzem um ingrediente adicional chamado Estabilização Top-Down Intrínseca (iTDS). Em vez de apenas perseguir a resposta correta, a rede também aprende um sinal interno mais lento que acompanha sua própria saída passada. Esse sinal, que muda suavemente, é realimentado na regra de aprendizagem, de modo que cada conexão é moldada não só pelo erro externo, mas também por como a rede tende a se comportar ao longo do tempo.

Ensinando redes a lembrar seus próprios hábitos

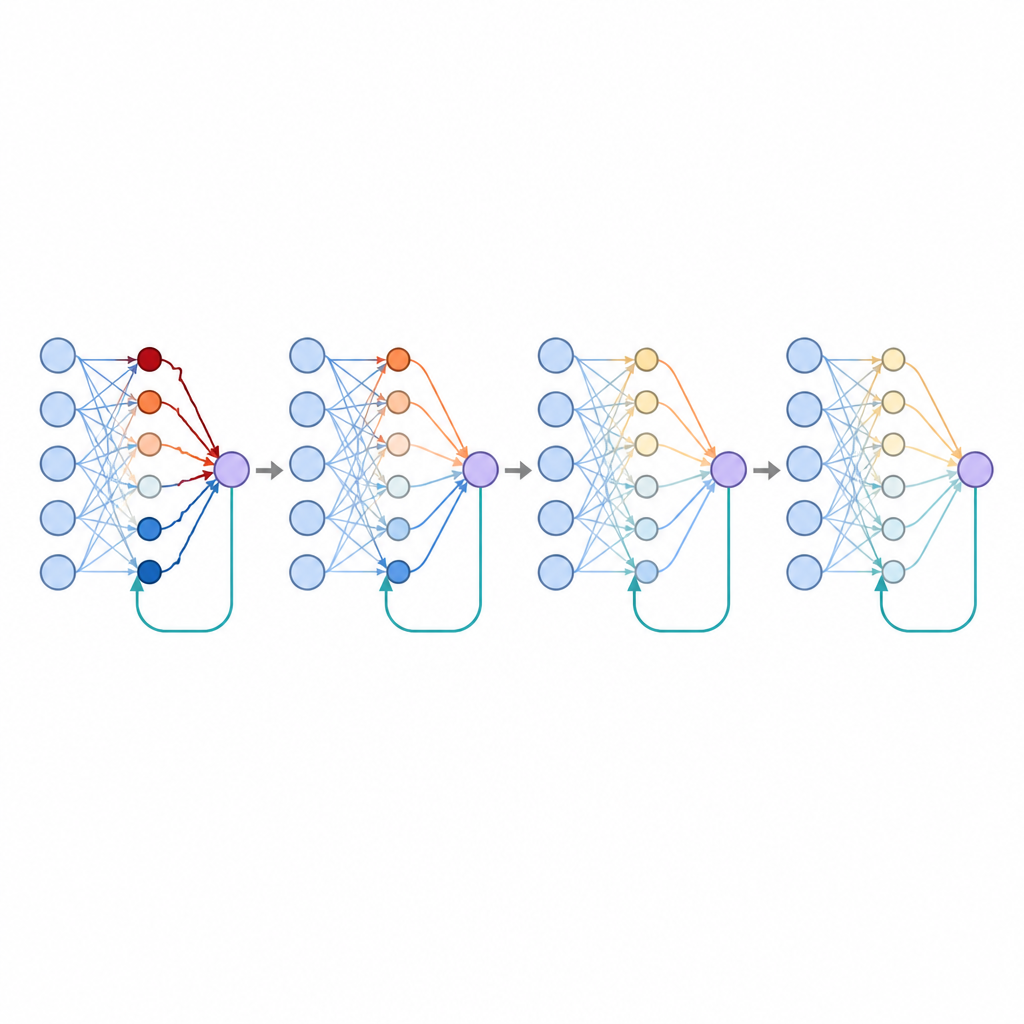

No iTDS, a rede mantém um registro contínuo e suavizado de sua atividade de saída recente. Esse traço interno não tenta prever dados futuros nem os insumos sensoriais crus; ele simplesmente se torna um eco filtrado do que a rede já produziu. Durante o treinamento, o termo de erro habitual empurra as conexões na direção do alvo correto, enquanto o termo top-down compara a saída atual com esse eco. Quando a atividade da rede é altamente variável, essas duas influências tendem a apontar na mesma direção, reforçando-se mutuamente e acelerando o aprendizado. À medida que o treinamento avança e a rede se assenta em um padrão mais consistente, a influência top-down enfraquece gradualmente, passando a agir mais como um estabilizador do que como um motor de mudança.

Melhor sincronização, categorização e lidar com o caos

Os pesquisadores testaram o iTDS em vários tipos de redes neurais, incluindo modelos recorrentes, feedforward e de reservatório, em dezesseis tarefas diferentes. Essas variaram desde rastrear sinais suaves ao longo do tempo, reconhecer dígitos manuscritos até resolver problemas lógicos simples. Em muitos casos, adicionar iTDS levou a um treinamento mais rápido e a erro menor do que o aprendizado supervisionado padrão sozinho, mesmo quando a dinâmica subjacente da rede era caótica. O método foi particularmente eficaz quando as redes tinham muitas unidades ativas ou quando os sinais de saída oscilavam fortemente — condições comuns tanto em cenários biológicos quanto artificiais.

Aprendendo com exemplos ruidosos e enganosos

Dados do mundo real raramente são limpos. Para testar a robustez, os autores deliberadamente adicionaram ruído às entradas, rotacionaram imagens fora da orientação habitual e até inseriram “contra-experimentos” onde exemplos foram pareados com a resposta errada. Nessas condições estressantes, redes que usavam apenas aprendizado padrão tendiam a reagir em excesso, remodelando suas conexões de maneiras pouco úteis. Com o iTDS, o sinal top-down lento atuou como um freio: quando surgia um exemplo surpreendente ou contraditório, as duas influências de aprendizagem se cancelavam parcialmente, reduzindo a magnitude da mudança de peso. Como resultado, redes com iTDS foram mais resistentes tanto a distorções aleatórias quanto a perturbações cuidadosamente escolhidas que normalmente iludem classificadores.

Por que separar feedback positivo e negativo importa

O estudo também explorou o que acontece quando algumas conexões se especializam em rastrear apenas erros positivos e outras apenas erros negativos, ecoando como certas células cerebrais respondem de modo diferente a recompensas e retrocessos. Essa separação produziu naturalmente padrões de conectividade mais esparsos, onde muitas conexões permaneciam próximas de zero enquanto um subconjunto menor carregava a maior parte da influência. Essa esparsidade é conhecida por melhorar a generalização e, aqui, reduziu ainda mais as taxas de erro. Os autores demonstraram que simplesmente forçar muitos pesos a permanecerem em zero mimetizava boa parte desse benefício, sugerindo que feedback especializado pode ser uma via biológica para obter representações esparsas e eficientes.

O que isso significa para cérebros e máquinas futuros

No conjunto, o arcabouço iTDS mostra que dar às máquinas de aprendizagem um senso vagarosamente mutante de seu próprio comportamento recente pode torná-las aprendizes mais rápidos e solucionadoras de problemas mais estáveis. Em vez de depender exclusivamente do descompasso imediato com a resposta correta, redes que combinam correções rápidas com estabilização top-down suave lidam com ruído, confusão e mudança de modo mais elegante. Para a neurociência, o modelo oferece previsões concretas sobre como vias de feedback podem moldar o aprendizado. Para a inteligência artificial, sugere que incorporar sinais de auto-monitoramento, em múltiplas escalas de tempo, pode ser um caminho prático para sistemas que aprendem mais como nós e falham com menos frequência quando o mundo fica bagunçado.

Citação: Pilzak, A., Pennington, B. & Thivierge, JP. Intrinsic stabilization of synaptic plasticity improves learning and robustness in artificial neural networks. Nat Commun 17, 4164 (2026). https://doi.org/10.1038/s41467-026-70920-3

Palavras-chave: plasticidade sináptica, feedback top-down, redes neurais recorrentes, aprendizagem robusta, resiliência ao ruído