Clear Sky Science · sv

Händelsebaserad lunar optisk flödes-egomotionsuppskattningsutmaning: utformning och resultat av ELOPE-tävlingen

Varför smartare ögon spelar roll vid månlandningar

När rymdorganisationer förbereder sig för att skicka robotar och så småningom människor tillbaka till Månen blir det en stor utmaning att landa säkert i grov, skuggig terräng—särskilt nära polerna där is kan gömma sig i permanent mörker. Denna artikel undersöker en ny typ av “smart öga” för rymdfarkoster, kallad händelsebaserad kamera, och rapporterar om en världsomspännande tävling som testade hur väl olika team kunde använda den för att styra en månnedstigningsfarkost mot en säker nersättning.

En ny metod att se rörelse i mörker

Till skillnad från vanliga kameror som tar kompletta bilder med fasta intervaller reagerar händelsebaserade kameror endast när ljusstyrkan i en enskild pixel förändras. Varje förändring utlöser en punktformig “händelse” med en exakt tidsstämpel, vilket skapar ett flöde av glesa, snabba uppdateringar istället för tunga bilder. Denna konstruktion efterliknar hur biologiska ögon fungerar och ger viktiga fördelar för rymdfärd: extremt snabb respons, mycket stort dynamiskt omfång och låg energiåtgång. Dessa styrkor är särskilt användbara nära månens södra pol, där solen stryker vid horisonten, kratrar ligger i djupa skuggor och ljusa, reflekterande stoft lätt kan överväldiga traditionella sensorer.

Att bygga en realistisk digital månlekplats

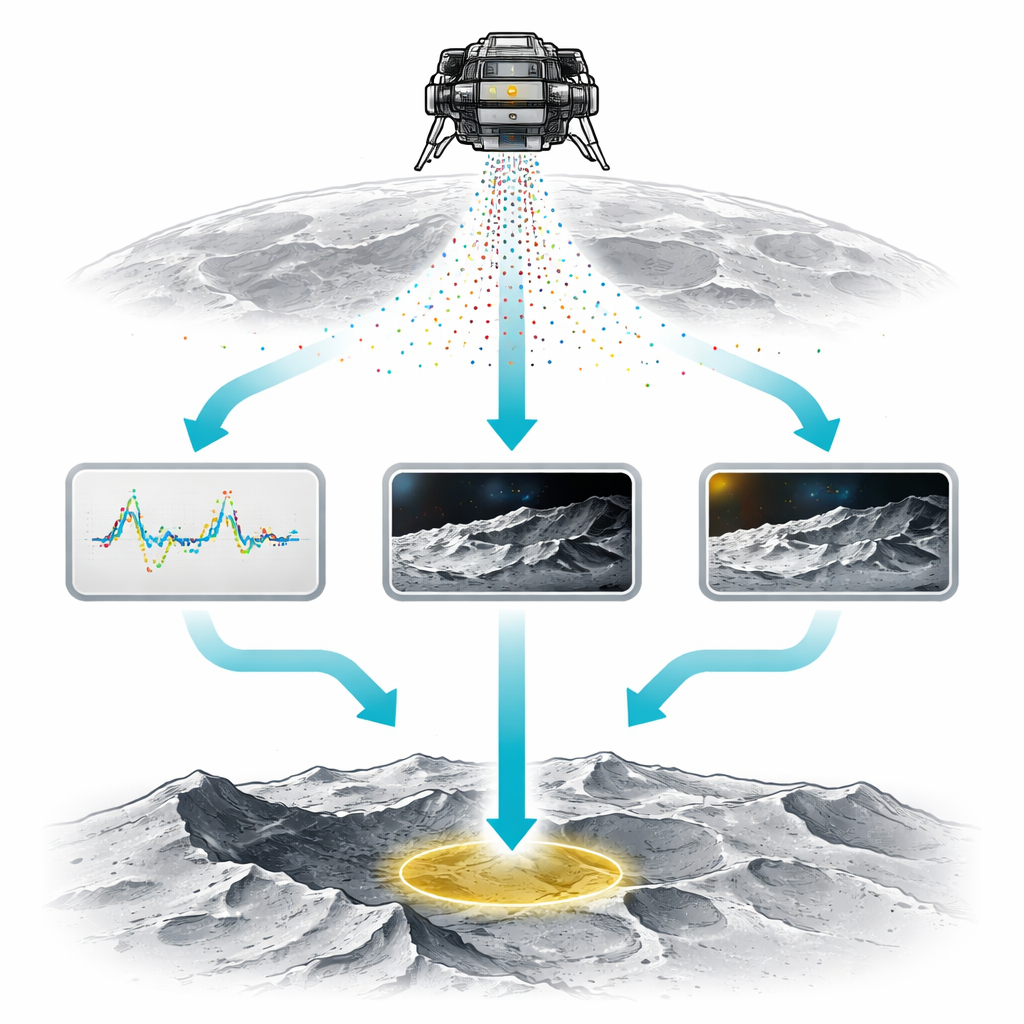

Eftersom verkliga händelsedrivna data från Månen ännu inte finns skapade forskarna ELOPE-datasetet och tävlingen. Med specialiserad programvara simulerade de först bränsleeffektiva landningsbanor för en farkost liknande Apollo-landaren, inklusive både vanliga nedstigningar och mer komplexa ”avlednings”-manövrar där nersättningsplatsen ändras sent i inflygningen. Ett planetärt renderingsverktyg genererade sedan detaljerade, fotoliknande vyer av ytan längs dessa banor under olika ljusförhållanden, och en händelsekamerasimulator konverterade bildsekvenserna till ett flöde av händelser. Varje sekvens levererades med perfekta ”facit” för farkostens sanna rörelse, plus virtuella mätningar från en rörelsesensor och en laseravståndsmätare, vilket gjorde det möjligt för tävlande att testa hur noggrant deras metoder kunde återskapa landarens hastighet och riktning.

En global tävling av smarta navigationsidéer

ELOPE-tävlingen lockade 44 team från universitet, industri och oberoende forskare, varav 21 nådde slutresultatet och lämnade in 132 lösningar. Alla team var tvungna att uppskatta landarens tredimensionella hastighet över tid från samma syntetiska sensordata. Arrangörerna tillhandahöll också en stark referensmetod baserad på bildramar som först omvandlade händelser till bilder och sedan tillämpade standardtekniker för optiskt flöde, vilket utmanade tävlande att göra bättre genom att utnyttja den händelsebaserade sensingens fulla potential. Endast tre team slog denna referens, vilket visar både teknikens löfte och dess nuvarande begränsningar.

Tre vinnande vägar att läsa rörelse

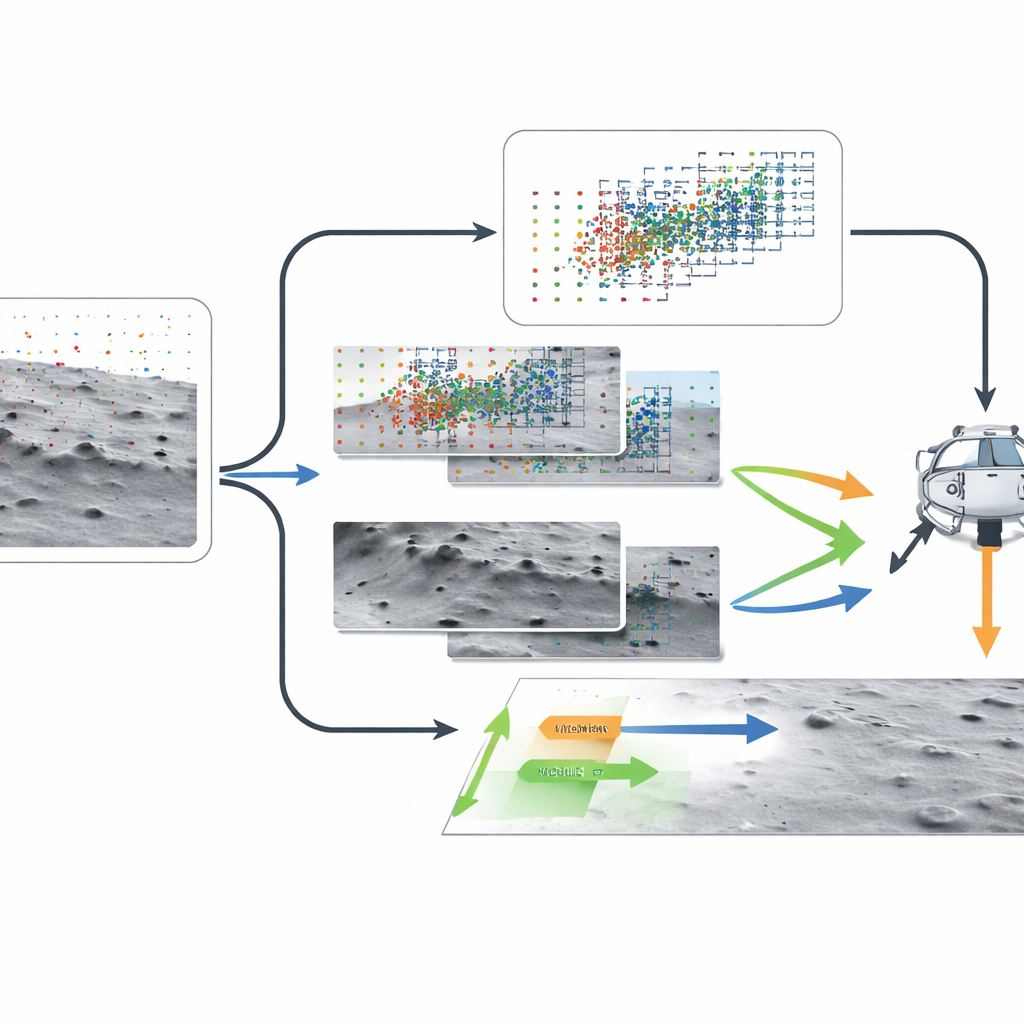

Topplaget, SOMIS-LAB, satsade fullt på enbart händelsebaserad information. Istället för att gruppera händelser i fasta tidsluckor justerade deras metod tidsfönstret dynamiskt beroende på hur många händelser som anlände, sedan förvrängde de händelserna enligt hypotetiska rörelser och bedömde hur ”skarpt” det resulterande mönstret såg ut i frekvensdomänen. Genom att söka den rörelse som gjorde kanter i scenen så tydliga som möjligt uppnådde de högst noggrannhet—om än till en hög beräkningskostnad som för närvarande vore för långsam för en verklig nersättning. Andra- och tredjeplacerade lagen, HRI och LUNARIS, valde en mer traditionell väg: de binade händelser till kortlivade bilder och använde etablerade verktyg från datorseende. Ett av dem behandlade månens yta som nästan plan och fann den bästa övergripande transformationen mellan på varandra följande bilder; det andra uppskattade detaljerad per-pixel-rörelse, avlägsnade den del som orsakades av landarens rotation med hjälp av rörelsesensorns data, och kombinerade detta med avståndsinformation för att härleda landarens hastighet. Dessa tillvägagångssätt var tillräckligt snabba för realtidsbruk och presterade fortfarande bättre än referensen.

Vad vi lär oss av svåra fall

Genom att studera var alla metoder hade svårigheter fann författarna att de svåraste banorna var de med kraftiga ljusproblem—översaturerade eller dåligt exponerade källbilder, som gav få meningsfulla händelser efter konvertering. De såg också att komplexa avledningsmanövrar, med skarpare svängar och attitydförändringar, generellt var svårare att rekonstruera än raka nedstigningar. Intressant nog experimenterade många team med djupinlärning men återgick ofta till klassiska visionsmetoder för sina slutgiltiga inlämningar, med hänvisning till utmaningar som glesa händelser, begränsade träningsdata och behovet av robust generalisering. En enkät efter tävlingen visade också att majoriteten av deltagarna konverterade händelser till ramar med fast timing, vilket understryker hur ovanlig den helt händelsedrivna strategin från vinnande laget fortfarande är.

Vad detta betyder för framtida månuppdrag

Studien slutsatser är att händelsebaserade kameror är starka kandidater för framtida system för månlandning, särskilt i krävande polära regioner. Även med ett syntetiskt dataset och den extra nackdelen att kamerakalibreringsdetaljer saknades matchade flera team eller överträffade en omsorgsfullt utformad frame-baserad referensmetod. Den mest exakta lösningen visade att ett fullständigt omfamnande av händelseströmmen kan ge utmärkta rörelseuppskattningar, medan snabba frame-baserade hybrider visade att praktiska, realtidssystem redan finns inom räckhåll. Tillsammans markerar dessa resultat ett viktigt steg mot landare som kan ”se” snabb rörelse och hård belysning mer som ett levande öga, vilket förbättrar chanserna för säkra, precisa nersättningar på Månen och längre bort.

Citering: Fanti, P., Williams, L.B.S., Dvořák, O. et al. Event-based lunar optical flow egomotion estimation challenge: design and results of the ELOPE competition. npj Space Explor. 2, 18 (2026). https://doi.org/10.1038/s44453-026-00033-0

Nyckelord: händelsebaserad vision, månnedstigning, egomotionsuppskattning, neuromorfa sensorer, autonom navigation