Clear Sky Science · pt

Desafio de estimação de egomotion por fluxo óptico lunar baseado em eventos: desenho e resultados da competição ELOPE

Por que olhos mais inteligentes importam para pousos lunares

À medida que agências espaciais se preparam para enviar robôs e, eventualmente, pessoas de volta à Lua, pousar com segurança em terrenos acidentados e sombreados — especialmente perto dos polos, onde gelo pode permanecer em escuridão permanente — torna-se um grande desafio. Este artigo explora um novo tipo de “olho inteligente” para espaçonaves, chamado câmera baseada em eventos, e relata uma competição mundial que avaliou quão bem equipes diferentes conseguiam usá-la para guiar um módulo lunar rumo a um toque seguro na superfície.

Uma nova maneira de ver o movimento no escuro

Diferente de câmeras comuns que capturam imagens completas em intervalos fixos, câmeras baseadas em eventos reagem apenas quando o brilho em um pixel minúsculo muda. Cada alteração dispara um “evento” pontual com carimbo de tempo preciso, criando um fluxo de atualizações esparsas e rápidas em vez de imagens volumosas. Esse desenho imita o funcionamento dos olhos biológicos e traz vantagens-chave para o voo espacial: resposta extremamente rápida, faixa de brilho muito ampla e baixo consumo de energia. Essas forças são especialmente úteis perto do Polo Sul lunar, onde o Sol raspa o horizonte, crateras permanecem em sombra profunda e poeira reflexiva brilhante pode facilmente saturar sensores tradicionais.

Construindo um playground digital lunar realista

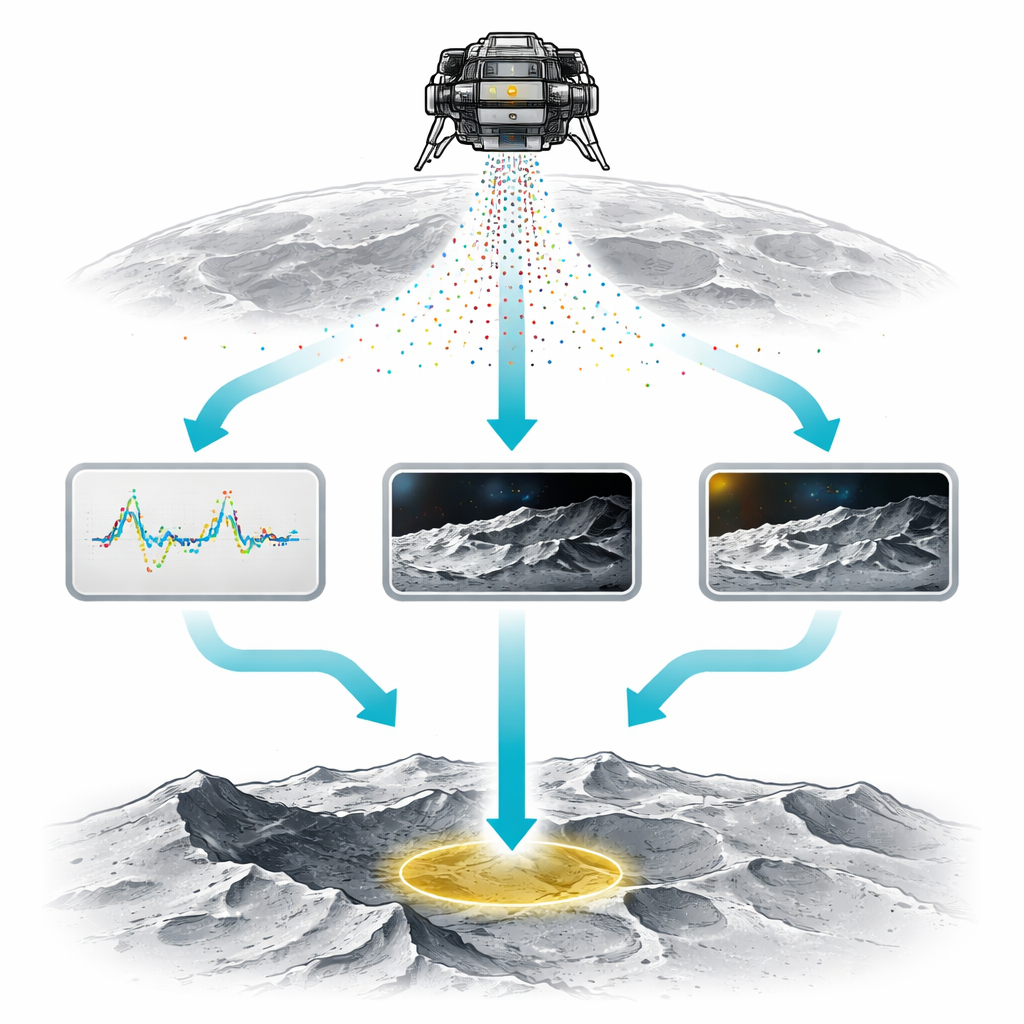

Como ainda não existem dados reais baseados em eventos da Lua, os pesquisadores criaram o conjunto de dados e desafio ELOPE. Usando software especializado, eles primeiro simularam trajetórias de pouso economizadoras de combustível para uma espaçonave parecida com o módulo Apollo, incluindo descidas ordinárias e manobras mais complexas de “desvio”, quando o local de toque muda tardiamente na aproximação. Uma ferramenta de renderização planetária então gerou vistas detalhadas e fotorrealistas da superfície ao longo dessas trajetórias sob diferentes condições de iluminação, e um simulador de câmera de eventos converteu as sequências de imagens em fluxos de eventos. Cada sequência veio com “gabaritos” perfeitos da verdadeira movimentação do módulo, além de leituras virtuais de um sensor de movimento e de um telémetro a laser, permitindo aos competidores testar quão precisamente seus métodos podiam reconstruir a velocidade e a direção do módulo.

Um concurso global de ideias de navegação inteligente

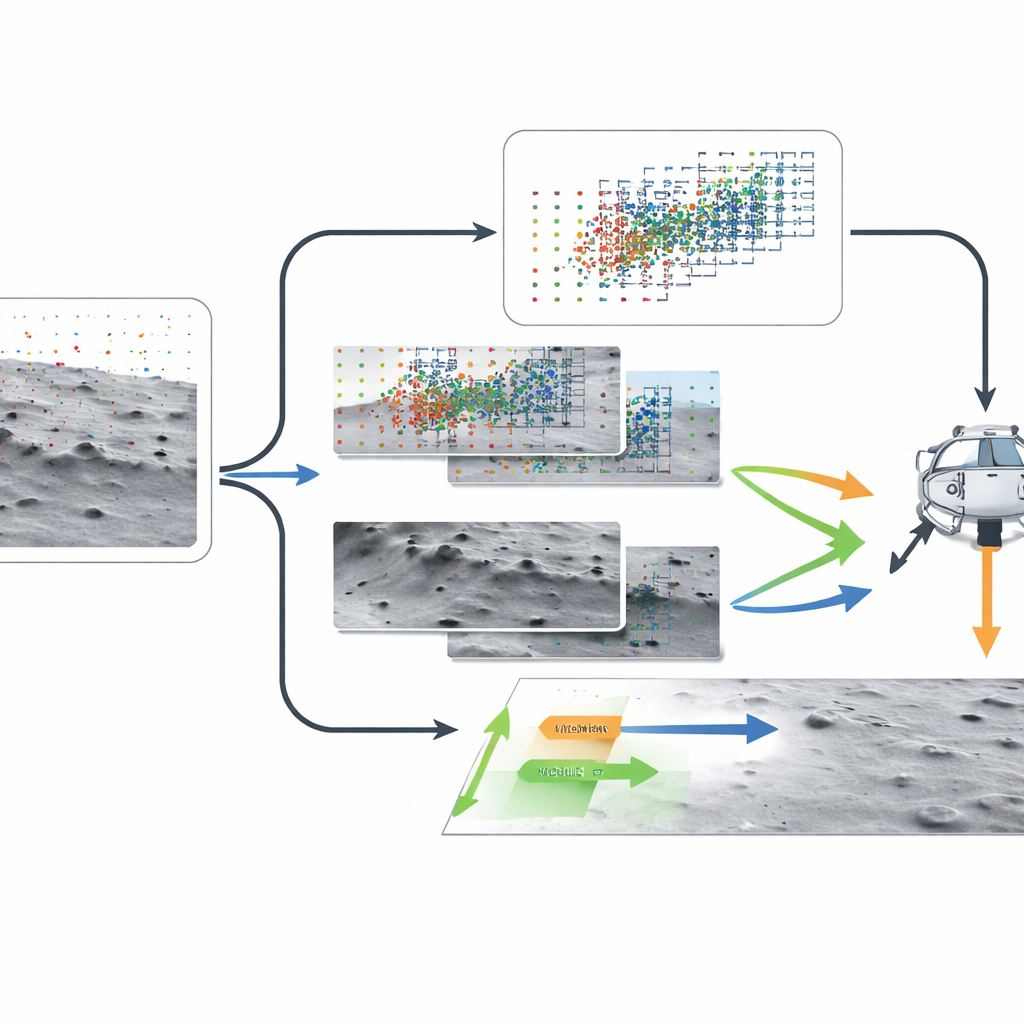

A competição ELOPE atraiu 44 equipes de universidades, indústria e pesquisadores independentes, com 21 alcançando o placar final e submetendo 132 soluções. Todas as equipes tiveram de estimar a velocidade tridimensional do módulo ao longo do tempo a partir dos mesmos dados sintéticos dos sensores. Os organizadores também forneceram um método de referência robusto baseado em frames que primeiro converteu eventos em imagens e em seguida aplicou técnicas padrão de fluxo óptico, desafiando os concorrentes a fazerem melhor explorando o pleno potencial da sensoriamento baseado em eventos. Apenas três equipes superaram essa linha de base, revelando tanto a promessa quanto os limites atuais da tecnologia.

Três caminhos vencedores para ler o movimento

A equipe vencedora, SOMIS-LAB, abraçou por completo a visão exclusiva por eventos. Em vez de agrupar eventos em fatias de tempo fixas, seu método ajustava a janela temporal dinamicamente com base na quantidade de eventos recebidos, depois deformava (warped) os eventos conforme hipóteses de movimento e avaliava o quão “nítido” o padrão resultante aparecia no domínio da frequência. Ao buscar o movimento que tornasse as arestas na cena o mais nítidas possível, eles alcançaram a melhor precisão — embora a um custo computacional alto que atualmente seria lento demais para um pouso real. As equipes em segundo e terceiro lugares, HRI e LUNARIS, seguiram uma via mais tradicional: agruparam eventos em imagens de curta duração e usaram ferramentas estabelecidas de visão computacional. Uma tratou a superfície lunar como quase plana e encontrou a melhor transformação global entre imagens sucessivas; a outra estimou movimento detalhado por pixel, removeu a parcela causada pela rotação do módulo usando dados do sensor de movimento e combinou isso com informação de distância para inferir a velocidade do módulo. Essas abordagens foram rápidas o suficiente para uso em tempo real e ainda assim superaram a linha de base.

O que aprendemos com casos difíceis

Ao estudar onde todos os métodos tiveram dificuldades, os autores descobriram que as trajetórias mais desafiadoras eram aquelas com fortes problemas de iluminação — imagens de origem superexpostas ou mal expostas, que produziram poucos eventos significativos após a conversão. Eles também observaram que manobras complexas de desvio, com curvas mais acentuadas e mudanças de atitude, eram geralmente mais difíceis de reconstruir do que descidas diretas. Curiosamente, muitas equipes experimentaram aprendizado profundo, mas frequentemente voltaram a métodos clássicos de visão para suas submissões finais, citando desafios como eventos esparsos, dados de treinamento limitados e a necessidade de generalização robusta. Uma pesquisa pós-competição também revelou que a maioria dos participantes converteu eventos em frames com temporização fixa, ressaltando quão rara ainda é a estratégia totalmente orientada a eventos da equipe vencedora.

O que isso significa para futuras missões lunares

O estudo conclui que câmeras baseadas em eventos são fortes candidatas para sistemas de pouso lunar futuros, particularmente em regiões polares exigentes. Mesmo com um conjunto de dados sintético e a desvantagem adicional de detalhes de calibração da câmera ausentes, várias equipes igualaram ou superaram um método de referência baseado em frames cuidadosamente elaborado. A solução mais precisa mostrou que abraçar plenamente o fluxo de eventos pode gerar excelentes estimativas de movimento, enquanto híbridos rápidos baseados em frames demonstraram que sistemas práticos em tempo real já estão ao alcance. Em conjunto, esses resultados marcam um passo importante rumo a módulos que podem “ver” movimento rápido e iluminação severa mais como um olho vivo, melhorando as chances de pousos precisos e seguros na Lua e além.

Citação: Fanti, P., Williams, L.B.S., Dvořák, O. et al. Event-based lunar optical flow egomotion estimation challenge: design and results of the ELOPE competition. npj Space Explor. 2, 18 (2026). https://doi.org/10.1038/s44453-026-00033-0

Palavras-chave: visão baseada em eventos, pouso lunar, estimação de egomotion, sensores neuromórficos, navegação autônoma