Clear Sky Science · es

Desafío de estimación de egomoción por flujo óptico lunar basado en eventos: diseño y resultados de la competición ELOPE

Por qué unos ojos más inteligentes importan en los aterrizajes lunares

Mientras las agencias espaciales se preparan para enviar robots y, eventualmente, personas de vuelta a la Luna, aterrizar de forma segura en terrenos accidentados y con sombras —especialmente cerca de los polos, donde el hielo puede ocultarse en la oscuridad permanente— se convierte en un reto importante. Este artículo explora un nuevo tipo de “ojo inteligente” para naves espaciales, llamado cámara basada en eventos, e informa sobre una competición mundial que evaluó qué tan bien distintos equipos podían usarla para guiar un módulo lunar hacia un aterrizaje seguro.

Una nueva forma de ver el movimiento en la oscuridad

A diferencia de las cámaras ordinarias que toman imágenes completas a intervalos fijos, las cámaras basadas en eventos solo reaccionan cuando cambia el brillo en un pequeño píxel. Cada cambio desencadena un “evento” puntual con una marca temporal precisa, creando un flujo de actualizaciones escasas y rápidas en lugar de imágenes voluminosas. Este diseño imita cómo funcionan los ojos biológicos y aporta ventajas clave para el vuelo espacial: respuesta extremadamente rápida, rango dinámico muy amplio y bajo consumo de energía. Esas fortalezas son especialmente útiles cerca del Polo Sur lunar, donde el Sol roza el horizonte, los cráteres quedan en sombras profundas y el polvo brillante y reflectante puede saturar fácilmente los sensores tradicionales.

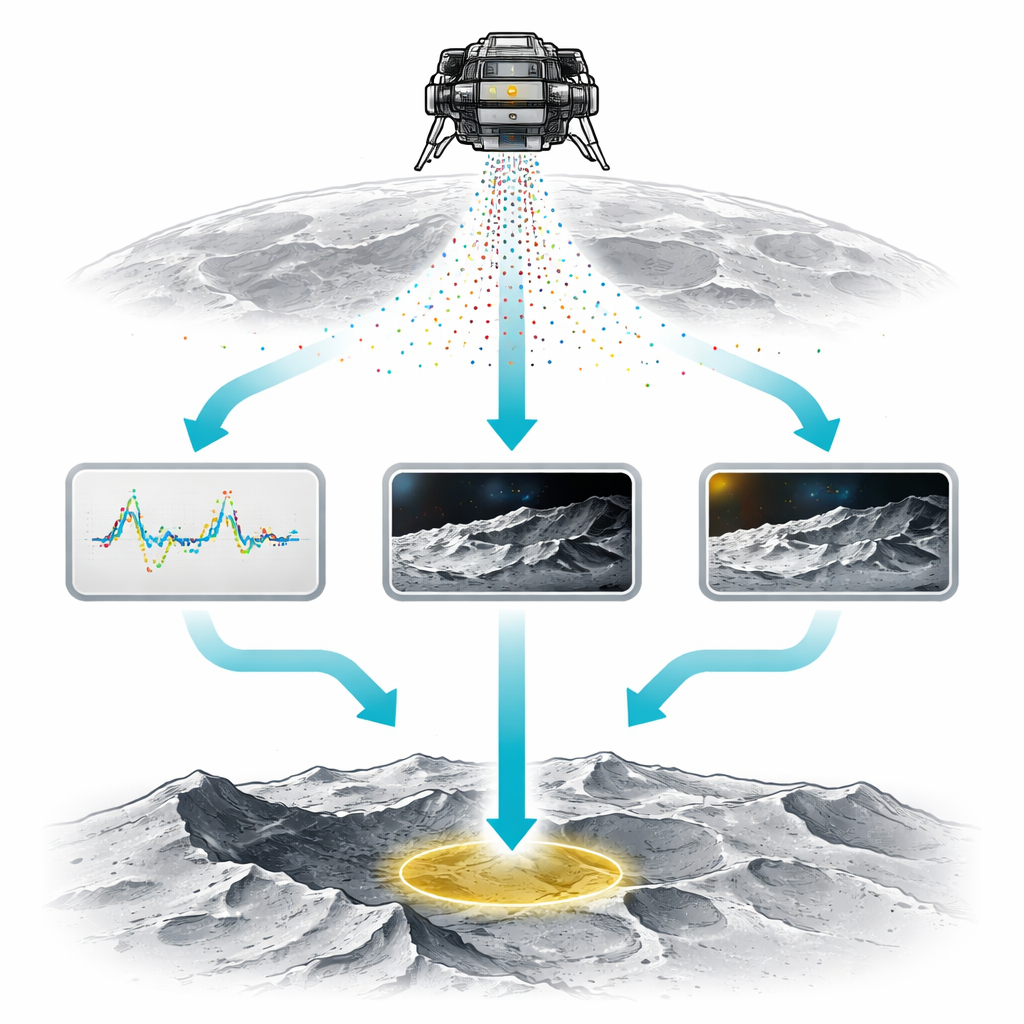

Construyendo un patio de pruebas lunar digital realista

Dado que todavía no existen datos reales basados en eventos procedentes de la Luna, los investigadores crearon el conjunto de datos y el desafío ELOPE. Usando software especializado, primero simularon trayectorias de descenso eficientes en combustible para una nave similar al módulo Apolo, incluyendo descensos ordinarios y maniobras más complejas de “desvío” donde el punto de aterrizaje cambia tarde en la aproximación. Una herramienta de renderizado planetario generó vistas detalladas y fotorrealistas de la superficie a lo largo de estas trayectorias bajo distintas condiciones de iluminación, y un simulador de cámara de eventos convirtió las secuencias de imágenes en flujos de eventos. Cada secuencia venía con “claves de respuesta” perfectas para el movimiento real del módulo, además de lecturas virtuales de un sensor de movimiento y un telémetro láser, permitiendo a los competidores probar con qué precisión sus métodos podían reconstruir la velocidad y dirección del módulo.

Un concurso global de ideas de navegación inteligentes

La competición ELOPE atrajo a 44 equipos de universidades, industria e investigadores independientes, con 21 alcanzando la hoja de resultados final y presentando 132 soluciones. Todos los equipos debían estimar la velocidad tridimensional del módulo a lo largo del tiempo a partir de los mismos datos sintéticos de sensores. Los organizadores también proporcionaron un método de referencia sólido basado en fotogramas que primero convertía los eventos en imágenes y luego aplicaba técnicas estándar de flujo óptico, desafiando a los competidores a superar este punto de referencia explotando el potencial completo del sensor basado en eventos. Solo tres equipos superaron esta línea base, revelando tanto la promesa como los límites actuales de la tecnología.

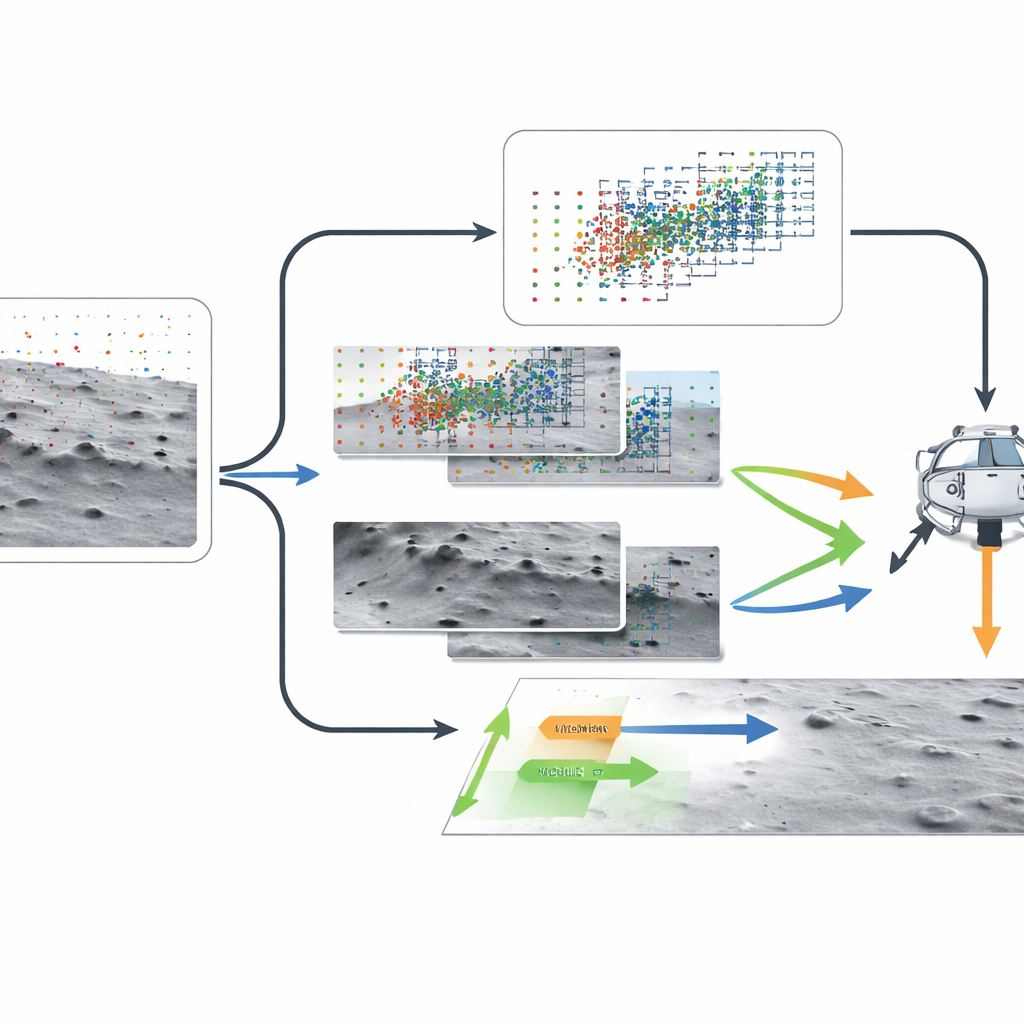

Tres vías ganadoras para leer el movimiento

El equipo ganador, SOMIS-LAB, apostó completamente por la visión basada únicamente en eventos. En lugar de agrupar eventos en intervalos temporales fijos, su método ajustaba la ventana temporal en tiempo real según la cantidad de eventos recibidos, luego deformaba los eventos según conjeturas de movimiento y evaluaba cuán “nítido” se veía el patrón resultante en el dominio de la frecuencia. Al buscar el movimiento que hacía los bordes de la escena lo más precisos posible, alcanzaron la mejor exactitud—aunque a un coste computacional elevado que actualmente sería demasiado lento para un aterrizaje real. Los equipos en segundo y tercer lugar, HRI y LUNARIS, optaron por un enfoque más tradicional: agrupar eventos en imágenes efímeras y usar herramientas establecidas de visión por computador. Uno trató la superficie lunar como casi plana y halló la transformación global óptima entre imágenes sucesivas; el otro estimó el movimiento por píxel, eliminó la parte causada por la rotación del módulo usando datos del sensor de movimiento y combinó eso con información de distancia para inferir la velocidad del módulo. Estos enfoques fueron lo bastante rápidos para uso en tiempo real y aún así superaron la referencia.

Qué aprendemos de los casos difíciles

Al estudiar dónde tropezaron todos los métodos, los autores encontraron que las trayectorias más difíciles eran las que presentaban fuertes problemas de iluminación: imágenes fuente sobresaturadas o con mala exposición, que producían pocos eventos significativos al convertirse. También observaron que las maniobras complejas de desvío, con giros más bruscos y cambios de actitud, fueron generalmente más difíciles de reconstruir que los descensos directos. Curiosamente, muchos equipos experimentaron con aprendizaje profundo pero a menudo volvieron a métodos clásicos de visión para sus envíos finales, citando desafíos como eventos escasos, datos de entrenamiento limitados y la necesidad de una generalización robusta. Una encuesta posterior a la competición también reveló que la mayoría de los participantes convirtieron los eventos en fotogramas con temporización fija, subrayando lo raro que sigue siendo el enfoque totalmente dirigido por eventos del equipo ganador.

Qué significa esto para futuras misiones lunares

El estudio concluye que las cámaras basadas en eventos son candidatas fuertes para futuros sistemas de aterrizaje lunar, particularmente en regiones polares exigentes. Incluso con un conjunto de datos sintético y la desventaja añadida de la falta de detalles de calibración de la cámara, varios equipos igualaron o superaron un método de referencia basado en fotogramas cuidadosamente diseñado. La solución más precisa demostró que abrazar completamente el flujo de eventos puede producir excelentes estimaciones de movimiento, mientras que los híbridos rápidos basados en fotogramas mostraron que los sistemas prácticos en tiempo real ya están al alcance. En conjunto, estos resultados marcan un paso importante hacia módulos que puedan “ver” el movimiento rápido y la iluminación difícil más como un ojo vivo, mejorando las probabilidades de aterrizajes precisos y seguros en la Luna y más allá.

Cita: Fanti, P., Williams, L.B.S., Dvořák, O. et al. Event-based lunar optical flow egomotion estimation challenge: design and results of the ELOPE competition. npj Space Explor. 2, 18 (2026). https://doi.org/10.1038/s44453-026-00033-0

Palabras clave: visión basada en eventos, aterrizaje lunar, estimación de egomoción, sensores neuromórficos, navegación autónoma