Clear Sky Science · de

Herausforderung zur ego-motion-Schätzung des lunaren optischen Flusses auf Event-Basis: Aufbau und Ergebnisse des ELOPE-Wettbewerbs

Warum klügere Augen für Mondlandungen wichtig sind

Während Raumfahrtagenturen Roboter und schließlich Menschen zurück zum Mond schicken, wird die sichere Landung in unebenem, schattigem Terrain – besonders in Polnähe, wo Eis in dauerhafter Dunkelheit verborgen liegen kann – zu einer großen Herausforderung. Dieser Beitrag untersucht eine neue Art von „intelligentem Auge“ für Raumfahrzeuge, die ereignisbasierte Kamera heißt, und berichtet über einen weltweiten Wettbewerb, der prüfte, wie gut verschiedene Teams sie nutzen können, um einen Mondlander zu einem sicheren Aufsetzen zu führen.

Eine neue Art, Bewegung im Dunkeln zu sehen

Im Gegensatz zu üblichen Kameras, die in festen Intervallen vollständige Bilder aufnehmen, reagieren ereignisbasierte Kameras nur, wenn die Helligkeit an einem winzigen Pixel sich ändert. Jede Änderung löst ein punktuelles „Ereignis“ mit genauer Zeitmarke aus und erzeugt einen Strom sparsamer, schneller Aktualisierungen statt voluminöser Bilder. Dieses Design ahmt nach, wie biologische Augen arbeiten, und bringt entscheidende Vorteile für den Raumflug: extrem schnelle Reaktion, sehr großer Helligkeitsbereich und geringer Stromverbrauch. Diese Stärken sind besonders nützlich in der Nähe des Südpols des Mondes, wo die Sonne knapp über dem Horizont steht, Krater in tiefem Schatten liegen und helles, reflektierendes Staub herkömmliche Sensoren schnell überfordern kann.

Ein realistischer digitaler Mondspielplatz

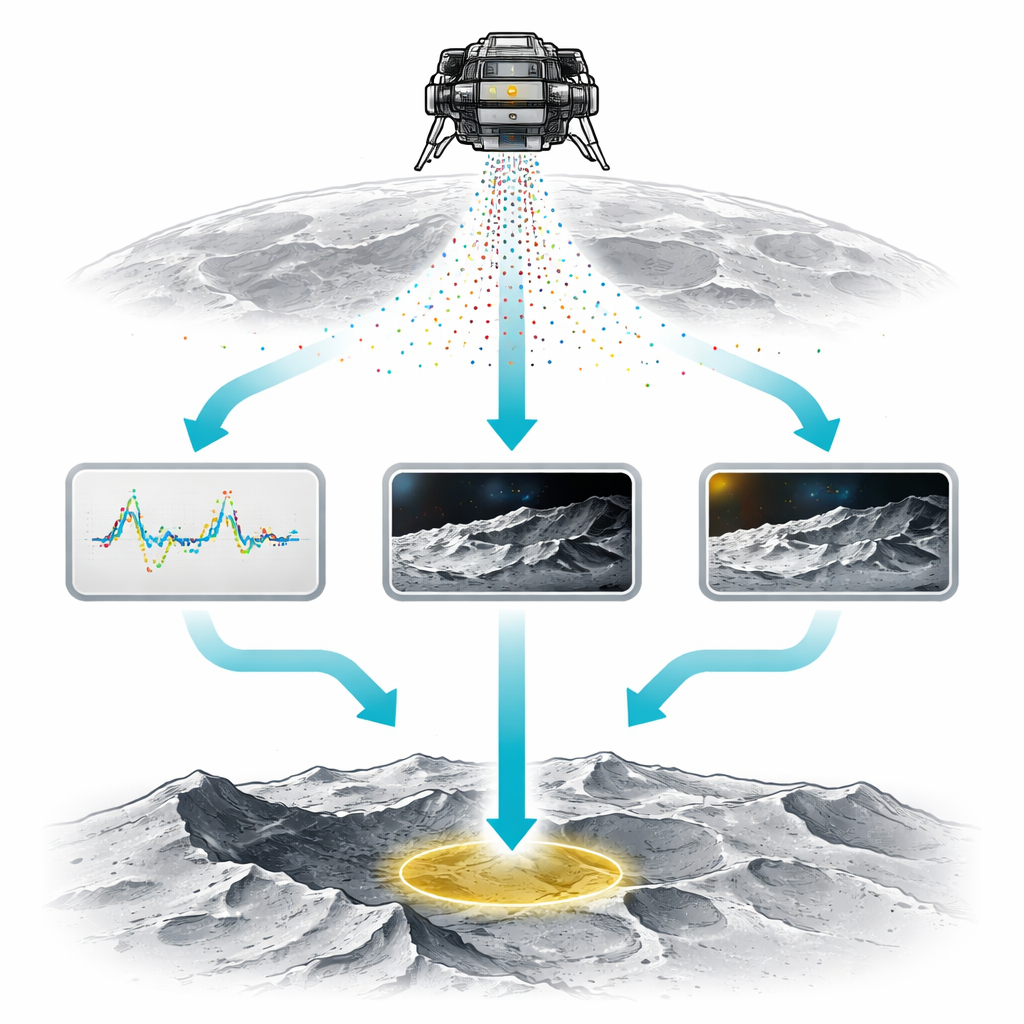

Da echte ereignisbasierte Daten vom Mond noch nicht vorliegen, erstellten die Forschenden den ELOPE-Datensatz und die Challenge. Mit spezialisierter Software simulierten sie zunächst treibstoffsparende Landewege für ein Raumfahrzeug ähnlich der Apollo-Landevorrichtung, einschließlich gewöhnlicher Abstiege und komplexerer „Ausweich“-Manöver, bei denen sich der Landestellenort spät im Anflug ändert. Ein planetarer Renderer erzeugte dann detailreiche, fotoähnliche Ansichten der Oberfläche entlang dieser Bahnen unter verschiedenen Beleuchtungsbedingungen, und ein Event-Kamera-Simulator wandelte die Bildsequenzen in Ereignisströme um. Jede Sequenz wurde mit perfekten „Antwortschlüsseln“ für die wahre Bewegung des Landers sowie virtuellen Messwerten eines Bewegungssensors und eines Laser-Entfernungsmessers versehen, sodass Teilnehmer testen konnten, wie genau ihre Methoden Geschwindigkeit und Richtung des Landers rekonstruieren konnten.

Ein globaler Wettbewerb für clevere Navigationsideen

Der ELOPE-Wettbewerb zog 44 Teams aus Universitäten, der Industrie und unabhängigen Forschenden an, von denen 21 die Endwertung erreichten und 132 Lösungen einreichten. Alle Teams mussten die dreidimensionale Geschwindigkeit des Landers über die Zeit aus denselben synthetischen Sensordaten schätzen. Die Veranstalter stellten außerdem eine starke frame-basierte Referenzmethode bereit, die Ereignisse zunächst in Bilder umwandelte und dann gängige Methoden zur optischen Flussbestimmung anwendete, um die Teilnehmenden herauszufordern, durch Ausnutzung des vollen Potenzials ereignisbasierter Sensorik bessere Ergebnisse zu erzielen. Nur drei Teams übertrafen diese Baseline, was sowohl das Versprechen als auch die gegenwärtigen Grenzen der Technologie aufzeigte.

Drei siegreiche Wege, Bewegung zu lesen

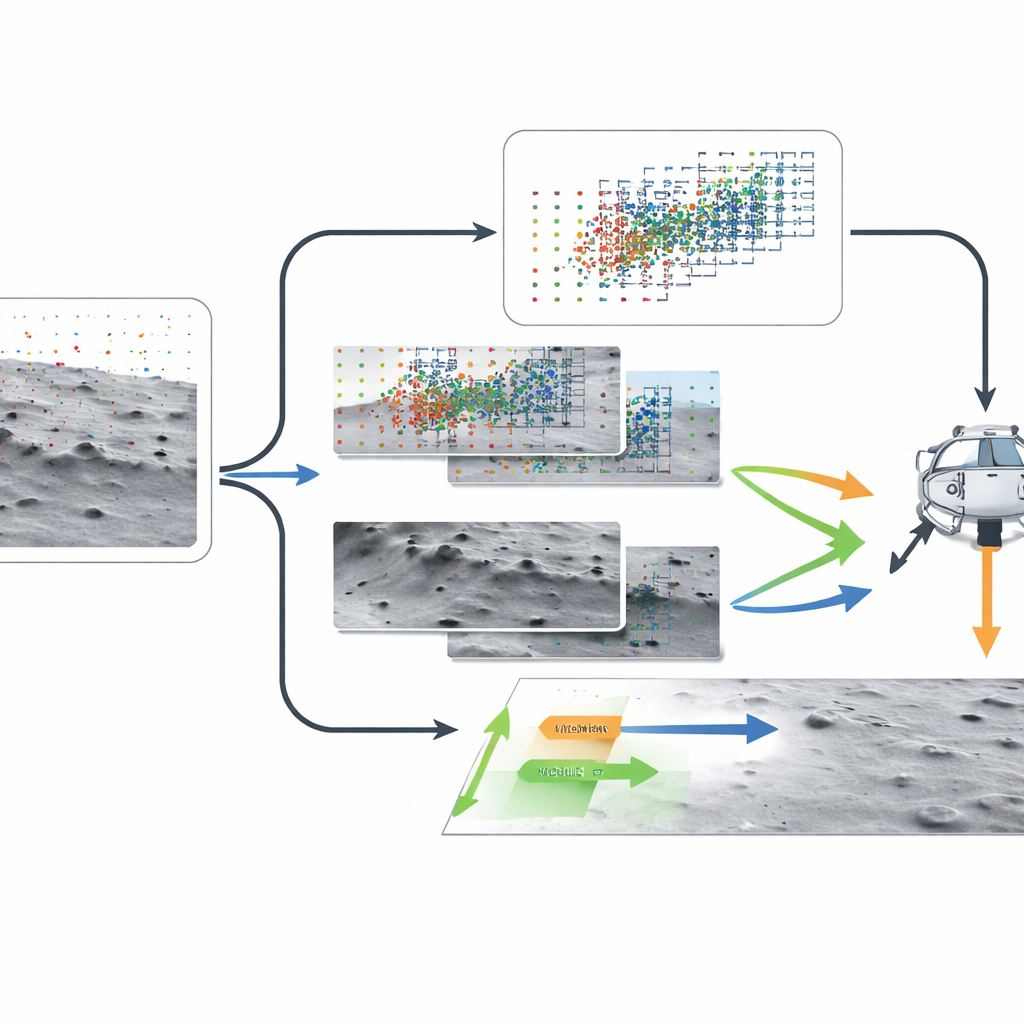

Das beste Team, SOMIS-LAB, setzte vollständig auf die rein ereignisbasierte Sicht der Welt. Anstatt Ereignisse in feste Zeitabschnitte zu bündeln, passte ihre Methode das Zeitfenster dynamisch an die eintreffende Ereignisanzahl an, verzerrte dann die Ereignisse entsprechend getesteter Bewegungsannahmen und bewertete, wie „scharf“ das resultierende Muster im Frequenzbereich erschien. Indem sie die Bewegung suchten, die Kanten in der Szene so deutlich wie möglich machte, erzielten sie die beste Genauigkeit – allerdings zu einem hohen Rechenaufwand, der derzeit für eine echte Landung zu langsam wäre. Die zweit- und drittplatzierten Teams, HRI und LUNARIS, wählten einen traditionelleren Weg: Sie banden Ereignisse zu kurzlebigen Bildern zusammen und nutzten etablierte Computer-Vision-Werkzeuge. Das eine Team behandelte die Mondoberfläche als annähernd eben und fand die beste Gesamttransformation zwischen aufeinanderfolgenden Bildern; das andere schätzte detaillierte pro-Pixel-Bewegungen, entfernte den Anteil, der durch die Rotation des Landers verursacht wurde, mithilfe von Bewegungssensordaten, und kombinierte dies mit Entfernungsinformationen, um die Geschwindigkeit des Landers abzuleiten. Diese Ansätze waren schnell genug für den Echtzeitbetrieb und übertrafen dennoch die Referenzmethode.

Was wir aus schwierigen Fällen lernen

Beim Studium der Fälle, in denen alle Methoden Probleme hatten, stellten die Autorinnen und Autoren fest, dass die schwierigsten Trajektorien jene mit starken Beleuchtungsproblemen waren – überbelichtete oder schlecht belichtete Quellbilder, die nach der Umwandlung nur wenige aussagekräftige Ereignisse lieferten. Außerdem erwiesen sich komplexe Ausweichmanöver mit schärferen Kurven und Lageänderungen allgemein als schwerer rekonstruierbar als gerade Abstiege. Interessanterweise experimentierten viele Teams mit Deep Learning, kehrten für ihre finalen Einreichungen aber oft zu klassischen Vision-Methoden zurück und nannten Herausforderungen wie spärliche Ereignisse, begrenzte Trainingsdaten und die Notwendigkeit robuster Generalisierung als Gründe. Eine Umfrage nach dem Wettbewerb zeigte außerdem, dass die meisten Teilnehmenden Ereignisse in Frames mit fester Zeitsteuerung umwandelten, was unterstreicht, wie selten die vollständig ereignisgesteuerte Strategie des Gewinnerteams noch ist.

Was das für künftige Mondmissionen bedeutet

Die Studie kommt zu dem Schluss, dass ereignisbasierte Kameras starke Anwärter für künftige Systeme zur Mondlandung sind, insbesondere in anspruchsvollen Polregionen. Selbst mit einem synthetischen Datensatz und dem zusätzlichen Handicap fehlender Kamerakalibrierungsdetails konnten mehrere Teams eine sorgfältig ausgelegte frame-basierte Referenzmethode erreichen oder übertreffen. Die genaueste Lösung zeigte, dass das vollständige Nutzen des Ereignisstroms exzellente Bewegungsschätzungen liefern kann, während schnelle frame-basierte Hybride demonstrierten, dass praktische, echtzeitfähige Systeme bereits in Reichweite sind. Zusammen markieren diese Ergebnisse einen wichtigen Schritt hin zu Landern, die schnelle Bewegungen und harte Beleuchtungsverhältnisse eher wie ein lebendes Auge „sehen“, was die Chancen für sichere, präzise Landungen auf dem Mond und darüber hinaus verbessert.

Zitation: Fanti, P., Williams, L.B.S., Dvořák, O. et al. Event-based lunar optical flow egomotion estimation challenge: design and results of the ELOPE competition. npj Space Explor. 2, 18 (2026). https://doi.org/10.1038/s44453-026-00033-0

Schlüsselwörter: ereignisbasierte Vision, Mondlandung, Egomotion-Schätzung, neuromorphe Sensoren, autonome Navigation