Clear Sky Science · it

Sfida di stima dell’egomozione ottica lunare basata su eventi: progettazione e risultati della competizione ELOPE

Perché occhi più intelligenti contano per gli atterraggi lunari

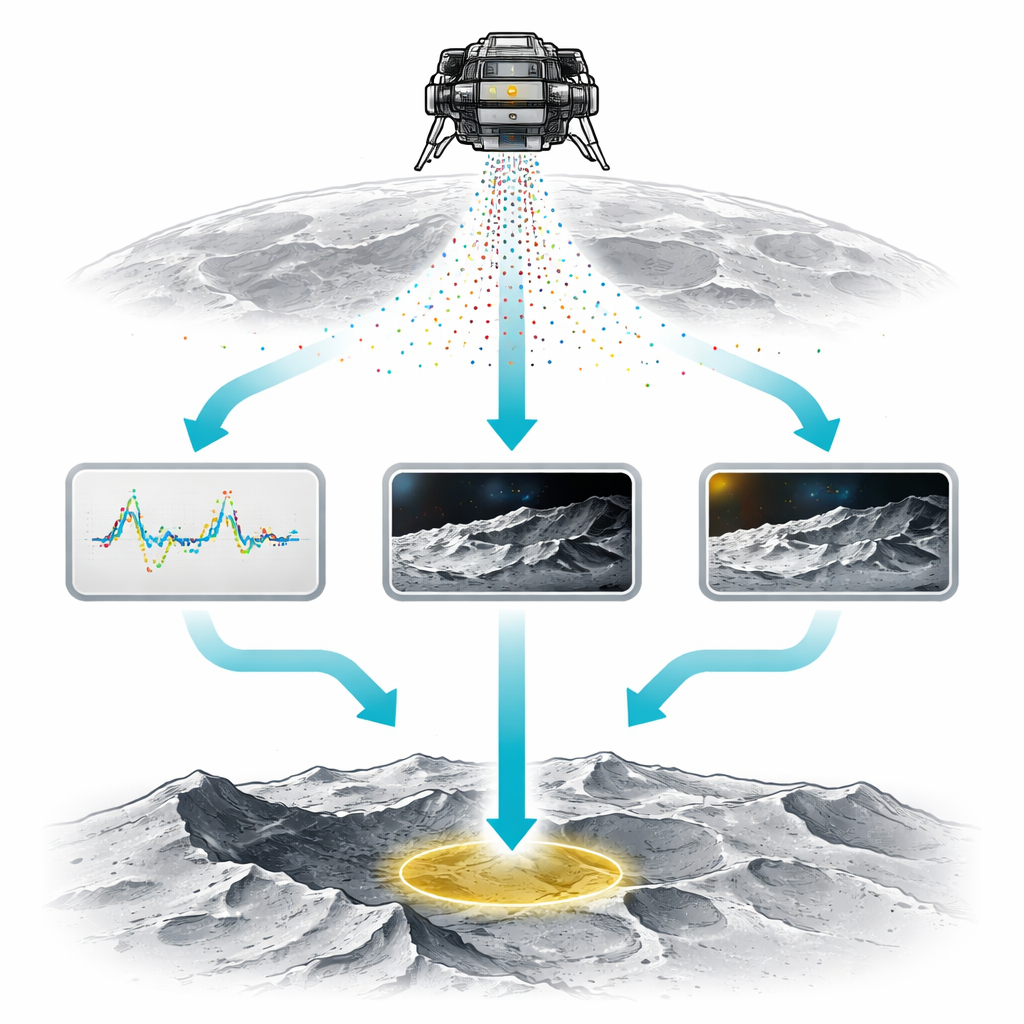

Mentre le agenzie spaziali si preparano a inviare di nuovo robot e, in futuro, persone sulla Luna, atterrare in sicurezza su terreni accidentati e in ombra—soprattutto vicino ai poli dove il ghiaccio può restare in oscurità perenne—diventa una sfida importante. Questo articolo esplora un nuovo tipo di “occhio intelligente” per i veicoli spaziali, chiamato telecamera basata su eventi, e riporta i risultati di una competizione mondiale che ha testato quanto bene diversi team riuscissero a usare questa tecnologia per guidare un lander lunare verso un punto di atterraggio sicuro.

Un nuovo modo di vedere il moto nel buio

A differenza delle videocamere tradizionali che catturano immagini complete a intervalli fissi, le telecamere basate su eventi reagiscono solo quando la luminosità a un singolo pixel cambia. Ogni cambiamento genera un «evento» puntuale con un marcaggio temporale preciso, producendo uno stream di aggiornamenti sparsi e rapidissimi invece di immagini pesanti. Questo progetto imita il funzionamento degli occhi biologici e offre vantaggi chiave per il volo spaziale: risposta estremamente rapida, gamma dinamica molto ampia e basso consumo energetico. Queste caratteristiche sono particolarmente utili vicino al Polo Sud lunare, dove il Sole sfiora l’orizzonte, i crateri restano in ombra profonda e polveri luminose e riflettenti possono facilmente saturare i sensori tradizionali.

Costruire un parco giochi lunare digitale realistico

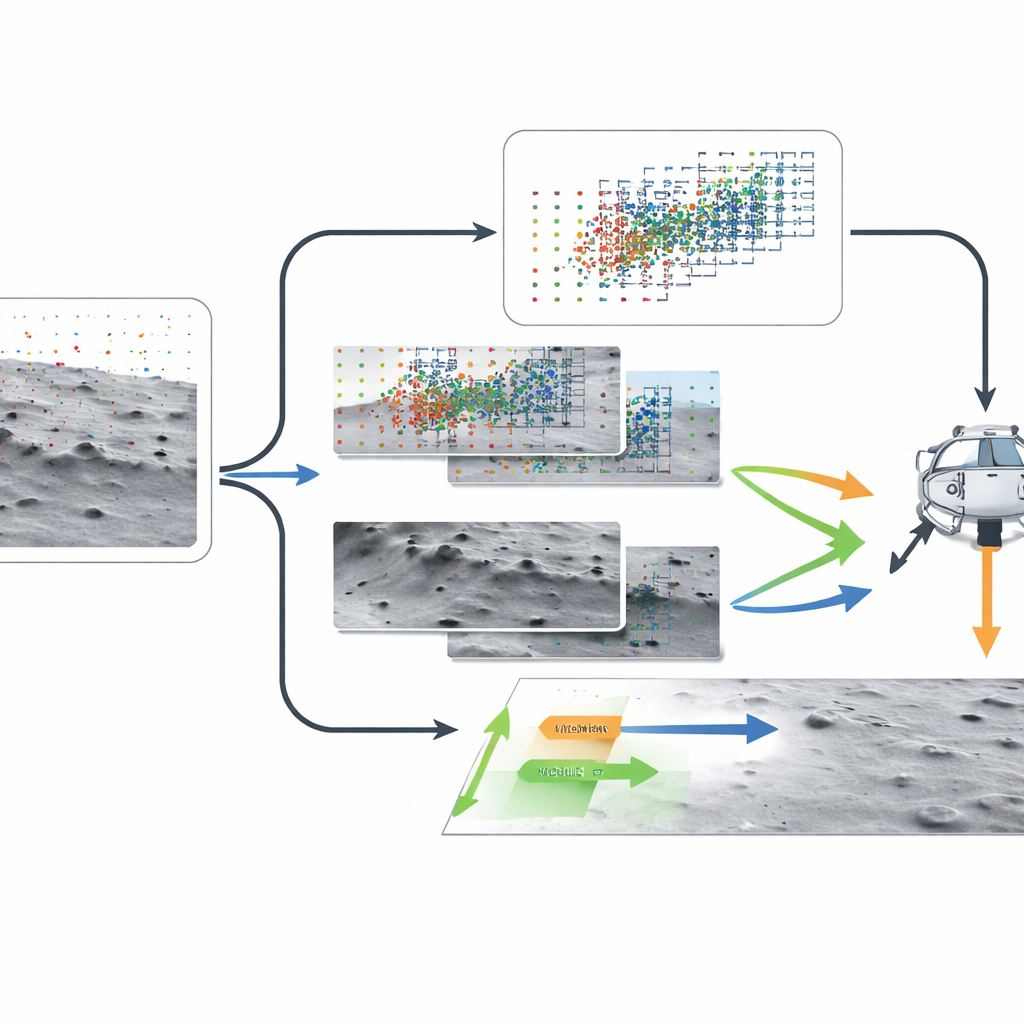

Poiché non esistono ancora dati reali di telecamere basate su eventi dalla Luna, i ricercatori hanno creato il dataset e la sfida ELOPE. Usando software specializzati, hanno prima simulato traiettorie di discesa a basso consumo di carburante per un veicolo simile al lander Apollo, includendo sia discese ordinarie sia manovre di «deviazione» più complesse in cui il sito di atterraggio cambia tardivamente nell’avvicinamento. Uno strumento di rendering planetario ha quindi generato viste dettagliate e fotorealistiche della superficie lungo queste traiettorie sotto differenti condizioni di illuminazione, e un simulatore di telecamera a eventi ha convertito le sequenze di immagini in flussi di eventi. Ogni sequenza è stata accompagnata da chiavi di riferimento perfette per il moto reale del lander, oltre a letture virtuali da un sensore di movimento e da un telemetro laser, permettendo ai concorrenti di verificare quanto accuratamente i loro metodi potessero ricostruire velocità e direzione del lander.

Una competizione globale di idee per la navigazione intelligente

La competizione ELOPE ha attratto 44 team provenienti da università, industria e ricercatori indipendenti, con 21 team arrivati alla classifica finale e 132 soluzioni sottoposte. Tutti i team dovevano stimare la velocità tridimensionale del lander nel tempo a partire dagli stessi dati sintetici dei sensori. Gli organizzatori hanno inoltre fornito un solido metodo di riferimento basato su frame che prima convertiva gli eventi in immagini e poi applicava tecniche standard di optical flow, sfidando i concorrenti a fare meglio sfruttando il pieno potenziale della sensoristica basata su eventi. Solo tre team hanno superato questa baseline, rivelando sia le promesse sia i limiti attuali della tecnologia.

Tre percorsi vincenti per leggere il moto

Il team vincitore, SOMIS-LAB, ha sfruttato pienamente la visione esclusivamente basata su eventi. Invece di raggruppare gli eventi in fette temporali fisse, il loro metodo ha adattato la finestra temporale al volo in base al numero di eventi ricevuti, quindi ha deformato gli eventi secondo ipotesi di moto provvisorie e valutato quanto il pattern risultante apparisse «nitido» in dominio di frequenza. Cercando il moto che rendeva i bordi della scena più netti possibile, hanno ottenuto la migliore accuratezza—anche se a un costo computazionale elevato che al momento risulterebbe troppo lento per un atterraggio reale. I team arrivati seconda e terza, HRI e LUNARIS, hanno seguito un percorso più tradizionale: hanno raggruppato gli eventi in immagini di breve durata e hanno usato strumenti affermati di computer vision. Uno ha considerato la superficie lunare quasi piana e ha trovato la migliore trasformazione complessiva tra immagini successive; l’altro ha stimato il moto dettagliato per pixel, ha rimosso la componente dovuta alla rotazione del lander usando i dati del sensore di movimento e ha combinato queste informazioni con le distanze per inferire la velocità del veicolo. Questi approcci erano sufficientemente veloci per l’uso in tempo reale e hanno comunque superato la baseline.

Cosa impariamo dai casi difficili

Analizzando dove tutti i metodi hanno incontrato maggiori difficoltà, gli autori hanno scoperto che le traiettorie più problematiche erano quelle con forti problemi di illuminazione—immagini sorgente sovraesposte o con scarsa esposizione che, una volta convertite, producevano pochi eventi significativi. Hanno inoltre osservato che le complesse manovre di deviazione, con virate più brusche e cambi di assetto, erano generalmente più difficili da ricostruire rispetto a discese lineari. È interessante che molti team abbiano sperimentato con il deep learning ma spesso siano tornati a metodi classici di visione per le submission finali, citando sfide come la scarsità di eventi, dati di addestramento limitati e la necessità di una generalizzazione robusta. Un sondaggio post-competizione ha inoltre rivelato che la maggioranza dei partecipanti convertiva gli eventi in frame con temporizzazione fissa, sottolineando quanto sia ancora rara la strategia completamente guidata dagli eventi adottata dal team vincitore.

Cosa significa per le future missioni lunari

Lo studio conclude che le telecamere basate su eventi sono forti candidate per i futuri sistemi di atterraggio lunare, in particolare nelle impegnative regioni polari. Anche con un dataset sintetico e lo svantaggio aggiunto di dettagli di calibrazione della camera mancanti, diversi team hanno eguagliato o superato un metodo di riferimento basato su frame accuratamente progettato. La soluzione più accurata ha dimostrato che abbracciare completamente lo stream di eventi può fornire eccellenti stime del moto, mentre ibridi frame‑based veloci hanno dimostrato che sistemi pratici in tempo reale sono già alla portata. Nel loro insieme, questi risultati rappresentano un passo importante verso lander che possono «vedere» il moto rapido e condizioni di illuminazione estreme più come un occhio vivente, migliorando le probabilità di atterraggi sicuri e precisi sulla Luna e oltre.

Citazione: Fanti, P., Williams, L.B.S., Dvořák, O. et al. Event-based lunar optical flow egomotion estimation challenge: design and results of the ELOPE competition. npj Space Explor. 2, 18 (2026). https://doi.org/10.1038/s44453-026-00033-0

Parole chiave: visione basata su eventi, atterraggio lunare, stima dell’egomozione, sensori neuromorfici, navigazione autonoma