Clear Sky Science · nl

Evenementgestuurde maan optische stroom egomotie-schatting uitdaging: ontwerp en resultaten van de ELOPE competitie

Waarom slimmer zicht belangrijk is voor maanlandingen

Nu ruimtevaartorganisaties zich voorbereiden op het terugsturen van robots en uiteindelijk mensen naar de Maan, wordt veilig landen in ruw, schaduwrijk terrein — vooral nabij de polen waar ijs in permanente duisternis kan schuilen — een grote uitdaging. Dit artikel onderzoekt een nieuw soort “slimme oog” voor ruimtevaartuigen, een evenementgestuurde camera, en rapporteert over een wereldwijde competitie die testte hoe goed verschillende teams deze sensor konden gebruiken om een maanlander naar een veilige touchdown te leiden.

Een nieuwe manier om beweging in het donker te zien

In tegenstelling tot gewone camera’s die volledige beelden met vaste tussenpozen maken, reageren evenementgestuurde camera’s alleen wanneer de helderheid op een klein pixel verandert. Elke verandering triggert een nauwkeurig getimed “event”, wat een stroom van spaarzame, snelle updates oplevert in plaats van omvangrijke afbeeldingen. Dit ontwerp bootst na hoe biologische ogen werken en biedt belangrijke voordelen voor de ruimtevaart: extreem snelle respons, zeer breed helderheidsbereik en laag energieverbruik. Die sterke punten zijn bijzonder nuttig nabij de zuidpool van de Maan, waar de zon laag langs de horizon staat, kraters in diepe schaduw liggen en fel reflecterend stof traditionele sensoren gemakkelijk kan overweldigen.

Een realistisch digitaal maan-speelveld bouwen

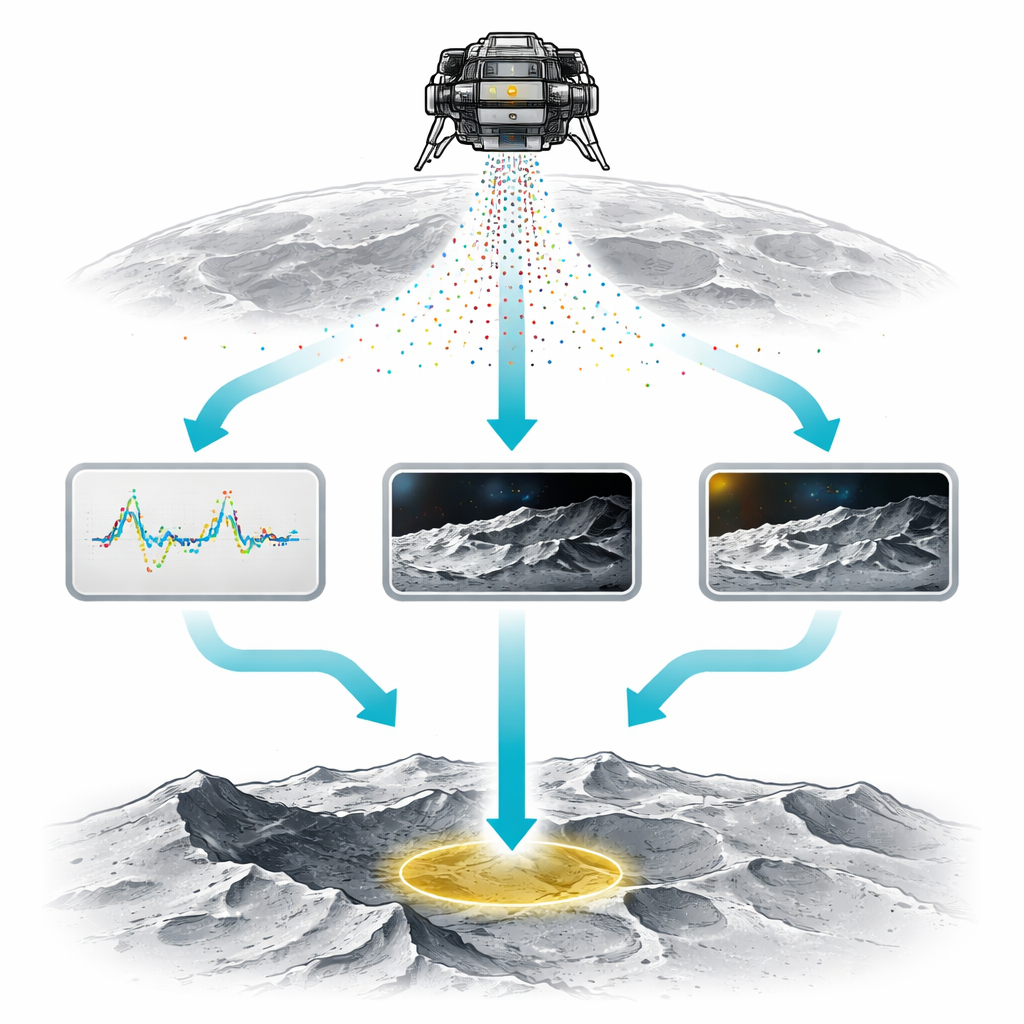

Aangezien echte evenementgestuurde data van de Maan nog niet bestaan, creëerden de onderzoekers de ELOPE-dataset en -uitdaging. Met gespecialiseerde software simuleerden ze eerst brandstofefficiënte landingspaden voor een ruimtevaartuig vergelijkbaar met de Apollo-lander, inclusief zowel gewone dalingen als complexere “divert”-manoeuvres waarbij de landingsplaats laat in de nadering verandert. Een planetaire rendertool genereerde vervolgens gedetailleerde, foto-achtige beelden van het oppervlak langs deze paden onder verschillende belichtingsomstandigheden, en een event-camera-simulator zette de beeldreeksen om in stroompjes events. Elke sequentie werd geleverd met perfecte ‘antwoordensleutels’ voor de werkelijke beweging van de lander, plus virtuele metingen van een bewegingssensor en een laserafstandsmeter, zodat deelnemers konden testen hoe nauwkeurig hun methoden de snelheid en richting van de lander konden reconstrueren.

Een wereldwijde wedstrijd voor slimme navigatie-ideeën

De ELOPE-competitie trok 44 teams van universiteiten, industrie en onafhankelijke onderzoekers, waarvan 21 de eindscorelijst haalden en 132 oplossingen indienden. Alle teams moesten de driedimensionale snelheid van de lander in de tijd schatten uit dezelfde synthetische sensorgegevens. De organisatoren leverden ook een sterke frame-gebaseerde referentiemethode die eerst events naar beelden omzette en daarna standaard optische-stroomtechnieken toepaste, als uitdaging voor deelnemers om beter te doen door het volledige potentieel van evenementgestuurde sensoren te benutten. Slechts drie teams versloegen deze baseline, wat zowel de belofte als de huidige beperkingen van de technologie blootlegt.

Drie winnende wegen om beweging te lezen

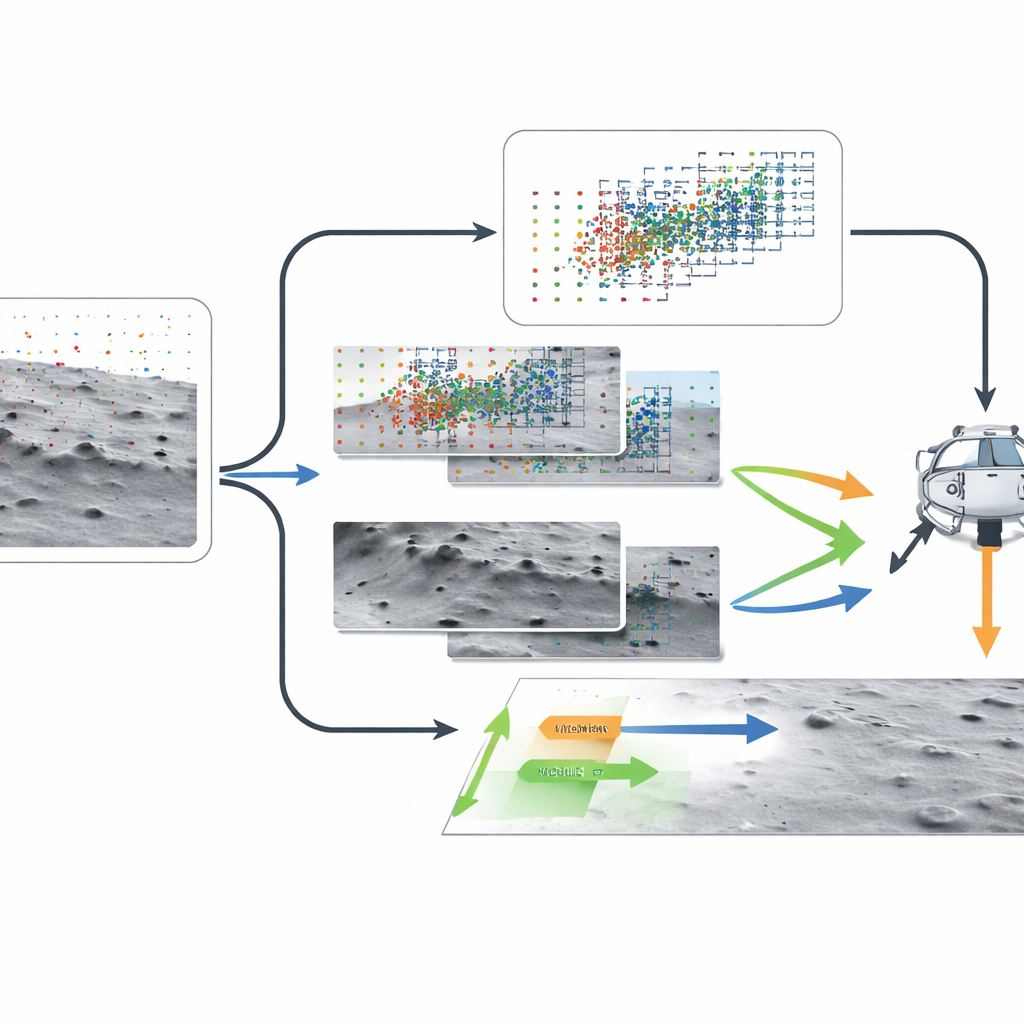

Het winnende team, SOMIS-LAB, omarmde volledig de event-only kijk op de wereld. In plaats van events in vaste tijdsintervallen te groeperen, paste hun methode het tijdvenster dynamisch aan op basis van het aantal binnenkomende events, vervolgens vervormden ze de events volgens proefmatige bewegingsgissingen en beoordeelden ze hoe “scherp” het resulterende patroon in het frequentiedomein leek. Door te zoeken naar de beweging die randen in de scène het meest scherp maakte, bereikten ze de beste nauwkeurigheid — hoewel tegen hoge rekenkosten die momenteel te traag zouden zijn voor een echte landing. De tweede en derde plaats, HRI en LUNARIS, kozen een meer traditionele route: zij binden events in kortstondige beelden en gebruikten gevestigde computer vision-tools. De één behandelde het maoppervlak als nagenoeg vlak en vond de beste algemene transformatie tussen opeenvolgende beelden; de ander schatte gedetailleerde per-pixel beweging, verwijderde het door de lander veroorzaakte deel veroorzaakt door rotatie met behulp van bewegingssensorgegevens, en combineerde dit met afstandsinformatie om de snelheid van de lander af te leiden. Deze benaderingen waren snel genoeg voor realtime gebruik en presteerden nog steeds beter dan de baseline.

Wat we leren van moeilijke gevallen

Door te bestuderen waar alle methoden moeite mee hadden, vonden de auteurs dat de lastigste trajecten die met sterke belichtingsproblemen waren — overbelichte of slecht belichte bronbeelden, die weinig zinvolle events opleverden nadat ze waren geconverteerd. Ze zagen ook dat complexe divert-manoeuvres, met scherpere bochten en attitudeveranderingen, over het algemeen moeilijker te reconstrueren waren dan eenvoudige dalingen. Interessant is dat veel teams experimenteerden met deep learning maar vaak terugvielen op klassieke visiemethoden voor hun definitieve inzendingen, met als redenen uitdagingen zoals spaarzame events, beperkte trainingsdata en de noodzaak van robuuste generalisatie. Een enquête na de competitie toonde ook aan dat de meeste deelnemers events omzettten in frames met vaste timing, wat benadrukt hoe zeldzaam de volledig event-gestuurde strategie van het winnende team nog steeds is.

Wat dit betekent voor toekomstige maanmissies

De studie concludeert dat evenementgestuurde camera’s sterke kanshebbers zijn voor toekomstige maanlandingssystemen, met name in veeleisende polaire gebieden. Zelfs met een synthetische dataset en het extra nadeel van ontbrekende cameracalibratiedetails, evenaarden of overtroffen meerdere teams een zorgvuldig samengestelde frame-gebaseerde referentiemethode. De meest nauwkeurige oplossing liet zien dat het volledig omarmen van de eventstroom uitstekende bewegingsschattingen kan opleveren, terwijl snelle frame-gebaseerde hybriden aantoonden dat praktische, realtime systemen al binnen bereik zijn. Samen markeren deze resultaten een belangrijke stap naar landers die snelle beweging en harde belichting meer als een levend oog kunnen “zien”, wat de kans op veilige, nauwkeurige touchdowns op de Maan en daarbuiten vergroot.

Bronvermelding: Fanti, P., Williams, L.B.S., Dvořák, O. et al. Event-based lunar optical flow egomotion estimation challenge: design and results of the ELOPE competition. npj Space Explor. 2, 18 (2026). https://doi.org/10.1038/s44453-026-00033-0

Trefwoorden: evenementgestuurde visie, maanlanding, egomotieschatting, neuromorfe sensoren, autonome navigatie