Clear Sky Science · fr

Défi d’estimation d’egomotion optique lunaire basé sur des événements : conception et résultats de la compétition ELOPE

Pourquoi des « yeux » plus intelligents comptent pour les atterrissages lunaires

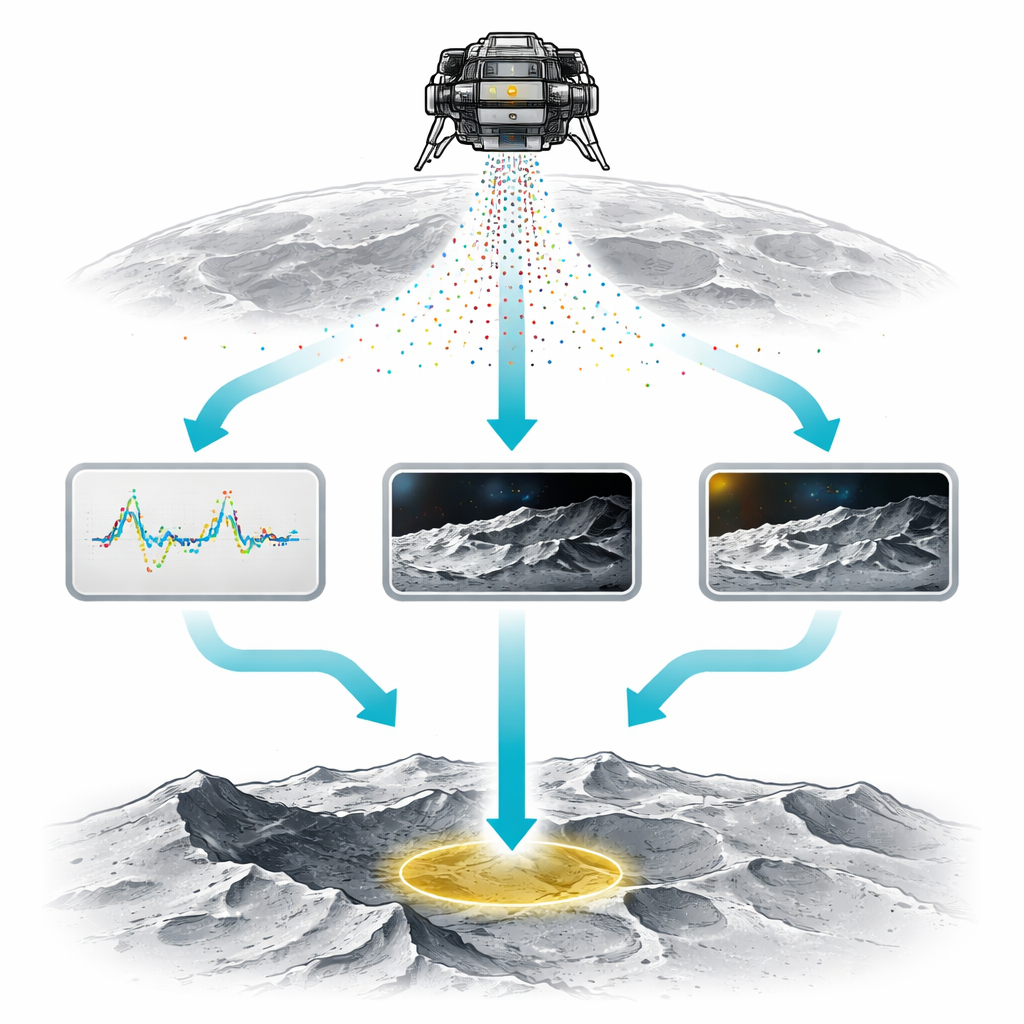

Alors que les agences spatiales se préparent à renvoyer des robots puis des humains sur la Lune, atterrir en toute sécurité sur un terrain accidenté et ombragé — en particulier près des pôles où la glace peut rester cachée dans l’obscurité permanente — devient un défi majeur. Cet article explore un nouveau type de « œil intelligent » pour les engins spatiaux, appelé caméra basée sur des événements, et présente un concours mondial qui a évalué la capacité de différentes équipes à l’utiliser pour guider un module lunaire vers un point d’atterrissage sûr.

Une nouvelle façon de percevoir le mouvement dans l’obscurité

Contrairement aux caméras ordinaires qui prennent des images complètes à intervalles fixes, les caméras basées sur des événements ne réagissent que lorsque la luminosité à un pixel change. Chaque variation déclenche un « événement » précis horodaté, produisant un flux d’informations clairsemé et rapide plutôt que des images volumineuses. Ce principe imite le fonctionnement des yeux biologiques et apporte des avantages clés pour le vol spatial : réactivité extrêmement rapide, très large plage de luminosité et faible consommation d’énergie. Ces points forts sont particulièrement utiles près du pôle Sud lunaire, où le Soleil frôle l’horizon, les cratères sont plongés dans l’ombre profonde et la poussière brillante et réfléchissante peut facilement saturer les capteurs traditionnels.

Construire un terrain de jeu lunaire numérique réaliste

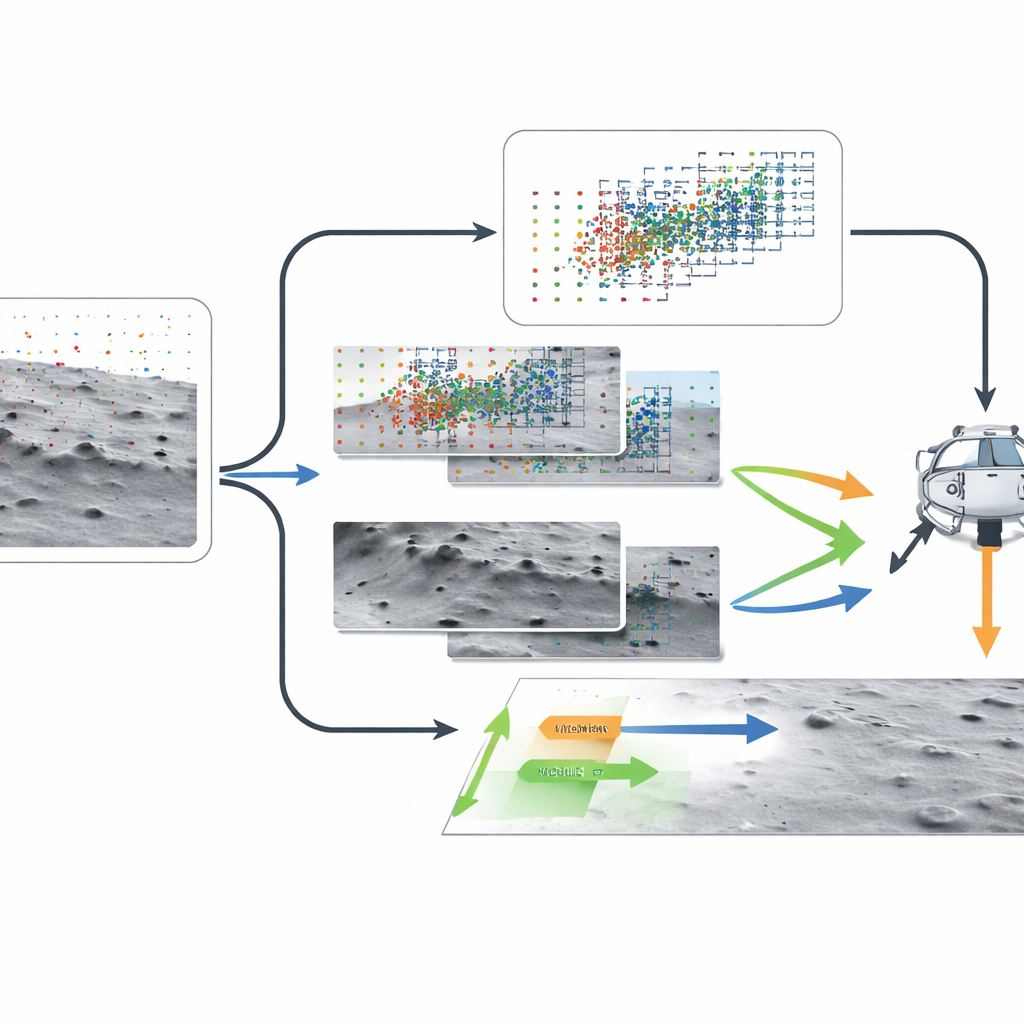

Comme des données réelles issues de caméras à événements sur la Lune n’existent pas encore, les chercheurs ont créé le jeu de données et le défi ELOPE. À l’aide d’un logiciel spécialisé, ils ont d’abord simulé des trajectoires d’atterrissage économes en carburant pour un vaisseau similaire au module Apollo, incluant des descentes ordinaires et des manœuvres plus complexes de « déviation » où le site d’atterrissage change tard dans l’approche. Un outil de rendu planétaire a ensuite généré des vues détaillées et photoréalistes de la surface le long de ces trajectoires sous divers éclairages, et un simulateur de caméra à événements a converti les séquences d’images en flux d’événements. Chaque séquence était accompagnée de « clés de réponse » parfaites pour le mouvement réel du module, ainsi que de lectures virtuelles d’un capteur inertiel et d’un télémètre laser, permettant aux concurrents de tester la précision de leurs méthodes pour reconstruire la vitesse et la direction du module.

Un concours mondial d’idées pour la navigation intelligente

La compétition ELOPE a attiré 44 équipes issues d’universités, de l’industrie et de chercheurs indépendants, 21 d’entre elles atteignant le tableau final et soumettant 132 solutions. Toutes les équipes devaient estimer la vitesse tridimensionnelle du module au cours du temps à partir des mêmes données synthétiques de capteurs. Les organisateurs ont également fourni une méthode de référence solide basée sur des images, qui convertissait d’abord les événements en images puis appliquait des techniques classiques de flux optique, mettant au défi les concurrents de faire mieux en exploitant le plein potentiel de la détection basée sur des événements. Seules trois équipes ont battu cette référence, révélant à la fois les promesses et les limites actuelles de la technologie.

Trois voies gagnantes pour lire le mouvement

L’équipe gagnante, SOMIS-LAB, a misé pleinement sur une vision purement événementielle. Plutôt que d’agréger les événements en tranches temporelles fixes, leur méthode adaptait la fenêtre temporelle à la volée selon le nombre d’événements reçus, puis déformait les événements en fonction d’hypothèses de mouvement de test et évaluait la « netteté » du motif résultant dans le domaine fréquentiel. En recherchant le mouvement qui rendait les contours de la scène les plus nets, ils ont obtenu la meilleure précision — bien que cela exige un coût de calcul élevé qui serait actuellement trop lent pour un véritable atterrissage. Les équipes classées deuxième et troisième, HRI et LUNARIS, ont suivi une voie plus traditionnelle : elles ont regroupé les événements en images éphémères et utilisé des outils établis de vision par ordinateur. L’une a traité la surface lunaire comme presque plane et trouvé la meilleure transformation globale entre images successives ; l’autre a estimé le mouvement au niveau de chaque pixel, a retiré la composante due à la rotation du module en se servant des données du capteur inertiel, puis a combiné cela avec l’information de distance pour déduire la vitesse du module. Ces approches étaient suffisamment rapides pour une utilisation en temps réel et surpassaient néanmoins la référence.

Ce que nous apprenons des cas difficiles

En étudiant les situations où toutes les méthodes ont eu des difficultés, les auteurs ont constaté que les trajectoires les plus ardues étaient celles présentant de forts problèmes d’éclairage — images sources surexposées ou sous-exposées, produisant peu d’événements significatifs après conversion. Ils ont également observé que les manœuvres de déviation complexes, avec des virages et des changements d’attitude plus marqués, étaient généralement plus difficiles à reconstruire que des descentes simples. Fait intéressant, de nombreuses équipes ont expérimenté l’apprentissage profond mais sont souvent revenues à des méthodes classiques de vision pour leurs soumissions finales, citant des défis comme la rareté des événements, le peu de données d’entraînement et la nécessité d’une généralisation robuste. Une enquête post-compétition a aussi révélé que la plupart des participants convertissaient les événements en trames à timing fixe, soulignant combien la stratégie entièrement pilotée par les événements de l’équipe gagnante reste rare.

Ce que cela signifie pour les futures missions lunaires

L’étude conclut que les caméras basées sur des événements sont de sérieuses candidates pour les systèmes d’atterrissage lunaires futurs, en particulier dans les régions polaires exigeantes. Même avec un jeu de données synthétique et le handicap supplémentaire de détails de calibration manquants, plusieurs équipes ont égalé ou battu une méthode de référence soignée fondée sur des images. La solution la plus précise a montré qu’embrasser pleinement le flux d’événements peut produire d’excellentes estimations de mouvement, tandis que des hybrides rapides basés sur des images démontrent que des systèmes pratiques et temps réel sont déjà à portée. Ensemble, ces résultats constituent une étape importante vers des modules capables de « voir » les mouvements rapides et les conditions d’éclairage difficiles plus comme un œil vivant, améliorant les chances d’atterrissages sûrs et précis sur la Lune et au-delà.

Citation: Fanti, P., Williams, L.B.S., Dvořák, O. et al. Event-based lunar optical flow egomotion estimation challenge: design and results of the ELOPE competition. npj Space Explor. 2, 18 (2026). https://doi.org/10.1038/s44453-026-00033-0

Mots-clés: vision basée sur des événements, atterrissage lunaire, estimation d’egomotion, capteurs neuromorphiques, navigation autonome