Clear Sky Science · pl

Wyzwanie w estymacji egoruchu z optycznego przepływu z kamer zdarzeniowych: projekt i wyniki konkursu ELOPE

Dlaczego mądrzejsze „oczy” mają znaczenie przy lądowaniach na Księżycu

W miarę jak agencje kosmiczne przygotowują się do wysyłania robotów, a później ludzi z powrotem na Księżyc, bezpieczne lądowanie w nierównym, cienistym terenie — szczególnie w rejonach polarnych, gdzie lód może być ukryty w stałej ciemności — staje się poważnym wyzwaniem. W artykule tym badane jest nowe podejście do „inteligentnego oka” statków kosmicznych, zwane kamerą zdarzeniową, oraz opisany jest międzynarodowy konkurs sprawdzający, na ile różne zespoły potrafiły wykorzystać taką kamerę do prowadzenia lądownika ku bezpiecznemu lądowaniu.

Nowy sposób widzenia ruchu w ciemności

W odróżnieniu od zwykłych kamer, które wykonują pełne zdjęcia w stałych odstępach, kamery zdarzeniowe reagują tylko wtedy, gdy jasność w pojedynczym pikselu ulega zmianie. Każda zmiana wyzwala precyzyjnie oznaczony czasowo „zdarzenie”, tworząc strumień rzadkich, szybkich aktualizacji zamiast obszernych obrazów. Ten projekt naśladuje sposób działania oczu biologicznych i przynosi kluczowe korzyści dla lotów kosmicznych: niezwykle szybką reakcję, bardzo szeroki zakres jasności i niskie zużycie energii. Zalety te są szczególnie przydatne w pobliżu bieguna południowego Księżyca, gdzie Słońce przesuwa się tuż nad horyzontem, kratery leżą w głębokim cieniu, a jasny, refleksyjny pył może łatwo zdominować tradycyjne czujniki.

Budowanie realistycznego cyfrowego placu zabaw na Księżycu

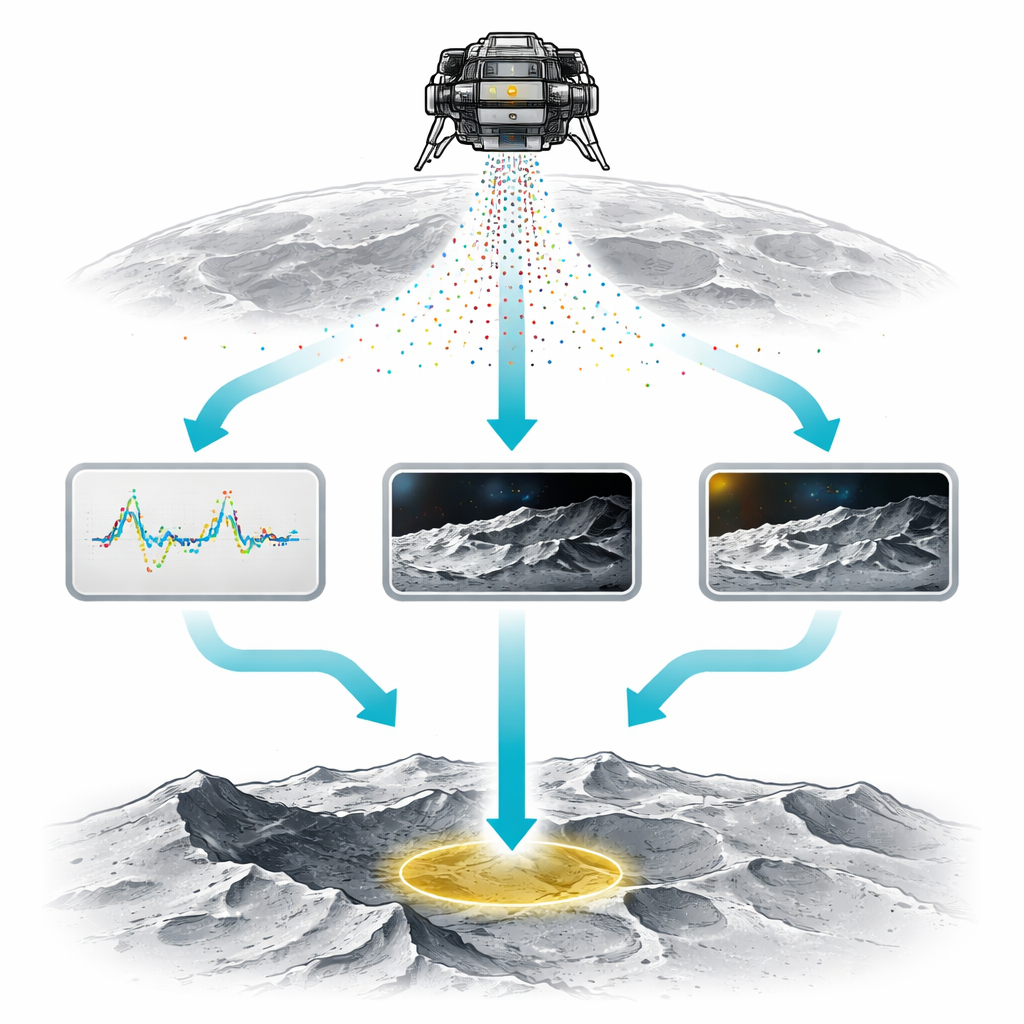

Ponieważ prawdziwe dane zdarzeniowe z Księżyca jeszcze nie istnieją, badacze stworzyli zbiór danych i wyzwanie ELOPE. Przy użyciu wyspecjalizowanego oprogramowania najpierw zasymulowali oszczędne paliwowo ścieżki lądowania dla statku podobnego do lądownika Apollo, obejmujące zarówno zwykłe zejścia, jak i bardziej złożone manewry „przekierowania”, gdy miejsce lądowania zmienia się późno podczas podejścia. Narzędzie do renderowania planetarnego wygenerowało następnie szczegółowe, fotorealistyczne widoki powierzchni wzdłuż tych trajektorii w różnych warunkach oświetlenia, a symulator kamery zdarzeniowej przekształcił sekwencje obrazów w strumienie zdarzeń. Każda sekwencja zawierała idealne „klucze odpowiedzi” dotyczące rzeczywistego ruchu lądownika, wraz z wirtualnymi odczytami z czujnika ruchu i dalmierza laserowego, co pozwoliło uczestnikom przetestować, jak dokładnie ich metody potrafią odtworzyć prędkość i kierunek lądownika.

Globalny konkurs pomysłów na inteligentną nawigację

Konkurs ELOPE przyciągnął 44 zespoły z uniwersytetów, przemysłu i środowiska badaczy niezależnych; 21 z nich dotarło do ostatecznej listy wyników i zgłosiło 132 rozwiązania. Wszystkie zespoły musiały oszacować trójwymiarową prędkość lądownika w czasie, korzystając z tych samych syntetycznych danych z czujników. Organizatorzy dostarczyli też silną metodę odniesienia opartą na klatkach, która najpierw konwertowała zdarzenia na obrazy, a następnie stosowała standardowe techniki optycznego przepływu, zachęcając konkurentów do osiągnięcia lepszych wyników przez wykorzystanie pełnego potencjału pomiarów zdarzeniowych. Tylko trzy zespoły pokonały tę bazę, co ukazało zarówno obietnicę, jak i obecne ograniczenia tej technologii.

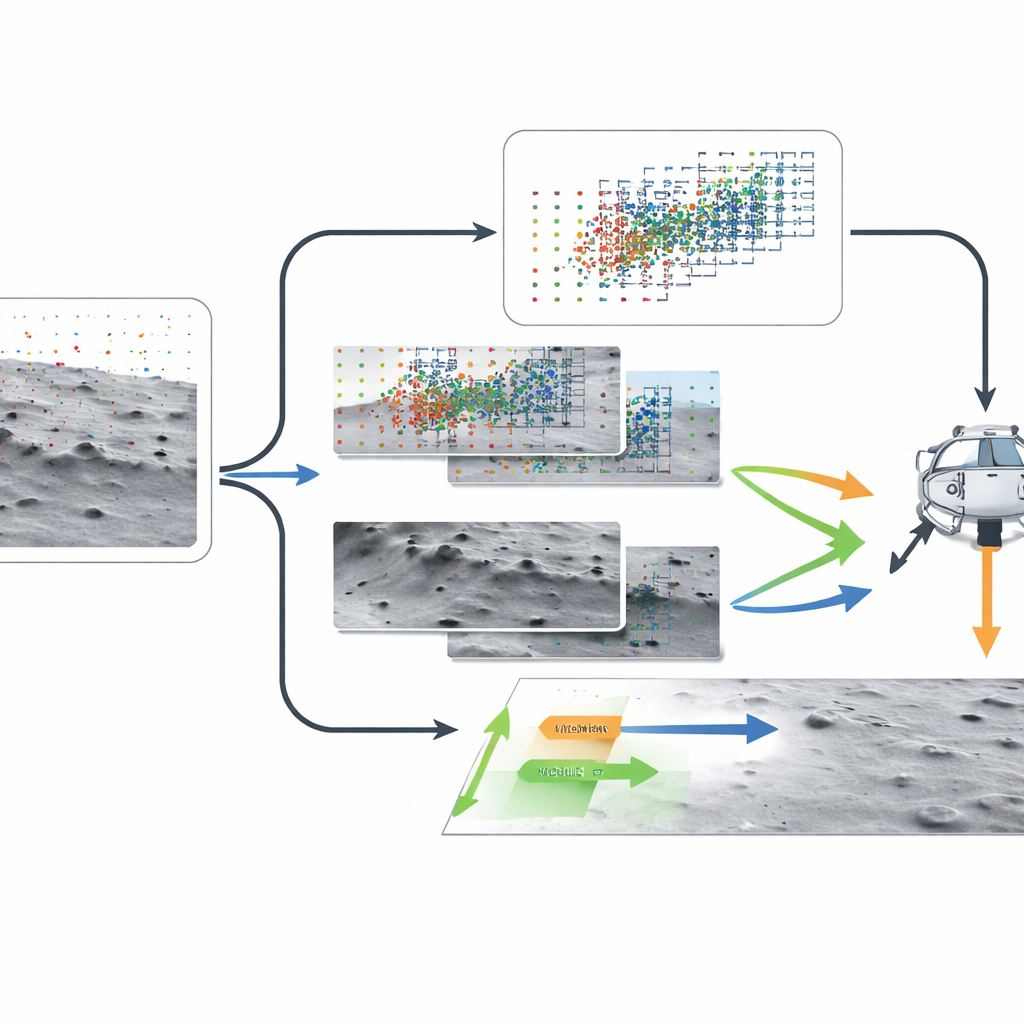

Trzy zwycięskie drogi odczytu ruchu

Zespół zwycięski, SOMIS-LAB, w pełni opierał się na zdarzeniowym obrazie świata. Zamiast grupować zdarzenia w stałe przedziały czasowe, ich metoda dynamicznie dostosowywała okno czasowe w zależności od liczby napływających zdarzeń, następnie deformowała zdarzenia zgodnie z próbnymi przypuszczeniami ruchu i oceniała, jak „ostry” wyglądał powstały wzór w dziedzinie częstotliwości. Szukając ruchu, który sprawiał, że krawędzie sceny były jak najbardziej wyraźne, osiągnęli najlepszą dokładność — choć przy dużych kosztach obliczeniowych, które aktualnie byłyby zbyt wolne dla rzeczywistego lądowania. Zespoły na drugim i trzecim miejscu, HRI i LUNARIS, obrały bardziej tradycyjną ścieżkę: grupowały zdarzenia w krótkotrwałe obrazy i używały ustalonych narzędzi widzenia komputerowego. Jeden zespół traktował powierzchnię księżycową jako niemal płaską i znajdował najlepszą ogólną transformację między kolejnymi obrazami; drugi oszacował szczegółowy ruch na poziomie piksela, odjął składową spowodowaną obrotem lądownika wykorzystując dane z czujnika ruchu i połączył to z informacją o odległości, aby wnioskować o prędkości lądownika. Podejścia te były wystarczająco szybkie do zastosowań w czasie rzeczywistym i wciąż przewyższały metodę referencyjną.

Czego uczymy się z trudnych przypadków

Badając miejsca, w których wszystkie metody miały problemy, autorzy stwierdzili, że najtrudniejsze trajektorie to te z poważnymi problemami oświetleniowymi — prześwietlone lub niedoświetlone obrazy źródłowe, które po konwersji generowały niewiele użytecznych zdarzeń. Zauważyli też, że złożone manewry przekierowania, z ostrzejszymi zakrętami i zmianami postawy, były generalnie trudniejsze do odtworzenia niż proste zejścia. Co ciekawe, wiele zespołów eksperymentowało z głębokim uczeniem, ale często w ostatecznych zgłoszeniach wracało do klasycznych metod widzenia, wskazując na problemy takie jak rzadkie zdarzenia, ograniczone dane treningowe i potrzeba odpornej generalizacji. Ankieta przeprowadzona po konkursie ujawniła również, że większość uczestników konwertowała zdarzenia na klatki o stałym czasie, podkreślając, jak rzadko wciąż stosowana jest w pełni zdarzeniowa strategia zwycięskiego zespołu.

Co to oznacza dla przyszłych misji księżycowych

Badanie konkluduje, że kamery zdarzeniowe są poważnymi kandydatami do przyszłych systemów lądowania na Księżycu, szczególnie w wymagających regionach polarnych. Nawet korzystając z syntetycznego zbioru danych i z dodatkowym utrudnieniem braku szczegółów kalibracji kamery, kilka zespołów wyrównało lub pokonało starannie opracowaną metodę odniesienia opartą na klatkach. Najdokładniejsze rozwiązanie pokazało, że pełne wykorzystanie strumienia zdarzeń może dać znakomite oszacowania ruchu, podczas gdy szybkie hybrydy oparte na klatkach wykazały, że praktyczne systemy działające w czasie rzeczywistym są już w zasięgu. Razem wyniki te stanowią ważny krok ku lądownikom, które mogą „widzieć” szybki ruch i ostre oświetlenie bardziej jak żywe oko, zwiększając szanse na bezpieczne, precyzyjne lądowania na Księżycu i dalej.

Cytowanie: Fanti, P., Williams, L.B.S., Dvořák, O. et al. Event-based lunar optical flow egomotion estimation challenge: design and results of the ELOPE competition. npj Space Explor. 2, 18 (2026). https://doi.org/10.1038/s44453-026-00033-0

Słowa kluczowe: wizyjność zdarzeniowa, lądowanie na Księżycu, estymacja egoruchu, czujniki neuromorficzne, nawigacja autonomiczna