Clear Sky Science · sv

Ett lättviktsnätverk för funktionsfusion för svag- och småmålsdetektion i fjärranalys

Varför det spelar roll att hitta pyttesmå objekt från luften

Från övervakning av trafik och fartyg till att vägleda insatser vid katastrofer skannar dagens satelliter och drönare ständigt jordytan. Många av de objekt vi bryr oss mest om—små fordon, båtar eller delar av infrastruktur—visas dock i bilder som bara några pixlar breda och riskerar att gå förlorade i röriga stadskvarter, skogar eller vid strandlinjer. I den här artikeln presenteras GSS‑YOLO, ett nytt, lättviktigt datorvisionssystem utformat för att pålitligt upptäcka dessa svaga, pyttesmå mål i fjärranalybilder, även när bilderna är suddiga, mörka eller fulla av distraherande bakgrundsdetaljer.

Utmaningen att hitta nålar i en höstack

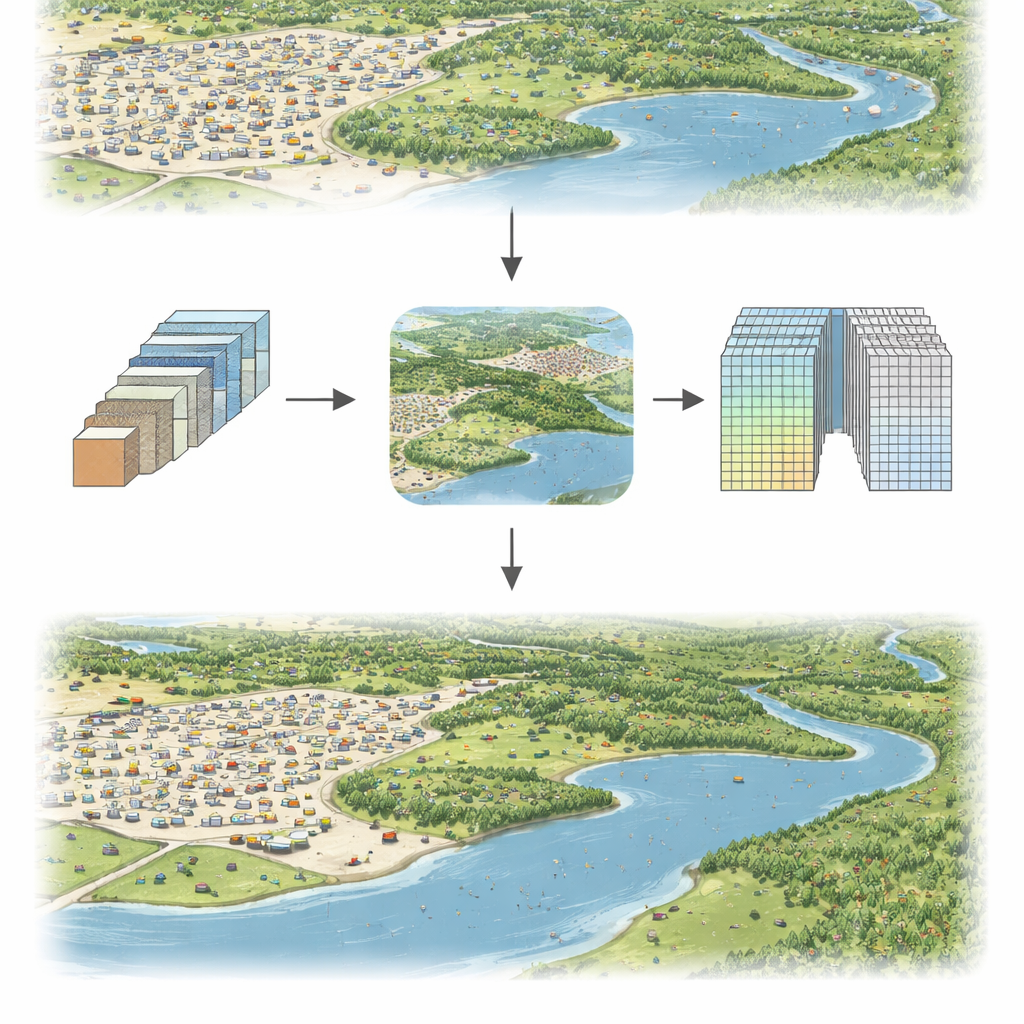

Kameror för fjärranalys som sitter på flygplan och satelliter fångar stora områden på en gång. Denna breda vy är användbar, men krymper varje objekt: små mål täcker ibland bara 10×10 pixlar eller mindre. Samtidigt är bakgrunderna komplexa—moln, tak, träd, floder, skuggor och säsongsmässiga förändringar i ljus eller väder ökar brusnivån. Traditionella detektionssystem missar antingen dessa små objekt eller kräver tunga, långsamma modeller som är svåra att köra i realtid på drönare eller kant-enheter. Författarna ville bygga en modell som både är noggrann för små objekt och effektiv nog att köras snabbt på begränsad hårdvara.

Ett kompakt system inriktat på små detaljer

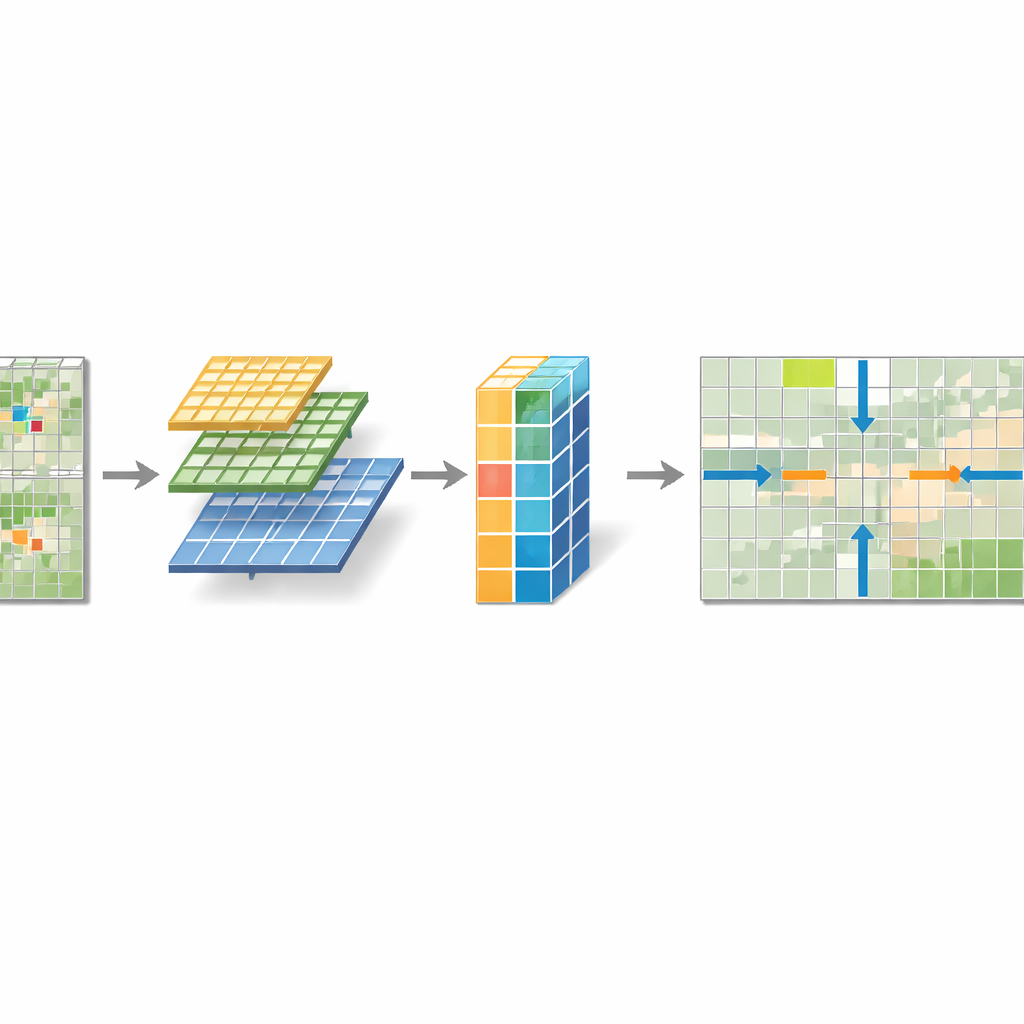

Forskarna utgår från en populär realtidsdetektor kallad YOLOv5 och omformar nyckelkomponenter för att skapa GSS‑YOLO. De introducerar tre huvudbyggstenar som fungerar tillsammans. För det första blandar en Shallow‑Deep Information Aggregation (SIA)-modul information från små och något större omgivningar i bilden, vilket hjälper nätverket att förena fina konturer med bredare kontext utan att göra modellen otymplig. För det andra ändrar en SPD‑Conv-block hur systemet minskar bildstorleken: i stället för att helt enkelt kasta bort pixlar vid nedsampling omarrangeras de så att fina detaljer bevaras i extra kanaler före en mild kompression. För det tredje sitter en Global Context‑Aware Module (GCAM) precis innan den slutliga detektorn och betraktar hela bilden för att framhäva positioner som sannolikt innehåller små mål samtidigt som bakgrundsbrus tonas ned.

Hur de nya modulerna samverkar

SIA angriper en grundläggande svaghet i många visionsnätverk: vanliga konvolutioner ser bara lokala fläckar och har svårt med global kontext. Genom att köra parallella filter som tittar i något olika skalor och sedan föra resultatet genom lätta lager som blandar och reglerar egenskaper, skapar SIA rikare beskrivningar av små objekt utan att lägga till många parametrar. SPD‑Conv hanterar ett annat problem—informationsförlust vid aggressiv nedsampling. Den delar upp funktionskartan i växelvis ordnade delnät och staplar dem djup‑vis, så att ingen pixel kastas bort; ett enkelt 1×1‑filter komprimerar sedan denna rikare representation. GCAM lägger till en global ”strålkastare”-effekt. Den poolar information separat längs horisontella och vertikala riktningar för att hålla reda på rader och kolumner där små objekt uppträder, och kombinerar detta med en strömlinjeformad uppmärksamhetsmekanism över kanaler. Resultatet är en flerdimensionell mask som förstärker signaler vid sannolika målplatser och undertrycker förvirrande texturer på andra ställen.

Sätta modellen på prov

För att avgöra om dessa idéer ger verkliga förbättringar utvärderade teamet GSS‑YOLO på tre krävande datasätt. USOD innehåller svaga, ultrasmå gråskaliga mål i svagt ljus; VisDrone2019 erbjuder tätbefolkade stadsscener fotograferade från drönare, fulla av pyttesmå fotgängare och fordon; och DIOR är en varierad satellitsamling med flygplan, broar, fartyg, idrottsytor med mera. I samtliga tre uppnådde GSS‑YOLO konsekvent högre precision, återkallning och genomsnittlig detektionskvalitet än en uppsättning moderna konkurrenter, inklusive nyare YOLO‑versioner och flera specialiserade småobjektsmodeller. På USOD‑datasetet levererade den till exempel inte bara bäst noggrannhet utan gjorde det också med färst parametrar—ungefär 5 miljoner—och högsta bearbetningshastighet, i storleksordningen hundratals bildrutor per sekund. Visuella exempel visar att den undviker både missade detektioner och falsklarm i trånga, röriga scener där andra system har svårt.

Vad detta innebär för vardagliga tillämpningar

För icke‑experter är huvudbudskapet att GSS‑YOLO gör det mer möjligt att köra skarpa detektioner av små, svårupptäckta mål direkt på drönare, satelliter eller andra kompakta enheter utan att förlita sig på enorma datacenter. Genom att bättre bevara fina bilddetaljer och använda global kontext för att styra uppmärksamheten förvandlar modellen svaga prickar till säkert igenkända objekt. Även om den fortfarande kan misslyckas under extrema förhållanden—till exempel när större delen av ett mål är dold eller rörelseoskärpa är kraftig—markerar arbetet ett praktiskt steg mot realtidsövervakning över stora områden för trafikhantering, miljöövervakning, säkerhet och räddningsinsatser, där förmågan att snabbt se små detaljer kan göra stor skillnad.

Citering: Wu, Z., Li, N., Tian, Z. et al. A lightweight feature fusion network for weak and small target detection in remote sensing. Sci Rep 16, 13295 (2026). https://doi.org/10.1038/s41598-026-43560-2

Nyckelord: fjärranalys, detektion av små objekt, lättviktsneuralt nätverk, dronbilder, jordobservation