Clear Sky Science · it

Una rete leggera per la fusione di feature per il rilevamento di bersagli deboli e piccoli in telerilevamento

Perché trovare oggetti minuscoli dal cielo è importante

Dalla sorveglianza del traffico e delle navi all’orientamento nelle operazioni di soccorso, satelliti e droni scandagliano continuamente la superficie terrestre. Tuttavia molte delle cose che ci interessano di più—piccoli veicoli, imbarcazioni o elementi di infrastrutture—appaiono nelle immagini come pochi pixel, facilmente perdibili in isolati affollati, boschi o litorali. Questo articolo presenta GSS‑YOLO, un nuovo sistema di visione artificiale leggero progettato per individuare con affidabilità questi bersagli deboli e minuscoli nelle immagini da telerilevamento, anche quando le foto sono sfocate, poco illuminate o piene di dettagli di sfondo distraenti.

La sfida di trovare aghi in un pagliaio

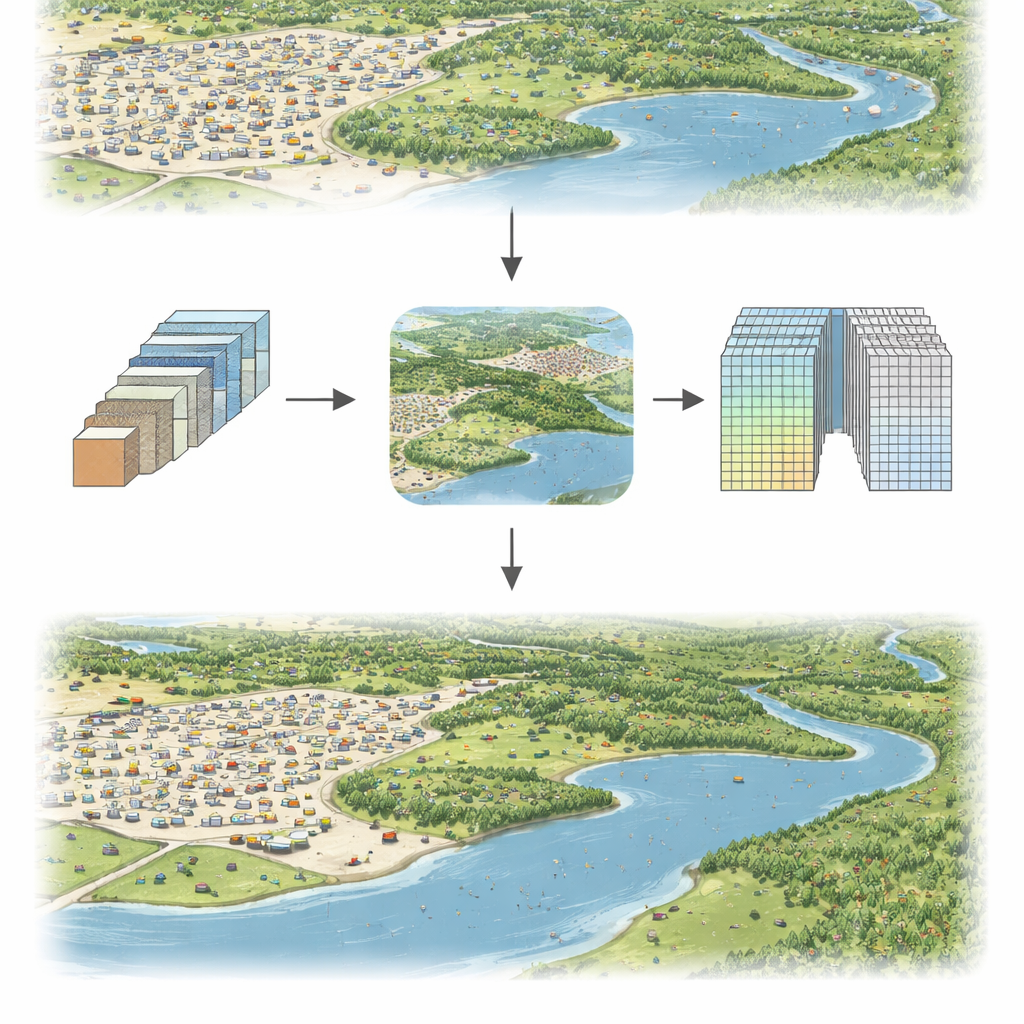

Le camere di telerilevamento montate su aerei e satelliti acquisiscono ampie porzioni di territorio in una sola inquadratura. Questa visuale ampia è utile, ma riduce la dimensione apparente degli oggetti: i bersagli piccoli possono occupare solo 10×10 pixel o meno. Contemporaneamente gli sfondi sono complessi—nubi, tetti, alberi, fiumi, ombre e variazioni stagionali di illuminazione o meteo aggiungono rumore. I sistemi di rilevamento tradizionali o non riescono a individuare questi oggetti minuscoli oppure richiedono modelli pesanti e lenti, difficili da eseguire in tempo reale su droni o dispositivi edge. Gli autori si sono posti l’obiettivo di costruire un modello che sia allo stesso tempo accurato sui piccoli oggetti ed efficiente quanto basta per girare rapidamente su hardware limitato.

Un sistema compatto tarato sui dettagli minuti

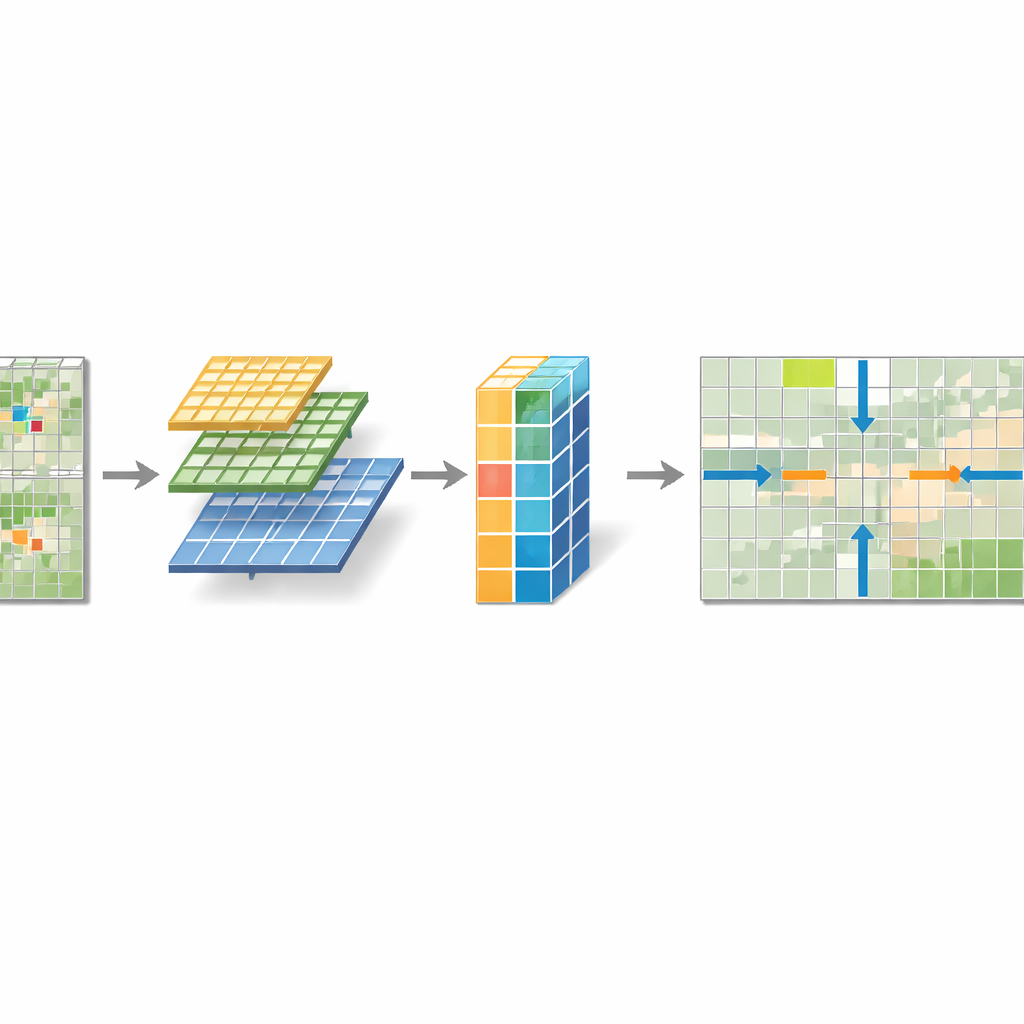

I ricercatori partono da un noto rilevatore in tempo reale chiamato YOLOv5 e ridisegnano componenti chiave per creare GSS‑YOLO. Introducono tre blocchi principali che lavorano insieme. Primo, un modulo Shallow‑Deep Information Aggregation (SIA) fonde informazioni provenienti da vicinanze piccole e leggermente più ampie nell’immagine, aiutando la rete a combinare contorni fini con un contesto più ampio senza gonfiare il modello. Secondo, un blocco SPD‑Conv cambia il modo in cui il sistema riduce la dimensione dell’immagine: invece di scartare pixel durante il downsampling, li riorganizza in modo che i dettagli fini siano preservati in canali aggiuntivi prima di una compressione leggera. Terzo, un Global Context‑Aware Module (GCAM) si colloca subito prima del rilevatore finale e analizza l’intera immagine per enfatizzare le posizioni probabilmente contenenti piccoli bersagli, attenuando nel contempo il rumore di sfondo.

Come i nuovi moduli lavorano insieme

SIA affronta una debolezza centrale di molte reti di visione: le convoluzioni ordinarie vedono solo patch locali e faticano a cogliere il contesto globale. Eseguendo filtri in parallelo che osservano scale leggermente diverse, quindi passando il risultato attraverso strati leggeri che mescolano e regolarizzano le feature, SIA produce descrittori più ricchi dei piccoli oggetti senza aggiungere molti parametri. SPD‑Conv risolve un problema diverso—la perdita di informazione dovuta a un downsampling aggressivo. Divide la mappa di feature in sotto‑griglie intrecciate e le impila in profondità, in modo che nessun pixel venga scartato; un semplice filtro 1×1 compatta poi questa rappresentazione più ricca. GCAM aggiunge un effetto “faro” globale. Aggrega informazioni separatamente lungo le direzioni orizzontale e verticale per tracciare righe e colonne dove compaiono piccoli oggetti, e combina questo con un meccanismo di attenzione snello sulle dimensioni dei canali. Il risultato è una maschera multidimensionale che rinforza i segnali nelle posizioni probabilmente rilevanti e sopprime texture fuorvianti altrove.

Mettere il modello alla prova

Per verificare se queste idee si traducono in vantaggi nel mondo reale, il team ha valutato GSS‑YOLO su tre dataset impegnativi. USOD contiene bersagli in scala di grigi ultra‑minoritari in scene con scarsa illuminazione; VisDrone2019 offre scene urbane affollate riprese da droni, piene di pedoni e veicoli minuscoli; DIOR è una collezione satellitare eterogenea con aerei, ponti, navi, campi sportivi e altro. Su tutti e tre i dataset, GSS‑YOLO ha ottenuto costantemente precisione, richiamo e qualità media di rilevamento superiori rispetto a una serie di concorrenti moderni, incluse versioni recenti di YOLO e diversi modelli specializzati per piccoli oggetti. Sul dataset USOD, per esempio, non solo ha fornito la migliore accuratezza ma lo ha fatto con il numero minore di parametri—circa 5 milioni—e la massima velocità di elaborazione, raggiungendo centinaia di frame al secondo. Esempi visivi mostrano come eviti sia omissioni sia falsi allarmi in scene affollate e confuse dove altri sistemi faticano.

Cosa significa per le applicazioni quotidiane

Per i non esperti, il messaggio chiave è che GSS‑YOLO rende più fattibile eseguire rilevamenti ad occhio fine per bersagli piccoli e difficili da vedere direttamente su droni, satelliti o altri dispositivi compatti, senza dipendere da enormi data center. Preservando meglio i dettagli fini dell’immagine e usando il contesto globale per guidare l’attenzione, il modello trasforma puntini sfocati in oggetti riconosciuti con fiducia. Pur potendo ancora fallire in condizioni estreme—ad esempio quando la maggior parte del bersaglio è nascosta o la sfocatura da movimento è severa—il lavoro rappresenta un passo pratico verso il monitoraggio in tempo reale su larga area per la gestione del traffico, l’osservazione ambientale, la sicurezza e le operazioni di emergenza, dove vedere piccoli dettagli rapidamente può fare una grande differenza.

Citazione: Wu, Z., Li, N., Tian, Z. et al. A lightweight feature fusion network for weak and small target detection in remote sensing. Sci Rep 16, 13295 (2026). https://doi.org/10.1038/s41598-026-43560-2

Parole chiave: telerilevamento, rilevamento di piccoli oggetti, rete neurale leggera, immagini da drone, osservazione della Terra