Clear Sky Science · fr

Un réseau léger de fusion de caractéristiques pour la détection de cibles faibles et petites en télédétection

Pourquoi repérer de tout petits objets depuis le ciel est important

Qu’il s’agisse de suivre le trafic et les navires ou de guider les interventions en cas de catastrophe, les satellites et les drones d’aujourd’hui scrutent en permanence la surface de la Terre. Pourtant, bon nombre des éléments qui nous intéressent le plus — petits véhicules, embarcations ou pièces d’infrastructure — n’occupent dans les images que quelques pixels, et se perdent facilement dans des quartiers urbains encombrés, des forêts ou des littoraux. Cet article présente GSS‑YOLO, un nouveau système de vision par ordinateur léger conçu pour détecter de manière fiable ces cibles faibles et minuscules dans des images de télédétection, même lorsque les clichés sont flous, sombres ou chargés d’arrière‑plan perturbant.

Le défi de trouver une aiguille dans une meule de foin

Les caméras de télédétection embarquées sur aéronefs et satellites couvrent de vastes zones en une seule prise. Cette large couverture est utile, mais réduit la taille apparente des objets : les petites cibles peuvent ne représenter que 10×10 pixels ou moins. Parallèlement, les arrière‑plans sont complexes — nuages, toitures, arbres, cours d’eau, ombres et variations saisonnières d’éclairage ou de météo ajoutent du bruit. Les systèmes de détection traditionnels manquent souvent ces minuscules objets ou exigent des modèles lourds et lents, difficiles à exécuter en temps réel sur des drones ou des dispositifs en périphérie. Les auteurs se sont donné pour objectif de concevoir un modèle à la fois performant pour les petits objets et suffisamment efficace pour fonctionner rapidement sur du matériel limité.

Un système compact optimisé pour les petits détails

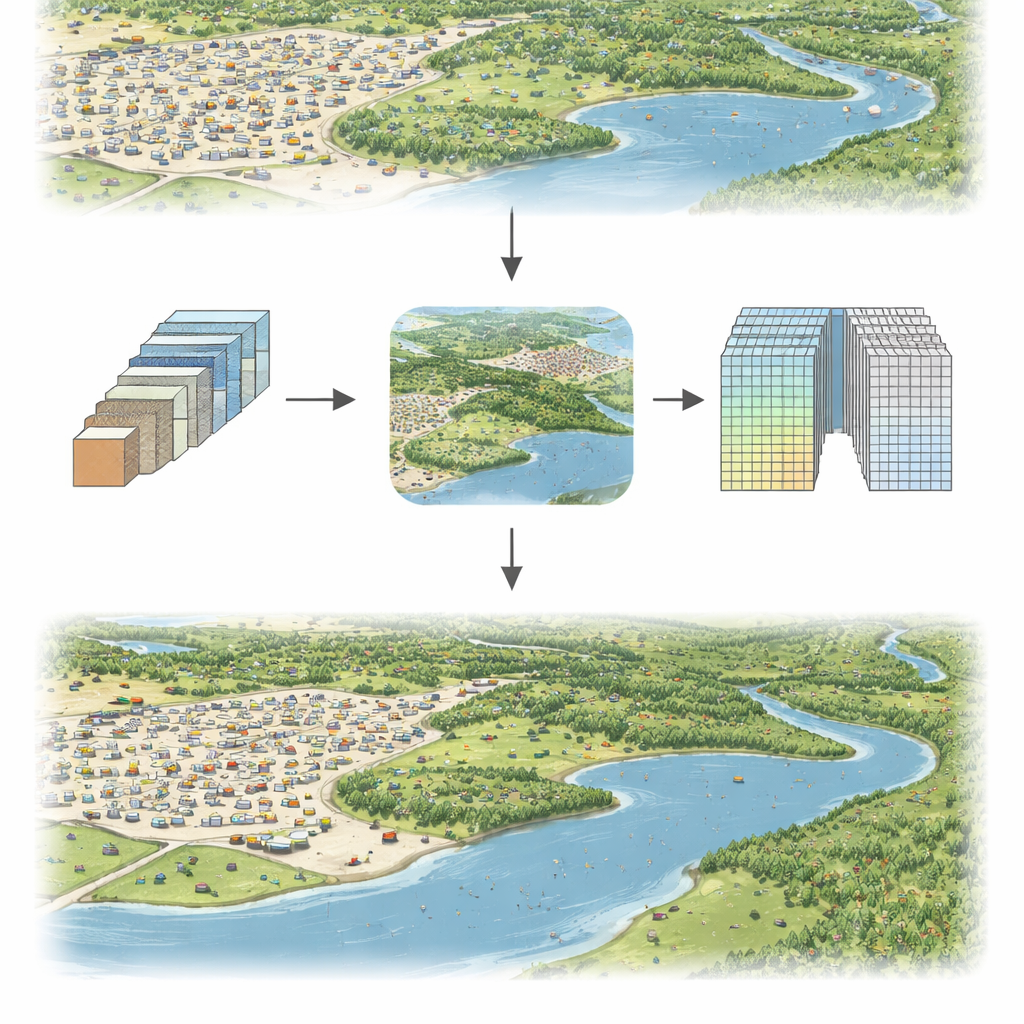

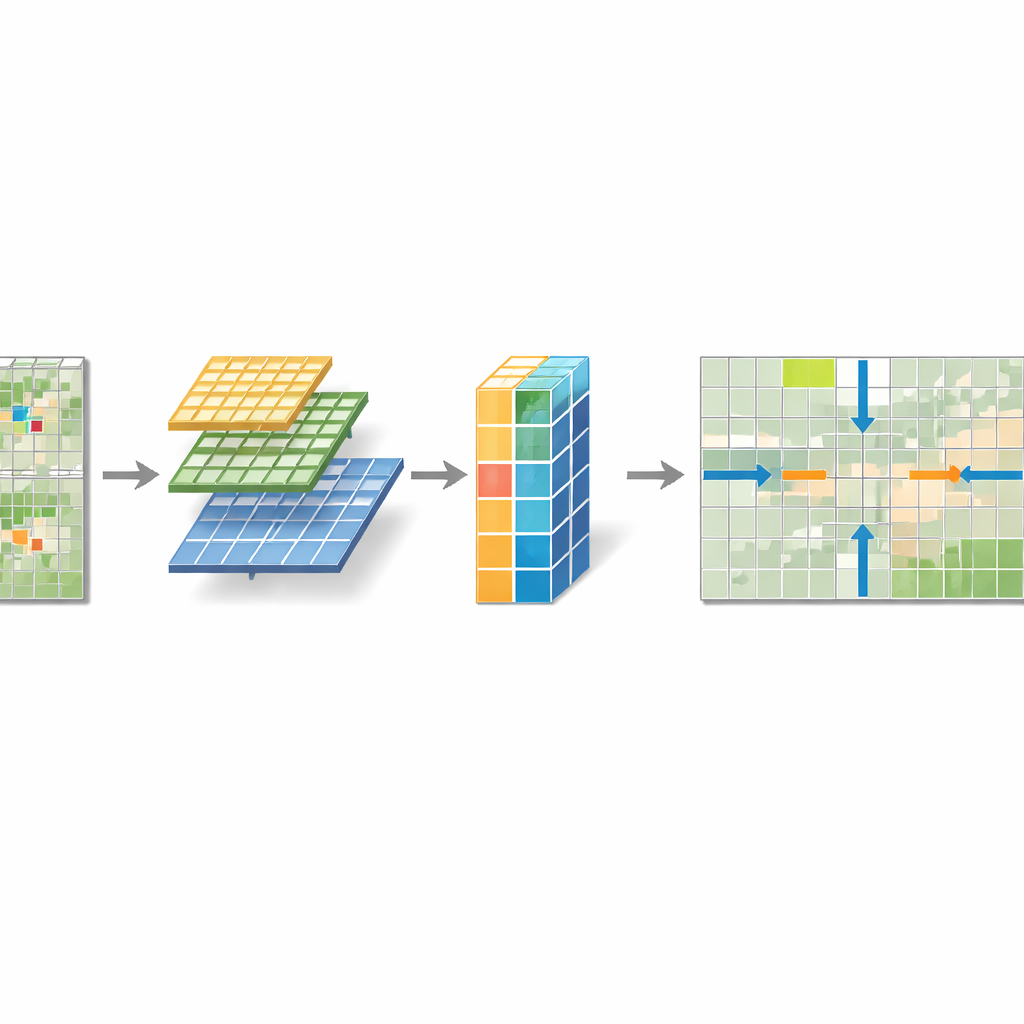

Les chercheurs partent d’un détecteur temps réel populaire, YOLOv5, et repensent des composants clés pour créer GSS‑YOLO. Ils introduisent trois blocs principaux qui fonctionnent de concert. D’abord, un module d’Agrégation d’Information Peu Profonde‑Profonde (SIA) mélange l’information provenant de voisinages petits et légèrement plus larges dans l’image, aidant le réseau à combiner bords fins et contexte plus large sans alourdir le modèle. Ensuite, un bloc SPD‑Conv modifie la manière dont le système réduit la taille des images : au lieu de simplement jeter des pixels lors du sous‑échantillonnage, il les réarrange de sorte que les détails fins soient préservés dans des canaux supplémentaires avant une compression douce. Enfin, un Module Global Sensible au Contexte (GCAM) se situe juste avant le détecteur final et examine l’ensemble de l’image pour mettre en lumière les positions susceptibles de contenir de petites cibles tout en atténuant le désordre d’arrière‑plan.

Comment les nouveaux modules coopèrent

SIA s’attaque à une faiblesse centrale de nombreux réseaux de vision : les convolutions ordinaires ne voient que des patchs locaux et peinent à capter le contexte global. En exécutant des filtres parallèles qui observent des échelles légèrement différentes, puis en passant le résultat par des couches légères qui mixent et régularisent les caractéristiques, SIA produit des descripteurs plus riches pour les petits objets sans ajouter beaucoup de paramètres. SPD‑Conv résout un autre problème — la perte d’information due à un sous‑échantillonnage agressif. Il découpe la carte de caractéristiques en sous‑grilles entrelacées et les empile en profondeur, de sorte qu’aucun pixel n’est jeté ; un filtre 1×1 simple compresse ensuite cette représentation enrichie. GCAM ajoute un effet de « projecteur » global. Il poole séparément selon les directions horizontale et verticale pour suivre les lignes et colonnes où apparaissent les minuscules objets, et combine cela avec un mécanisme d’attention allégé sur les canaux. Le résultat est un masque multidimensionnel qui renforce les signaux aux emplacements probables de cibles et supprime les textures trompeuses ailleurs.

Évaluer le modèle

Pour vérifier si ces idées se traduisent en gains réels, l’équipe a évalué GSS‑YOLO sur trois jeux de données exigeants. USOD contient des cibles ultra‑petites en niveaux de gris dans des scènes peu éclairées ; VisDrone2019 propose des scènes urbaines denses filmées depuis des drones, remplies de piétons et de véhicules minuscules ; et DIOR est une collection satellitaire diverse comprenant avions, ponts, navires, terrains de sport, et plus encore. Sur les trois, GSS‑YOLO a systématiquement obtenu une meilleure précision, rappel et qualité moyenne de détection que plusieurs concurrents modernes, y compris des versions récentes de YOLO et plusieurs modèles spécialisés pour les petits objets. Sur le jeu de données USOD, par exemple, il a non seulement fourni la meilleure exactitude mais l’a fait avec le moins de paramètres — environ 5 millions — et la plus grande vitesse de traitement, atteignant des centaines d’images par seconde. Des exemples visuels montrent qu’il évite à la fois les détections manquées et les fausses alertes dans des scènes encombrées où d’autres systèmes peinent.

Ce que cela signifie pour les applications courantes

Pour les non‑spécialistes, le message clé est que GSS‑YOLO rend plus faisable l’exécution d’une détection précise de petites cibles directement sur des drones, satellites ou autres appareils compacts, sans dépendre de centres de données massifs. En préservant mieux les détails fins des images et en utilisant le contexte global pour orienter l’attention, le modèle transforme de faibles taches en objets reconnus avec confiance. S’il peut encore échouer dans des conditions extrêmes — par exemple lorsque la majeure partie d’une cible est cachée ou que le flou de mouvement est important — ce travail représente une avancée pratique vers une surveillance en temps réel et à grande échelle pour la gestion du trafic, l’observation environnementale, la sécurité et les interventions d’urgence, où voir vite de petits détails peut faire une grande différence.

Citation: Wu, Z., Li, N., Tian, Z. et al. A lightweight feature fusion network for weak and small target detection in remote sensing. Sci Rep 16, 13295 (2026). https://doi.org/10.1038/s41598-026-43560-2

Mots-clés: télédétection, détection de petits objets, réseau neuronal léger, images par drone, observation de la Terre