Clear Sky Science · es

Una red ligera de fusión de características para la detección de objetivos débiles y pequeños en teledetección

Por qué importa encontrar objetos diminutos desde el cielo

Desde el seguimiento del tráfico y los barcos hasta la orientación de la respuesta ante desastres, los satélites y drones actuales escanean constantemente la superficie terrestre. Sin embargo, muchas de las cosas que más nos interesan—pequeños vehículos, embarcaciones o elementos de infraestructura—aparecen en las imágenes con solo unos pocos píxeles, fácilmente perdidos en bloques urbanos, bosques o costas llenas de detalles. Este artículo presenta GSS‑YOLO, un nuevo sistema de visión por ordenador ligero diseñado para detectar de forma fiable estos objetivos débiles y diminutos en imágenes de teledetección, incluso cuando las fotografías están borrosas, poco iluminadas o contienen fondos muy distractores.

El reto de encontrar agujas en un pajar

Las cámaras de teledetección montadas en aeronaves y satélites capturan áreas muy extensas a la vez. Esa vista amplia es útil, pero reduce el tamaño aparente de cada objeto: los objetivos pequeños pueden ocupar solo 10×10 píxeles o menos. Al mismo tiempo, los fondos son complejos—nubes, tejados, árboles, ríos, sombras y cambios estacionales en la iluminación o el tiempo añaden ruido. Los sistemas tradicionales de detección suelen perder estos objetos diminutos o requieren modelos pesados y lentos que son difíciles de ejecutar en tiempo real en drones o dispositivos en el borde. Los autores se propusieron construir un modelo que fuera tanto preciso para objetos pequeños como lo bastante eficiente para funcionar rápidamente en hardware limitado.

Un sistema compacto ajustado a los detalles pequeños

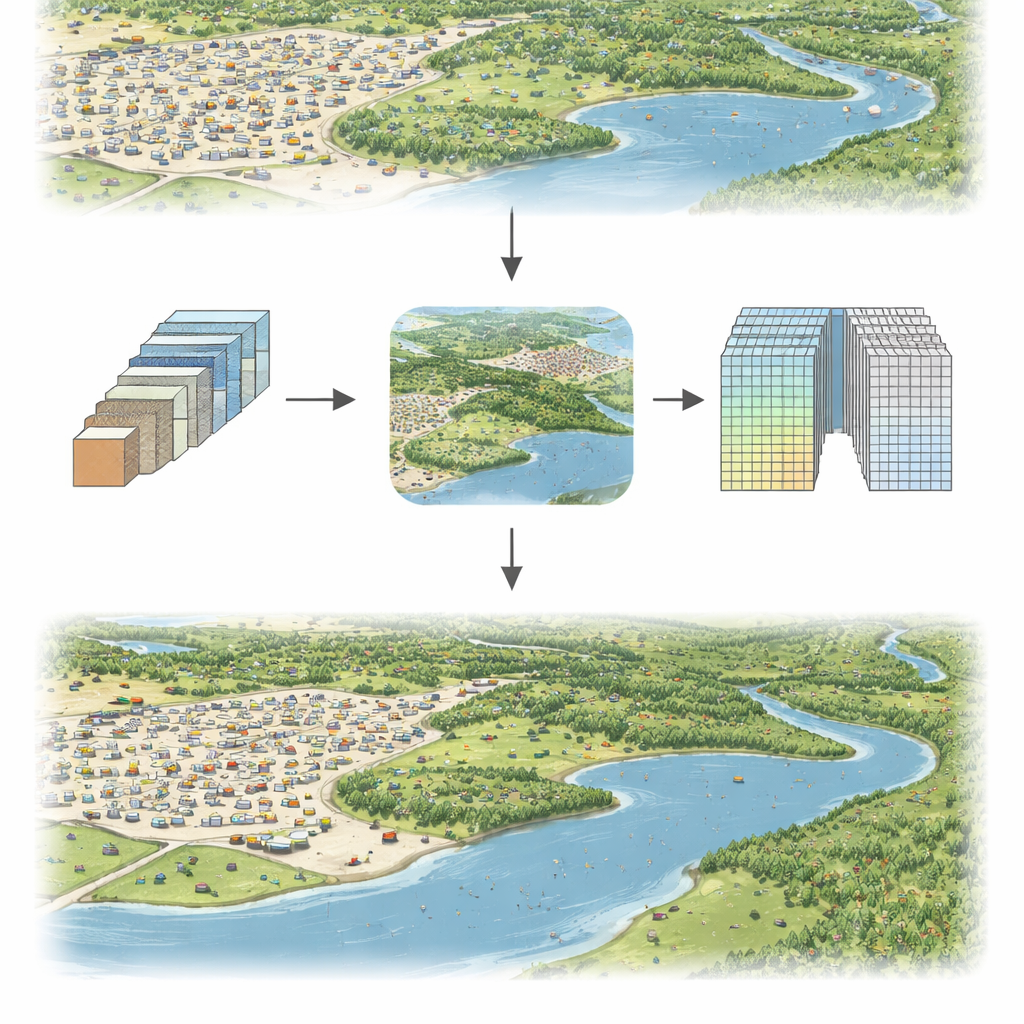

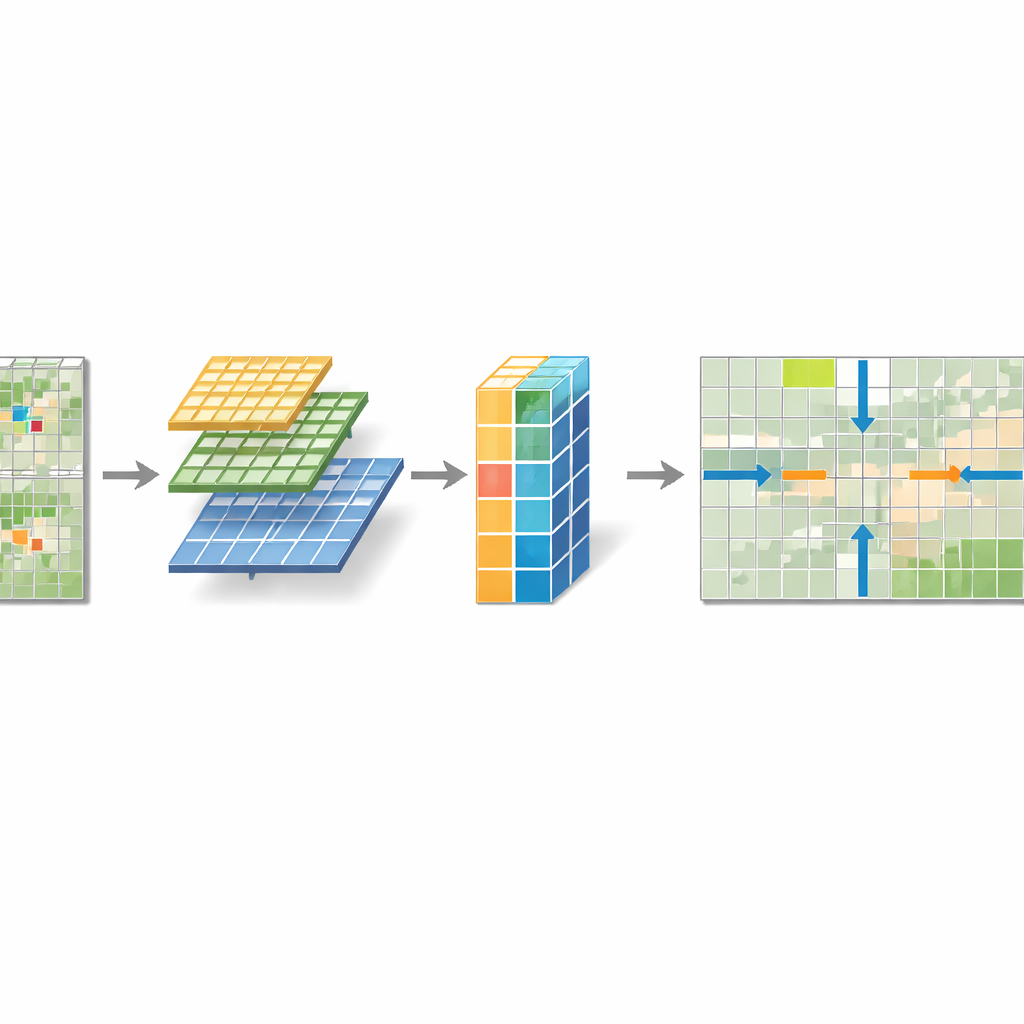

Los investigadores parten de un detector en tiempo real popular, YOLOv5, y rediseñan partes clave para crear GSS‑YOLO. Introducen tres bloques principales que trabajan de forma conjunta. Primero, un módulo de Agregación de Información Superficial‑Profunda (SIA) mezcla información de vecindarios pequeños y algo mayores en la imagen, ayudando a la red a combinar bordes finos con contexto más amplio sin aumentar demasiado el tamaño del modelo. Segundo, un bloque SPD‑Conv cambia la forma en que el sistema reduce el tamaño de la imagen: en lugar de desechar píxeles durante el muestreo a la baja, los reordena para que los detalles finos se preserven en canales adicionales antes de una compresión suave. Tercero, un Módulo Consciente del Contexto Global (GCAM) se sitúa justo antes del detector final y examina la imagen completa para resaltar posiciones que probablemente contengan objetivos pequeños mientras atenúa el ruido de fondo.

Cómo funcionan los nuevos módulos en conjunto

SIA aborda una debilidad central de muchas redes de visión: las convoluciones ordinarias solo ven parches locales y tienen dificultades con el contexto global. Al ejecutar filtros en paralelo que observan escalas ligeramente distintas y luego pasar el resultado por capas ligeras que mezclan y regularizan las características, SIA produce descriptores más ricos de objetos pequeños sin añadir muchos parámetros. SPD‑Conv resuelve otro problema: la pérdida de información por un muestreo a la baja agresivo. Parte el mapa de características en subcuadrículas entrelazadas y las apila en profundidad, de modo que no se descarta ningún píxel; a continuación, un filtro simple de 1×1 compacta esta representación más rica. GCAM añade un efecto de “foco” global. Agrupa información por separado a lo largo de las direcciones horizontal y vertical para seguir filas y columnas donde aparecen objetos diminutos, y combina esto con un mecanismo de atención simplificado sobre los canales. El resultado es una máscara multidimensional que refuerza las señales en ubicaciones con probabilidad de contener objetivos y suprime texturas confusas en otras zonas.

Poniendo el modelo a prueba

Para comprobar si estas ideas se traducen en mejoras reales, el equipo evaluó GSS‑YOLO en tres conjuntos de datos exigentes. USOD contiene objetivos ultra‑pequeños en escala de grises y escenas con poca luz; VisDrone2019 ofrece escenas urbanas concurridas captadas desde drones, repletas de peatones y vehículos diminutos; y DIOR es una colección diversa de imágenes satelitales que incluyen aviones, puentes, barcos, campos deportivos y más. En los tres casos, GSS‑YOLO logró consistentemente mayor precisión, recall y calidad media de detección que una batería de competidores modernos, incluidas versiones recientes de YOLO y varios modelos especializados en objetos pequeños. En el conjunto USOD, por ejemplo, no solo alcanzó la mejor precisión, sino que lo hizo con el menor número de parámetros—alrededor de 5 millones—y la mayor velocidad de procesamiento, alcanzando cientos de fotogramas por segundo. Ejemplos visuales muestran que evita tanto detecciones perdidas como falsas alarmas en escenas concurridas y ruidosas donde otros sistemas tienen problemas.

Qué significa esto para aplicaciones cotidianas

Para el público general, el mensaje clave es que GSS‑YOLO hace más factible ejecutar detección de alta precisión sobre objetivos pequeños y difíciles de ver directamente en drones, satélites u otros dispositivos compactos, sin depender de centros de datos masivos. Al preservar mejor los detalles finos de la imagen y usar el contexto global para guiar la atención, el modelo convierte motas apenas visibles en objetos reconocidos con confianza. Aunque aún puede fallar en condiciones extremas—por ejemplo, cuando la mayor parte de un objetivo está oculta o el desenfoque por movimiento es severo—el trabajo supone un paso práctico hacia la monitorización en tiempo real de áreas extensas para gestión del tráfico, observación ambiental, seguridad y respuesta a emergencias, donde ver detalles diminutos rápidamente puede marcar una gran diferencia.

Cita: Wu, Z., Li, N., Tian, Z. et al. A lightweight feature fusion network for weak and small target detection in remote sensing. Sci Rep 16, 13295 (2026). https://doi.org/10.1038/s41598-026-43560-2

Palabras clave: teledetección, detección de objetos pequeños, red neuronal ligera, imágenes de dron, observación de la Tierra