Clear Sky Science · pl

Lekka sieć do fuzji cech dla wykrywania słabych i małych obiektów w teledetekcji

Dlaczego wykrywanie maleńkich obiektów z nieba ma znaczenie

Od monitorowania ruchu i statków po wspieranie działań ratunkowych — współczesne satelity i drony nieustannie skanują powierzchnię Ziemi. Jednak wiele interesujących nas obiektów — małe pojazdy, łodzie czy fragmenty infrastruktury — pojawia się na zdjęciach jako zaledwie kilka pikseli i łatwo ginie w zatłoczonych dzielnicach, lasach czy na wybrzeżach. W artykule przedstawiono GSS‑YOLO, nowy, lekki system wizji komputerowej zaprojektowany do niezawodnego wykrywania tych słabych, drobnych celów na obrazach teledetekcyjnych, nawet gdy zdjęcia są rozmyte, ciemne lub pełne rozpraszających elementów tła.

Wyzwanie: znaleźć igłę w stogu siana

Kamera teledetekcyjna zamontowana na statku powietrznym czy satelicie rejestruje jednocześnie duże obszary. Szeroki kadr jest przydatny, ale zmniejsza rozmiar każdego obiektu — małe cele mogą zajmować tylko 10×10 pikseli lub mniej. Równocześnie tło jest złożone — chmury, dachy, drzewa, rzeki, cienie oraz sezonowe zmiany oświetlenia i pogody dodają szum. Tradycyjne systemy wykrywania albo pomijają te drobne obiekty, albo wymagają ciężkich, wolnych modeli trudnych do uruchomienia w czasie rzeczywistym na dronach czy urządzeniach brzegowych. Autorzy postawili sobie za cel stworzenie modelu, który będzie jednocześnie dokładny dla małych obiektów i wystarczająco wydajny, by działać szybko na ograniczonym sprzęcie.

Kompaktowy system dostrojony do małych detali

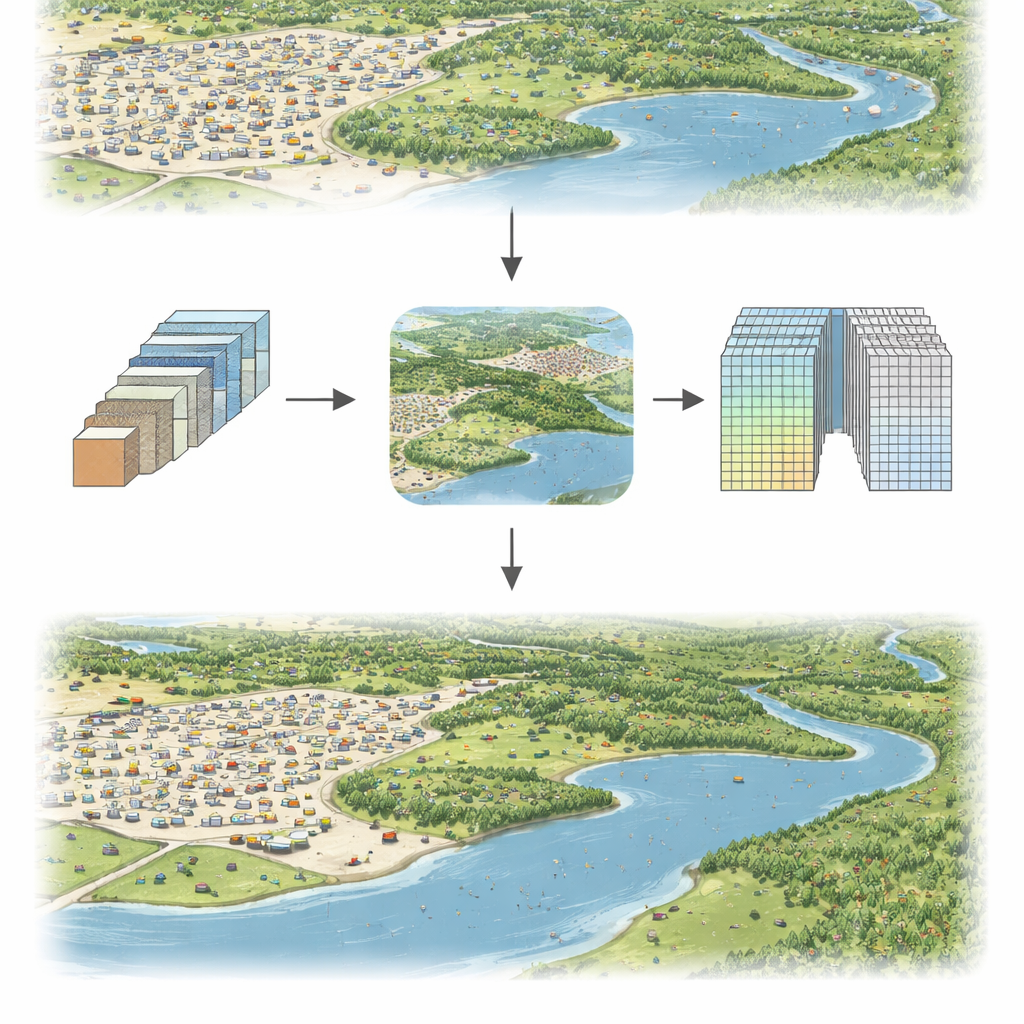

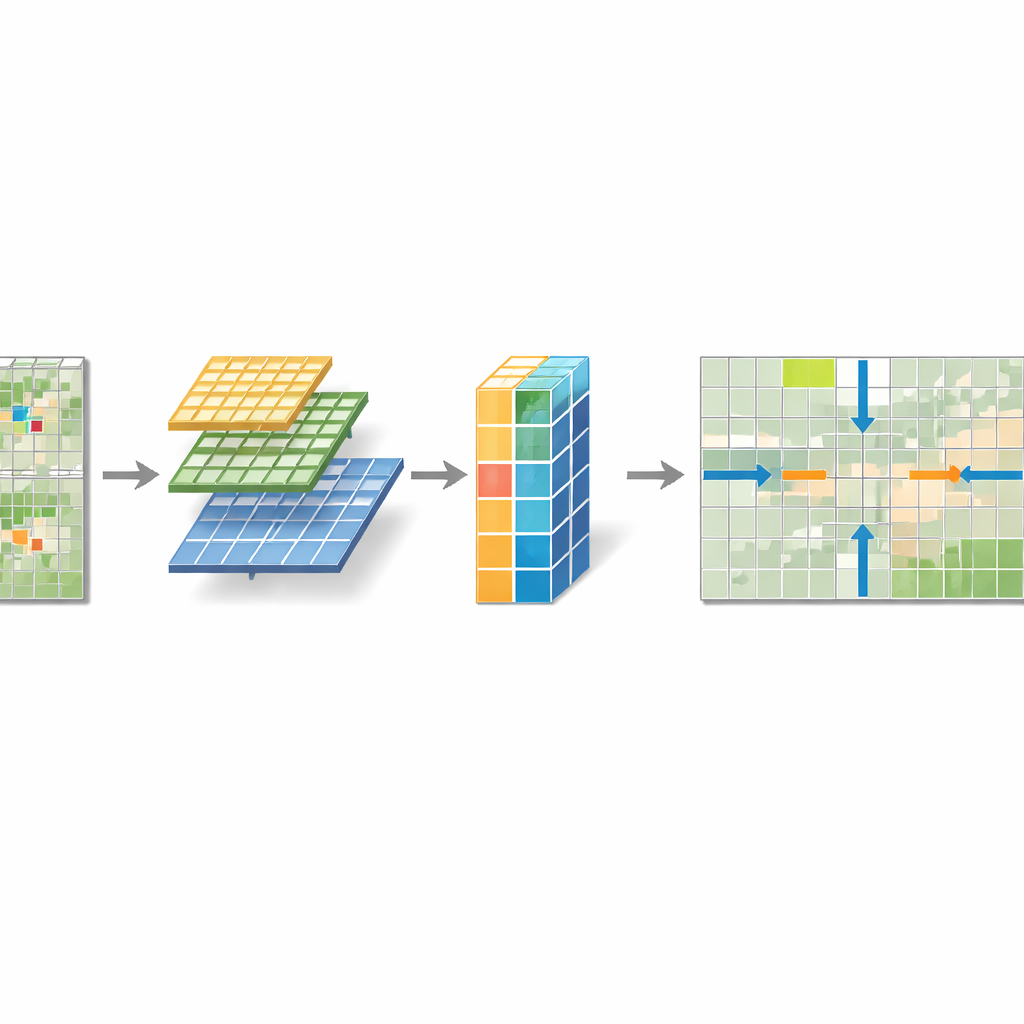

Badacze zaczęli od popularnego detektora czasu rzeczywistego YOLOv5 i przeprojektowali kluczowe elementy, tworząc GSS‑YOLO. Wprowadzili trzy główne bloki budulcowe, które współdziałają ze sobą. Po pierwsze, moduł Shallow‑Deep Information Aggregation (SIA) miesza informacje z małych i nieco większych sąsiedztw obrazu, pomagając sieci łączyć drobne krawędzie z szerszym kontekstem bez nadmiernego rozrastania modelu. Po drugie, blok SPD‑Conv zmienia sposób, w jaki system zmniejsza rozmiar obrazu: zamiast po prostu odrzucać piksele podczas downsamplingu, przearanżowuje je tak, żeby drobne detale zostały zachowane w dodatkowych kanałach przed łagodną kompresją. Po trzecie, Global Context‑Aware Module (GCAM) umieszczony tuż przed końcowym detektorem przeszukuje cały obraz, aby uwypuklić miejsca, które prawdopodobnie zawierają małe cele, jednocześnie tłumiąc rozpraszające elementy tła.

Jak nowe moduły współpracują

SIA adresuje podstawową słabość wielu sieci wizji: zwykłe konwolucje widzą tylko lokalne fragmenty i mają problem z globalnym kontekstem. Poprzez uruchamianie równoległych filtrów działających na nieco różnych skalach, a następnie przekazywanie wyniku przez lekkie warstwy, które mieszają i regularyzują cechy, SIA generuje bogatsze deskryptory małych obiektów bez dodawania wielu parametrów. SPD‑Conv rozwiązuje inny problem — utratę informacji przy agresywnym downsamplingu. Dzieli mapę cech na przeplatane pod‑siatki i układa je w głąb (w kanałach), tak aby żaden piksel nie został odrzucony; prosty filtr 1×1 następnie upakowuje tę bogatszą reprezentację. GCAM dodaje globalny efekt „reflektora”. Agreguje informacje osobno w kierunkach poziomym i pionowym, by śledzić wiersze i kolumny, w których pojawiają się drobne obiekty, i łączy to ze uproszczonym mechanizmem uwagi po kanałach. Efektem jest wielowymiarowa maska, która wzmacnia sygnały w prawdopodobnych lokalizacjach celów i tłumi mylące tekstury w innych miejscach.

Testy modelu

Aby sprawdzić, czy pomysły przekładają się na rzeczywiste korzyści, zespół ocenił GSS‑YOLO na trzech wymagających zestawach danych. USOD zawiera przyciemnione, ultra‑małe cele w skalach szarości w scenach o słabym oświetleniu; VisDrone2019 oferuje zatłoczone sceny miejskie rejestrowane przez drony, pełne maleńkich pieszych i pojazdów; a DIOR to zróżnicowana kolekcja satelitarna z samolotami, mostami, statkami, boiskami i innymi obiektami. We wszystkich trzech zestawach GSS‑YOLO konsekwentnie osiągał wyższą precyzję, czułość i średnią jakość wykrywania niż pakiet nowoczesnych konkurentów, w tym nowsze wersje YOLO i kilka wyspecjalizowanych modeli do wykrywania małych obiektów. W zestawie USOD, na przykład, nie tylko uzyskał najlepszą dokładność, lecz zrobił to przy najmniejszej liczbie parametrów — około 5 milionów — i najwyższej prędkości przetwarzania, sięgającej setek klatek na sekundę. Przykłady wizualne pokazują, że unika zarówno przeoczeń, jak i fałszywych alarmów w zatłoczonych, złożonych scenach, z którymi zmagają się inne systemy.

Co to oznacza w praktyce

Dla osób niebędących ekspertami kluczowy wniosek jest taki, że GSS‑YOLO ułatwia uruchamianie precyzyjnego wykrywania małych, trudnych do zauważenia celów bezpośrednio na dronach, satelitach czy innych kompaktowych urządzeniach, bez polegania na ogromnych centrach danych. Dzięki lepszemu zachowaniu drobnych detali obrazu i wykorzystaniu globalnego kontekstu do kierowania uwagą, model zamienia słabe kropki w pewnie rozpoznawane obiekty. Chociaż nadal może zawodzić w ekstremalnych warunkach — np. gdy większość obiektu jest zasłonięta lub gdy rozmycie ruchu jest silne — praca ta stanowi praktyczny krok w stronę monitoringu szerokich obszarów w czasie rzeczywistym dla zarządzania ruchem, obserwacji środowiska, bezpieczeństwa i reakcji kryzysowej, gdzie szybkie dostrzeżenie drobnych szczegółów może mieć duże znaczenie.

Cytowanie: Wu, Z., Li, N., Tian, Z. et al. A lightweight feature fusion network for weak and small target detection in remote sensing. Sci Rep 16, 13295 (2026). https://doi.org/10.1038/s41598-026-43560-2

Słowa kluczowe: teledetekcja, wykrywanie małych obiektów, lekka sieć neuronowa, obrazowanie z dronów, obserwacja Ziemi