Clear Sky Science · de

Ein leichtgewichtiges Feature‑Fusionsnetzwerk zur Erkennung schwacher und kleiner Ziele in der Fernerkundung

Warum das Finden winziger Objekte aus der Luft wichtig ist

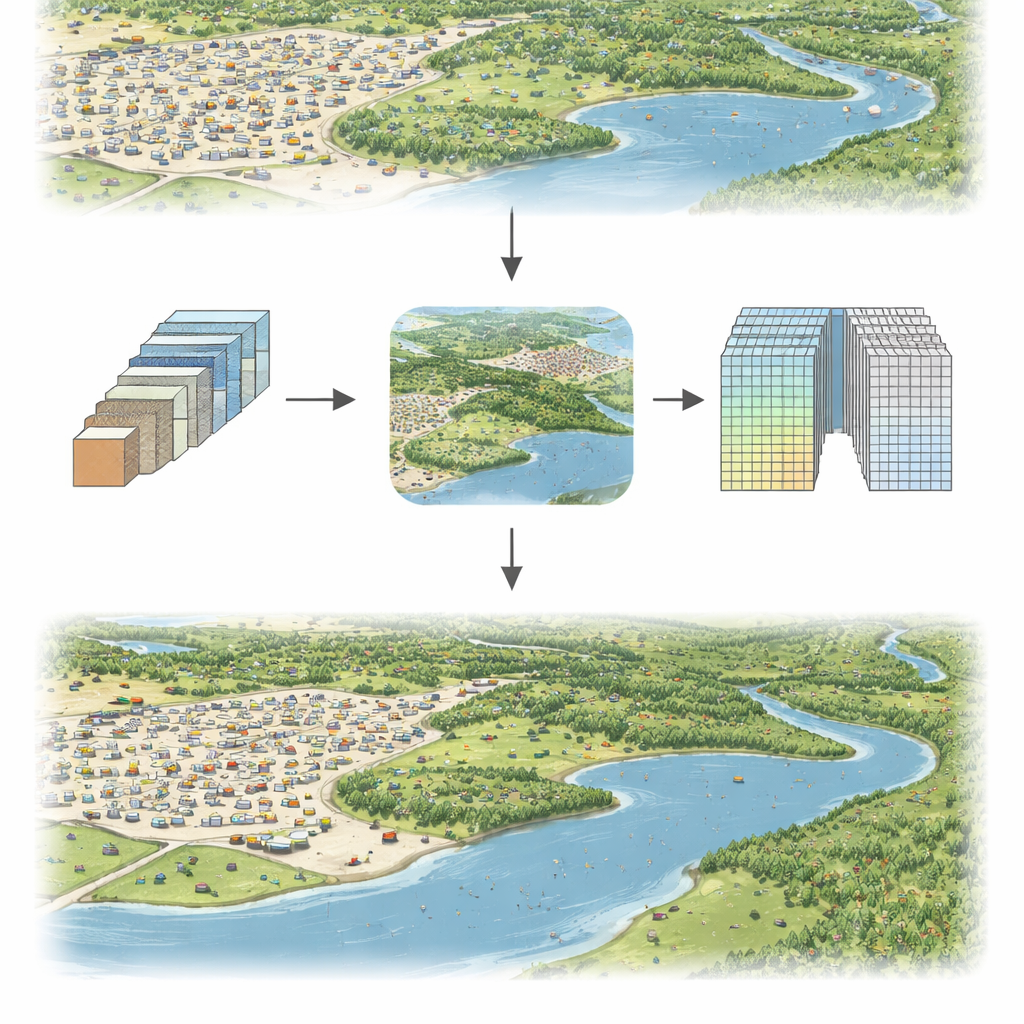

Von der Verkehrs‑ und Schiffsüberwachung bis hin zur Unterstützung bei Katastropheneinsätzen scannen heutige Satelliten und Drohnen kontinuierlich die Erdoberfläche. Viele der für uns wichtigsten Objekte — kleine Fahrzeuge, Boote oder Infrastrukturteile — erscheinen in Bildern jedoch nur über wenige Pixel und gehen leicht in überfüllten Stadtblöcken, Wäldern oder an Uferzonen verloren. Dieses Paper stellt GSS‑YOLO vor, ein neues, leichtgewichtiges Computer‑Vision‑System, das entwickelt wurde, um diese schwachen, winzigen Ziele in Fernerkundungsbildern zuverlässig zu erkennen, selbst wenn Aufnahmen unscharf, dunkel oder von störendem Hintergrundrauschen geprägt sind.

Die Herausforderung: Nadeln im Heuhaufen finden

Fernerkundungskameras auf Flugzeugen und Satelliten erfassen große Gebiete auf einmal. Dieser weite Blick ist nützlich, verkleinert aber jedes Objekt: Kleine Ziele können nur noch 10×10 Pixel oder weniger abdecken. Gleichzeitig sind Hintergründe komplex — Wolken, Dächer, Bäume, Flüsse, Schatten sowie jahreszeitliche Beleuchtungs‑ und Wetteränderungen erhöhen das Rauschen. Traditionelle Erkennungssysteme übersehen diese winzigen Objekte oder benötigen schwere, langsame Modelle, die sich nur schwer in Echtzeit auf Drohnen oder Edge‑Geräten betreiben lassen. Die Autoren haben es sich zum Ziel gesetzt, ein Modell zu entwickeln, das sowohl bei kleinen Objekten genau als auch auf begrenzter Hardware effizient genug für schnellen Betrieb ist.

Ein kompaktes System auf Feinheiten getrimmt

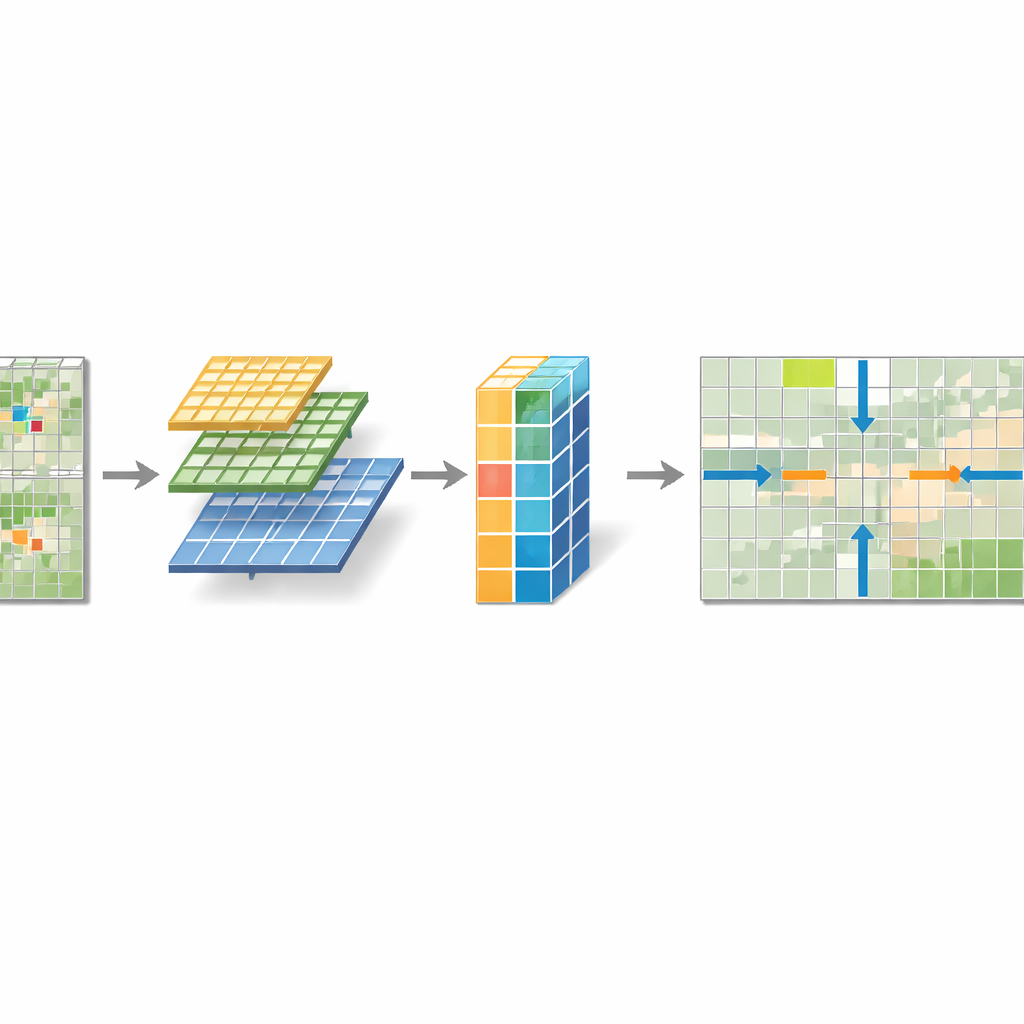

Die Forscher beginnen mit einem populären Echtzeitdetektor, YOLOv5, und überarbeiten zentrale Komponenten, um GSS‑YOLO zu schaffen. Sie führen drei Hauptbausteine ein, die zusammenwirken. Erstens mischt das Shallow‑Deep Information Aggregation (SIA) Modul Informationen aus kleinen und etwas größeren Nachbarschaften im Bild, sodass das Netzwerk feine Kanten mit breiterem Kontext kombiniert, ohne das Modell aufzublähen. Zweitens verändert ein SPD‑Conv‑Block die Art der Größenreduktion: Anstatt beim Downsampling Pixel einfach zu verwerfen, werden diese so umgeordnet, dass feine Details in zusätzlichen Kanälen erhalten bleiben, bevor eine schonende Kompression erfolgt. Drittens sitzt ein Global Context‑Aware Module (GCAM) unmittelbar vor dem finalen Detektor und betrachtet das gesamte Bild, um Positionen hervorzuheben, die wahrscheinlich kleine Ziele enthalten, während Hintergrundstörungen abgeschwächt werden.

Wie die neuen Module zusammenwirken

SIA adressiert eine Kernschwäche vieler Vision‑Netzwerke: Gewöhnliche Faltungen sehen nur lokale Ausschnitte und tun sich mit globalem Kontext schwer. Durch paralleles Anwenden von Filtern, die leicht unterschiedliche Skalen betrachten, und anschließendes Durchreichen der Ergebnisse durch leichtgewichtige Schichten, die Merkmale mischen und regularisieren, erzeugt SIA reichhaltigere Beschreibungen kleiner Objekte, ohne viele Parameter hinzuzufügen. SPD‑Conv löst ein anderes Problem — Informationsverlust durch aggressives Downsampling. Es zerlegt die Feature‑Map in verschachtelte Sub‑Gitter und stapelt diese tiefenweise, sodass kein Pixel verworfen wird; ein einfacher 1×1‑Filter komprimiert dann diese reichhaltigere Repräsentation. GCAM fügt einen globalen „Scheinwerfer“ hinzu: Es poolt Informationen getrennt entlang horizontaler und vertikaler Richtungen, um Reihen und Spalten zu verfolgen, in denen winzige Objekte auftreten, und kombiniert dies mit einem schlanken Aufmerksamkeitsmechanismus über Kanäle. Das Ergebnis ist eine mehrdimensionale Maske, die Signale an wahrscheinlichen Zielorten stärkt und verwirrende Texturen anderswo unterdrückt.

Das Modell auf die Probe gestellt

Um zu prüfen, ob sich diese Ideen in realen Vorteilen niederschlagen, bewertete das Team GSS‑YOLO an drei anspruchsvollen Datensätzen. USOD enthält dunkle, ultra‑kleine Graustufen‑Ziele in Lichtschwachen Szenen; VisDrone2019 bietet belebte Stadtszenen aus Drohnenperspektive, voll mit winzigen Fußgängern und Fahrzeugen; und DIOR ist eine vielfältige Satellitensammlung mit Flugzeugen, Brücken, Schiffen, Sportplätzen und mehr. Über alle drei Datensätze hinweg erreichte GSS‑YOLO durchgehend höhere Präzision, Recall und durchschnittliche Erkennungsqualität als eine Reihe moderner Konkurrenzmodelle, darunter neuere YOLO‑Versionen und mehrere spezialisierte Modelle für kleine Objekte. Auf dem USOD‑Datensatz etwa lieferte es nicht nur die beste Genauigkeit, sondern auch die wenigsten Parameter — rund 5 Millionen — und die höchste Verarbeitungsgeschwindigkeit, mit Hunderten von Bildern pro Sekunde. Visuelle Beispiele zeigen, dass es sowohl verpasste Erkennungen als auch Fehlalarme in überfüllten, unruhigen Szenen vermeidet, in denen andere Systeme Probleme haben.

Was das für den Alltag bedeutet

Für Nicht‑Experten ist die Kernbotschaft, dass GSS‑YOLO die Ausführung scharfsinniger Erkennung kleiner, schwer sichtbarer Ziele direkt auf Drohnen, Satelliten oder anderen kompakten Geräten praktikabler macht, ohne auf riesige Rechenzentren angewiesen zu sein. Durch besseres Bewahren feiner Bilddetails und die Nutzung globalen Kontexts zur Steuerung der Aufmerksamkeit verwandelt das Modell schwache Punkte in verlässlich erkannte Objekte. Obwohl es unter extremen Bedingungen — etwa wenn ein Großteil eines Ziels verdeckt ist oder starke Bewegungsunschärfe vorliegt — weiterhin scheitern kann, stellt diese Arbeit einen praxisnahen Schritt in Richtung Echtzeit‑Weitbereichsüberwachung für Verkehrsmanagement, Umweltbeobachtung, Sicherheit und Notfallhilfe dar, wo das schnelle Erkennen winziger Details einen großen Unterschied machen kann.

Zitation: Wu, Z., Li, N., Tian, Z. et al. A lightweight feature fusion network for weak and small target detection in remote sensing. Sci Rep 16, 13295 (2026). https://doi.org/10.1038/s41598-026-43560-2

Schlüsselwörter: Fernerkundung, Erkennung kleiner Objekte, leichtgewichtiges neuronales Netzwerk, Drohnenaufnahmen, Erdbeobachtung