Clear Sky Science · pt

Uma rede leve de fusão de características para detecção de alvos fracos e pequenos em sensoriamento remoto

Por que encontrar objetos minúsculos do céu é importante

De monitorar o tráfego e navios a orientar respostas a desastres, os satélites e drones de hoje escaneiam continuamente a superfície da Terra. Ainda assim, muitas das coisas que mais nos interessam — pequenos veículos, barcos ou trechos de infraestrutura — aparecem nas imagens com apenas alguns pixels, facilmente perdidos em quarteirões urbanos lotados, florestas ou linhas costeiras. Este artigo apresenta o GSS‑YOLO, um novo sistema de visão computacional leve projetado para detectar de forma confiável esses alvos fracos e diminutos em imagens de sensoriamento remoto, mesmo quando as fotos estão borradas, escuras ou cheias de detalhes de fundo que distraem.

O desafio de ver agulhas num palheiro

Câmeras de sensoriamento remoto montadas em aeronaves e satélites capturam áreas enormes de uma só vez. Essa visão ampla é útil, mas reduz cada objeto: alvos pequenos podem ocupar apenas 10×10 pixels ou menos. Ao mesmo tempo, os fundos são complexos — nuvens, telhados, árvores, rios, sombras e mudanças sazonais de iluminação ou clima adicionam ruído. Sistemas de detecção tradicionais ou não detectam esses objetos minúsculos ou exigem modelos pesados e lentos, difíceis de executar em tempo real em drones ou dispositivos de borda. Os autores propuseram construir um modelo que seja ao mesmo tempo preciso para objetos pequenos e eficiente o bastante para rodar rapidamente em hardware limitado.

Um sistema compacto ajustado para detalhes finos

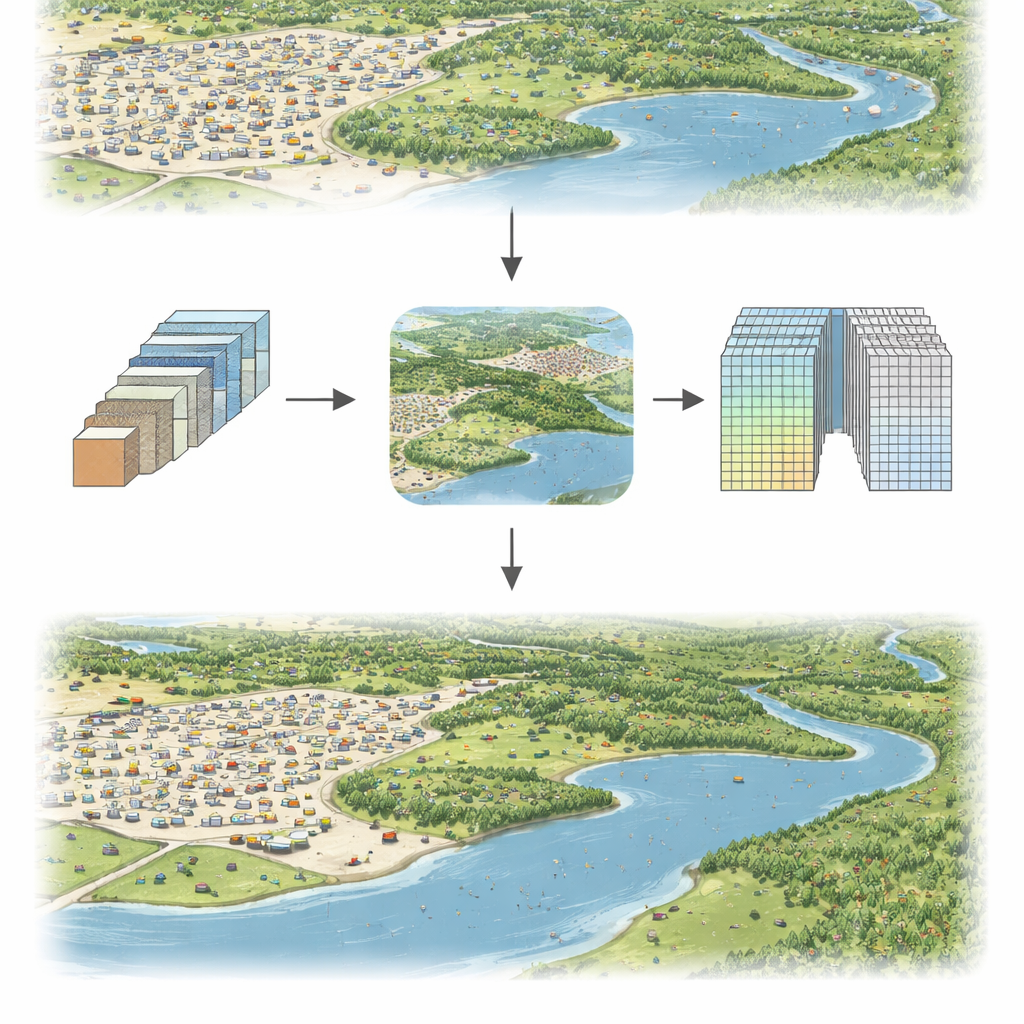

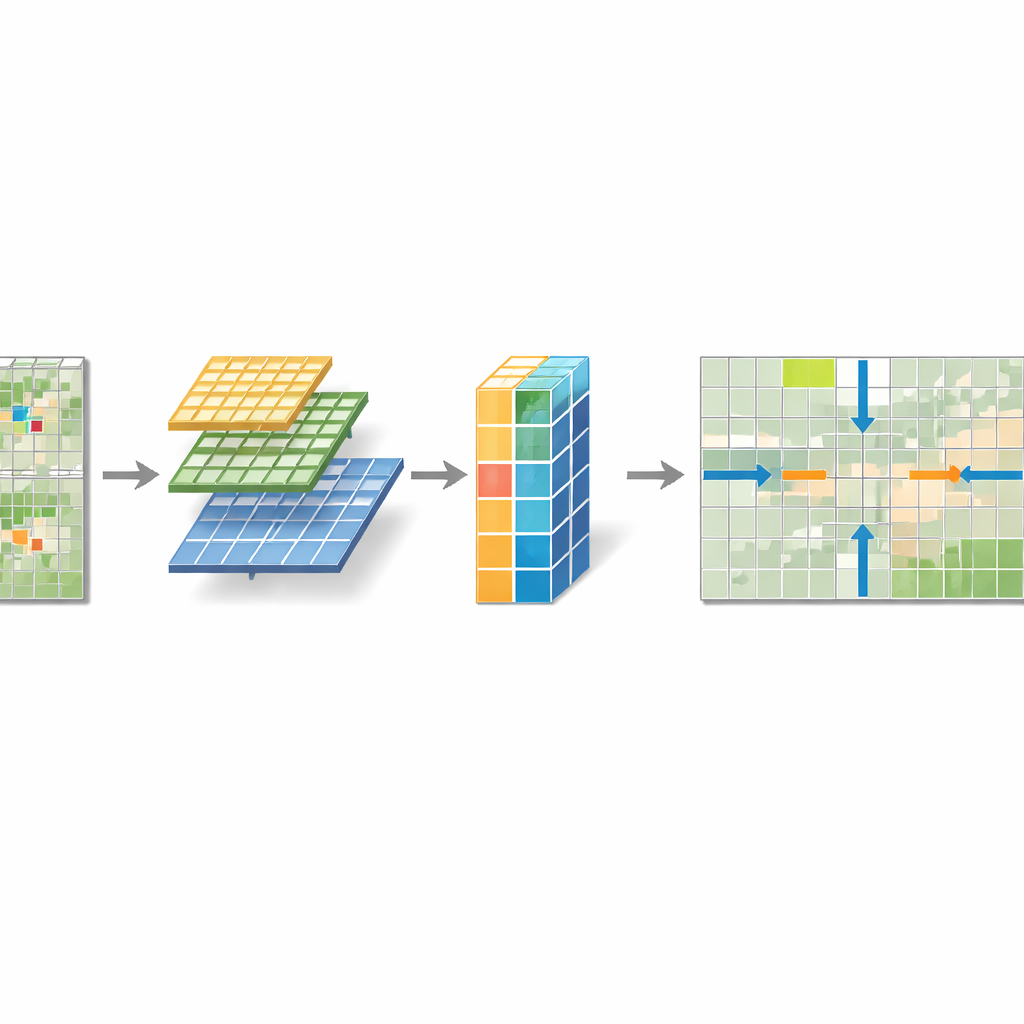

Os pesquisadores partem de um detector em tempo real popular chamado YOLOv5 e redesenham partes-chave para criar o GSS‑YOLO. Eles introduzem três blocos principais que funcionam em conjunto. Primeiro, um módulo Agregação de Informação Rasa‑Profunda (SIA) mistura informações de vizinhanças pequenas e ligeiramente maiores na imagem, ajudando a rede a combinar bordas finas com contexto mais amplo sem inflar o modelo. Segundo, um bloco SPD‑Conv altera como o sistema reduz o tamanho da imagem: em vez de simplesmente descartar pixels durante o downsampling, ele os reorganiza para que detalhes finos sejam preservados em canais extras antes de uma compressão suave. Terceiro, um Módulo de Consciência de Contexto Global (GCAM) fica logo antes do detector final e observa a imagem inteira para realçar posições que provavelmente contenham alvos pequenos enquanto reduz o ruído de fundo.

Como os novos módulos funcionam em conjunto

SIA aborda uma fraqueza central de muitas redes de visão: convoluções ordinárias enxergam apenas patches locais e têm dificuldade com contexto global. Ao executar filtros em paralelo que analisam escalas ligeiramente diferentes, e então passar o resultado por camadas leves que misturam e regularizam características, o SIA produz descritores mais ricos de objetos pequenos sem acrescentar muitos parâmetros. SPD‑Conv resolve um problema diferente — perda de informação por downsampling agressivo. Ele corta o mapa de características em sub‑grades entrelaçadas e as empilha em profundidade, de modo que nenhum pixel é descartado; um simples filtro 1×1 então compacta essa representação mais rica. GCAM adiciona um efeito de "holofote" global. Ele agrega informações separadamente ao longo das direções horizontal e vertical para acompanhar linhas e colunas onde aparecem objetos minúsculos, e combina isso com um mecanismo de atenção enxuto sobre canais. O resultado é uma máscara multidimensional que fortalece sinais em localizações prováveis de alvos e suprime texturas confusas em outras áreas.

Colocando o modelo à prova

Para verificar se essas ideias se traduzem em ganhos no mundo real, a equipe avaliou o GSS‑YOLO em três conjuntos de dados exigentes. O USOD contém alvos em tons de cinza, ultra‑pequenos e pouco iluminados; o VisDrone2019 oferece cenas urbanas movimentadas filmadas por drones, repletas de pedestres e veículos minúsculos; e o DIOR é uma coleção diversa de satélites com aviões, pontes, navios, campos esportivos e mais. Em todos os três, o GSS‑YOLO alcançou consistentemente maior precisão, recall e qualidade média de detecção do que um conjunto de concorrentes modernos, incluindo versões recentes do YOLO e vários modelos especializados em pequenos objetos. No conjunto USOD, por exemplo, ele não só apresentou a melhor acurácia como o fez com o menor número de parâmetros — cerca de 5 milhões — e a maior velocidade de processamento, atingindo centenas de quadros por segundo. Exemplos visuais mostram que ele evita tanto detecções perdidas quanto falsos alarmes em cenas lotadas e confusas onde outros sistemas têm dificuldade.

O que isso significa para aplicações do dia a dia

Para não especialistas, a mensagem principal é que o GSS‑YOLO torna mais viável rodar detecção de alta sensibilidade sobre alvos pequenos e difíceis de ver diretamente em drones, satélites ou outros dispositivos compactos, sem depender de grandes centros de dados. Ao preservar melhor os detalhes finos da imagem e usar contexto global para guiar a atenção, o modelo transforma manchas tênues em objetos reconhecidos com confiança. Embora ainda possa falhar em condições extremas — como quando a maior parte de um alvo está oculta ou o desfoque de movimento é severo — o trabalho representa um passo prático rumo ao monitoramento em tempo real de larga área para gestão de tráfego, observação ambiental, segurança e resposta a emergências, onde ver pequenos detalhes rapidamente pode fazer grande diferença.

Citação: Wu, Z., Li, N., Tian, Z. et al. A lightweight feature fusion network for weak and small target detection in remote sensing. Sci Rep 16, 13295 (2026). https://doi.org/10.1038/s41598-026-43560-2

Palavras-chave: sensoriamento remoto, detecção de pequenos objetos, rede neural leve, imagens de drones, observação da Terra