Clear Sky Science · nl

Een lichtgewicht feature-fusienetwerk voor zwakke en kleine doeldetectie in remote sensing

Waarom het vinden van piepkleine objecten vanuit de lucht belangrijk is

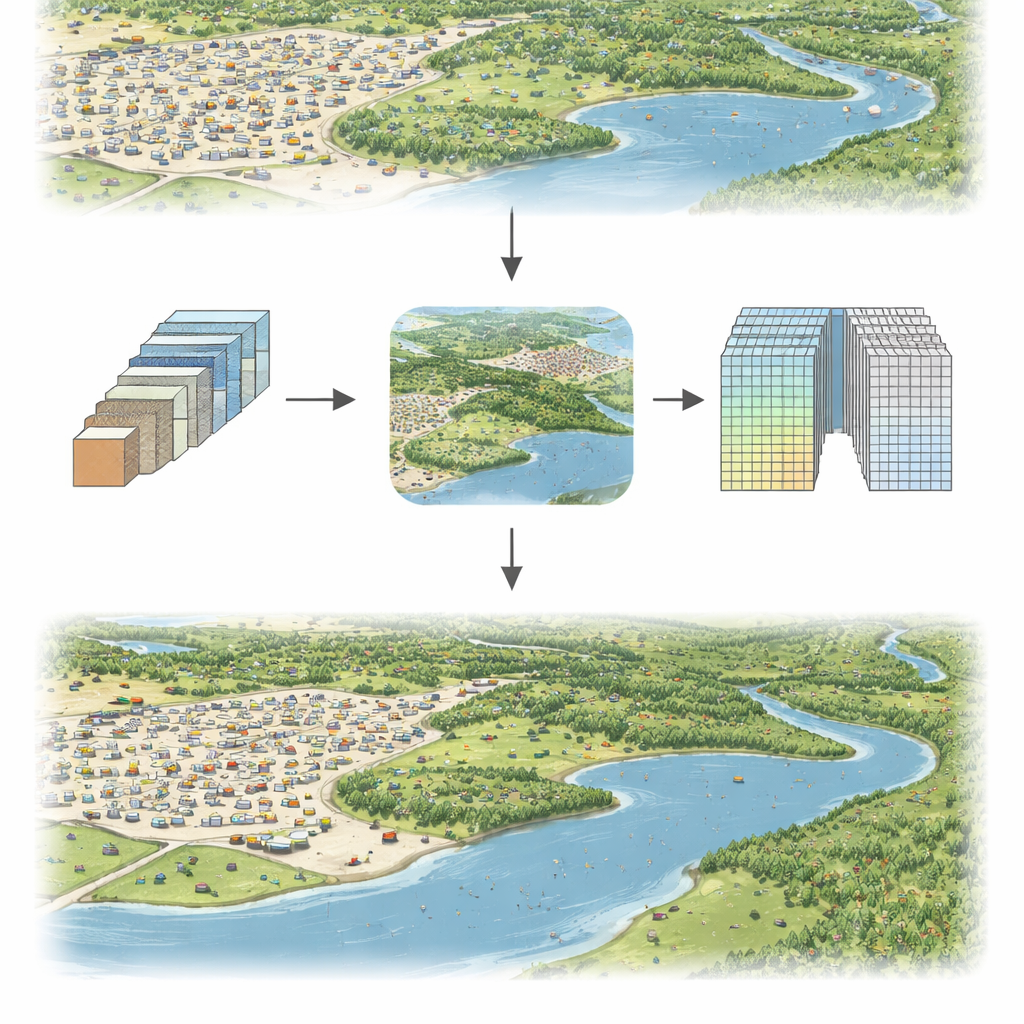

Van het monitoren van verkeer en schepen tot het sturen van hulpacties bij rampen: satellieten en drones scannen tegenwoordig continu het aardoppervlak. Veel van de zaken die we het meest willen volgen — kleine voertuigen, bootjes of onderdelen van infrastructuur — verschijnen in beelden echter als slechts enkele pixels en raken gemakkelijk verloren in drukke stadsblokken, bossen of aanleggen. Dit artikel introduceert GSS‑YOLO, een nieuw, lichtgewicht computervissysteem dat is ontworpen om deze zwakke, piepkleine doelen in remote‑sensingbeelden betrouwbaar te detecteren, zelfs wanneer de foto’s wazig, donker of vol afleidende achtergronddetails zijn.

De uitdaging: naalden zoeken in een hooiberg

Remote‑sensingcamera’s op vliegtuigen en satellieten leggen tegelijkertijd enorme gebieden vast. Dat brede beeld is nuttig, maar het verkleint elk object: kleine doelen beslaan soms slechts 10×10 pixels of minder. Tegelijkertijd zijn achtergronden complex — wolken, daken, bomen, rivieren, schaduwen en seizoensafhankelijke veranderingen in licht of weer voegen allemaal ruis toe. Traditionele detectiesystemen missen deze piepkleine objecten of vragen om zware, trage modellen die moeilijk in realtime op drones of randapparatuur te draaien zijn. De auteurs wilden een model bouwen dat zowel nauwkeurig is voor kleine objecten als efficiënt genoeg om snel op beperkte hardware te werken.

Een compact systeem afgestemd op kleine details

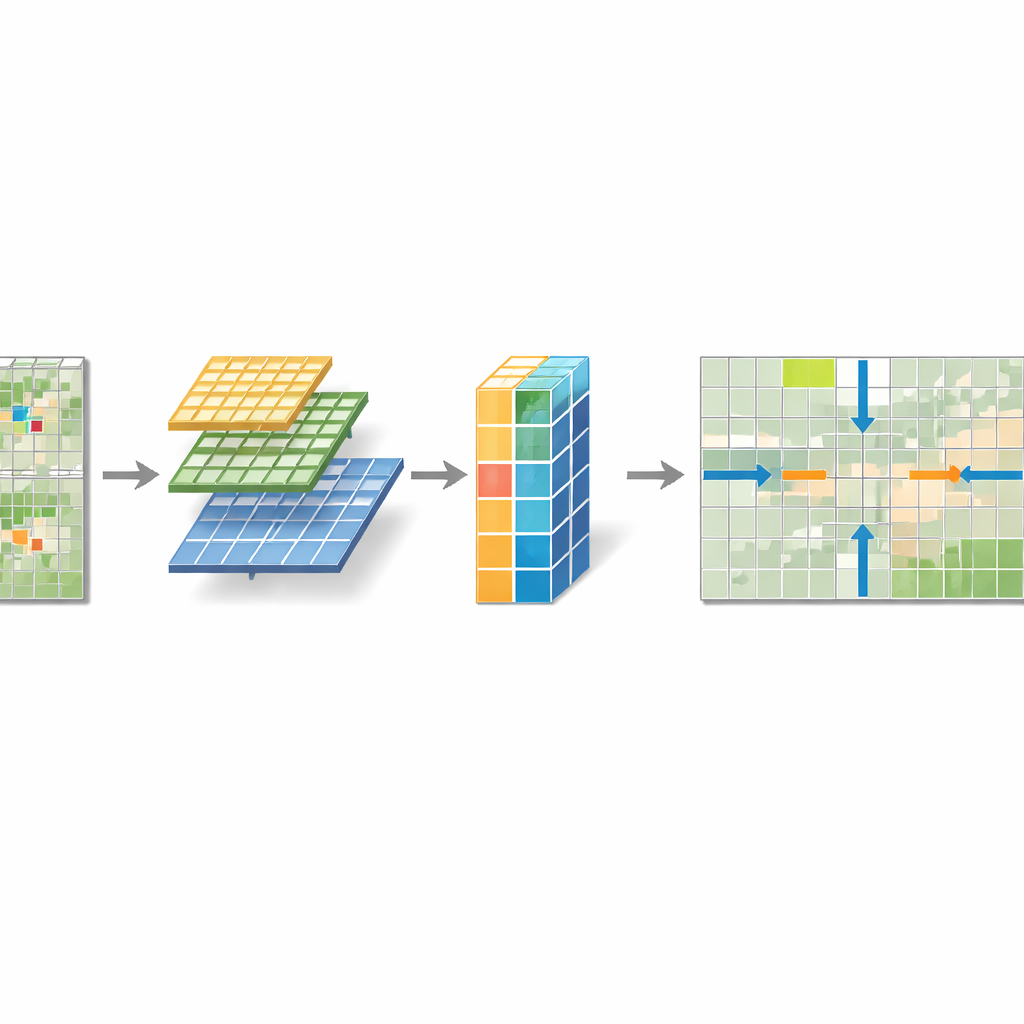

De onderzoekers vertrekken van een populaire realtimedetector, YOLOv5, en herontwerpen sleutelcomponenten om GSS‑YOLO te creëren. Ze introduceren drie hoofdbouwstenen die samen werken. Ten eerste mixt een Shallow‑Deep Information Aggregation (SIA)-module informatie uit kleine en iets grotere buurtgebieden in het beeld, wat het netwerk helpt fijne randen te combineren met bredere context zonder het model opzadelen met veel extra parameters. Ten tweede verandert een SPD‑Conv-blok de manier waarop het systeem de afbeeldingsgrootte reduceert: in plaats van tijdens downsampling pixels simpelweg weg te gooien, herschikt het ze zodat fijne details bewaard blijven in extra kanalen voordat ze zachtjes worden samengeperst. Ten derde bevindt zich een Global Context‑Aware Module (GCAM) vlak voor de uiteindelijke detector; die kijkt over het hele beeld om posities te benadrukken die waarschijnlijk kleine doelen bevatten en tegelijk achtergrondruis te onderdrukken.

Hoe de nieuwe modules samenwerken

SIA pakt een kernzwakte van veel visienetwerken aan: gewone convoluties zien alleen lokale patchjes en worstelen met globale context. Door parallelle filters te laten draaien die naar iets verschillende schalen kijken, en het resultaat vervolgens door lichtgewicht lagen te sturen die features mengen en regulariseren, produceert SIA rijkere beschrijvingen van kleine objecten zonder veel extra parameters toe te voegen. SPD‑Conv adresseert een ander probleem — informatieverlies door agressieve downsampling. Het snijdt de featuremap in afwisselende subroosters en stapelt die depth‑wise, zodat geen pixel wordt weggelaten; een eenvoudige 1×1‑filter compacteert vervolgens deze rijkere representatie. GCAM voegt een globale ‘spotlight’-werking toe. Het poolt informatie afzonderlijk langs horizontale en verticale richtingen om rijen en kolommen bij te houden waar kleine objecten verschijnen, en combineert dit met een gestroomlijnd attentie‑mechanisme over kanalen. Het resultaat is een multidimensionaal masker dat signalen op waarschijnlijke doelposities versterkt en verwarrende texturen elders onderdrukt.

Het model op de proef stellen

Om te beoordelen of deze ideeën zich in de praktijk bewijzen, evalueerde het team GSS‑YOLO op drie veeleisende datasets. USOD bevat zwakke, ultrakleine grijswaarde‑doelen in scènes met weinig licht; VisDrone2019 biedt drukke stedelijke scènes geschoten vanaf drones, vol kleine voetgangers en voertuigen; en DIOR is een diverse satellietverzameling met vliegtuigen, bruggen, schepen, sportvelden en meer. Over alle drie behaalde GSS‑YOLO consequent hogere precisie, recall en gemiddelde detectiekwaliteit dan een reeks moderne concurrenten, inclusief recente YOLO‑versies en verschillende gespecialiseerde kleine‑objectmodellen. Op de USOD‑dataset leverde het model bijvoorbeeld niet alleen de beste nauwkeurigheid maar deed dat ook met het minste aantal parameters — ongeveer 5 miljoen — en de hoogste verwerkingssnelheid, tot honderden frames per seconde. Visuele voorbeelden tonen dat het zowel gemiste detecties als valse alarmen vermijdt in drukke, rommelige scènes waar andere systemen moeite hebben.

Wat dit betekent voor alledaagse toepassingen

Voor niet‑experts is de kernboodschap dat GSS‑YOLO het haalbaarder maakt om scherpziende detectie van kleine, moeilijk waarneembare doelen rechtstreeks op drones, satellieten of andere compacte apparaten uit te voeren, zonder te vertrouwen op enorme datacenters. Door fijne beelddetails beter te behouden en globale context te gebruiken om aandacht te sturen, verandert het model vage stipjes in met vertrouwen herkende objecten. Hoewel het nog kan falen onder extreme omstandigheden — bijvoorbeeld wanneer het grootste deel van een doel verborgen is of bewegingsonscherpte ernstig is — markeert dit werk een praktische stap richting realtime, grootschalige monitoring voor verkeersbeheer, milieuobservatie, beveiliging en noodhulp, waar het snel zien van kleine details een groot verschil kan maken.

Bronvermelding: Wu, Z., Li, N., Tian, Z. et al. A lightweight feature fusion network for weak and small target detection in remote sensing. Sci Rep 16, 13295 (2026). https://doi.org/10.1038/s41598-026-43560-2

Trefwoorden: remote sensing, detectie van kleine objecten, lichtgewicht neuraal netwerk, dronebeelden, Aarde-observatie