Clear Sky Science · ru

Объяснимое обнаружение музыки, сгенерированной машиной, и ранняя систематическая оценка

Почему это важно для поклонников музыки и создателей

Искусственный интеллект теперь может сочинять правдопodobные песни за секунды. Это вдохновляет творцов, но вызывает беспокойство у музыкантов, лейблов и слушателей, которым важны оригинальность и справедливое признание. В этом исследовании поставлен простой, но срочный вопрос: можем ли мы надёжно определить, создана ли композиция человеком или машиной, и можем ли мы понять, как эти системы обнаружения принимают решения?

Задача обнаружения песен, созданных ИИ

Музыка, сгенерированная машинами, уже используется для фоновых треков, помощи в написании песен и даже терапии. В то же время те же инструменты могут наводнить стриминговые платформы низкоусердными треками, размыть авторство и обесценить труд людей. Предыдущие исследования по обнаружению фейкового аудио в основном сосредоточивались на речи или на узких музыкальных задачах и часто опирались на неопубликованные модели или единичные тесты. Авторы утверждают, что в области не хватает ясного систематического сравнения методов, особенно такого, которое объясняло бы, почему детектор отмечает трек как «реальный» или «фейковый». Их цель — создать ранний, всесторонний эталон.

Как исследователи тестировали детекторы

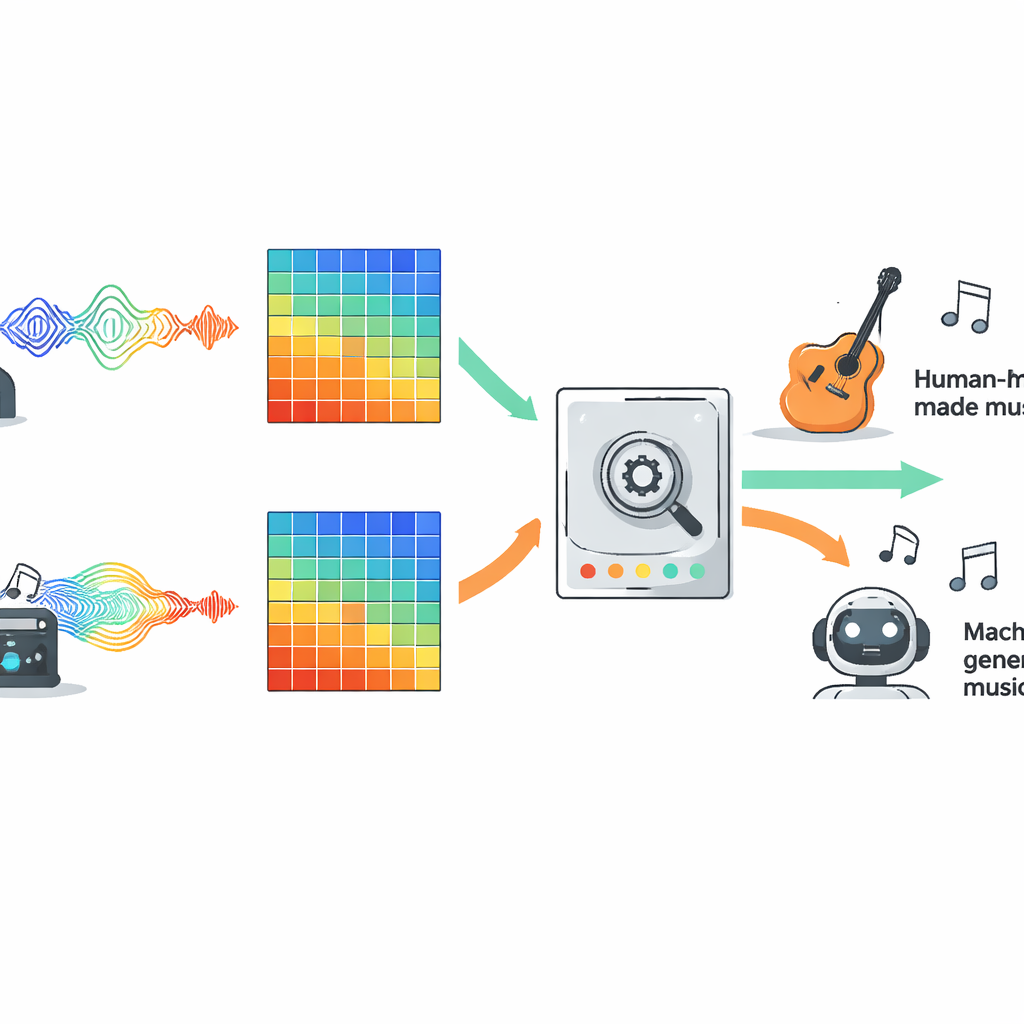

Чтобы честно сопоставить подходы, авторы оценили десять популярных типов моделей на большой открытой базе данных FakeMusicCaps, которая смешивает тысячи коротких фрагментов музыки, сочинённой людьми, с клипами, сгенерированными несколькими системами текст‑в‑музыку. Всё аудио было преобразовано в мел‑спектрограммы — визуальное представление звука, широко используемое в современной аудио‑ИИ — и каждая модель получила ровно одни и те же входные данные. В набор вошли традиционные методы машинного обучения, несколько семейств глубоких нейронных сетей, системы на базе Transformer и более новые модели состояния пространства, созданные для отслеживания длинных последовательностей во времени. Затем команда проверила обученные детекторы на втором, более сложном наборе M6, содержащем более длинные и разнообразные песни, чтобы понять, насколько хорошо модели обобщаются за пределы тренировочной среды.

Что лучше всего работало для разных типов музыки

На исходных данных FakeMusicCaps многие модели глубокого обучения показали высокую эффективность. Компактная архитектура MobileNet достигла наивысшей точности и F1‑метрики, продемонстрировав, что быстрые и лёгкие системы могут хорошо справляться, когда тестовый материал похож на тренировочный. Однако на более сложной, выходной за домен коллекции M6 производительность упала у всех моделей, что выявило хрупкость современных детекторов при встрече с новыми генераторами, жанрами или условиями записи. В более реалистичной среде классическая сверточная сеть ResNet18 обеспечила наилучший баланс между успехом в домене и устойчивостью вне домена, опередив более сложные варианты вроде Transformer и расширенных моделей последовательностей. Исследование также протестировало простую мультимодальную схему, которая сочетала аудиофичи с представлениями текста песен, и это слияние явно превзошло аудио‑только базовые модели там, где были доступны исполненные тексты.

Взгляд внутрь «чёрного ящика»

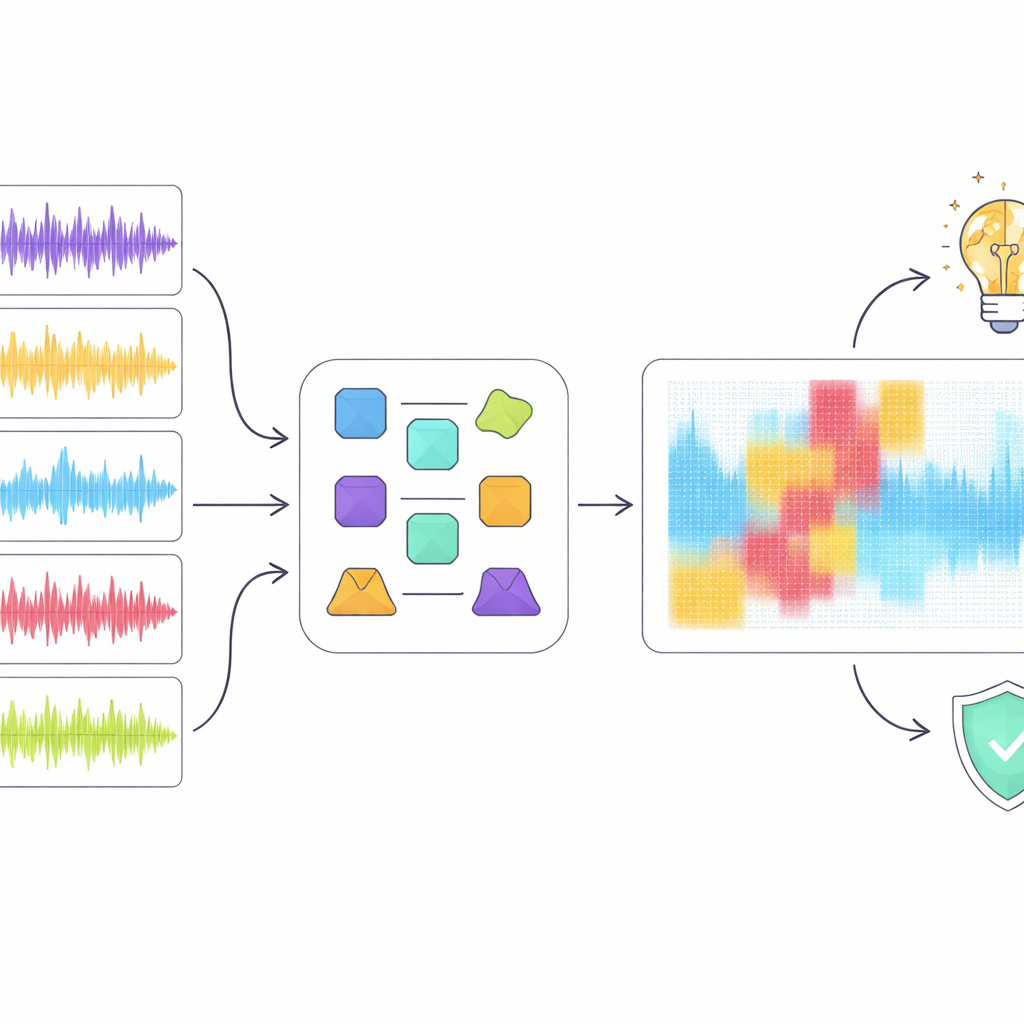

Высокие показатели сами по себе недостаточны, когда обнаружение может повлиять на карьеры и авторские права, поэтому авторы обратились к инструментам объяснимого ИИ, чтобы исследовать, как лучшая модель, ResNet18, приходила к своим решениям. Они применили несколько популярных методов объяснений, которые выделяют области спектрограммы, наиболее важные для классификации клипа как человеческого или машинного. Вместо доверия одному приёму они предложили «ансамблевый» подход, который ищет регионы, в которых несколько методов сходятся во мнении о важности. Когда они цифровым образом удаляли только эти перекрывающиеся области из представления аудио, производительность обнаружения резко падала, хотя замаскированная часть спектрограммы была относительно невелика. Это указывает на то, что консенсус действительно выделяет критически важные акустические паттерны, а не случайный шум.

Что это говорит о музыке и машинах

Анализ объяснимости выявил разрыв между тем, как модель «слушает», и тем, как люди воспринимают музыку. Например, детектор порой рассматривал короткие музыкальные паузы как подозрительные артефакты, а не как естественную структуру, штрафуя фрагменты, которые человеческие слушатели сочли бы хорошо сформированными. В целом модель, похоже, опиралась больше на низкоуровневые спектральные особенности, чем на высокоуровневые музыкальные идеи — ритм, мелодию и форму. Авторы утверждают, что будущие детекторы должны включать более богатые музыкально‑осведомлённые признаки и лучше использовать тексты песен, стремясь к решениям, которые больше соотносятся с музыкальным пониманием, а не только с поверхностными паттернами.

Где сейчас находятся ИИ и музыка

Эта работа даёт один из первых широких и прозрачных эталонов для обнаружения музыки, сгенерированной ИИ, и для объяснения работы таких детекторов. Она показывает, что нынешние системы часто могут правильно отмечать фейковые треки в контролируемых условиях, но испытывают трудности, когда музыка поступает из новых источников, и что им пока не хватает понимания музыкальной структуры на уровне человека. Авторы предлагают создавать детекторы следующего поколения, которые объединят акустические сигналы, смысл текстов, концепции музыкальной теории и методы объяснимости в единую конвейерную систему. При успешной реализации такие инструменты могли бы помочь стриминговым сервисам, владельцам прав и слушателям ориентироваться в будущем, где музыка, созданная людьми и машинами, сосуществует более справедливо и прозрачно.

Цитирование: Li, Y., Sun, Q., Li, H. et al. Explainable detection of machine generated music and early systematic evaluation. Sci Rep 16, 13757 (2026). https://doi.org/10.1038/s41598-026-42133-7

Ключевые слова: музыка, сгенерированная ИИ, обнаружение фейкового аудио, аутентичность музыки, объяснимый ИИ, мультимодальные модели