Clear Sky Science · nl

Verklaarbare detectie van door machines gemaakte muziek en vroege systematische evaluatie

Waarom dit belangrijk is voor muziekliefhebbers en makers

Kunstmatige intelligentie kan nu in seconden overtuigende liedjes componeren. Dat is opwindend voor creativiteit maar verontrustend voor muzikanten, platenmaatschappijen en luisteraars die waarde hechten aan originaliteit en eerlijke erkenning. Deze studie stelt een eenvoudige maar urgente vraag: kunnen we betrouwbaar vaststellen of een muziekstuk door een mens of door een machine is gemaakt, en kunnen we begrijpen hoe deze detectiesystemen hun beslissingen nemen?

De uitdaging van het herkennen van door AI gemaakte nummers

Door machines gegenereerde muziek wordt al gebruikt voor achtergrondmuziek, hulp bij songwriting en zelfs therapie. Tegelijkertijd kunnen dezelfde tools streamingplatforms overspoelen met weinig inspanning gemaakte nummers, auteurschap vervagen en de waarde van door mensen gemaakte composities aantasten. Eerder onderzoek naar het detecteren van nep-audio richtte zich vooral op spraak of op enge muzikale gevallen, en steunde vaak op niet-gepubliceerde modellen of eenmalige tests. De auteurs stellen dat het vakgebied een duidelijke, systematische vergelijking van methoden mist, vooral een die ook uitlegt waarom een detector een nummer echt of nep noemt. Hun doel is om die vroege, uitgebreide benchmark te bouwen.

Hoe de onderzoekers de detectors testten

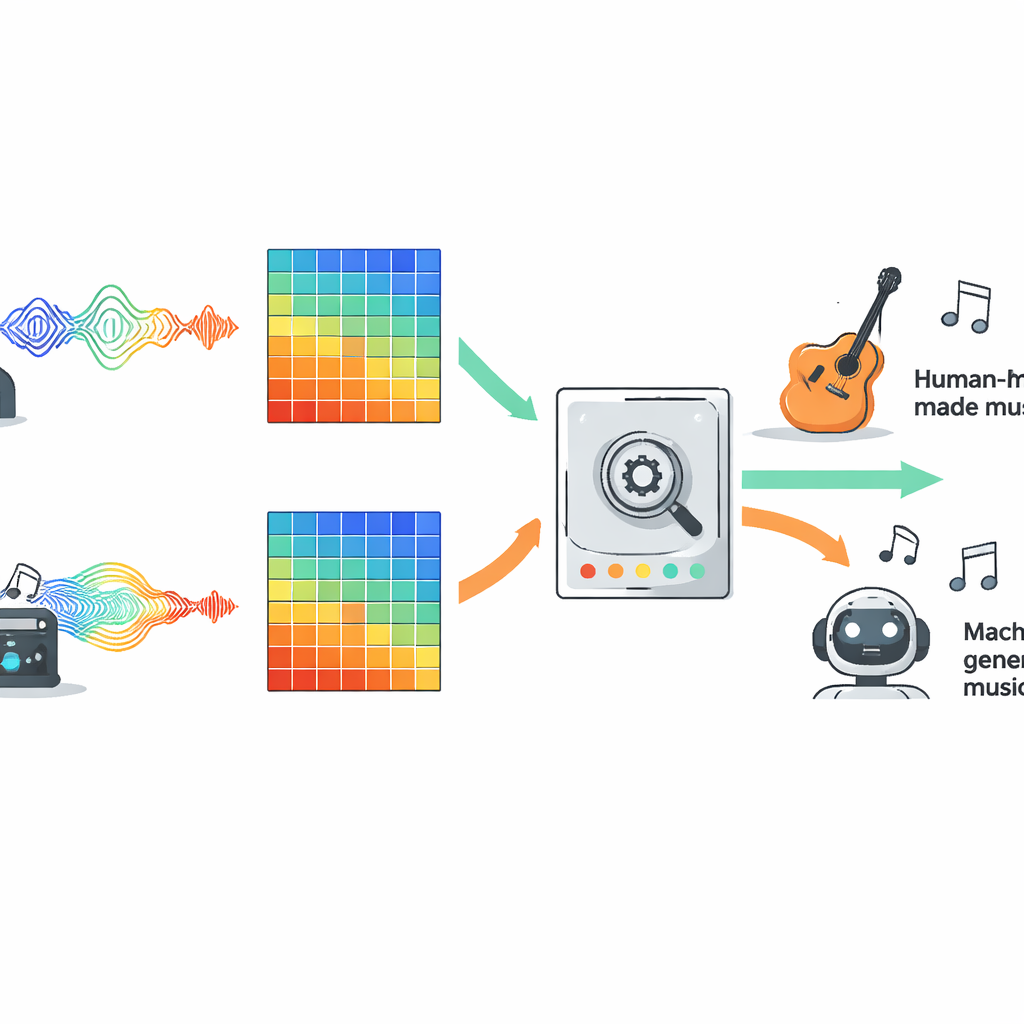

Om concurrerende benaderingen eerlijk te vergelijken, evalueerden de auteurs tien populaire modeltypen op een grote open dataset genaamd FakeMusicCaps, die duizenden korte fragmenten van door mensen gecomponeerde muziek mengt met fragmenten gegenereerd door verschillende text-to-music systemen. Alle audio werd omgezet in Mel-spectrogrammen, een visuele representatie van geluid die veel gebruikt wordt in moderne audio-AI, en elk model zag precies dezelfde invoer. De line-up omvatte traditionele machine learning, meerdere families van diepe neurale netwerken, op Transformers gebaseerde systemen en nieuwere state-space modellen die ontworpen zijn om lange sequenties in de tijd te volgen. Het team zette de getrainde detectors vervolgens in op een tweede, zwaardere dataset genaamd M6, met langere en meer gevarieerde nummers, om te zien hoe goed ze generaliseerden buiten hun trainingsomgeving.

Wat het beste werkte voor verschillende soorten muziek

Op de originele FakeMusicCaps-data presteerden veel deep learning-modellen sterk. Een compacte architectuur genaamd MobileNet behaalde de hoogste nauwkeurigheid en F1-score, wat laat zien dat snelle en lichte systemen goed kunnen presteren wanneer het testmateriaal sterk lijkt op de trainingsset. Op de moeilijkere, out-of-domain M6-collectie daalde de prestatie echter voor alle modellen, wat aantoont hoe broos huidige detectors kunnen zijn bij nieuwe generators, genres of opnamecondities. In deze realistischer toets leverde een klassiek convolutioneel netwerk bekend als ResNet18 de beste balans tussen succes binnen de domein en robuustheid buiten het domein, en versloeg daarmee complexere opties zoals Transformers en uitgebreide sequentiemodellen. De studie testte ook een eenvoudige multimodale opzet die audiofuncties combineerde met representaties van de songteksten, en deze fusie overtrof duidelijk audio-only baselines wanneer gezongen tekst beschikbaar was.

In de zwarte doos kijken

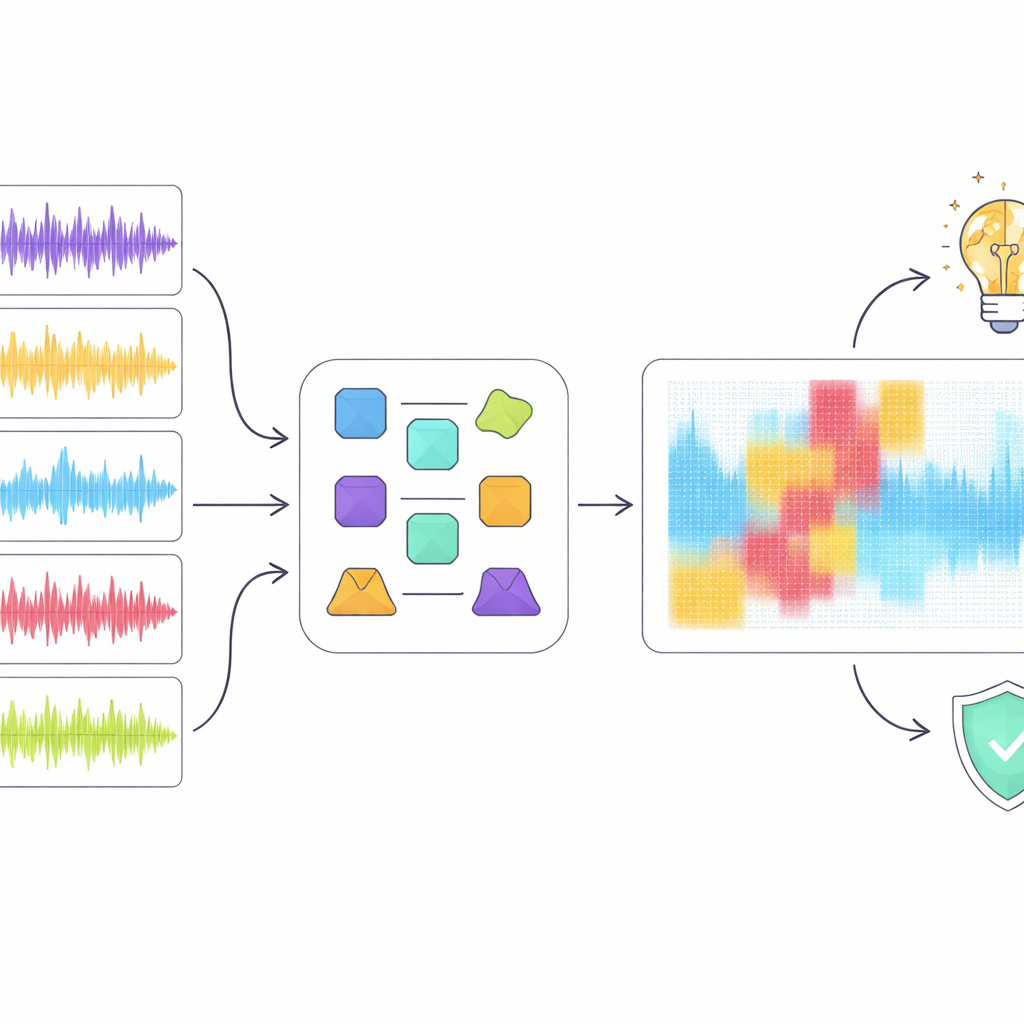

Hoge scores alleen zijn niet genoeg wanneer detectie carrières en auteursrechten kan beïnvloeden, dus richtten de auteurs zich op verklaarbare AI-tools om te onderzoeken hoe het beste model, ResNet18, tot zijn beslissingen kwam. Ze pasten verschillende populaire verklaringsmethoden toe die benadrukken welke gebieden van een spectrogram het belangrijkst waren voor het classificeren van een fragment als mens- of machinegemaakt. In plaats van op één techniek te vertrouwen, introduceerden ze een “ensemble”-benadering die zoekt naar gebieden waarvan meerdere methoden het eens zijn dat ze belangrijk zijn. Toen ze deze overlappende gebieden digitaal uit de audiorepresentatie verwijderden, daalde de detectieprestatie scherp, ondanks dat een relatief klein deel van het spectrogram werd gemaskeerd. Dit suggereert dat de consensus daadwerkelijk kritische akoestische patronen belicht in plaats van willekeurige ruis.

Wat dit onthult over muziek en machines

De verklaarbaarheidsanalyse bracht een kloof aan het licht tussen hoe het model “luistert” en hoe mensen muziek horen. Zo behandelde de detector soms korte muzikale pauzes als verdachte artefacten in plaats van als natuurlijke structuur, waardoor fragmenten werden bestraft die menselijke luisteraars als goed opgebouwd zouden beschouwen. Over het geheel leek het model meer te vertrouwen op laag-niveau spectrale eigenaardigheden dan op hoog-niveau muzikale ideeën zoals ritme, melodie en vorm. De auteurs stellen dat toekomstige detectors rijkere muziek-bewuste kenmerken en beter gebruik van songteksten moeten integreren, met het doel beslissingen te nemen die meer in lijn zijn met muzikale begrip in plaats van alleen oppervlaktpatronen.

Waar dit AI en muziek vandaag de dag achterlaat

Dit werk levert een van de eerste brede, transparante meetlatten voor het detecteren van AI-gegenereerde muziek en voor het verklaren hoe zulke detectors werken. Het toont aan dat huidige systemen in gecontroleerde omstandigheden vaak nep-nummers correct kunnen signaleren, maar moeite hebben wanneer muziek uit nieuwe bronnen komt, en dat ze muzikale structuur nog niet op dezelfde manier begrijpen als mensen. De auteurs stellen voor om next-generation detectors te bouwen die akoestische aanwijzingen, betekenis van songteksten, concepten uit muziektheorie en verklaarbare methoden samenvoegen in één pijplijn. Als dat lukt, kunnen dergelijke hulpmiddelen streamingdiensten, rechthebbenden en luisteraars helpen navigeren in een toekomst waar door mensen en door machines gemaakte muziek eerlijker en transparanter naast elkaar bestaat.

Bronvermelding: Li, Y., Sun, Q., Li, H. et al. Explainable detection of machine generated music and early systematic evaluation. Sci Rep 16, 13757 (2026). https://doi.org/10.1038/s41598-026-42133-7

Trefwoorden: AI-gegenereerde muziek, deepfake-audio detectie, muziekauthenticiteit, verklaarbare AI, multimodale modellen