Clear Sky Science · pt

Compreendendo os efeitos dos dados de pré-treinamento em modelos fundamentais da retina usando duas grandes coortes de fundoscopia

Por que exames oculares e dados de treinamento de IA importam

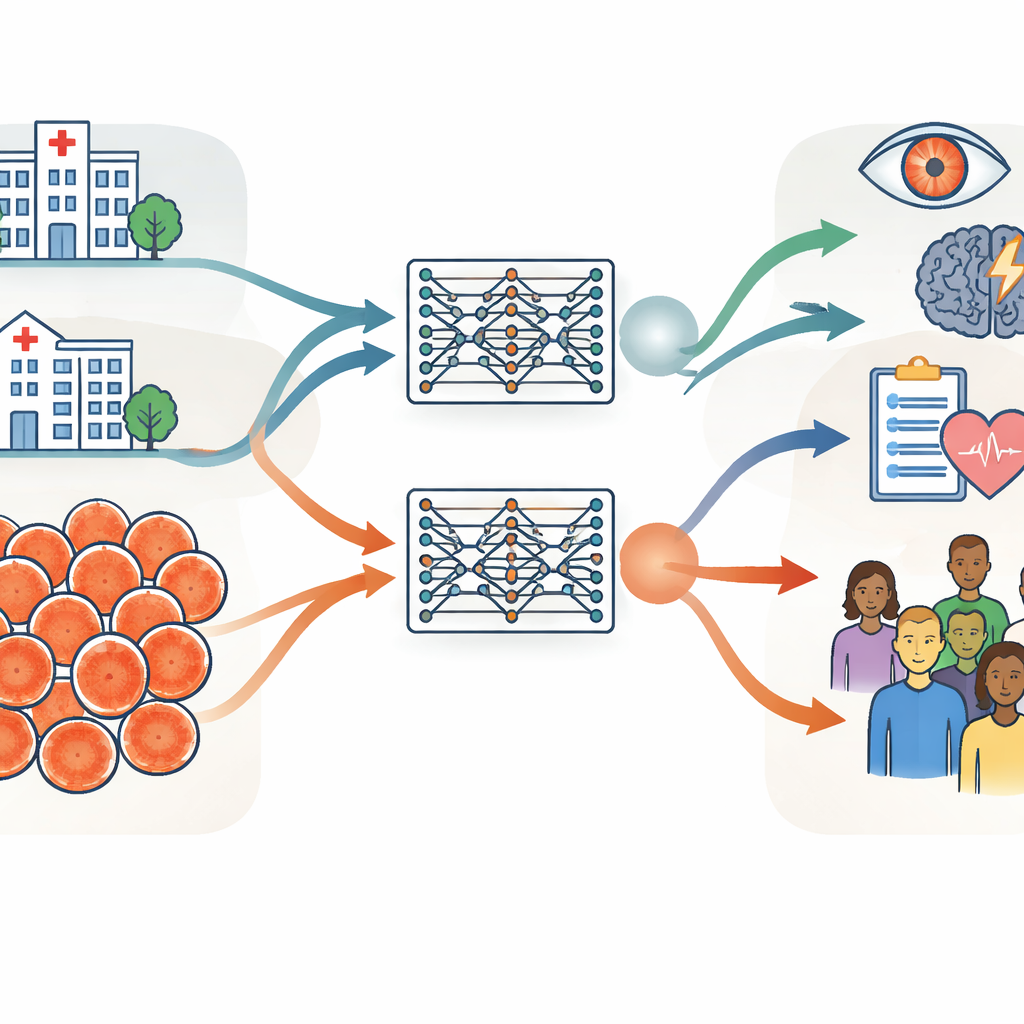

Exames oculares estão sendo usados cada vez mais não apenas para detectar doenças oculares, mas também para revelar pistas sobre nossa saúde geral, desde diabetes até risco de AVC. Sistemas poderosos de inteligência artificial chamados modelos fundamentais podem aprender com milhões dessas imagens e então ser adaptados para diversas tarefas médicas. Este estudo faz uma pergunta simples, porém importante: o tipo de dado que usamos para treinar esses modelos — quem são os pacientes, de onde vêm e como suas imagens aparecem — altera o desempenho e a equidade desses modelos?

Duvas enormes coleções de imagens oculares em continentes diferentes

Os pesquisadores basearam a investigação em duas coleções muito grandes de fotografias retinianas, cada uma contendo cerca de 900.000 imagens. Uma veio do Moorfields Eye Hospital, no Reino Unido, um hospital especializado onde os pacientes tendem a ser mais velhos e a apresentar mais doenças oculares. A outra veio do Shanghai Diabetes Prevention Program, na China, um programa de triagem comunitária com adultos mais jovens e, em sua maioria, saudáveis. Além da idade e do estado de saúde, os grupos diferiam em equilíbrio de sexo, composição étnica e nos dispositivos de câmera usados para capturar as imagens. A equipe mediu cuidadosamente essas diferenças usando informações básicas como idade e sexo, características de imagem extraídas por computador e medidas clinicamente relevantes dos vasos sanguíneos e do nervo óptico na parte posterior do olho.

Treinando modelos gêmeos de IA para testar desempenho geral

Usando procedimentos de treinamento idênticos, o grupo criou dois modelos fundamentais retinianos “gêmeos”: um treinado apenas com as imagens do hospital do Reino Unido e outro apenas com as imagens do programa de triagem chinês. Ambos os modelos aprenderam de forma autônoma a partir de exames não rotulados e depois foram adaptados para tarefas específicas, como detectar doença ocular diabética e prever risco de AVC. O teste-chave foi verificar se um modelo treinado em um contexto ainda poderia ter bom desempenho quando aplicado a dados do outro contexto ou a conjuntos públicos coletados em vários outros países. Na maioria das tarefas e conjuntos de dados, os dois modelos apresentaram desempenho semelhante, mesmo quando avaliados em imagens bastante diferentes daquelas que haviam visto antes. Isso sugere que modelos fundamentais retinianos, uma vez treinados com dados suficientes, podem generalizar bem entre hospitais, países e tipos de câmera.

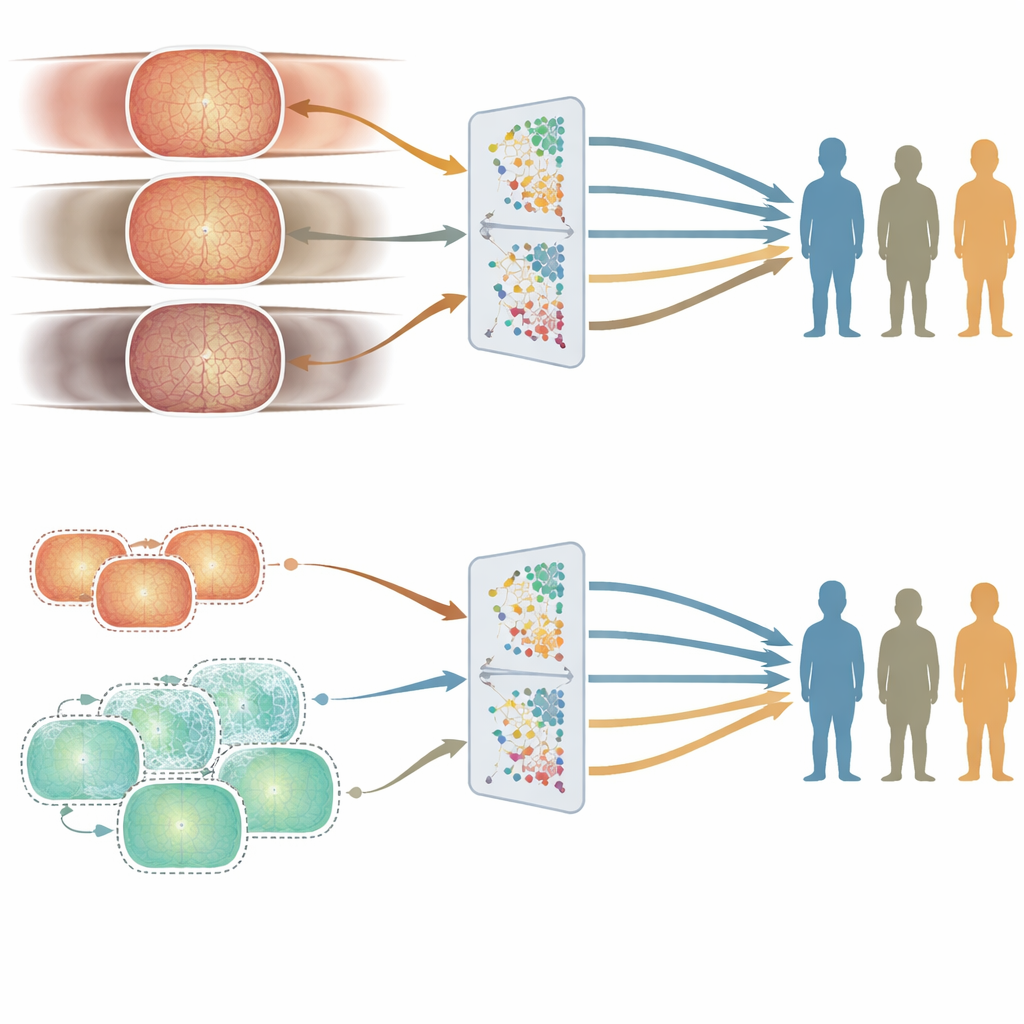

Onde surgem falhas de equidade: idade versus sexo e etnia

Boa acurácia média não é suficiente se um sistema funciona melhor para algumas pessoas do que para outras. Para investigar a equidade, os autores compararam o desempenho dos dois modelos em diferentes subgrupos por idade, sexo e etnia usando um conjunto de teste cuidadosamente selecionado. A idade mostrou-se o fator mais relevante. O modelo treinado no Reino Unido, construído a partir de pacientes mais velhos, tende a ter desempenho melhor em faixas etárias mais altas, enquanto o modelo treinado na China, construído a partir de adultos mais jovens, teve desempenho superior em pessoas mais jovens. Essas lacunas apareceram de forma consistente em várias tarefas relacionadas a doenças oculares. Em contraste, as diferenças de desempenho entre homens e mulheres, ou entre os principais grupos étnicos, foram menores e menos consistentes, e não acompanharam de forma simples a representação desses grupos nos dados de treinamento.

Como o próprio olho muda com a idade

Para entender por que a idade teve um efeito tão forte, a equipe examinou como a aparência da retina variava com a idade nos conjuntos de treinamento. Eles investigaram tanto medidas clínicas — como a complexidade e o ramo dos vasos sanguíneos — quanto características abstratas que os próprios modelos de IA extraem das imagens. As faixas etárias mostraram diferenças claras e estatisticamente significativas em ambos os tipos de medidas, mesmo após controle por sexo e etnia. Em outras palavras, a estrutura da retina realmente muda com a idade de uma forma que os modelos conseguem detectar. Por causa disso, um modelo fortemente treinado em uma faixa etária pode ficar mais sintonizado com aquele grupo, levando a lacunas sutis, porém importantes, na equidade.

Usando imagens sintéticas para nivelar o campo

Para verificar se poderiam reduzir essas diferenças relacionadas à idade, os pesquisadores geraram centenas de milhares de imagens retinianas sintéticas projetadas para se assemelhar a pacientes mais jovens. Eles misturaram essas imagens com imagens reais do hospital para criar um conjunto de treinamento mais balanceado por idade e então treinaram um novo modelo. O desempenho geral permaneceu semelhante, mas a acurácia para pessoas mais jovens melhorou em algumas tarefas, reduzindo a desigualdade entre faixas etárias. Esse experimento sugere que adicionar dados sintéticos de forma cuidadosa pode ajudar a mitigar pontos cegos em IA médica sem a necessidade de coletar uma quantidade muito maior de imagens do mundo real.

O que isso significa para o futuro da IA médica

O estudo mostra que a “dieta” de dados fornecida a sistemas de IA médica molda fortemente não apenas o quão poderosos eles são, mas também quem mais se beneficia deles. Modelos fundamentais retinianos podem funcionar de forma robusta entre países e dispositivos, o que é encorajador para uso global. Ao mesmo tempo, o trabalho revela que certos atributos dos dados — neste caso, idade — têm impacto maior na equidade do que outros. Para pacientes e clínicos, a mensagem é que transparência sobre os dados de treinamento e o balanceamento deliberado de características-chave são essenciais se quisermos ferramentas de IA que atendam pessoas de todas as idades de forma equitativa.

Citação: Zhou, Y., Wang, Z., Wu, Y. et al. Understanding pre-training data effects in retinal foundation models using two large fundus cohorts. Nat Commun 17, 3309 (2026). https://doi.org/10.1038/s41467-026-70077-z

Palavras-chave: imagem retiniana, equidade em IA médica, modelos fundamentais, dados de pré-treinamento, retinopatia diabética