Clear Sky Science · es

Comprender los efectos de los datos de preentrenamiento en modelos fundacionales retinianos mediante dos grandes cohortes de fondo de ojo

Por qué importan los escáneres oculares y los datos de entrenamiento de la IA

Los escáneres oculares se usan cada vez más no solo para detectar enfermedades oculares, sino también para revelar pistas sobre nuestra salud general, desde la diabetes hasta el riesgo de ictus. Potentes sistemas de inteligencia artificial llamados modelos fundacionales pueden aprender a partir de millones de estas imágenes y luego adaptarse a múltiples tareas médicas. Este estudio plantea una pregunta simple pero importante: ¿el tipo de datos que usamos para entrenar estos modelos —quiénes son los pacientes, de dónde proceden y cómo se ven sus exploraciones— cambia la eficacia y la equidad de los modelos?

Dos enormes colecciones de imágenes oculares en continentes distintos

Los investigadores basaron su estudio en dos colecciones muy grandes de fotografías retinianas, cada una con alrededor de 900.000 imágenes. Una procedía del Moorfields Eye Hospital en el Reino Unido, un hospital especializado donde los pacientes tienden a ser mayores y presentan más enfermedad ocular. La otra venía del Shanghai Diabetes Prevention Program en China, un programa de cribado comunitario con adultos más jóvenes y, en su mayoría, sanos. Más allá de la edad y el estado de salud, los grupos diferían en equilibrio por sexo, composición étnica y los dispositivos de cámara usados para capturar las imágenes. El equipo cuantificó cuidadosamente estas diferencias usando información básica como edad y sexo, características extraídas por computadora y medidas clínicamente relevantes de los vasos sanguíneos y del nervio óptico en la parte posterior del ojo.

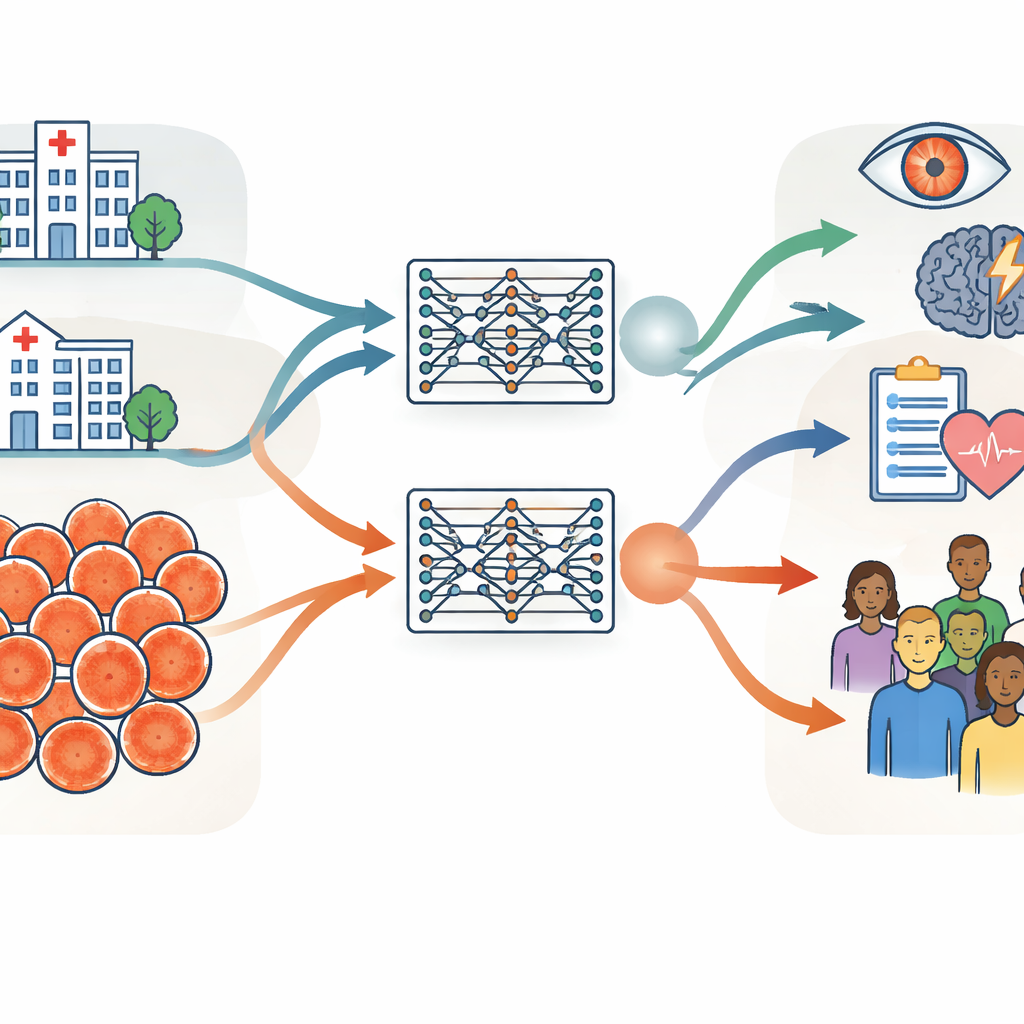

Entrenar modelos gemelos de IA para probar el rendimiento general

Usando procedimientos de entrenamiento idénticos, el grupo creó dos modelos fundacionales retinianos “gemelos”: uno entrenado solo con las imágenes del hospital del Reino Unido y otro solo con las imágenes del programa de cribado de China. Ambos modelos aprendieron de forma autodirigida a partir de exploraciones no etiquetadas y luego se adaptaron a tareas específicas como detectar enfermedad ocular diabética y predecir riesgo de ictus. La prueba clave fue si un modelo entrenado en un entorno podía seguir rindiendo bien cuando se aplicaba a datos del otro entorno o a conjuntos de datos públicos recogidos en varios países. En la mayoría de tareas y conjuntos de datos, los dos modelos rindieron de forma similar, incluso cuando se evaluaron imágenes bastante distintas de las vistas durante el entrenamiento. Esto sugiere que los modelos fundacionales retinianos, una vez entrenados con suficientes datos, pueden generalizar bien entre hospitales, países y tipos de cámaras.

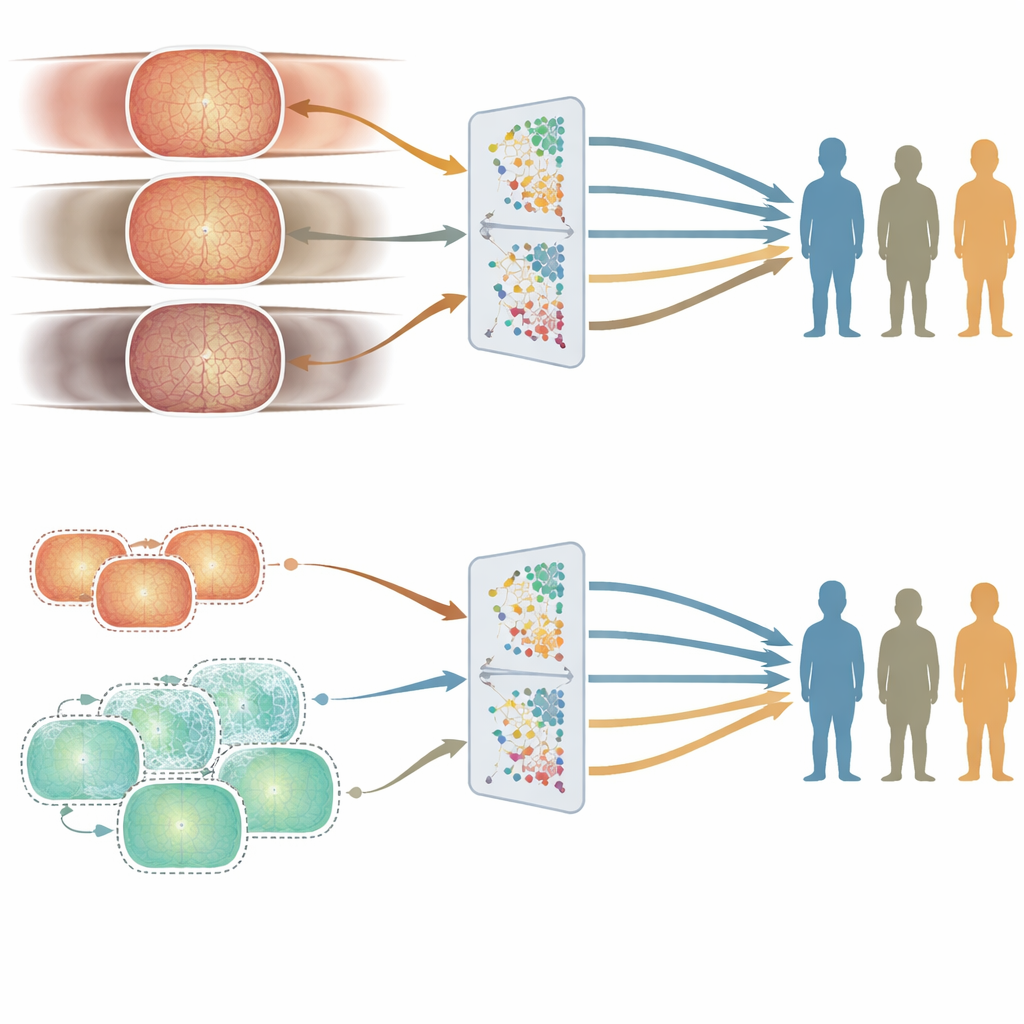

Dónde aparecen grietas en la equidad: edad frente a sexo y etnia

Una buena precisión media no basta si un sistema funciona mejor para algunas personas que para otras. Para investigar la equidad, los autores compararon el rendimiento de los dos modelos en distintos subgrupos por edad, sexo y etnia usando un conjunto de prueba cuidadosamente seleccionado. La edad resultó ser el factor más importante. El modelo entrenado en el Reino Unido, formado con pacientes mayores, tendía a funcionar mejor en grupos de mayor edad, mientras que el modelo entrenado en China, formado con adultos más jóvenes, funcionaba mejor en personas jóvenes. Estas diferencias aparecieron de forma consistente en varias tareas relacionadas con enfermedades oculares. En contraste, las diferencias de rendimiento entre hombres y mujeres, o entre los principales grupos étnicos, fueron menores y menos consistentes, y no se correlacionaron de manera simple con cómo estaban representados esos grupos en los datos de entrenamiento.

Cambios en el propio ojo con la edad

Para entender por qué la edad tenía un efecto tan marcado, el equipo examinó cómo variaba la apariencia de la retina con la edad en los conjuntos de entrenamiento. Analizaron tanto medidas clínicas —como la complejidad y el ramaje de los vasos sanguíneos— como características abstractas que los propios modelos de IA extraen de las imágenes. Los grupos de edad mostraron diferencias claras y estadísticamente significativas en ambos tipos de medidas, incluso tras controlar por sexo y etnia. En otras palabras, la estructura de la retina cambia realmente con la edad de una forma que los modelos pueden detectar. Por ello, un modelo entrenado en exceso en un rango de edad concreto puede volverse más afinado para ese grupo, generando brechas de equidad sutiles pero importantes.

Usar imágenes sintéticas para igualar el terreno

Para comprobar si podían reducir estas brechas relacionadas con la edad, los investigadores generaron cientos de miles de imágenes retinianas sintéticas diseñadas para parecerse a pacientes más jóvenes. Las mezclaron con imágenes hospitalarias reales para crear un conjunto de entrenamiento con mejor equilibrio de edad y entrenaron un nuevo modelo. El rendimiento global se mantuvo similar, pero la precisión para personas más jóvenes mejoró en algunas tareas, reduciendo la desigualdad entre grupos de edad. Este experimento sugiere que añadir datos sintéticos con cuidado puede ayudar a suavizar puntos ciegos en la IA médica sin necesidad de recopilar muchos más datos reales.

Qué significa esto para la IA médica futura

El estudio muestra que la “dieta” de datos que se suministra a los sistemas de IA médica determina no solo cuán potentes son, sino también quién se beneficia más de ellos. Los modelos fundacionales retinianos pueden funcionar de manera robusta entre países y dispositivos, lo cual es alentador para su uso global. Al mismo tiempo, el trabajo revela que ciertos atributos de los datos —en este caso, la edad— tienen un impacto mayor en la equidad que otros. Para pacientes y clínicos, el mensaje es que la transparencia sobre los datos de entrenamiento y el equilibrio deliberado de características clave son esenciales si queremos herramientas de IA que sirvan de forma equitativa a personas de todas las edades.

Cita: Zhou, Y., Wang, Z., Wu, Y. et al. Understanding pre-training data effects in retinal foundation models using two large fundus cohorts. Nat Commun 17, 3309 (2026). https://doi.org/10.1038/s41467-026-70077-z

Palabras clave: imágenes retinianas, justicia en IA médica, modelos fundacionales, datos de preentrenamiento, retinopatía diabética