Clear Sky Science · pl

Obliczenia niepewności epistemicznej do wykrywania włamań z wyjaśnialnością i optymalizacją wielokryterialną przy użyciu AA-NLS i GRUSO-GRU

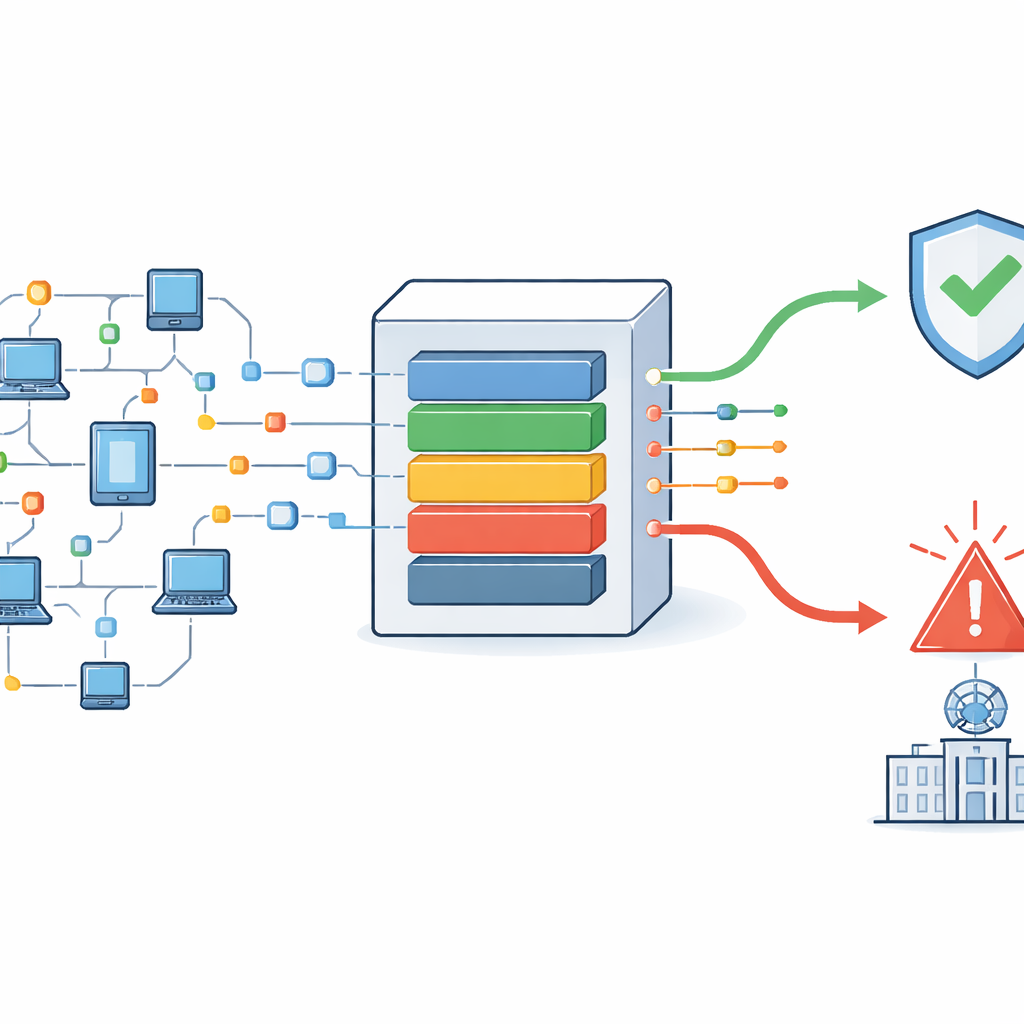

Dlaczego bezpieczny ruch internetowy ma znaczenie

Każdy e-mail, połączenie wideo czy inteligentne urządzenie korzysta z niewidocznych strumieni danych przepływających przez sieci. W tym ruchu ukrywają się próby włamań, kradzieży informacji lub zakłócania usług. Nowoczesne mechanizmy obronne próbują automatycznie wykrywać takie incydenty, lecz rzeczywiste dane sieciowe są chaotyczne: pakiety przychodzą z opóźnieniem, w złej kolejności albo z brakującymi fragmentami. W badaniu przedstawiono nowy system wykrywania włamań, który nie tylko radzi sobie z tą niepewnością, lecz także wyjaśnia swoje decyzje i priorytetyzuje najbardziej pilne alarmy dla zespołów bezpieczeństwa.

Chaotyczny ruch i ukryte zagrożenia

Tradycyjne narzędzia wykrywania włamań często zakładają, że dane sieciowe są czyste i uporządkowane, albo koncentrują się głównie na znanych wzorcach ataków. W praktyce ruch internetowy pełen jest luk, opóźnień i przestawionych pakietów. Te problemy mogą prowadzić do niebezpiecznych nieporozumień: atak może wyglądać normalnie, jeśli jego pakiety pojawią się z opóźnieniem, a nieszkodliwa aktywność może zostać oznaczona jako wroga. Autorzy nazywają tego typu „lukę w wiedzy” niepewnością epistemiczną. Twierdzą, że wiele istniejących systemów albo ją ignoruje, albo radzi sobie z nią jedynie w ograniczony sposób, co skutkuje fałszywymi alarmami, przeoczeniami zagrożeń i przeciążeniem kolejek alertów utrudniającym reakcję człowieka.

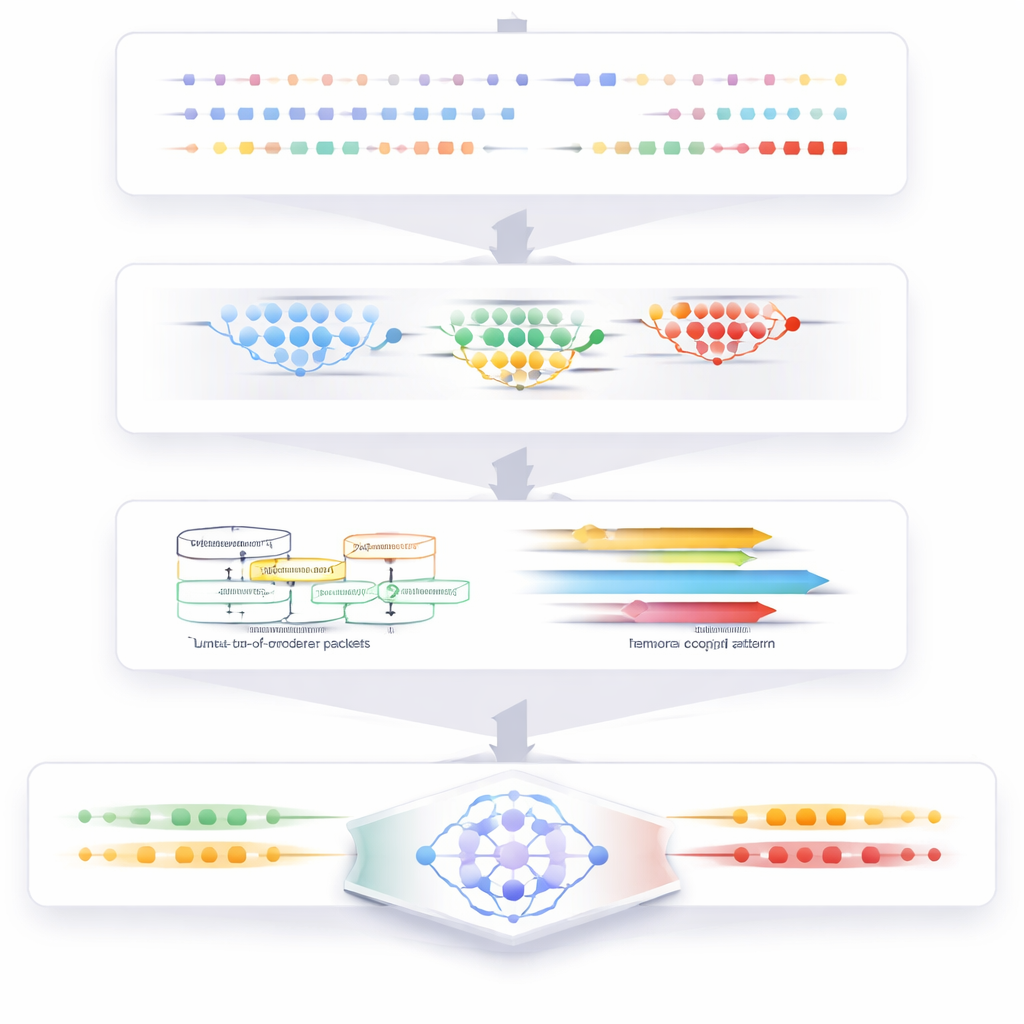

Budowa inteligentniejszego potoku wykrywania

Proponowany system obejmuje cały cykl monitorowania sieci — od surowego ruchu do końcowego alertu. Zaczyna od oczyszczenia danych: usuwane są duplikaty, a dopasowana metoda najbliższych sąsiadów uzupełnia brakujące wartości bez zniekształcania lokalnych wzorców. Następnie krok klasteryzacji grupuje podobne zachowania w ruchu, aby nietypowe lub rzadkie aktywności wyróżniały się wyraźniej. Z tych grup system wydobywa kluczowe cechy, takie jak częstotliwość wymiany pakietów, długość przepływów czy prędkość przesyłu danych w każdym kierunku. Te cechy dają skondensowany obraz zachowania sieci w danym momencie.

Rozumienie niepewności i czasu

Centralną innowacją pracy jest dedykowany moduł oceniający ryzyko wynikające z pakietów przychodzących w złej kolejności. Wykorzystując rozszerzone ramy logiczne, każdy pakiet traktowany jest jako posiadający stopnie „dowodu ataku”, „dowodu normalności” i „dowodu nieokreślonego”, które łączy się ostrożnie tak, by suma pozostawała spójna i sensowna. Równolegle model temporalny uczy się, jak stany sieci zmieniają się w czasie, wygładzając niemożliwe przejścia i chroniąc przed ślepymi punktami o zerowym prawdopodobieństwie. Razem te składniki uchwycają zarówno niepewność wprowadzaną przez opóźnienia pakietów, jak i ukryty rytm zachowań normalnych wobec anomalnych w sieci.

Nauka rozpoznawania ataków i ich wyjaśnianie

Wszystkie przetworzone informacje trafiają do spersonalizowanego klasyfikatora głębokiego uczenia opartego na warstwie typu gated recurrent unit. Autorzy przeprojektowali jego wewnętrzną strukturę i funkcje aktywacji tak, by uczył się szybciej, zbiegał bardziej niezawodnie i lepiej skalował niż powszechne modele rekurencyjne. Klasyfikator oznacza ruch jako nieszkodliwy lub jako jeden z kilku typów ataków, w tym odmowę usługi, brute force, botnet, infiltrację czy ataki webowe. Aby analitycy mogli ufać raportom systemu, moduł wyjaśniający następnie ocenia, jak mocno każda cecha wejściowa przyczyniła się do danej decyzji, stosując schemat ważenia oparty na informacji, który jest bardziej stabilny przy skośnych, rzeczywistych danych.

Skupianie uwagi na najbardziej pilnych zagrożeniach

W obciążonych sieciach nawet dobry detektor może zalewać operatorów większą liczbą alertów, niż są w stanie obsłużyć na czas. Aby temu zaradzić, ramy systemu dodają warstwę optymalizacji inspirowaną zachowaniem polującym pustynnych lisów. Ta warstwa traktuje alerty jako kandydatów do uszeregowania i poszukuje porządku, który maksymalizuje jakość wykrywania przy jednoczesnym minimalizowaniu opóźnień i wykorzystania zasobów. Specjalna funkcja matematyczna pomaga wyszukiwaniu wydostać się z niekorzystnych pośrednich rozwiązań. Eksperymenty na kilku publicznych zestawach danych dotyczących włamań pokazują, że ten krok priorytetyzacji zwiększa przepustowość i skraca czasy reakcji w porównaniu z innymi strategiami obsługi alertów.

Co wyniki oznaczają dla zwykłych użytkowników

Autorzy raportują, że ich zintegrowane podejście osiąga ponad 99% dokładności w wieloklasowym wykrywaniu włamań, oferując jednocześnie jaśniejsze wyjaśnienia i szybsze, lepiej uporządkowane alerty niż metody konkurencyjne. Dla osoby niebędącej specjalistą oznacza to bardziej niezawodny cyfrowy „układ odpornościowy”, który rzadziej fałszywie alarmuje i częściej wykrywa subtelne ataki, nawet gdy dane są niekompletne lub mylące. Choć metoda sama w sobie nie szyfruje ani nie chroni zawartości danych użytkowników, znacząco wzmacnia kluczową warstwę obronną w nowoczesnych sieciach. Przy dalszych pracach nad ochroną end-to-end podejścia tego typu mogą przyczynić się do płynniejszego, bezpieczniejszego i bardziej godnego zaufania działania usług online dla wszystkich.

Cytowanie: Kiruthika, K., Karpagam, M., Sardar, T.H. et al. Epistemic uncertain computing for intrusion detection with explainability & multi-criteria optimization using AA-NLS and GRUSO-GRU. Sci Rep 16, 14050 (2026). https://doi.org/10.1038/s41598-026-44214-z

Słowa kluczowe: wykrywanie włamań, bezpieczeństwo sieci, niepewność, wyjaśnialna sztuczna inteligencja, alarmy o cyberatakach