Clear Sky Science · es

Computación epistemicamente incierta para detección de intrusiones con explicabilidad y optimización multicriterio usando AA-NLS y GRUSO-GRU

Por qué importa un tráfico de internet más seguro

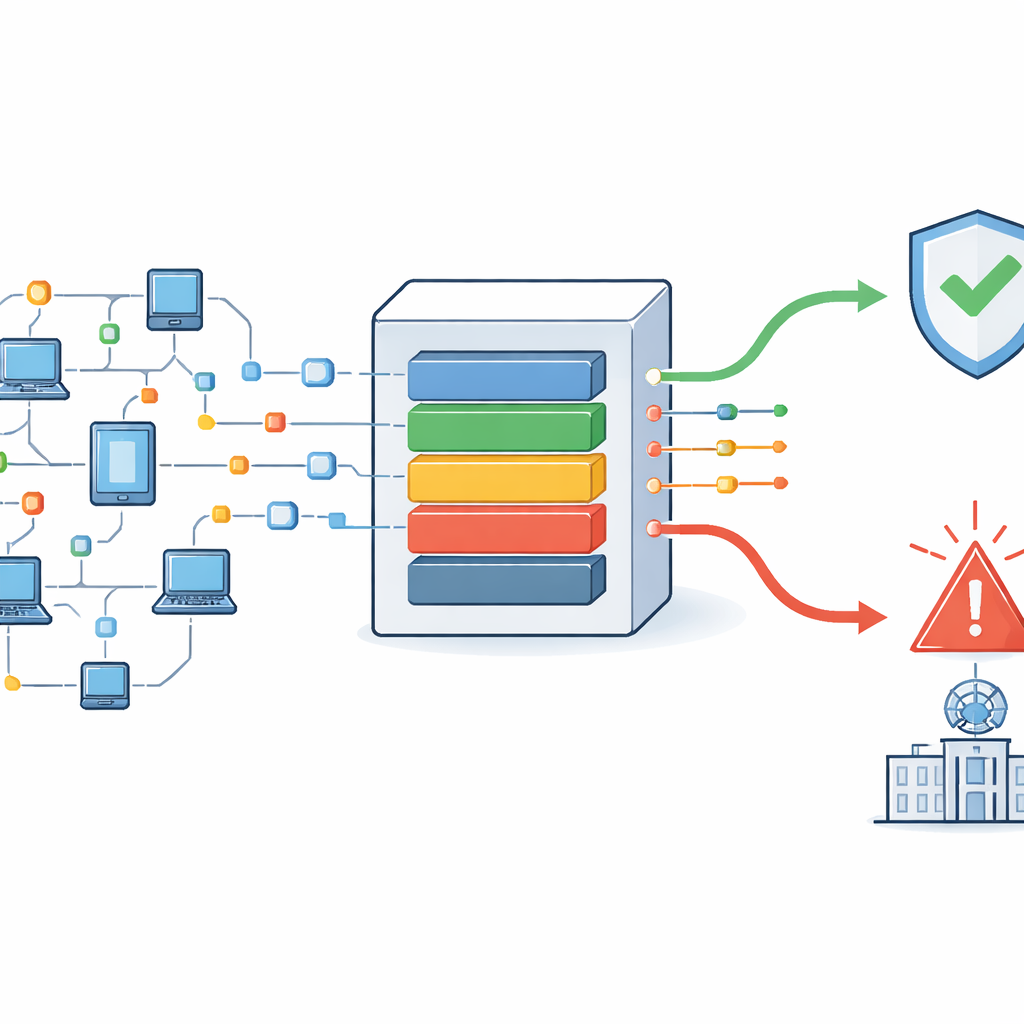

Cada correo que envías, llamada por vídeo que realizas o dispositivo inteligente que usas depende de corrientes invisibles de datos que recorren las redes. Ocultas en ese tráfico hay intentos de atacantes por infiltrarse, robar información o interrumpir servicios. Las defensas modernas intentan detectar automáticamente estas intrusiones, pero los datos reales de red son desordenados: los paquetes llegan tarde, fuera de orden o con fragmentos faltantes. Este estudio presenta un nuevo marco de detección de intrusiones que no solo afronta esa incertidumbre, sino que además explica sus decisiones y prioriza las alertas más urgentes para los equipos de seguridad.

Tráfico desordenado y peligros ocultos

Las herramientas tradicionales de detección de intrusiones suelen asumir que los datos de red son limpios y están ordenados, o se centran principalmente en patrones de ataque conocidos. En la práctica, el tráfico de internet está lleno de huecos, retrasos y paquetes reordenados. Estos problemas pueden causar confusión peligrosa: un ataque puede parecer normal si sus paquetes llegan tarde, o una actividad inofensiva puede señalarse como hostil. Los autores denominan a este tipo de "brecha de conocimiento" incertidumbre epistémica. Sostienen que muchos sistemas existentes la ignoran o la tratan de forma limitada, lo que conduce a falsas alarmas, amenazas pasadas por alto y colas de alertas abrumadoras que ralentizan la respuesta humana.

Construyendo una canalización de detección más inteligente

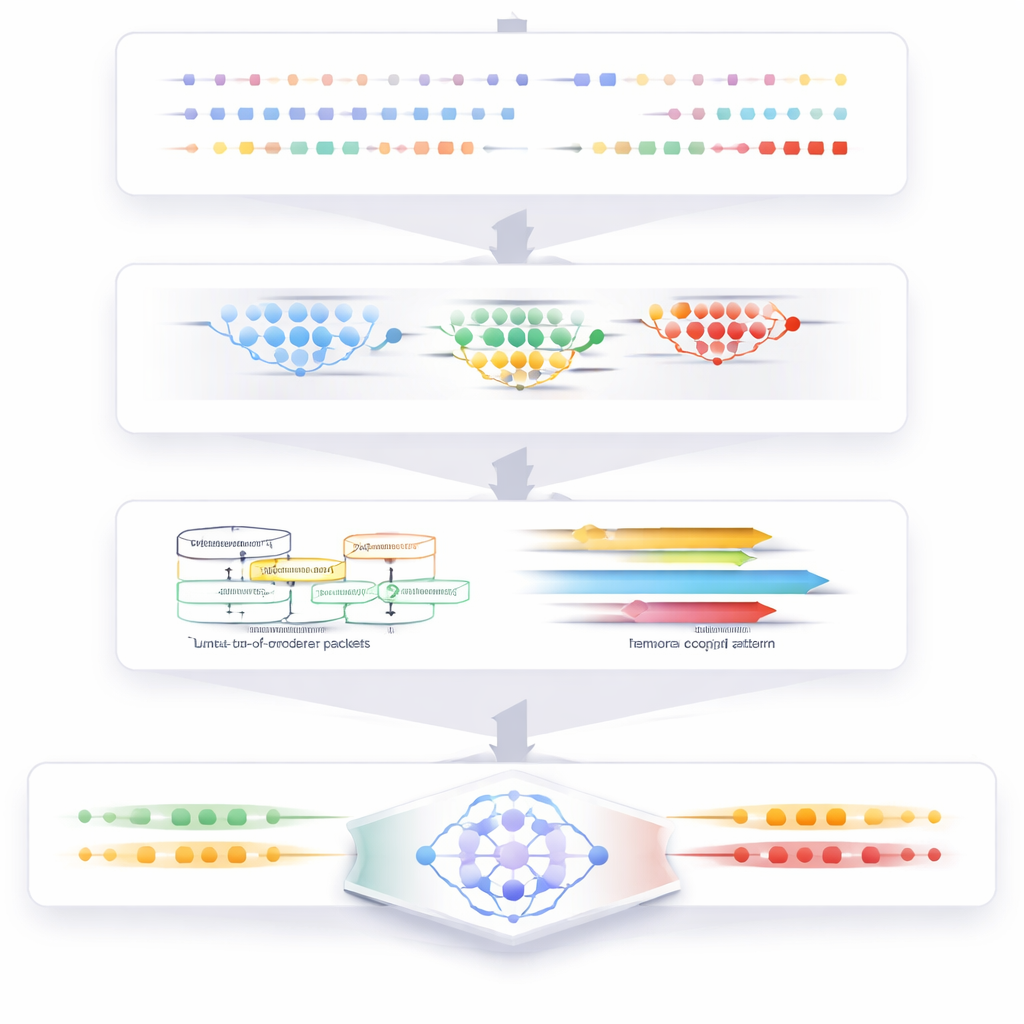

El sistema propuesto aborda todo el ciclo de vida del monitoreo de red, desde el tráfico bruto hasta la alerta final. Comienza limpiando los datos: se eliminan registros duplicados y un método de vecinos más cercanos adaptado rellena los valores faltantes sin distorsionar los patrones locales. A continuación, un paso de agrupamiento (clustering) reúne comportamientos similares en el tráfico para que las actividades inusuales o raras destaquen con más claridad. A partir de estos grupos, el sistema extrae características clave, como la frecuencia de intercambio de paquetes, la duración de los flujos y la rapidez del movimiento de datos en cada dirección. Estas características ofrecen una imagen compacta de cómo se comporta la red en cada momento.

Entender la incertidumbre y la sincronización

Una innovación central del trabajo es un módulo dedicado a evaluar el riesgo que generan los paquetes fuera de orden. Usando un marco lógico extendido, cada paquete se trata como portador de grados de "evidencia de ataque", "evidencia de normalidad" y "evidencia indeterminada", que se combinan cuidadosamente para que el total siga siendo consistente y significativo. En paralelo, un modelo temporal aprende cómo evolucionan los estados de la red en el tiempo, suavizando transiciones imposibles y protegiendo contra puntos ciegos de probabilidad cero. En conjunto, estos componentes capturan tanto la incertidumbre introducida por los retrasos de paquetes como el ritmo oculto del comportamiento normal frente al anormal en la red.

Aprender a detectar ataques y explicarlos

Toda esta información procesada alimenta un clasificador de aprendizaje profundo personalizado basado en una unidad recurrente con compuertas (GRU). Los autores rediseñan su arquitectura interna y sus funciones de activación para que aprenda más rápido, converja con mayor fiabilidad y escale mejor que los modelos recurrentes habituales. El clasificador etiqueta el tráfico como benigno o como uno de varios tipos de ataque, incluidos denegación de servicio, fuerza bruta, botnet, infiltración y ataques web. Para ayudar a los analistas a confiar en lo que informa el sistema, un módulo de explicación estima a qué intensidad contribuyó cada característica de entrada a una decisión dada, usando un esquema de ponderación basado en la información que resulta más estable en datos reales sesgados.

Concentrar la atención en las amenazas más urgentes

En redes muy activas, incluso un detector potente puede inundar a los operadores con más alertas de las que pueden gestionar a tiempo. Para abordar esto, el marco añade una capa de optimización inspirada en el comportamiento de caza de los zorros del desierto. Esta capa trata las alertas como candidatas a ser ordenadas y busca una clasificación que maximice la calidad de detección minimizando a la vez el retraso y el uso de recursos. Una función matemática especial ayuda a la búsqueda a escapar de malas elecciones intermedias. Experimentos con varios conjuntos de datos públicos de intrusiones muestran que este paso de priorización aumenta el rendimiento y reduce los tiempos de respuesta en comparación con otras estrategias de gestión de alertas.

Qué significan los hallazgos para los usuarios cotidianos

Los autores informan que su enfoque combinado alcanza más del 99% de precisión en detección de intrusiones multiclase mientras ofrece explicaciones más claras y alertas mejor ordenadas y más rápidas que métodos competidores. Para un no especialista, esto se traduce en un "sistema inmunitario" digital más fiable que es menos propenso a dar falsas alertas y más capaz de detectar ataques sutiles, incluso cuando los datos están incompletos o confusos. Aunque el método no cifra ni protege por sí mismo el contenido de los datos de los usuarios, refuerza de forma significativa una capa defensiva clave en las redes modernas. Con más trabajo en protección de extremo a extremo, enfoques como este podrían ayudar a mantener los servicios en línea más fluidos, seguros y dignos de confianza para todos.

Cita: Kiruthika, K., Karpagam, M., Sardar, T.H. et al. Epistemic uncertain computing for intrusion detection with explainability & multi-criteria optimization using AA-NLS and GRUSO-GRU. Sci Rep 16, 14050 (2026). https://doi.org/10.1038/s41598-026-44214-z

Palabras clave: detección de intrusiones, seguridad de redes, incertidumbre, IA explicable, alertas de ciberataques