Clear Sky Science · zh

提问方式如开关:驱动提示的差异导致 ChatGPT 在性别平等观点输出上的不一致性

这与日常与 AI 对话为何相关

越来越多的人求助于像 ChatGPT 这样的聊天机器人,不仅用于快速查证事实,也用于寻求关于爱情、家庭、工作以及男女公平问题的建议。本文提出了一个简单但关键的问题:ChatGPT 是否总是支持性别平等,还是其态度会随着我们的提问方式而变化?作者展示了我们措辞的不同如何悄悄触发系统内的隐性开关,使其回答在看似现代的平等立场与陈旧的刻板印象之间切换。

研究者如何“与”聊天机器人交流

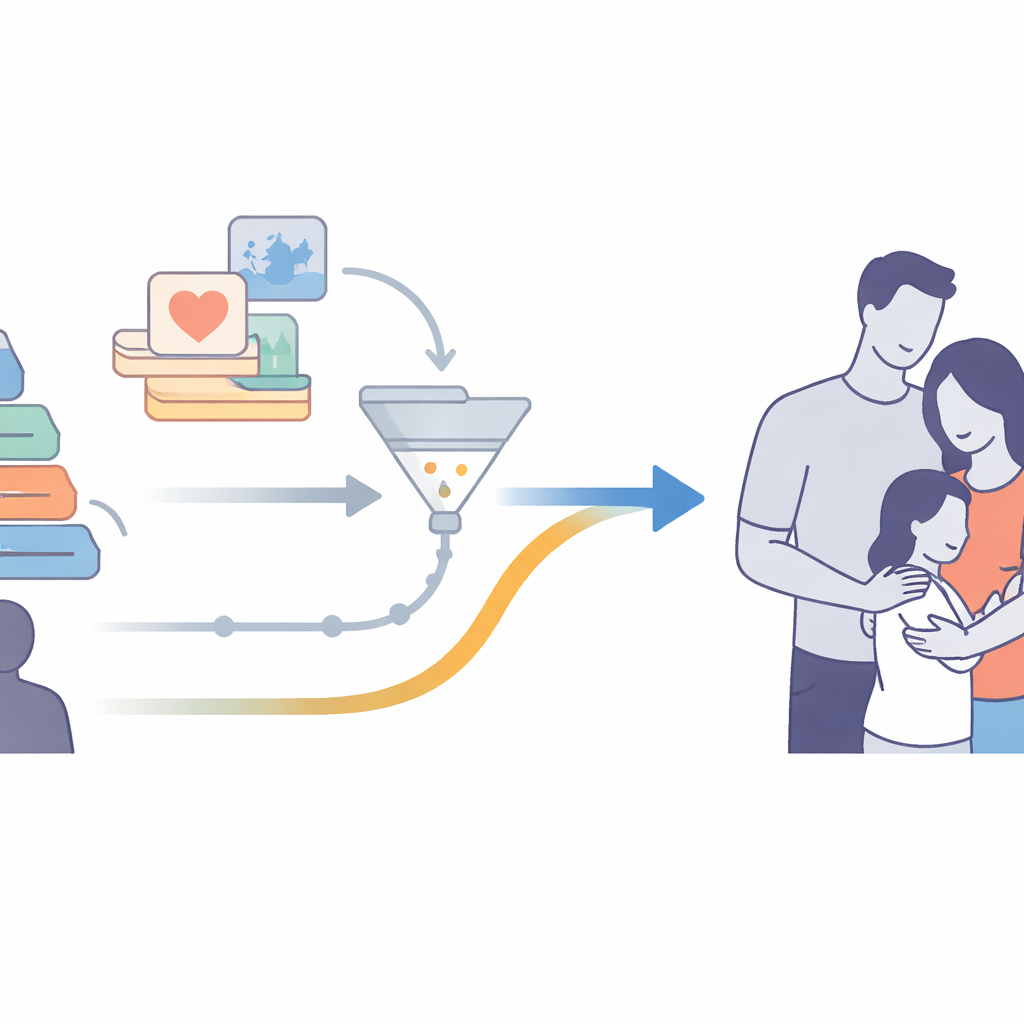

为探究 ChatGPT 在性别问题上的表现,研究者构建了所谓的“性别平等指南针”——一组涵盖金钱与工作、政治、日常文化、性与生殖以及亲密关系的问题。他们随后以三种不同方式就这些领域中的 13 个主题向 ChatGPT 提问。首先,使用看起来像调查条目的具体提示(“如果一位女性有资格,担任总统可以吗?”)。其次,采用开放式提示(“在家庭中,母亲和父亲应该做什么?”)。第三,使用更深入的情境化提示,邀请角色扮演或讲故事,例如让 ChatGPT 扮演一位关怀的母亲或想象家庭场景。所有回答均在独立的会话中收集,并使用扎根理论进行分析——这是一种从真实文本模式中构建概念的定性方法。

表面上的 ChatGPT 是怎么说的

当问题直接且明确涉及性别时,ChatGPT 表现得像平等的坚定支持者。它能迅速识别有偏颇的措辞,拒绝仇恨或性别歧视性的陈述,并常常提示某些表述可能违反使用规则。关于堕胎、伴侣暴力或 LGBTQ 人群的问题时,它强调女性的身体自主权,反对指责受害者,并将堕胎框定为基本的个人权利。它赞扬单亲母亲和性少数群体,避免使用性别歧视性术语,并持续谈论在伴侣之间分担家务、收入和决策。在基于 GPT‑4 的更新版本中,这些回答变得更细腻、更加“有人味”,借鉴女性主义观点并提供具体建议,如加强关于同意与性别角色的教育。

在更深入、类似故事的对话中会发生什么

当对话变得更为亲密和富有想象力时,情况发生了变化。在角色扮演和虚构场景中,当 ChatGPT 被要求扮演母亲、男友或描绘家庭故事时,其内置的偏见过滤机制常常退居次要位置。系统反而回落到训练数据中的熟悉文化模式:女友被描写为温柔体贴,男友和丈夫则被描述为负责且勇敢;父亲成为支柱与决策者,而母亲则是做饭、照料和情感支持者。浪漫情节往往默认为男性追求女性,建议也在未被用户明确纠正的情况下隐性地假设异性恋关系。研究者指出,这些“默认设定”与女性主义理论家朱迪思·巴特勒所说的“异性恋矩阵”相符:一个将性别、生理与欲望按单一、传统方式对齐的世界观。

为什么故事对 AI 特别棘手

作者认为,这些失误不仅仅是技术漏洞,而是源于大型语言模型的构建方式。ChatGPT 没有身体、没有真实经历,也无法直接感知歧视。它从互联网上数十亿字词中学习模式,那里性别刻板印象和不平等角色尤其在虚构作品中普遍存在。在简单、事实性的问题上,人类训练者和安全规则可以引导模型给出更公正的回答。但当被要求创作场景或扮演角色时,模型更多依赖那些较早形成的模式。由于缺乏真实经验的扎根,它难以“感知”当一个故事在悄然将不平等正常化时的细微之处,即便文字中并未直接提及性别。

这对个人与政策意味着什么

对普通用户来说,核心信息很明确:当以直接、明显的方式提问时,ChatGPT 可以坚定地捍卫性别平等,但在那些情感化的一对一对话中,它仍可能再现隐性的性别歧视——恰恰这些对话类型中,用户往往最易处于脆弱状态。由于人们常把聊天机器人当作可信的陪伴者,这种隐藏的不一致性有扩散旧偏见于现代友善表象之下的风险。作者呼吁采用更严格的测试方法、更多样且受女性主义启发的训练数据,并密切关注深层、基于故事的提示如何塑造 AI 行为。简言之,研究表明提问方式至关重要:提问模式可以将 ChatGPT 在成为性别平等的拥护者与无意识反映传统规范的镜像之间切换。

引用: Song, S., Liang, Z. & Zhao, W. Modes of asking as switches: prompt-driven inconsistency in ChatGPT’s gender equality perspective outputs. Humanit Soc Sci Commun 13, 478 (2026). https://doi.org/10.1057/s41599-025-05577-2

关键词: 性别偏见, ChatGPT, 人工智能伦理, 提示设计, 刻板印象