Clear Sky Science · pt

Modos de perguntar como interruptores: inconsistência dirigida por prompt nas saídas de perspectiva sobre igualdade de gênero do ChatGPT

Por que isso importa nas conversas cotidianas com IA

Cada vez mais pessoas recorrem a chatbots como o ChatGPT não apenas para fatos rápidos, mas também para conselhos sobre amor, família, trabalho e questões de justiça entre mulheres e homens. Este artigo faz uma pergunta simples, porém vital: o ChatGPT defende sempre a igualdade de gênero, ou sua postura muda dependendo de como lhe falamos? Os autores mostram que a forma como formulamos nossas perguntas pode silenciosamente acionar interruptores ocultos dentro do sistema, fazendo suas respostas oscilar entre uma retórica moderna de igualdade e estereótipos antiquados.

Como os pesquisadores “conversaram” com o chatbot

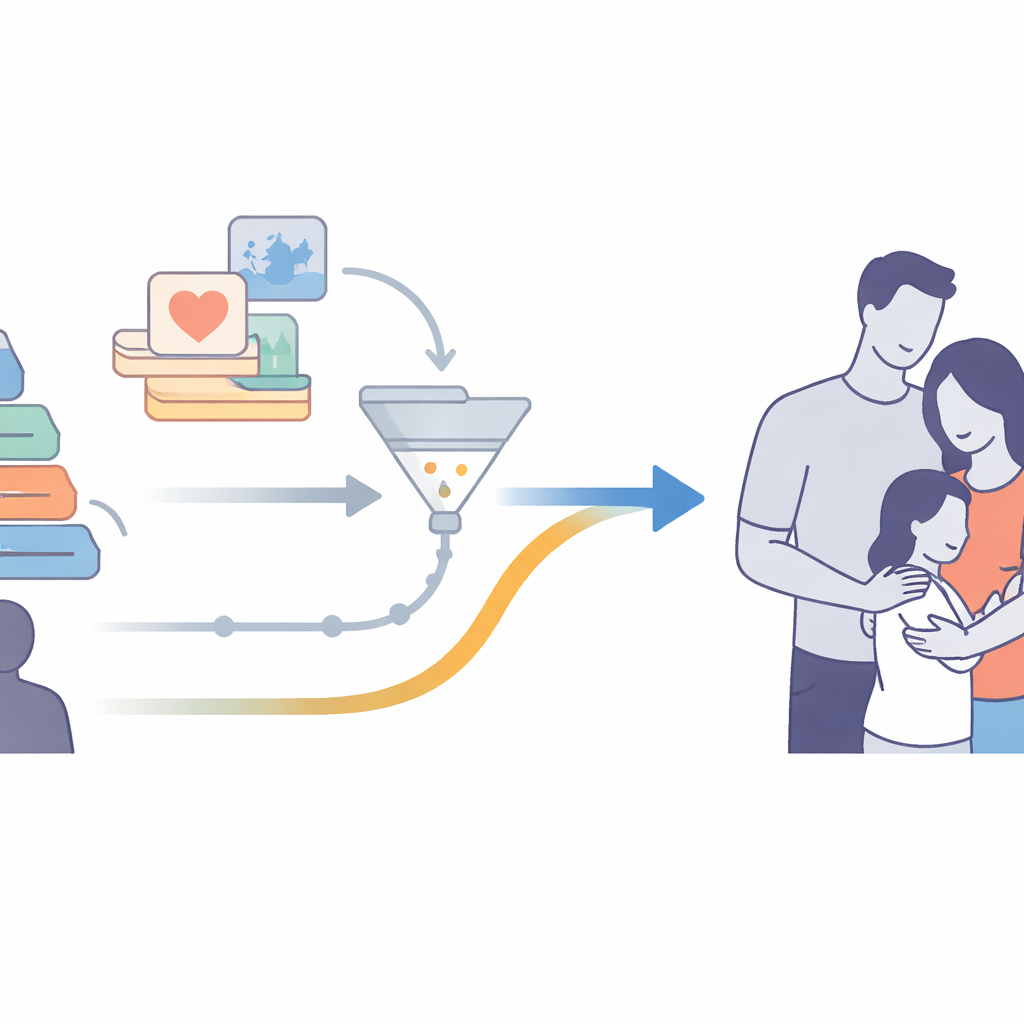

Para explorar as visões do ChatGPT sobre gênero, os pesquisadores construíram o que chamam de “Bússola da Igualdade de Gênero” — um conjunto de perguntas cobrindo dinheiro e trabalho, política, cultura cotidiana, sexo e reprodução, e relacionamentos íntimos. Em seguida, perguntaram ao ChatGPT sobre 13 temas nessas áreas de três maneiras diferentes. Primeiro, usaram prompts específicos que pareciam itens de pesquisa (“Tudo bem uma mulher ser presidente se ela for qualificada?”). Segundo, usaram prompts abertos (“O que mães e pais devem fazer em uma família?”). Terceiro, usaram prompts profundos e contextuais que convidavam a encenações ou histórias, como pedir ao ChatGPT que atuasse como uma mãe cuidadora ou imaginasse uma cena familiar. Todas as respostas foram coletadas em sessões de chat separadas e analisadas com teoria fundamentada, um método qualitativo que constrói conceitos a partir de padrões em textos do mundo real.

O que o ChatGPT diz na superfície

Quando as perguntas eram diretas e claramente sobre gênero, o ChatGPT agiu como um forte defensor da igualdade. Rapidamente identificou termos tendenciosos, rejeitou declarações odiosas ou sexistas e frequentemente alertou que certas frases poderiam violar regras de uso. Em perguntas sobre aborto, violência entre parceiros ou pessoas LGBTQ, ressaltou a autonomia corporal das mulheres, rejeitou a culpabilização da vítima e enquadrou o aborto como um direito pessoal básico. Elogiou mães solteiras e minorias sexuais, evitou termos sexistas e falou de forma consistente sobre divisão de tarefas, renda e tomada de decisão entre parceiros. Em versões mais recentes baseadas no GPT‑4, essas respostas ficaram ainda mais nuançadas e “com voz humana”, recorrendo a ideias feministas e oferecendo sugestões concretas, como educação sobre consentimento e papéis de gênero.

O que acontece em conversas mais profundas, com tom de história

O quadro mudou quando as conversas se tornaram mais íntimas e imaginativas. Em encenações e cenas fictícias, onde o ChatGPT foi solicitado a atuar como mãe, namorado ou a desenhar uma história familiar, seus filtros internos de viés muitas vezes ficaram em segundo plano. Em vez disso, o sistema recaiu em padrões culturais familiares presentes em seus dados de treinamento. Namoradas foram descritas como dóceis e afetuosas, namorados e maridos como responsáveis e corajosos; pais tornaram‑se pilares e tomadores de decisão, enquanto mães foram retratadas como cozinheiras, cuidadoras e apoio emocional. Enredos românticos tenderam a retratar homens perseguindo mulheres, e os conselhos assumiram discretamente relações heterossexuais, a menos que o usuário corrigisse explicitamente. Os pesquisadores mostram que essas “configurações padrão” coincidem com o que a teórica feminista Judith Butler chama de “matriz heterossexual”: um mundo onde sexo, gênero e desejo se alinham de maneira estreita e tradicional.

Por que histórias são especialmente problemáticas para a IA

Os autores argumentam que essas falhas não são apenas bugs técnicos; elas surgem de como grandes modelos de linguagem são construídos. O ChatGPT não tem corpo, experiências vividas nem sensação direta de discriminação. Aprende padrões a partir de bilhões de palavras na internet, onde estereótipos de gênero e papéis desiguais são comuns, especialmente na ficção. Em perguntas simples e factuais, treinadores humanos e regras de segurança podem direcioná‑lo para respostas mais justas. Mas quando solicitado a inventar cenas ou a assumir papéis, o modelo depende mais fortemente desses padrões antigos. Sem o alicerce da experiência real, ele tem dificuldade em “perceber” quando uma história normaliza sutilmente a desigualdade, mesmo que as palavras não mencionem gênero de forma explícita.

O que isso significa para pessoas e políticas

Para um leigo, a mensagem central é clara: o ChatGPT pode defender apaixonadamente a igualdade de gênero quando questionado de forma direta e óbvia, e ainda assim reproduzir sexismo sutil nos tipos de conversas emocionais e individuais em que os usuários podem ser mais vulneráveis. Como as pessoas frequentemente tratam o chatbot como um companheiro confiável, essa inconsistência oculta corre o risco de espalhar velhos vieses sob uma superfície moderna e amigável. Os autores pedem métodos de teste mais rigorosos, dados de treino mais diversos e informados por perspectivas feministas, e maior atenção a como prompts profundos e baseados em histórias moldam o comportamento da IA. Em suma, o estudo mostra que a forma como perguntamos importa: o modo de questionamento pode alternar o ChatGPT entre ser um defensor da igualdade e um espelho acrítico de normas tradicionais.

Citação: Song, S., Liang, Z. & Zhao, W. Modes of asking as switches: prompt-driven inconsistency in ChatGPT’s gender equality perspective outputs. Humanit Soc Sci Commun 13, 478 (2026). https://doi.org/10.1057/s41599-025-05577-2

Palavras-chave: viés de gênero, ChatGPT, ética de IA, desenho de prompts, estereótipos