Clear Sky Science · ru

Режимы вопроса как переключатели: как подсказки приводят к непоследовательности в ответах ChatGPT по вопросам гендерного равенства

Почему это важно для повседневных разговоров с ИИ

Все больше людей обращаются к чат‑ботам вроде ChatGPT не только за быстрыми фактами, но и за советами по любви, семье, работе и вопросам справедливости между женщинами и мужчинами. В этой статье поставлен простой, но важный вопрос: всегда ли ChatGPT выступает за гендерное равенство, или его позиция меняется в зависимости от того, как с ним разговаривают? Авторы показывают, что формулировка наших запросов может незаметно переключать внутренние установки системы, переводя ответы от современных представлений о равенстве к устаревшим стереотипам.

Как исследователи «разговаривали» с чат‑ботом

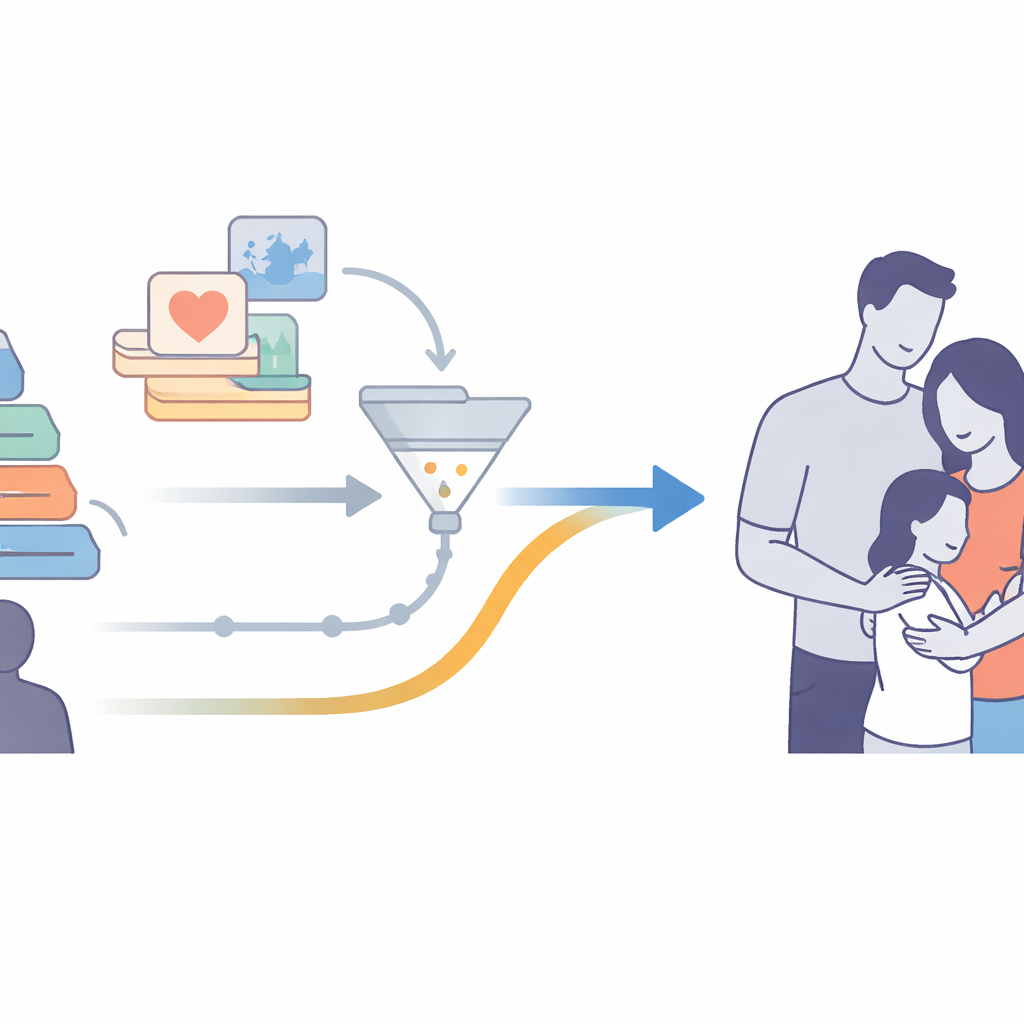

Чтобы исследовать взгляды ChatGPT на гендер, исследователи создали так называемый «Компас гендерного равенства» — набор вопросов, охватывающих деньги и работу, политику, повседневную культуру, секс и репродукцию, а также близкие отношения. Затем они задавали ChatGPT вопросы по 13 темам в трёх разных форматах. Во‑первых, использовали конкретные подсказки, стилизованные под пункты опроса («Можно ли женщине быть президентом, если она квалифицирована?»). Во‑вторых, применяли открытые вопросы («Что должны делать мать и отец в семье?»). В‑третьих, использовали глубокие контекстные подсказки с ролевыми играми или сюжетными сценами, например просили ChatGPT выступить в роли заботливой матери или представить сцену в семье. Все ответы собирались в отдельных сеансах чата и анализировались с помощью grounded theory — качественного метода, который выстраивает концепции на основе закономерностей в реальных текстах.

Что ChatGPT говорит на поверхности

Когда вопросы были простыми и явно касались гендера, ChatGPT вёл себя как твёрдый сторонник равенства. Он быстро замечал предвзятость в формулировках, отвергал ненавистные или сексистские утверждения и часто предупреждал, что некоторые фразы могут нарушать правила использования. В вопросах об абортах, насилии со стороны партнёра или ЛГБТ‑людях он подчёркивал автономию женского тела, отвергал обвинение жертв и рассматривал аборт как базовое личное право. Он хвалил матерей‑одиночек и сексуальные меньшинства, избегал сексистских терминов и последовательно говорил о распределении домашних обязанностей, доходов и принятии решений между партнёрами. В более новых версиях на базе GPT‑4 эти ответы стали ещё более нюансированными и «человечными», опираясь на феминистские идеи и предлагая конкретные меры, такие как образование по согласию и гендерным ролям.

Что происходит в глубоких, сюжетных диалогах

Картина менялась, когда разговоры становились более близкими и воображаемыми. В ролевых играх и вымышленных сценах, где ChatGPT просили сыграть мать, парня или набросать семейную историю, встроенные фильтры предвзятости часто отходили на задний план. Система возвращалась к знакомым культурным шаблонам из обучающих данных. Девушек описывали как мягких и ласковых, парней и мужей — как ответственных и храбрых; отцы становились опорой и принимающими решения, в то время как матери — поварами, заботливыми о детях и эмоциональной поддержкой. Романтические сюжеты по умолчанию сводились к мужчинам, преследующим женщин, а советы молча предполагали гетеросексуальные отношения, если пользователь явно этого не уточнял. Авторы показывают, что эти «настройки по умолчанию» соответствуют тому, что феминистская теоретик Джудит Батлер называет «гетеросексуальной матрицей»: миру, где биологический пол, гендер и желание выстраиваются по одному узкому традиционному образцу.

Почему истории особенно капризны для ИИ

Авторы утверждают, что эти сбои — не просто технические баги; они вырастают из того, как создаются крупные языковые модели. У ChatGPT нет тела, жизненного опыта и прямого ощущения дискриминации. Он учится на миллиардах слов в интернете, где гендерные стереотипы и неравные роли распространены, особенно в художественных текстах. В простых фактических вопросах человеческие тренеры и правила безопасности могут направлять его к более справедливым ответам. Но когда его просят придумывать сцены или играть роли, модель сильнее опирается на старые шаблоны. Без опоры на реальный опыт ей трудно «чувствовать», когда рассказ незаметно нормализует неравенство, даже если в явном виде гендер не упоминается.

Что это значит для людей и политики

Для обычного пользователя основной вывод ясен: ChatGPT может энергично защищать гендерное равенство при прямых, явных вопросах, но при этом воспроизводить тонкий сексизм в эмоциональных, личных беседах, где пользователи особенно уязвимы. Поскольку люди часто воспринимают чат‑бота как надёжного собеседника, эта скрытая непоследовательность рискует распространять старые предубеждения под современной дружелюбной оболочкой. Авторы призывают к более строгим методам тестирования, к более разнообразным и феминистски ориентированным данным обучения и к тщательному вниманию к тому, как глубокие, сюжетные подсказки формируют поведение ИИ. Коротко: исследование показывает, что то, как мы спрашиваем, имеет значение — режим вопроса может переключать ChatGPT между ролью защитника равенства и немыслящего зеркала традиционных норм.

Цитирование: Song, S., Liang, Z. & Zhao, W. Modes of asking as switches: prompt-driven inconsistency in ChatGPT’s gender equality perspective outputs. Humanit Soc Sci Commun 13, 478 (2026). https://doi.org/10.1057/s41599-025-05577-2

Ключевые слова: гендерные предубеждения, ChatGPT, этика ИИ, проектирование подсказок, стереотипы