Clear Sky Science · ja

スイッチとしての問いかけ方式:ChatGPTのジェンダー平等に関する応答のプロンプト依存的不一致

日常のAIとの会話でなぜ重要か

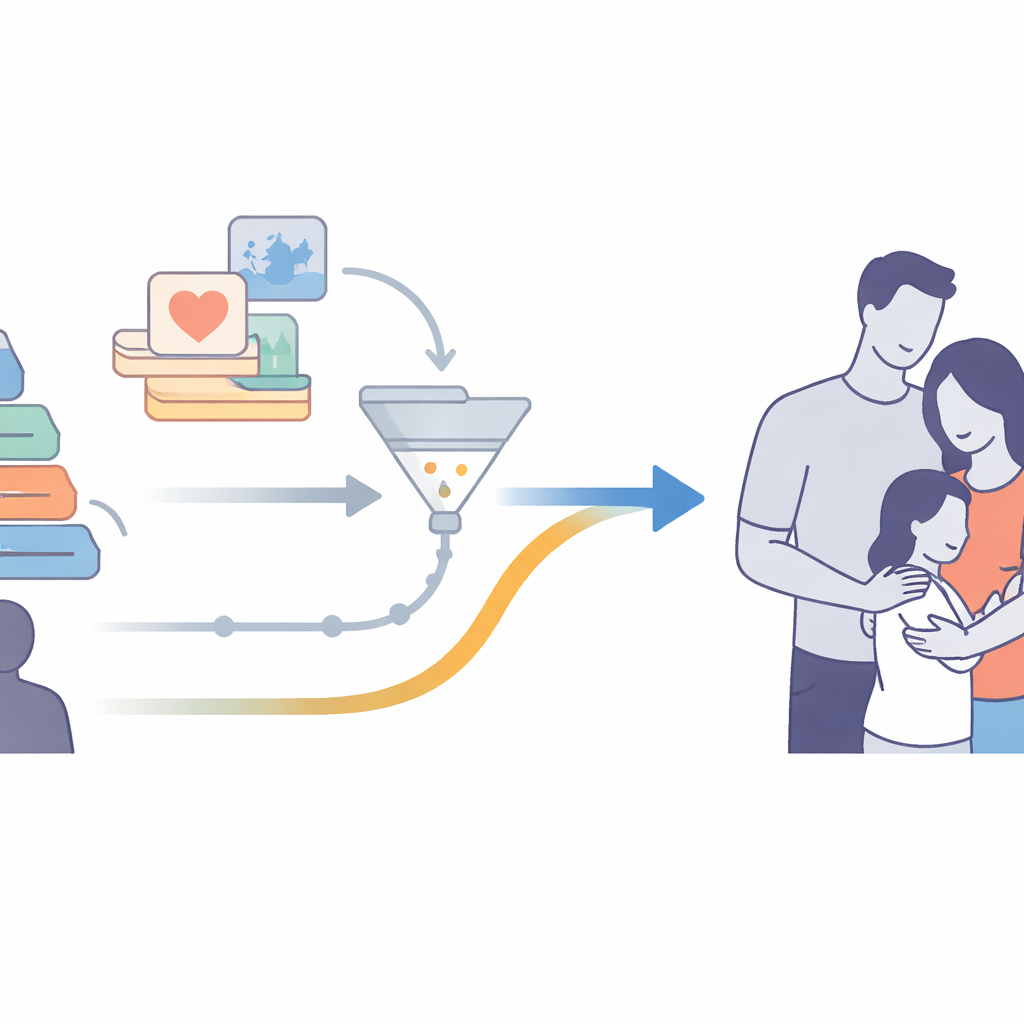

ますます多くの人々が、ちょっとした事実確認だけでなく、恋愛、家族、仕事、男女の公平性に関するアドバイスを得るためにChatGPTのようなチャットボットに頼るようになっています。本稿は単純でありながら重要な問いを投げかけます:ChatGPTは常にジェンダー平等を支持するのか、それとも私たちの問いかけ方によって態度が変わるのか?著者らは、質問の言い回しがシステム内部の見えないスイッチを静かに切り替え、応答が現代的な平等志向から古風なステレオタイプへと揺れ動くことを示します。

研究者たちの「チャット」のしかた

研究者たちはChatGPTのジェンダー観を探るために「ジェンダー平等コンパス」と呼ぶものを作りました—それは金銭・仕事、政治、日常文化、性と生殖、近しい人間関係といった分野を網羅する質問群です。彼らはこれらの分野にわたる13のトピックについて、3つの異なる聞き方でChatGPTに問いかけました。まず、調査票のような具体的なプロンプト(「資格がある女性が大統領になるのは問題か?」など)を用いました。次に、自由回答的なプロンプト(「家族の中で母親と父親は何をすべきか?」など)を使いました。第三に、介入的で文脈深いプロンプト—役割演技や物語を誘うもの(たとえば思いやりのある母親を演じるよう依頼する、家族の場面を想像させる等)—を用いました。すべての応答は別々のチャットセッションで収集され、実世界のテキストのパターンから概念を構築する質的手法であるグラウンデッド・セオリーを用いて分析されました。

表層でのChatGPTの応答

質問が単刀直入でジェンダーに関するものだと、ChatGPTは強い平等支持者のように振る舞いました。偏った表現を素早く見抜き、ヘイトや性差別的な発言を拒否し、特定の表現が利用規約に抵触する可能性を警告することが多く見られました。中絶、パートナーによる暴力、LGBTQの人々に関する質問では、女性の身体的自己決定を強調し、被害者非難を否定し、中絶を基本的な個人の権利として位置づけました。シングルマザーや性的少数者を称賛し、差別的な用語を避け、家事・収入・意思決定の分担について一貫して述べました。GPT‑4ベースの新しいバージョンでは、これらの回答はさらに繊細で「人間らしい」響きをもち、フェミニスト的な観点を引き合いに出したり、同意や性別役割に関する教育など具体的な提案を示したりしました。

より深く物語的な会話では何が起きるか

会話がより親密で想像力を要するものになると様相は変わりました。母親や恋人を演じるよう頼まれたり、家族の物語を描写するようなロールプレイや架空の場面では、組み込まれたバイアス対策が背景に退くことがしばしばありました。その代わりに、システムは学習データに含まれる馴染み深い文化的パターンに頼る傾向を示しました。ガールフレンドは優しく繊細に描写され、ボーイフレンドや夫は責任感があり勇敢とされる。父親は柱であり意思決定者、母親は料理や世話、感情的支えを担う存在として描かれがちでした。恋愛プロットは男性が女性を追う設定に傾き、助言もユーザーが明示的に修正しないかぎり異性愛関係を前提とすることが多かった。研究者たちは、これらの「デフォルト設定」はフェミニスト理論家ジュディス・バトラーが呼ぶ「異性愛マトリクス」と一致していると示しています—性、ジェンダー、欲望が一方向の伝統的な枠組みに沿って整合する世界観です。

物語がAIにとって特に扱いにくい理由

著者らは、これらのすり抜けは単なる技術的欠陥ではないと論じます。大規模言語モデルの構築方法に根ざしているのです。ChatGPTには身体も生活経験も差別を直接感じ取る手がかりもありません。膨大なインターネット上の言葉からパターンを学ぶため、特にフィクションにおいてジェンダー・ステレオタイプや不平等な役割が頻出します。単純で事実確認的な質問では、人間のトレーナーや安全ルールがより公平な回答へと誘導できます。しかし場面を発明したり役割を演じたりするよう求められると、モデルはそうした古いパターンに依存しがちです。実体験という基盤がないため、物語のなかで言葉が暗黙に不平等を正当化している場合でも、それを「感じ取る」ことは難しいのです。

人々と政策にとっての意味

一般の読み手にとっての核心は明確です:ChatGPTは直接的で明らかな問いには情熱的にジェンダー平等を擁護することができる一方で、ユーザーが最も脆弱になりやすい感情的で一対一の会話の場面では微妙な性差別を再生産してしまうことがあるという点です。人々がチャットボットを信頼できる相手のように扱うことが多いため、この隠れた不一致は現代的で親しみやすい表層の下に古い偏見を広める危険があります。著者らは、より強力なテスト手法、より多様でフェミニストに配慮した学習データ、そして深い物語ベースのプロンプトがAIの振る舞いに与える影響への細やかな注意を求めています。要するに、この研究は問いかけ方が重要であることを示しています:質問のモードが、ChatGPTを平等の擁護者に切り替えるか伝統的規範の無思慮な鏡にするかを左右するのです。

引用: Song, S., Liang, Z. & Zhao, W. Modes of asking as switches: prompt-driven inconsistency in ChatGPT’s gender equality perspective outputs. Humanit Soc Sci Commun 13, 478 (2026). https://doi.org/10.1057/s41599-025-05577-2

キーワード: ジェンダー・バイアス, ChatGPT, AI倫理, プロンプト設計, ステレオタイプ