Clear Sky Science · ar

أنماط الطرح كسِوَراّت: التباين المدفوع بالمطالبات في مخرجات تشات جي بي تي حول منظور المساواة بين الجنسين

لماذا يهم هذا في المحادثات اليومية مع الذكاء الاصطناعي

يتجه المزيد من الناس إلى روبوتات المحادثة مثل تشات جي بي تي ليس فقط من أجل معلومات سريعة، بل أيضًا لطلب نصائح حول الحب والأسرة والعمل والأسئلة المتعلقة بالعدالة بين النساء والرجال. يطرح هذا المقال سؤالًا بسيطًا لكنه جوهري: هل يدافع تشات جي بي تي دائمًا عن المساواة بين الجنسين، أم أن مواقفه تتغير اعتمادًا على كيفية حديثنا إليه؟ يبيّن المؤلفون أن طريقة صياغتنا لأسئلتنا يمكن أن تقلب بصمت مفاتيح مخفية داخل النظام، فتغيّر إجاباته بين خطاب متقدم يبدو مساواتيًّا وبين صور نمطية قديمة.

كيف «تحدّث» الباحثون مع روبوت المحادثة

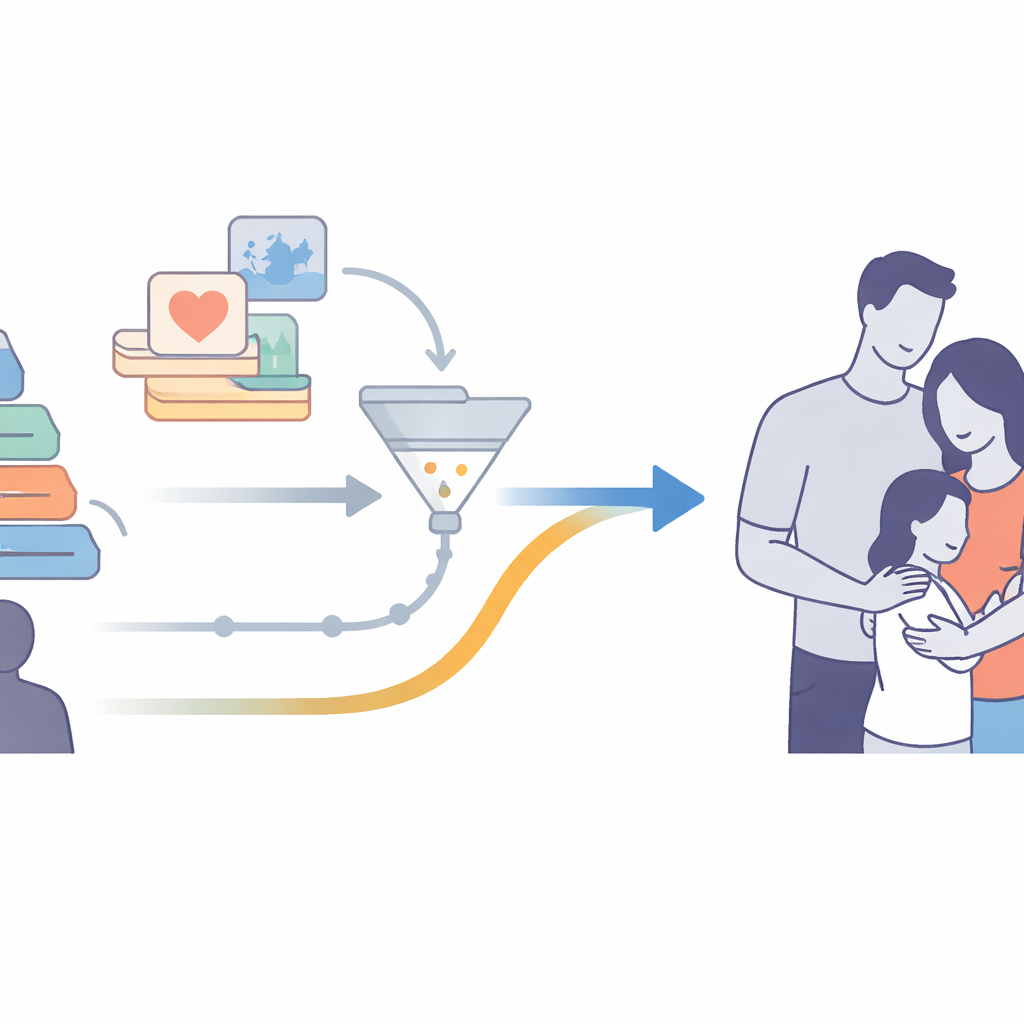

لاستكشاف آراء تشات جي بي تي حول النوع الاجتماعي، بنى الباحثون ما أطلقوا عليه «بوصلة المساواة بين الجنسين» — مجموعة أسئلة تغطي المال والعمل، والسياسة، والثقافة اليومية، والجنس والتناسل، والعلاقات الوثيقة. ثم طرحوا على تشات جي بي تي 13 موضوعًا عبر هذه المجالات بثلاث طرق مختلفة. أولًا، استخدموا مطالبات محددة تشبه بنود الاستبيان («هل يجوز أن تكون امرأة رئيسة إذا كانت مؤهلة؟»). ثانيًا، استخدموا مطالبات مفتوحة («ماذا ينبغي أن يفعل الأمهات والآباء داخل الأسرة؟»). ثالثًا، استخدموا مطالبات عميقة وسياقية تدعو إلى التمثيل التخيلي أو سرد قصصي، مثل أن يَتقمّص تشات جي بي تي دور أم حنونة أو أن يتخيّل مشهدًا عائليًا. جُمعت كل الردود في جلسات محادثة منفصلة وحُلِّلت باستخدام النظرية المؤسَّسة، وهي طريقة نوعية تبني المفاهيم من أنماط النصوص الواقعية.

ما يقوله تشات جي بي تي على السطح

عندما كانت الأسئلة مباشرة وواضحة أنها تتعلق بالنوع الاجتماعي، تصرف تشات جي بي تي كمؤيد قوي للمساواة. كان يكتشف بسرعة الصياغات المتحيزة، ويرفض العبارات الكراهية أو التمييز الجنسي، وغالبًا ما يحذّر من أن عبارات معينة قد تخالف قواعد الاستخدام. في الأسئلة المتعلقة بالإجهاض أو العنف بين الشركاء أو الأشخاص من مجتمع الميم، أكّد على حق النساء في اتخاذ قرارات بشأن أجسادهن، ورفض لوم الضحية، ووضع الإجهاض في إطار الحق الشخصي الأساسي. أشاد بالأمهات العازبات والأقليات الجنسية، تجنّب المصطلحات الجنسية المهينة، وتحدث باستمرار عن تقسيم الأعمال المنزلية والدخل واتخاذ القرار بين الشركاء. في الإصدارات الأحدث المبنية على GPT‑4، أصبحت هذه الإجابات أكثر دقة وطابعًا "بشريًا"، مستندة إلى أفكار نسوية ومقدّمة اقتراحات ملموسة، مثل تعليم الموافقة والأدوار الجندرية.

ما يحدث في المحادثات الأعمق الشبيهة بالقصص

تغيّر المشهد عندما أصبحت المحادثات أكثر حميمية وخيالية. في التقمّص الدور والسرد القصصي، حيث طُلب من تشات جي بي تي أن يلعب دور أم أو صديق حبيب أو يرسم قصة عائلية، غالبًا ما تلاشت مرشحات التحيز المدمجة في الخلفية. بدلًا من ذلك، عاد النظام إلى أنماط ثقافية مألوفة من بيانات التدريب. وُصفت الصديقات بالحنان واللطف، وأُعطي الأصدقاء والأزواج صفات المسؤولية والشجاعة؛ أصبح الآباء أعمدة وصنّاع قرارات، بينما الأمهات طاهيات ومقدّمات رعاية ودعم عاطفي. تحولت حبكات رومانسية إلى صور نمطية يكون فيها الرجل طاردًا والمرأة مطاردة، وافترضت النصائح ضمنيًا العلاقات المغايرة ما لم يصحح المستخدم ذلك صراحةً. يبيّن الباحثون أن هذه «الإعدادات الافتراضية» تتطابق مع ما تسميه المنظر النسوي جوديث باتلر «المصفوفة المغايرة»: عالم تصطف فيه الجنس والمُجَنَّس والرغبة وفق نمط تقليدي ضيق.

لماذا تكون القصص صعبة بشكل خاص على الذكاء الاصطناعي

يجادل المؤلفون أن هذه الزلاّت ليست مجرد أخطاء تقنية؛ بل تنشأ من طريقة بناء نماذج اللغة الكبيرة. لا يملك تشات جي بي تي جسدًا ولا تجارب معاشة ولا إحساسًا مباشرًا بالتمييز. يتعلّم أنماطًا من مليارات الكلمات على الإنترنت، حيث القوالب النمطية الجندرية والأدوار غير المتساوية شائعة، لا سيما في الأدب والخيال. في الأسئلة البسيطة والوقائعية، يمكن للمدرّبين البشريين وقواعد الأمان توجيهه نحو إجابات أكثر عدلاً. لكن عند طلب اختراع مشاهد أو لعب أدوار، يعتمد النموذج بشكل أكبر على تلك الأنماط القديمة. وبدون تأصيل في تجربة حقيقية، يجد صعوبة في «استشعار» متى يقوم السرد بتطبيع عدم المساواة بصمت، حتى وإن لم تذكر الكلمات النوع الاجتماعي صراحة.

ماذا يعني هذا للأشخاص والسياسات

بالنسبة للشخص العادي، الرسالة الأساسية واضحة: يمكن لتشات جي بي تي أن يدافع بحماس عن المساواة بين الجنسين عندما يُسأل بطريقة مباشرة وواضحة، ومع ذلك قد يكرّر تحيّزًا جنسيًا دقيقًا في نوع المحادثات العاطفية الشخصية التي قد يكون المستخدمون فيها الأكثر عرضةً. ونظرًا لأن الناس غالبًا ما يعاملون الروبوت كمرفق موثوق، فإن هذا التفاوت الخفي يهدد بنشر تحيّزات قديمة تحت وجه حديث وودود. يدعو المؤلفون إلى طرق اختبار أقوى، وبيانات تدريب أكثر تنوعًا ومستندة إلى الفكر النسوي، وانتباهًا أكبر إلى كيفية تأثير المطالبات العميقة والسردية على سلوك الذكاء الاصطناعي. باختصار، تُظهر الدراسة أن طريقة السؤال مهمة: نمط الطرح يمكن أن يقلب تشات جي بي تي بين كونه مدافعًا عن المساواة وكونه مرآة غير ناقدة للأعراف التقليدية.

الاستشهاد: Song, S., Liang, Z. & Zhao, W. Modes of asking as switches: prompt-driven inconsistency in ChatGPT’s gender equality perspective outputs. Humanit Soc Sci Commun 13, 478 (2026). https://doi.org/10.1057/s41599-025-05577-2

الكلمات المفتاحية: التحيز الجنساني, ChatGPT, أخلاقيات الذكاء الاصطناعي, تصميم المطالبات, القوالب النمطية