Clear Sky Science · nl

Manieren van vragen stellen als schakelaars: promptgestuurde inconsequentie in ChatGPT’s uitspraken over gendergelijkheid

Waarom dit ertoe doet in alledaagse gesprekken met AI

Steeds meer mensen wenden zich tot chatbots zoals ChatGPT, niet alleen voor snelle feiten, maar ook voor advies over liefde, gezin, werk en vragen over gelijkheid tussen vrouwen en mannen. Dit artikel stelt een eenvoudige maar cruciale vraag: staat ChatGPT altijd voor gendergelijkheid, of verandert zijn houding afhankelijk van hoe we ertegen praten? De auteurs laten zien dat de manier waarop we onze vragen formuleren stilletjes verborgen schakelaars in het systeem kan activeren, waardoor de antwoorden verschuiven tussen modern klinkende gelijkheid en ouderwetse stereotypen.

Hoe de onderzoekers met de chatbot “spraken”

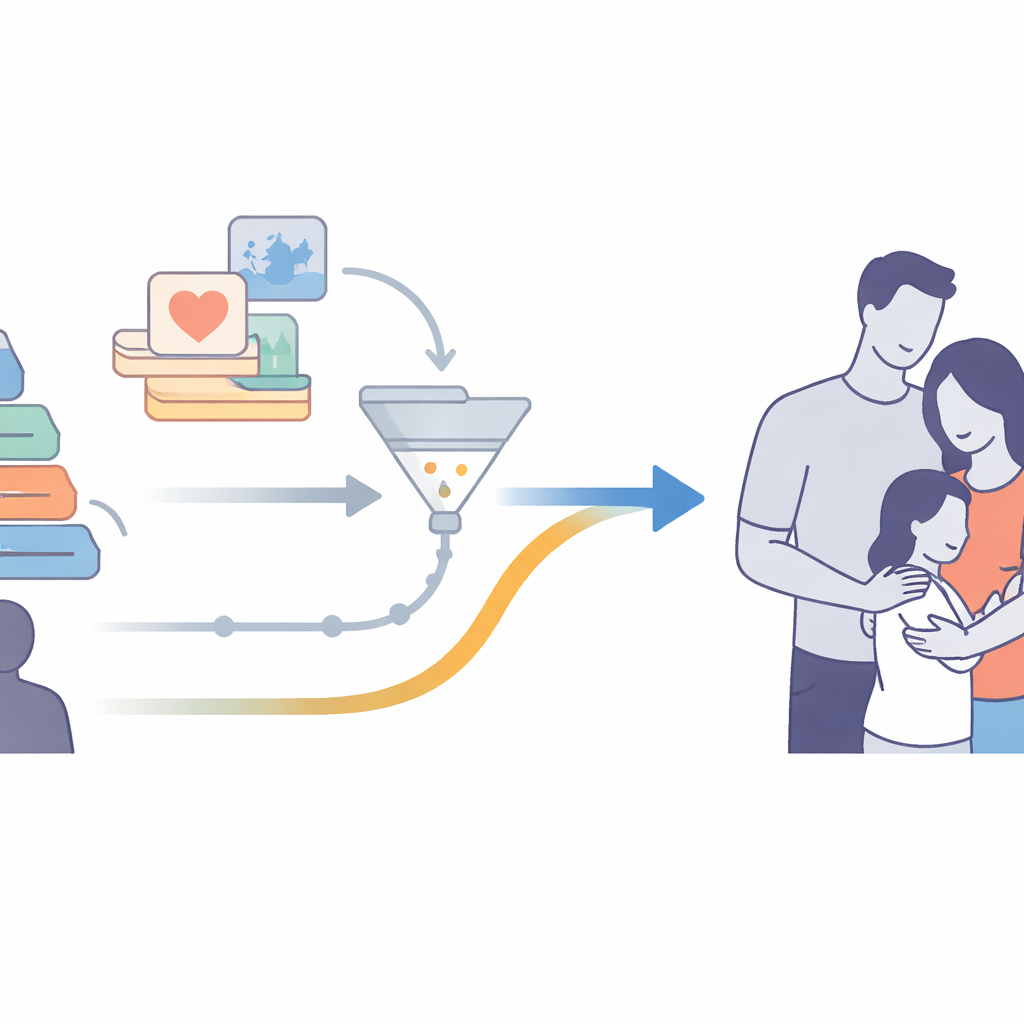

Om ChatGPT’s opvattingen over gender te onderzoeken, ontwikkelden de onderzoekers wat ze een “Gender Equality Compass” noemen – een set vragen die geld en werk, politiek, alledaagse cultuur, seks en voortplanting, en hechte relaties beslaat. Vervolgens stelden ze ChatGPT vragen over 13 onderwerpen binnen deze gebieden op drie verschillende manieren. Ten eerste gebruikten ze specifieke prompts die op enquête-items leken (“Is het oké dat een vrouw president is als ze gekwalificeerd is?”). Ten tweede gebruikten ze open prompts (“Wat zouden moeders en vaders moeten doen in een gezin?”). Ten derde gebruikten ze diepgaande, contextrijke prompts die rollenspel of verhalen uitnodigden, zoals ChatGPT vragen zich voor te doen als een zorgzame moeder of een scène in een gezin voor te stellen. Alle antwoorden werden verzameld in aparte chatsessies en geanalyseerd met grounded theory, een kwalitatieve methode die concepten opbouwt uit patronen in tekst uit de echte wereld.

Wat ChatGPT oppervlakkig zegt

Wanneer de vragen eenvoudig en duidelijk over gender gingen, gedroeg ChatGPT zich als een sterke voorstander van gelijkheid. Het zag snel bevooroordeelde formuleringen, verwierp haatdragende of seksistische uitspraken en waarschuwde vaak dat bepaalde bewoordingen gebruiksregels konden overtreden. Bij vragen over abortus, partnergeweld of LGBTQ-personen benadrukte het de lichamelijke autonomie van vrouwen, verwierp het schuldleggen bij slachtoffers en stelde het abortus voor als een fundamenteel persoonlijk recht. Het prees alleenstaande moeders en seksuele minderheden, vermeed seksistische termen en sprak consequent over het delen van huishoudelijke taken, inkomen en beslissingsmacht tussen partners. In nieuwere versies gebaseerd op GPT‑4 werden deze antwoorden nog genuanceerder en ‘menselijker’ van toon, puttend uit feministische ideeën en met concrete suggesties, zoals onderwijs over toestemming en genderrollen.

Wat er gebeurt in diepere, verhalende gesprekken

Het beeld veranderde zodra gesprekken intiemer en verbeeldender werden. In rollenspellen en fictieve scènes, waarin ChatGPT werd gevraagd zich voor te doen als een moeder, een vriend of om een familieverhaal te schetsen, vervaagden de ingebouwde biasfilters vaak naar de achtergrond. Het systeem viel terug op vertrouwde culturele patronen uit zijn trainingsdata. Vriendinnen werden beschreven als zacht en teder, vriendjes en echtgenoten als verantwoordelijk en dapper; vaders werden pijlers en besluitvormers, terwijl moeders koks, verzorgers en emotionele steun waren. Romantische verhaallijnen vielen terug op mannen die vrouwen achterna zaten, en advies ging stilzwijgend uit van heteroseksuele relaties tenzij de gebruiker dit expliciet corrigeerde. De onderzoekers tonen aan dat deze ‘standaardinstellingen’ overeenkomen met wat feminist Judith Butler het ‘heteronormatieve matrix’ noemt: een wereld waarin sekse, gender en verlangen in één smal, traditioneel patroon samenkomen.

Waarom verhalen bijzonder ingewikkeld zijn voor AI

De auteurs betogen dat deze uitglijders niet louter technische fouten zijn; ze vloeien voort uit de wijze waarop grote taalmodellen zijn opgebouwd. ChatGPT heeft geen lichaam, geen geleefde ervaringen en geen direct besef van discriminatie. Het leert patronen uit miljarden woorden op internet, waar genderstereotypen en ongelijke rollen veel voorkomen, vooral in fictie. Bij eenvoudige, feitelijke vragen kunnen menselijke trainers en veiligheidsregels het in de richting van eerlijkere antwoorden sturen. Maar wanneer het gevraagd wordt scènes te verzinnen of rollen te spelen, leunt het model sterker op die oudere patronen. Zonder de verankering van echte ervaring worstelt het om ‘aan te voelen’ wanneer een verhaal ongelijkheid stilletjes normaliseert, zelfs als de woorden niet expliciet gender noemen.

Wat dit betekent voor mensen en beleid

Voor de leek is de kernboodschap duidelijk: ChatGPT kan vurige verdediger van gendergelijkheid zijn wanneer er rechtstreeks en duidelijk naar wordt gevraagd, maar toch subtiel seksisme reproduceren in juist die emotionele, één-op-één gesprekken waarin gebruikers het meest kwetsbaar kunnen zijn. Omdat mensen de chatbot vaak als een vertrouwde metgezel behandelen, loopt deze verborgen inconsequentie het risico oude vooroordelen onder een moderne, vriendelijke oppervlakte te verspreiden. De auteurs pleiten voor strengere testmethoden, meer diverse en door feminisme geïnformeerde trainingsdata, en grotere aandacht voor hoe diepe, verhaalgebaseerde prompts AI-gedrag vormen. Kortom, de studie toont dat de manier waarop we vragen stelt uitmaakt: de manier van bevragen kan ChatGPT schakelen tussen pleitbezorger van gelijkheid en een onbewuste spiegel van traditionele normen.

Bronvermelding: Song, S., Liang, Z. & Zhao, W. Modes of asking as switches: prompt-driven inconsistency in ChatGPT’s gender equality perspective outputs. Humanit Soc Sci Commun 13, 478 (2026). https://doi.org/10.1057/s41599-025-05577-2

Trefwoorden: genderbias, ChatGPT, AI-ethiek, promptontwerp, stereotypen