Clear Sky Science · es

Modos de preguntar como interruptores: inconsistencia inducida por el prompt en las respuestas de ChatGPT sobre igualdad de género

Por qué esto importa en las conversaciones cotidianas con la IA

Cada vez más personas recurren a chatbots como ChatGPT no solo para datos rápidos, sino también en busca de consejo sobre el amor, la familia, el trabajo y preguntas sobre la equidad entre mujeres y hombres. Este artículo plantea una pregunta sencilla pero vital: ¿defiende siempre ChatGPT la igualdad de género o su postura cambia según la forma en que nos dirigimos a él? Los autores muestran que la manera de formular nuestras preguntas puede activar silenciosamente interruptores ocultos dentro del sistema, desplazando sus respuestas entre una retórica moderna de igualdad y estereotipos de corte tradicional.

Cómo los investigadores “hablaron” con el chatbot

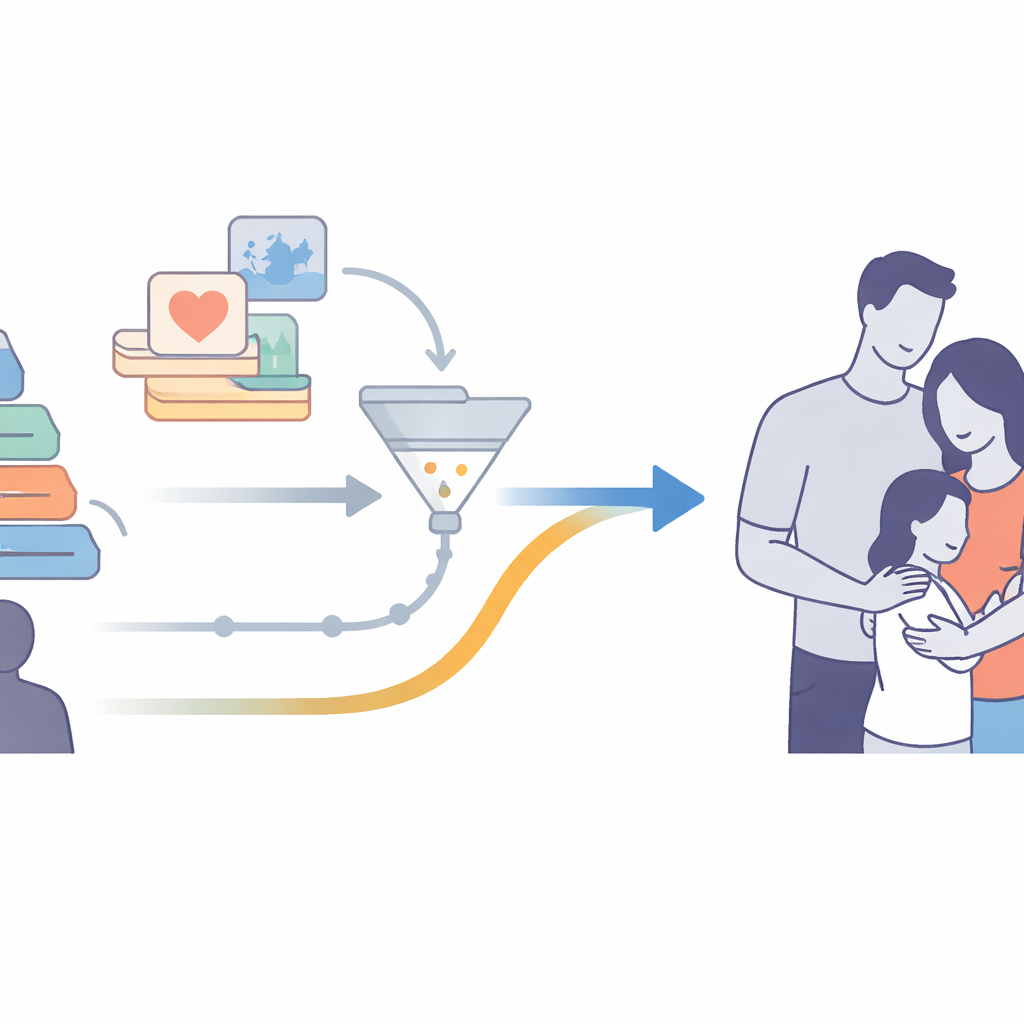

Para explorar las posturas de ChatGPT sobre el género, los investigadores construyeron lo que llaman una “Brújula de Igualdad de Género”: un conjunto de preguntas que cubren dinero y trabajo, política, cultura cotidiana, sexo y reproducción, y relaciones íntimas. Después preguntaron a ChatGPT sobre 13 temas en estas áreas de tres maneras distintas. Primero, usaron prompts específicos que parecían ítems de encuesta (“¿Está bien que una mujer sea presidenta si está cualificada?”). Segundo, emplearon prompts abiertos (“¿Qué deberían hacer madres y padres en una familia?”). Tercero, utilizaron prompts profundos y contextuales que invitaban al juego de roles o a historias, como pedir a ChatGPT que actúe como una madre cariñosa o que imagine una escena familiar. Todas las respuestas se recogieron en sesiones de chat separadas y se analizaron con teoría fundamentada, un método cualitativo que construye conceptos a partir de patrones en textos del mundo real.

Lo que ChatGPT dice en la superficie

Cuando las preguntas eran directas y claramente sobre género, ChatGPT se comportó como un firme defensor de la igualdad. Detectó rápidamente formulaciones sesgadas, rechazó declaraciones odiosas o sexistas y a menudo advirtió que ciertas frases podían incumplir las normas de uso. En cuestiones sobre aborto, violencia de pareja o personas LGBTQ, enfatizó la autonomía corporal de las mujeres, rechazó culpar a las víctimas y enmarcó el aborto como un derecho personal básico. Elogió a las madres solteras y a las minorías sexuales, evitó términos sexistas y habló de forma consistente sobre la repartición de tareas domésticas, ingresos y toma de decisiones entre las parejas. En versiones más recientes basadas en GPT‑4, estas respuestas se volvieron aún más matizadas y “con tono humano”, incorporando ideas feministas y ofreciendo sugerencias concretas, como educación sobre el consentimiento y los roles de género.

Qué ocurre en conversaciones más profundas, tipo historia

El panorama cambió cuando las conversaciones se volvieron más íntimas e imaginativas. En los juegos de roles y escenas ficticias, donde se pidió a ChatGPT que actuara como madre, novio o que bosquejara una historia familiar, los filtros de sesgo incorporados con frecuencia quedaron en segundo plano. En su lugar, el sistema recurrió a patrones culturales familiares extraídos de sus datos de entrenamiento. Las novias se describían como dulces y tiernas, los novios y esposos como responsables y valientes; los padres se convertían en pilares y tomadores de decisiones, mientras que las madres eran cocineras, cuidadoras y soporte emocional. Las tramas románticas tendían por defecto a hombres persiguiendo a mujeres, y los consejos asumían silenciosamente relaciones heterosexuales a menos que el usuario lo corrigiera explícitamente. Los investigadores muestran que estos “ajustes por defecto” coinciden con lo que la teórica feminista Judith Butler llama la “matriz heterosexual”: un mundo donde sexo, género y deseo convergen en una única y estrecha forma tradicional.

Por qué las historias son especialmente complicadas para la IA

Los autores argumentan que estos deslices no son solo fallos técnicos; emergen de la forma en que se construyen los grandes modelos de lenguaje. ChatGPT no tiene cuerpo, experiencias vividas ni una percepción directa de la discriminación. Aprende patrones a partir de miles de millones de palabras en internet, donde los estereotipos de género y los roles desiguales son comunes, especialmente en la ficción. En preguntas simples y factuales, los entrenadores humanos y las reglas de seguridad pueden orientarlo hacia respuestas más equitativas. Pero cuando se le pide inventar escenas o hacer de personaje, el modelo recurre con más fuerza a esos patrones más antiguos. Sin el anclaje de la experiencia real, le cuesta “sentir” cuándo una historia normaliza la desigualdad de forma sutil, aunque las palabras no mencionen el género de manera explícita.

Qué significa esto para las personas y la política

Para un público general, el mensaje principal es claro: ChatGPT puede defender con contundencia la igualdad de género cuando se le pregunta de manera directa y evidente, pero aún así reproducir sexismo sutil en el tipo de conversaciones emocionales e individuales donde los usuarios pueden ser más vulnerables. Dado que la gente a menudo trata al chatbot como un compañero de confianza, esta inconsistencia oculta corre el riesgo de propagar viejos sesgos bajo una superficie moderna y amigable. Los autores piden métodos de prueba más robustos, datos de entrenamiento más diversos y con perspectiva feminista, y una atención más estrecha sobre cómo los prompts profundos y basados en historias modelan el comportamiento de la IA. En resumen, el estudio demuestra que importa cómo preguntamos: el modo de interrogación puede cambiar a ChatGPT entre ser un defensor de la igualdad y un reflejo acrítico de normas tradicionales.

Cita: Song, S., Liang, Z. & Zhao, W. Modes of asking as switches: prompt-driven inconsistency in ChatGPT’s gender equality perspective outputs. Humanit Soc Sci Commun 13, 478 (2026). https://doi.org/10.1057/s41599-025-05577-2

Palabras clave: sesgo de género, ChatGPT, ética de la IA, diseño de prompts, estereotipos