Clear Sky Science · zh

将医学知识纳入可解释深度学习框架以用于糖尿病胰岛素调量

更聪明的胰岛素决策为何重要

对于数以百万计的 2 型糖尿病患者来说,每天把胰岛素剂量调对是一项平衡艺术。在医院环境中,医生必须根据不断变化的血糖水平、化验结果和药物情况持续调整剂量。这既耗时又费脑力,尤其是在医护人员紧缺的情况下。强大的人工智能(AI)系统能够提供帮助,但大多数系统像一个封闭盒子:它们给出一个数值,却不展示推理过程。本研究描述了一种新的 AI 框架,它不仅推荐胰岛素剂量,还以与有经验的糖尿病专家思路相一致的方式解释其决策。

让“黑箱”助手变得可理解

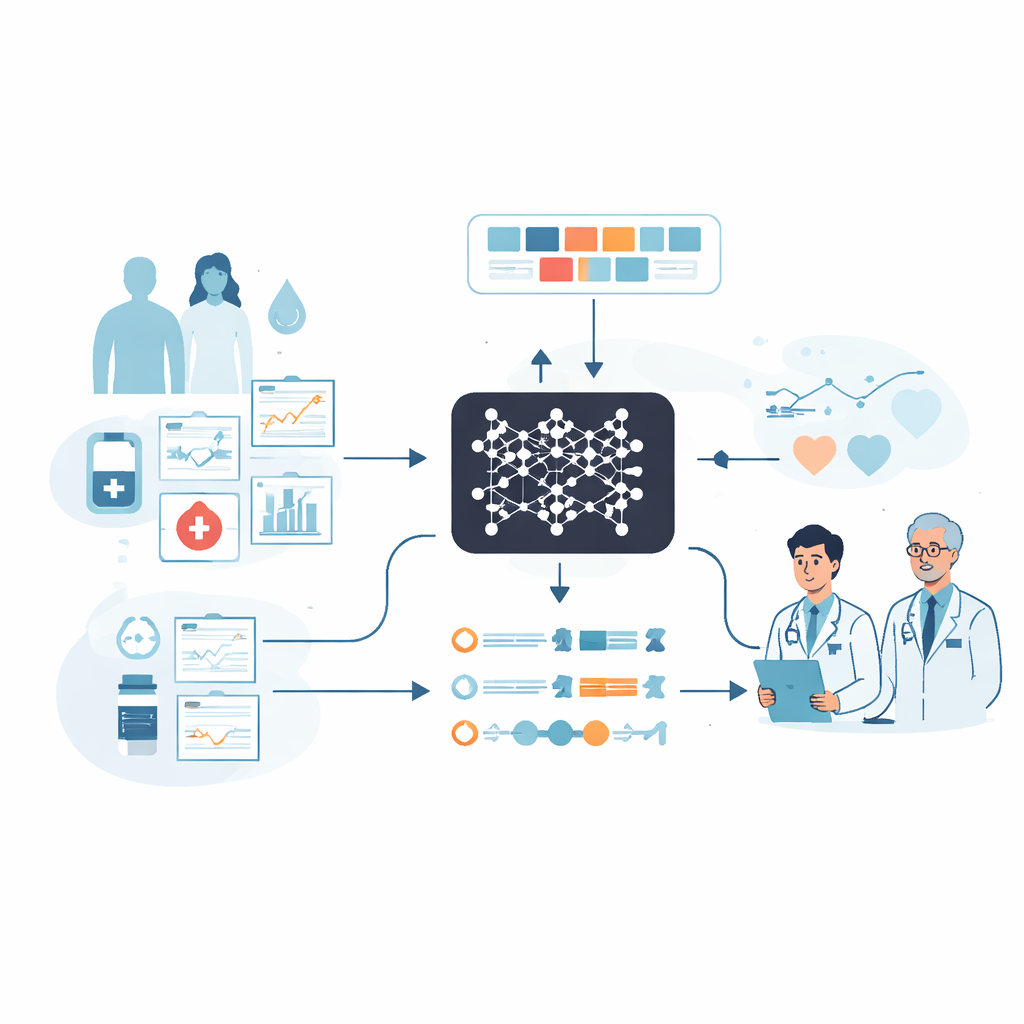

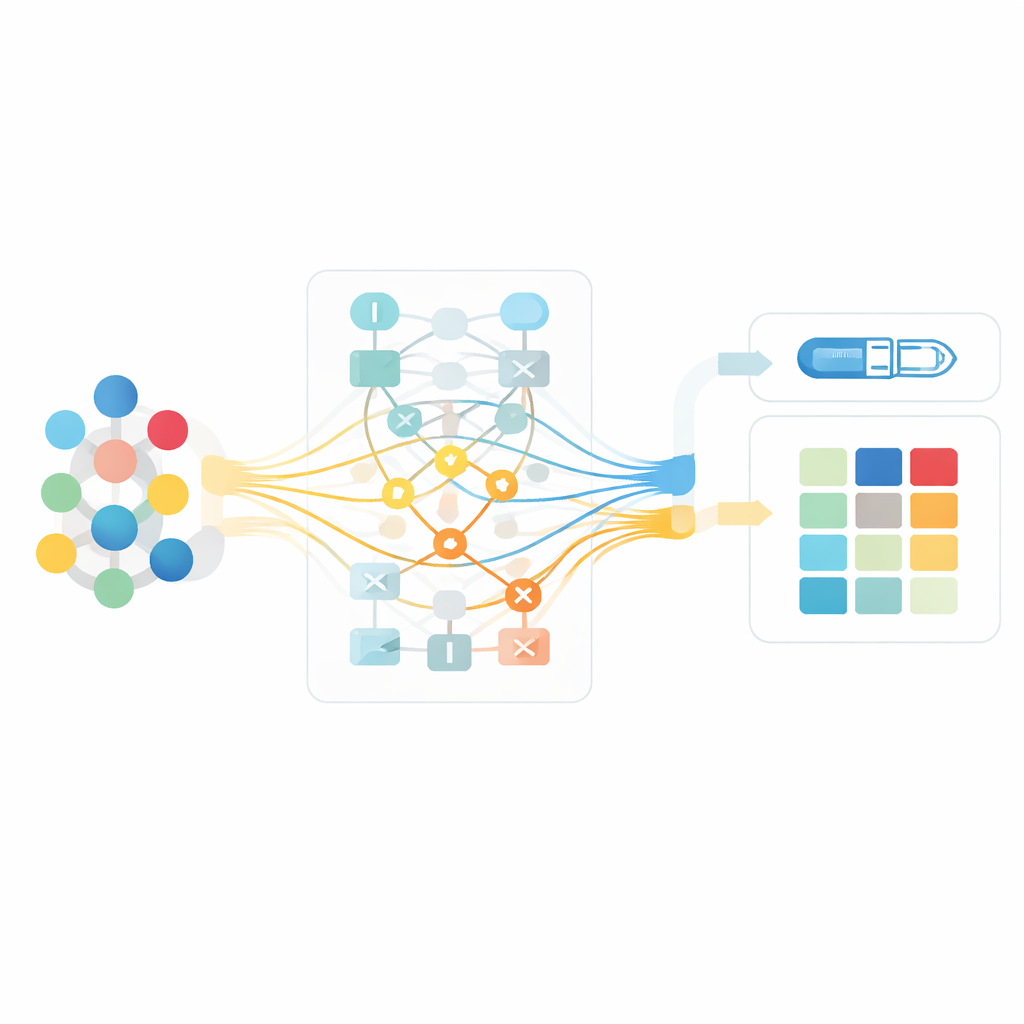

研究人员在先前开发的一种深度学习系统基础上进行扩展,该系统利用电子健康记录数据为住院的 2 型糖尿病患者预测胰岛素剂量。这些记录包括患者基本信息、全天的血糖测量、胰岛素及其他降糖药物使用情况,以及化验结果。原始模型表现良好,但无法说明为何偏好某一剂量,令许多临床医生对其依赖持谨慎态度。为弥补这一差距,团队设计了一个“可解释 AI”层,位于黑箱模型之上,将其内部机制翻译成可被人理解的要素,例如哪些血糖记录、既往胰岛素注射或患者特征对某次推荐影响最大。

看因素的组合效应,而非单独考察

大多数现有的解释工具侧重于一次只评估一个因素——例如年龄或单次血糖值——对模型预测的影响。在糖尿病护理中,这可能导致误导,因为安全的胰岛素剂量通常取决于多个因素如何相互作用,例如近期血糖趋势、肾功能、体重和既往剂量。新的框架采用了一种方法,既能捕捉个体效应,又能捕捉因素间的成对交互作用。这使其能够突出显示例如:餐后血糖偏高并伴随近期午餐胰岛素减少,会强烈提示增加下次剂量,而在另一种情境下相同的血糖值可能仅需较小的调整。

教 AI 尊重医学判断

即使是复杂的解释方法,如果仅受数据模式驱动,也可能与医学常识冲突。为解决这一问题,研究人员引入了“医生参与”流程。一个由资深内分泌科医生组成的小组反复审阅 AI 的解释,检查其强调的特征以及这些特征影响的方向和大小是否符合既定临床指南。他们的反馈被转化为明确的约束,例如:当血糖升高时不应减少胰岛素剂量,或在其他降糖药物减少时不应降低胰岛素。这些约束被纳入解释引擎并在多轮迭代中不断细化,直到专家判断系统的推理与安全且被接受的实践相符。统计检验表明,在这一过程之后,解释与已知糖尿病护理原则的符合度大幅提高,并避免了明显错误。

该系统如何影响真实世界决策

为了检验更好解释是否真能帮助临床医生,团队开展了一项研究,邀请八名医生——其中一半为初级医师、一半为更有经验的医生——在三种条件下评审真实病历:单独决策、仅看到 AI 的剂量建议、以及同时看到剂量和其解释。在所有参与者中,查看 AI 解释后,他们所选剂量与专家参考值之间的平均差距减小,且与专家方向一致并处于可接受范围内的决策比例增加。这个益处对初级医生尤为显著,他们的准确性和信心提升最大。资深医生本来表现较好,但在能看到 AI 推荐理由时仍报告感觉更有把握。

为何解释质量很重要

研究人员还测试了当 AI 的解释有误时会发生什么:他们向医生提供了刻意设计的、有缺陷的推理说明,同时剂量建议本身仍然合理。在这些情况下,表现常常变差,尤其是在初级临床医生中,AI 支持通常带来的好处消失甚至逆转。这一发现强调,解释不仅仅是表面装饰:如果解释具有误导性,可能会通过引导医生偏离自身更靠谱的判断而对护理造成伤害。因此,高质量且有医学依据的解释对于安全使用 AI 至关重要。

这对患者和临床医生意味着什么

通俗地说,该研究表明,AI 系统不仅可以被训练以推荐胰岛素剂量,还能以一种与糖尿病专家推理方式相呼应的方式“展示其工作过程”。通过将医学知识直接嵌入其解释引擎并在开发过程中持续让医生参与,该框架使 AI 建议更值得信赖且更易于审查。对患者而言,这可能转化为更安全且更一致的胰岛素调整,尤其是在经验较少的临床人员值班时。更广泛地说,这一方法为在其他复杂医疗领域构建透明 AI 工具提供了模板,有助于将黑箱式预测转变为临床决策中的协作伙伴。

引用: He, H., Ying, Z., Li, B. et al. Explainable deep learning framework incorporating medical knowledge for insulin titration in diabetes. Commun Med 6, 192 (2026). https://doi.org/10.1038/s43856-026-01449-1

关键词: 2 型糖尿病, 胰岛素剂量, 可解释 AI, 临床决策支持, 电子健康记录