Clear Sky Science · nl

Verklaarbaar deep learning‑kader met medische kennis voor insulinedosering bij diabetes

Waarom slimmer insulinebeleid telt

Voor miljoenen mensen met type 2 diabetes is het vinden van de juiste insulinedosis een dagelijkse evenwichtsoefening. In ziekenhuizen moeten artsen voortdurend doses aanpassen op basis van wisselende bloedsuikers, labuitslagen en medicatie. Dat kost veel tijd en mentale energie, vooral waar het personeel onderbezet is. Krachtige kunstmatige intelligentie (AI)-systemen kunnen daarbij helpen, maar de meeste werken als gesloten dozen: ze geven een getal zonder hun redenering te tonen. Deze studie beschrijft een nieuw AI‑kader dat niet alleen insulinedoses aanbeveelt, maar ook zijn keuzes verklaart op een manier die aansluit bij hoe ervaren diabetesspecialisten denken.

Een zwarte doos begrijpelijk maken

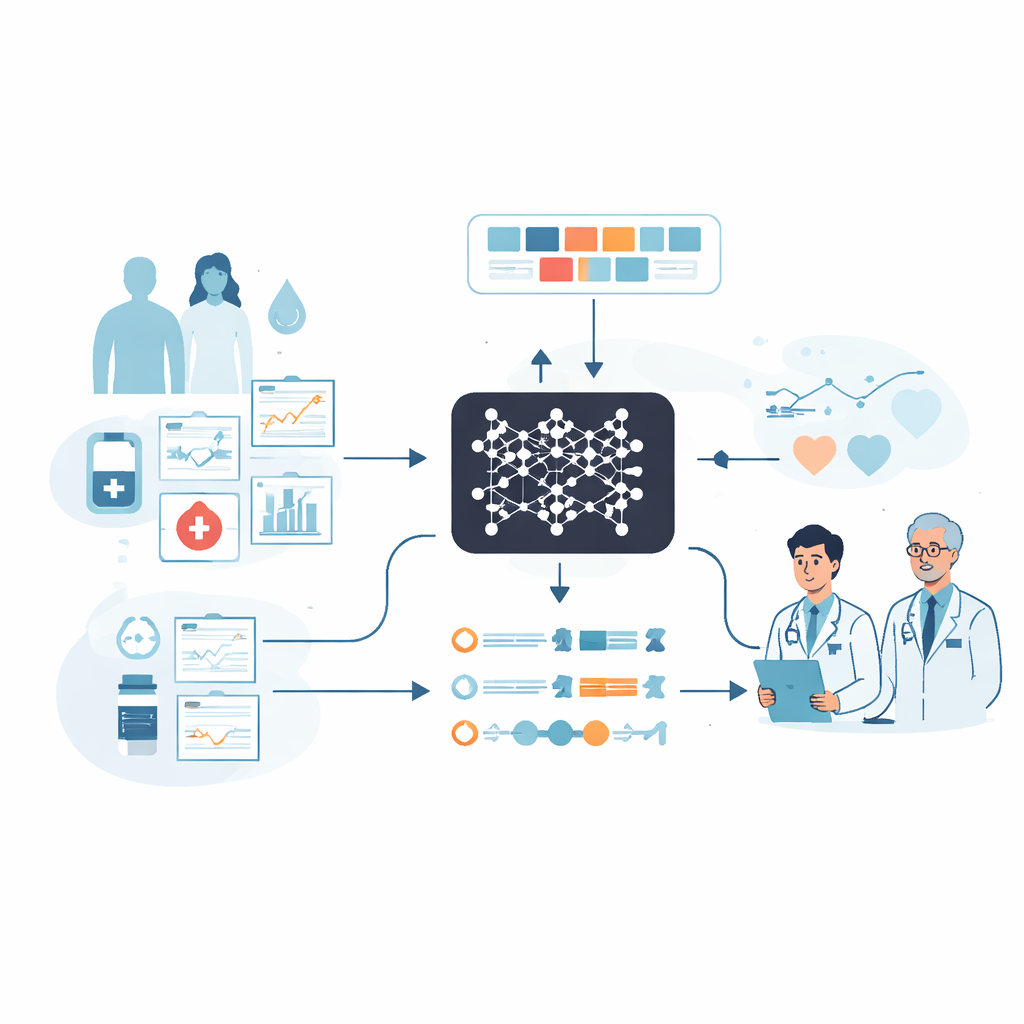

De onderzoekers bouwden voort op een eerder ontwikkeld deep learning‑systeem dat insulinedoses voorspelt voor opgenomen patiënten met type 2 diabetes, gebruikmakend van gegevens uit elektronische patiëntendossiers. Die dossiers bevatten basisgegevens van de patiënt, bloedsuikermetingen gedurende de dag, insuline en andere diabetesmedicatie, en labuitslagen. Het oorspronkelijke model presteerde goed maar kon niet laten zien waarom het de ene dosis boven de andere verkoos, waardoor veel clinici terughoudend waren het te vertrouwen. Om deze kloof te dichten, ontwierp het team een “verklaarbare AI”-laag die bovenop het zwarte‑doosmodel zit en de interne werking vertaalt naar voor mensen begrijpelijke onderdelen, zoals welke bloedsuikermetingen, eerdere insulineinjecties of patiëntkenmerken het meest bijdroegen aan een bepaalde aanbeveling.

Factoren samen bekijken, niet los

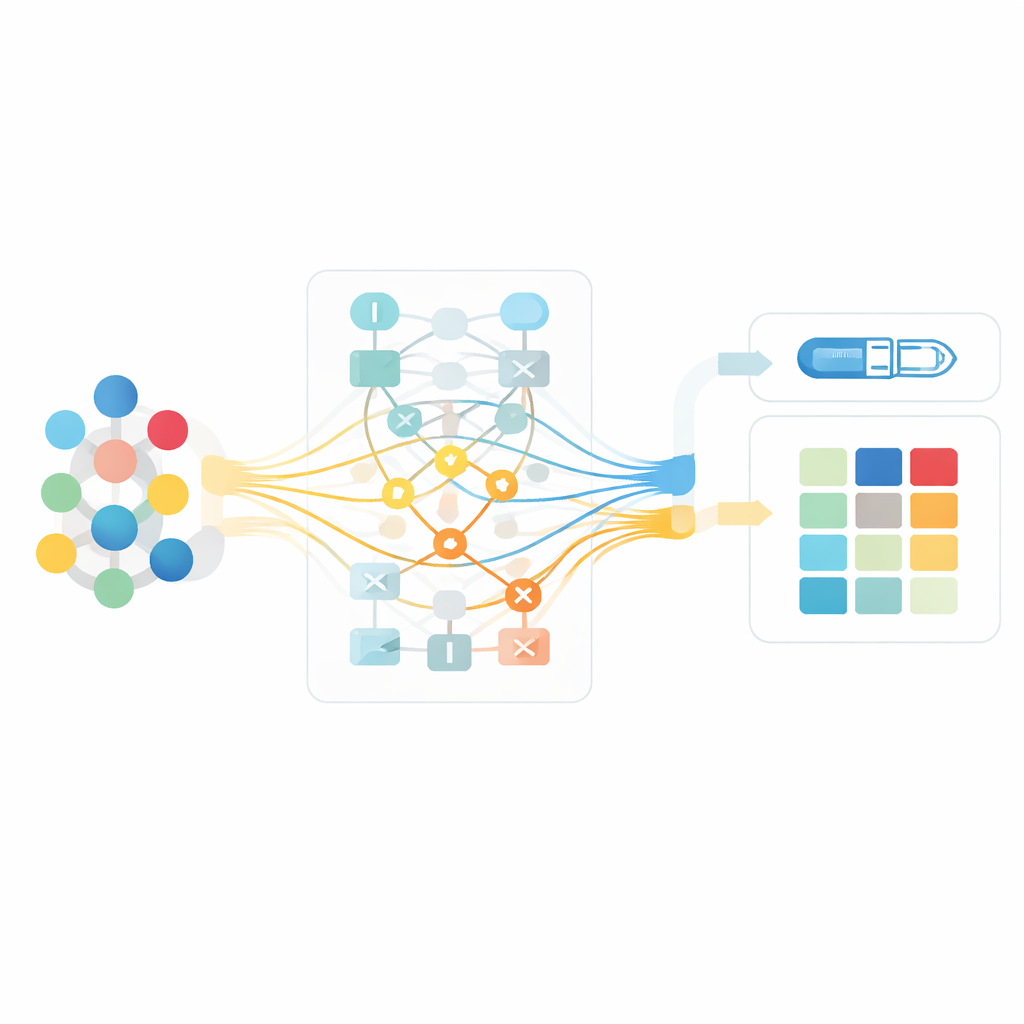

De meeste bestaande uitlegmethoden richten zich op de invloed van één factor tegelijk—bijvoorbeeld leeftijd of één bloedsuikermeting—op de voorspelling van het model. Dat kan misleidend zijn in de diabeteszorg, waar de veilige insulinedosis meestal afhangt van de samenhang tussen meerdere factoren, zoals recente bloedsuikertrends, nierfunctie, lichaamsgewicht en eerdere doses. Het nieuwe kader gebruikt een methode die zowel individuele effecten als twee‑wegsinteracties tussen factoren kan vastleggen. Daardoor kan het bijvoorbeeld laten zien hoe een hoge bloedsuiker na de lunch samen met een recente verlaging van de lunchinsuline een sterk signaal geeft om de volgende dosis te verhogen, terwijl dezelfde bloedsuiker in een andere context om een kleinere aanpassing kan vragen.

De AI leren medische oordeelsvorming te respecteren

Zelfs een geavanceerde uitlegmethode kan botsen met medische common sense als die alleen door patronen in de data wordt aangestuurd. Om dit aan te pakken introduceerden de onderzoekers een “arts in de lus”-proces. Een panel van ervaren endocrinologen beoordeelde herhaaldelijk de AI‑verklaringen en controleerde of de kenmerken die werden uitgelicht, en de richting en omvang van hun effecten, overeenkwamen met vastgestelde klinische richtlijnen. Hun feedback werd vertaald in expliciete beperkingen, zoals: insulinedoses mogen niet dalen wanneer de bloedsuiker stijgt, of wanneer andere bloedsuikerverlagende medicijnen worden verminderd. Deze beperkingen werden ingebouwd in de uitlegmodule en in meerdere rondes verfijnd totdat de experts oordeelden dat de redenering van het systeem overeenkwam met veilige en geaccepteerde praktijk. Statistische tests toonden aan dat na dit proces de verklaringen veel beter aansloten bij bekende principes van diabeteszorg en voor de hand liggende fouten vermeden.

Hoe het systeem beslissingen in de praktijk beïnvloedt

Om te onderzoeken of betere verklaringen clinici daadwerkelijk helpen, voerde het team een studie uit met acht artsen—de helft junior en de helft meer ervaren—die echte patiëntencasussen beoordeelden onder drie condities: alleen werken, alleen de AI‑dosisaanbeveling zien, en zowel de dosis als de verklaring zien. Over alle deelnemers verminderde het bekijken van de AI‑verklaring het gemiddelde verschil tussen hun gekozen dosis en een expertreferentie en nam het percentage beslissingen toe dat overeenkwam met de richting van de expert en binnen een aanvaardbaar bereik bleef. Het voordeel was vooral groot voor juniorartsen, bij wie nauwkeurigheid en vertrouwen het meest verbeterden. Seniorartsen presteerden al goed, maar rapporteerden ook meer vertrouwen wanneer ze konden zien waarom de AI een bepaalde dosis aanraadde.

Waarom de kwaliteit van verklaringen ertoe doet

De onderzoekers testten ook wat er zou gebeuren als de AI‑verklaringen onjuist waren, door artsen synthetische, opzettelijk foutieve redeneringen te tonen naast verder goede dosisaanbevelingen. In deze gevallen verslechterde de prestaties vaak, met name bij juniorclinici, en verdwenen of keerden de gebruikelijke voordelen van AI‑ondersteuning om. Deze bevinding benadrukt dat verklaringen niet slechts cosmetische toevoegingen zijn: als ze misleidend zijn, kunnen ze de zorg schaden door clinici weg te sturen van hun eigen betere oordeel. Hoogwaardige, medisch onderbouwde verklaringen zijn daarom essentieel voor veilig gebruik van AI.

Wat dit betekent voor patiënten en zorgverleners

In eenvoudige bewoordingen laat de studie zien dat een AI‑systeem niet alleen kan worden getraind om insulinedoses aan te bevelen, maar ook om "zijn werk te tonen" op een manier die aansluit bij de manier waarop diabetesspecialisten over zorg redeneren. Door medische kennis direct in de uitlegmodule te verweven en artsen gedurende de ontwikkeling te betrekken, maakt het kader AI‑suggesties betrouwbaarder en makkelijker controleerbaar. Voor patiënten kan dit leiden tot veiliger en consistenter insulineaanpassingen, vooral wanneer minder ervaren zorgverleners dienst hebben. Breder gezien biedt de aanpak een sjabloon voor het bouwen van transparante AI‑hulpmiddelen in andere complexe medische domeinen, en helpt het zwarte‑doosvoorspellingen te transformeren tot samenwerkende partners in klinische besluitvorming.

Bronvermelding: He, H., Ying, Z., Li, B. et al. Explainable deep learning framework incorporating medical knowledge for insulin titration in diabetes. Commun Med 6, 192 (2026). https://doi.org/10.1038/s43856-026-01449-1

Trefwoorden: type 2 diabetes, insulinedosering, verklaarbare AI, klinische besluitvormingondersteuning, elektronische patiëntendossiers