Clear Sky Science · de

Erklärbares Deep‑Learning‑Framework mit medizinischem Wissen zur Insulin‑Titration bei Diabetes

Warum klügere Insulinentscheidungen wichtig sind

Für Millionen Menschen mit Typ‑2‑Diabetes ist die richtige Insulindosis ein täglicher Balanceakt. In Krankenhäusern müssen Ärztinnen und Ärzte Dosen beständig an veränderte Blutzuckerwerte, Laborbefunde und Medikamente anpassen. Das ist zeitaufwendig und geistig belastend, besonders dort, wo das Personal knapp ist. Leistungsfähige Systeme der künstlichen Intelligenz (KI) können unterstützen, arbeiten aber meist wie Black‑Boxes: Sie liefern eine Zahl, ohne ihre Entscheidungswege offen zu legen. Diese Studie beschreibt ein neues KI‑Framework, das nicht nur Insulindosen empfiehlt, sondern seine Entscheidungen auch so erklärt, dass sie mit der Denkweise erfahrener Diabetesspezialistinnen und -spezialisten übereinstimmen.

Den Black‑Box‑Assistenten verständlich machen

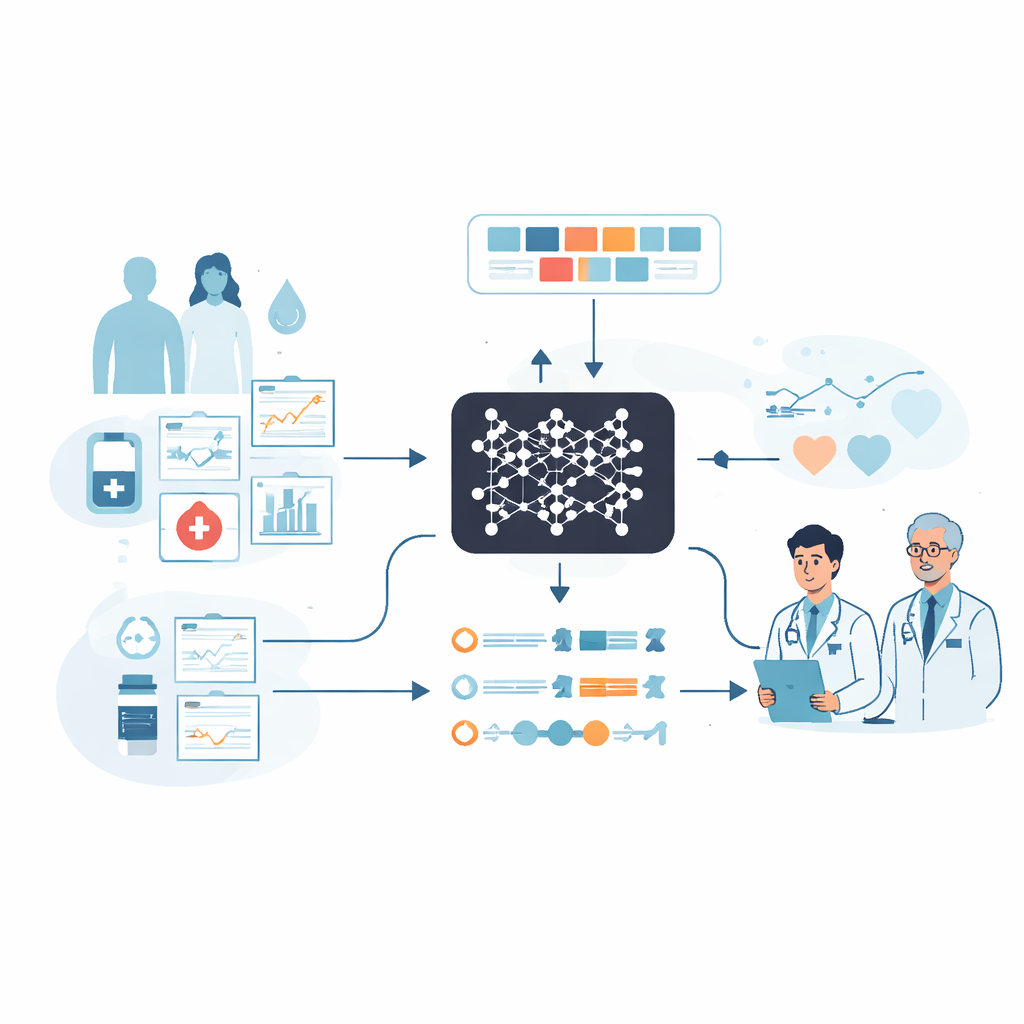

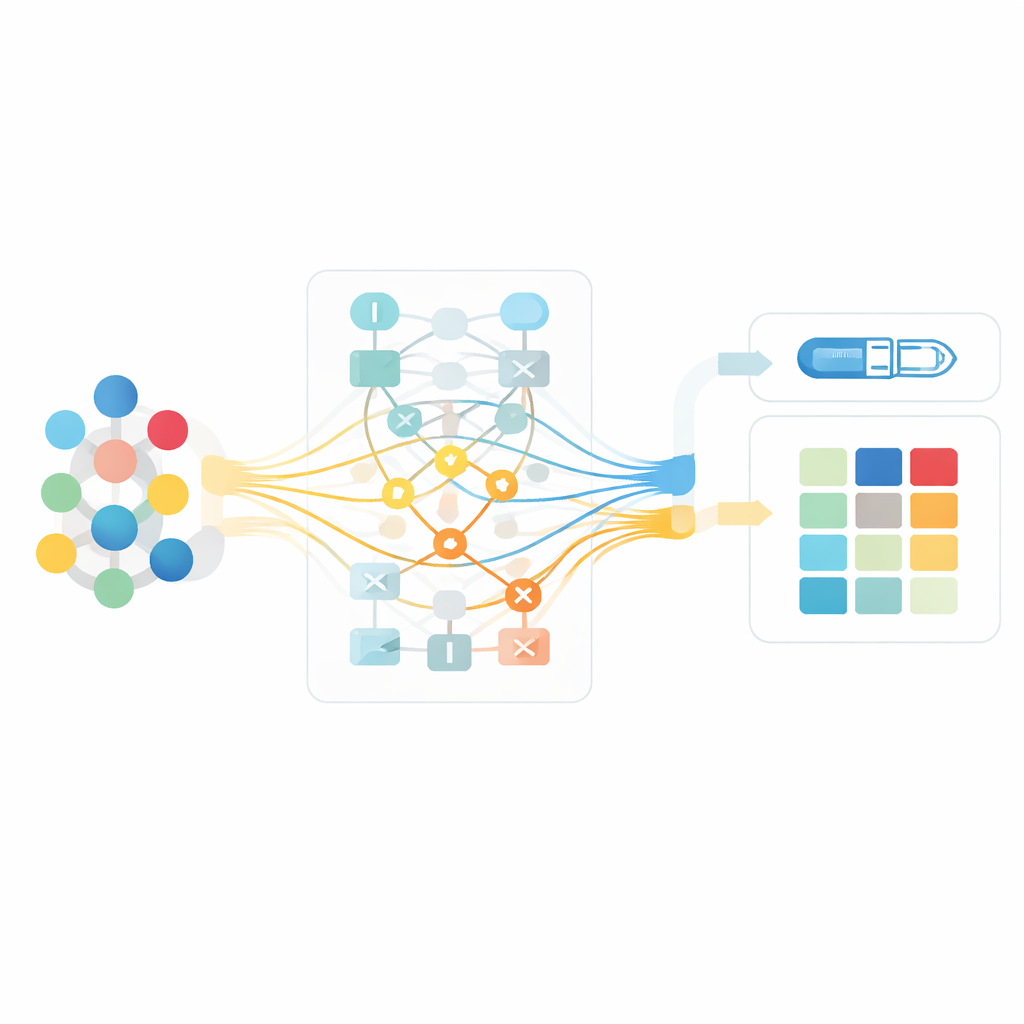

Die Forschenden bauten auf einem zuvor entwickelten Deep‑Learning‑System auf, das Insulindosen für hospitalisierte Patientinnen und Patienten mit Typ‑2‑Diabetes vorhersagt und Daten aus elektronischen Gesundheitsakten nutzt. Diese Akten enthalten grundlegende Patientendaten, Blutzuckermessungen über den Tag verteilt, Insulin‑ und andere Diabetesmedikationen sowie Laborwerte. Das ursprüngliche Modell lieferte gute Vorhersagen, konnte aber nicht darlegen, warum es eine Dosis einer anderen vorgezogen hat, weshalb viele Klinikärzte zögerten, sich darauf zu verlassen. Um diese Lücke zu schließen, entwarf das Team eine „erklärbare KI“‑Schicht, die über dem Black‑Box‑Modell liegt und dessen interne Mechanismen in für Menschen verständliche Bausteine übersetzt — etwa welche Blutzuckerwerte, frühere Insulininjektionen oder Patientenmerkmale eine bestimmte Empfehlung am stärksten beeinflusst haben.

Faktoren in Kombination betrachten, nicht isoliert

Die meisten vorhandenen Erklärungsmethoden konzentrieren sich auf den Einfluss einzelner Faktoren — etwa des Alters oder eines einzelnen Blutzuckerwerts — auf die Vorhersage des Modells. Das kann in der Diabetesversorgung irreführend sein, weil die sichere Insulindosis meist davon abhängt, wie mehrere Faktoren zusammenwirken, etwa jüngste Blutzuckertrends, Nierenfunktion, Körpergewicht und frühere Dosen. Das neue Framework verwendet eine Methode, die sowohl individuelle Effekte als auch paarweise Wechselwirkungen zwischen Faktoren erfassen kann. So lässt sich beispielsweise darstellen, wie ein hoher Blutzucker nach dem Mittagessen zusammen mit einer kürzlich reduzierten Mittagsinsulindosis ein starkes Signal für eine Erhöhung der nächsten Dosis gibt, während derselbe Blutzucker in einem anderen Kontext nur eine kleinere Anpassung nahelegen könnte.

Die KI auf medizinisches Urteilsvermögen trimmen

Selbst eine ausgefeilte Erklärmethode kann dem medizinischen gesunden Menschenverstand widersprechen, wenn sie allein von Mustern in den Daten getrieben wird. Um dem entgegenzuwirken, führten die Forschenden einen „Arzt‑im‑Loop“‑Prozess ein. Ein Gremium erfahrener Endokrinologinnen und Endokrinologen überprüfte wiederholt die Erklärungen der KI und prüfte, ob die hervorgehobenen Merkmale sowie Richtung und Größe ihrer Effekte mit etablierten klinischen Leitlinien übereinstimmen. Ihr Feedback wurde in explizite Einschränkungen übersetzt, etwa: Insulindosen sollten nicht sinken, wenn der Blutzucker steigt, oder wenn andere blutzuckersenkende Medikamente reduziert werden. Diese Einschränkungen wurden in die Erklärungsschicht eingebaut und über mehrere Runden verfeinert, bis die Fachleute die Schlussfolgerungen des Systems als mit sicherer und akzeptierter Praxis vereinbar bewerteten. Statistische Tests zeigten, dass die Erklärungen nach diesem Prozess wesentlich besser mit bekannten Prinzipien der Diabetestherapie übereinstimmten und offensichtliche Fehler vermieden.

Wie das System reale Entscheidungen beeinflusst

Um zu prüfen, ob bessere Erklärungen Klinikpersonal tatsächlich helfen, führten die Forschenden eine Studie mit acht Ärztinnen und Ärzten durch — je zur Hälfte Juniors und Erfahrene —, die reale Patientenfälle unter drei Bedingungen bewerteten: allein arbeitend, nur mit der Dosisempfehlung der KI und mit Dosis plus Erklärung. Bei allen Teilnehmenden verringerte das Anzeigen der KI‑Erklärung den durchschnittlichen Abstand zwischen ihrer gewählten Dosis und einer Expertenreferenz und erhöhte den Anteil der Entscheidungen, die mit der Expertenrichtung übereinstimmten und in einem akzeptablen Bereich lagen. Der Nutzen zeigte sich besonders stark bei den Juniorärztinnen und -ärzten, deren Genauigkeit und Vertrauen am stärksten zunahmen. Erfahrene Ärztinnen und Ärzte schnitten bereits gut ab, berichteten jedoch ebenfalls über ein größeres Vertrauen, wenn sie nachvollziehen konnten, warum die KI eine bestimmte Dosis empfohlen hatte.

Warum die Qualität der Erklärung zählt

Die Forschenden untersuchten auch, was passiert, wenn die KI‑Erklärungen fehlerhaft sind, indem sie den Ärztinnen und Ärzten synthetische, absichtlich falsche Begründungen zusammen mit ansonsten guten Dosisvorschlägen präsentierten. In diesen Fällen verschlechterte sich die Leistung häufig, insbesondere bei den Junior‑Klinikerinnen und -Klinikern, und die üblichen Vorteile der KI‑Unterstützung entfielen oder kehrten sich um. Dieser Befund unterstreicht, dass Erklärungen nicht nur ein kosmetischer Zusatz sind: Sind sie irreführend, können sie die Versorgung schädigen, indem sie Fachpersonal von besserem eigenem Urteil abbringen. Hochwertige, medizinisch fundierte Erklärungen sind daher für den sicheren Einsatz von KI unerlässlich.

Was das für Patientinnen, Patienten und Klinikpersonal bedeutet

Einfach gesagt zeigt die Studie, dass ein KI‑System nicht nur darauf trainiert werden kann, Insulindosen zu empfehlen, sondern auch, seine «Rechnung» so offenzulegen, dass sie mit der Denkweise von Diabetesspezialistinnen und -spezialisten übereinstimmt. Indem medizinisches Wissen direkt in die Erklärungsschicht eingewoben und Ärztinnen und Ärzte während der gesamten Entwicklung einbezogen wurden, macht das Framework KI‑Vorschläge vertrauenswürdiger und leichter prüfbar. Für Patientinnen und Patienten könnte das sicherere und konsistentere Insulinanpassungen bedeuten, insbesondere wenn weniger erfahrenes Klinikpersonal im Dienst ist. Allgemeiner bietet der Ansatz eine Blaupause für den Aufbau transparenter KI‑Werkzeuge in anderen komplexen Bereichen der Medizin und hilft, Black‑Box‑Vorhersagen in kooperative Partner bei klinischen Entscheidungen zu verwandeln.

Zitation: He, H., Ying, Z., Li, B. et al. Explainable deep learning framework incorporating medical knowledge for insulin titration in diabetes. Commun Med 6, 192 (2026). https://doi.org/10.1038/s43856-026-01449-1

Schlüsselwörter: Typ‑2‑Diabetes, Insulindosierung, erklärbare KI, klinische Entscheidungsunterstützung, elektronische Gesundheitsakten