Clear Sky Science · es

Marco explicable de aprendizaje profundo que incorpora conocimiento médico para la titulación de insulina en la diabetes

Por qué importan decisiones de insulina más inteligentes

Para millones de personas con diabetes tipo 2, ajustar correctamente la dosis de insulina es un equilibrio diario. En los hospitales, los médicos deben ajustar las dosis constantemente en función de los niveles de glucosa cambiantes, las pruebas de laboratorio y los medicamentos. Esto consume mucho tiempo y supone una carga mental, sobre todo donde el personal está escaso. Los potentes sistemas de inteligencia artificial (IA) pueden ayudar, pero la mayoría funcionan como cajas cerradas: producen un número sin mostrar su razonamiento. Este estudio describe un nuevo marco de IA que no solo recomienda dosis de insulina, sino que además explica sus elecciones de un modo coherente con la forma de pensar de especialistas en diabetes experimentados.

Entendiendo a un asistente en caja negra

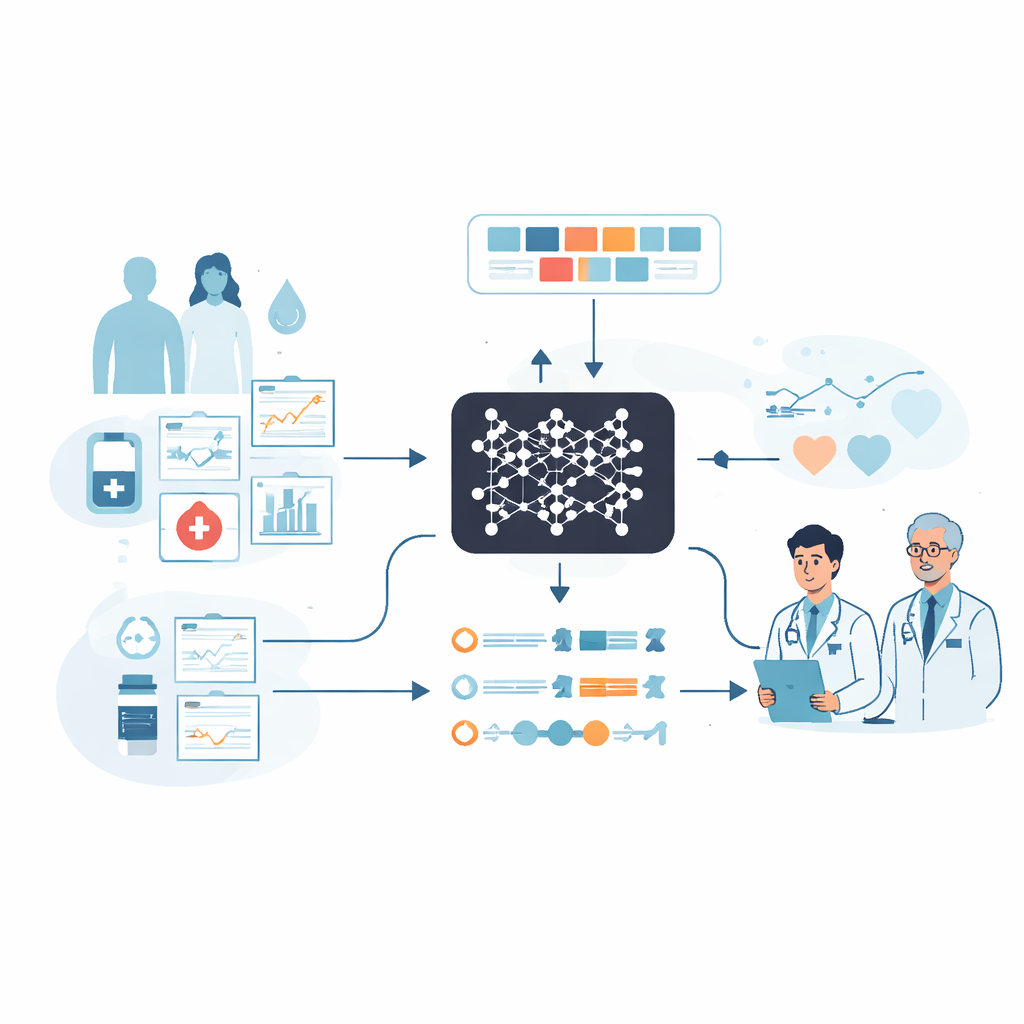

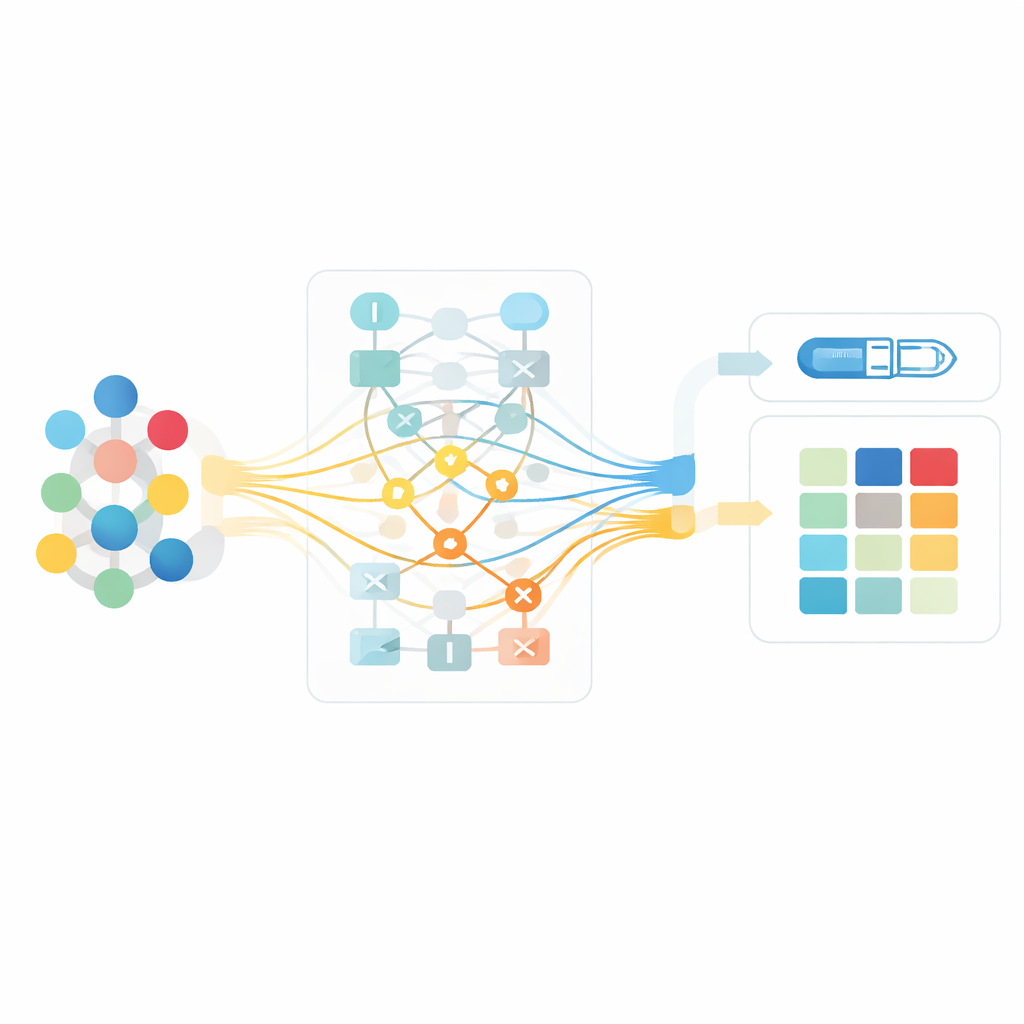

Los investigadores partieron de un sistema de aprendizaje profundo previamente desarrollado que predice dosis de insulina para pacientes hospitalizados con diabetes tipo 2, usando datos de historias clínicas electrónicas. Estos registros incluyen datos básicos del paciente, lecturas de glucemia a lo largo del día, insulina y otros fármacos antidiabéticos, y resultados de laboratorio. El modelo original funcionaba bien pero no podía mostrar por qué prefería una dosis sobre otra, lo que llevó a muchos clínicos a desconfiar. Para cerrar esta brecha, el equipo diseñó una capa de “IA explicable” que se sitúa encima del modelo de caja negra y traduce su funcionamiento interno en piezas comprensibles para humanos, como qué registros de glucemia, inyecciones previas de insulina o características del paciente influyeron más en una recomendación concreta.

Analizar factores en combinación, no de forma aislada

La mayoría de las herramientas de explicación existentes se centran en el impacto de un factor a la vez —por ejemplo, la edad o un único valor de glucemia— sobre la predicción del modelo. Eso puede inducir a error en la atención de la diabetes, donde la dosis segura de insulina suele depender de cómo interactúan varios factores, como las tendencias recientes de glucosa, la función renal, el peso corporal y dosis previas. El nuevo marco emplea un método capaz de capturar tanto efectos individuales como interacciones por pares entre factores. Esto le permite destacar, por ejemplo, cómo una glucemia alta después del almuerzo junto con una reducción reciente de la insulina en esa comida envía una señal clara para aumentar la siguiente dosis, mientras que la misma glucemia en otro contexto podría requerir un cambio menor.

Enseñar a la IA a respetar el juicio médico

Aun un método de explicación sofisticado puede chocar con el sentido común médico si se guía únicamente por patrones en los datos. Para afrontarlo, los investigadores introdujeron un proceso de “médico en el bucle”. Un panel de endocrinólogos experimentados revisó repetidamente las explicaciones de la IA, comprobando si las características resaltadas y la dirección y magnitud de sus efectos concordaban con las guías clínicas establecidas. Sus comentarios se tradujeron en restricciones explícitas, como: las dosis de insulina no deberían disminuir cuando la glucemia aumenta, o cuando otros fármacos hipoglucemiantes se reducen. Estas restricciones se incorporaron al motor de explicaciones y se refinaron en varias rondas hasta que los expertos consideraron que el razonamiento del sistema coincidía con una práctica segura y aceptada. Las pruebas estadísticas mostraron que, tras este proceso, las explicaciones concordaban mucho mejor con los principios conocidos del cuidado de la diabetes y evitaban errores evidentes.

Cómo el sistema afecta decisiones en el mundo real

Para evaluar si las mejores explicaciones realmente ayudan a los clínicos, el equipo realizó un estudio con ocho médicos —la mitad juniors y la otra mitad más experimentados— que revisaron casos reales de pacientes bajo tres condiciones: trabajando solos, viendo solo la sugerencia de dosis de la IA, y viendo tanto la dosis como su explicación. En todos los participantes, ver la explicación de la IA redujo la diferencia promedio entre la dosis elegida por el médico y una referencia experta e incrementó el porcentaje de decisiones que coincidían en la dirección con el experto y se mantenían dentro de un rango aceptable. El beneficio fue especialmente marcado para los médicos jóvenes, cuya precisión y confianza mejoraron más. Los médicos senior ya tenían buen desempeño, pero también manifestaron mayor confianza al poder ver por qué la IA recomendó una dosis concreta.

Por qué importa la calidad de la explicación

Los investigadores también probaron qué ocurriría si las explicaciones de la IA fuesen incorrectas, presentando a los médicos razonamientos sintéticos y deliberadamente defectuosos junto con sugerencias de dosis por lo demás adecuadas. En esos casos el rendimiento a menudo empeoró, particularmente entre los clínicos junior, y los beneficios habituales del apoyo de la IA desaparecieron o incluso se invirtieron. Este hallazgo subraya que las explicaciones no son un adorno: si inducen a error, pueden perjudicar la atención desviando a los clínicos de su propio juicio más acertado. Por tanto, son esenciales explicaciones de alta calidad y fundamentadas médicamente para un uso seguro de la IA.

Qué significa esto para pacientes y clínicos

En términos prácticos, el estudio muestra que un sistema de IA puede entrenarse no solo para recomendar dosis de insulina, sino también para “mostrar su trabajo” de un modo que resuene con la forma en que los especialistas en diabetes razonan sobre la atención. Al integrar el conocimiento médico directamente en su motor de explicaciones e involucrar a los médicos a lo largo del desarrollo, el marco hace que las sugerencias de la IA sean más confiables y más fáciles de escrutar. Para los pacientes, esto podría traducirse en ajustes de insulina más seguros y consistentes, especialmente cuando hay clínicos menos experimentados de guardia. En un sentido más amplio, el enfoque ofrece un modelo para construir herramientas de IA transparentes en otras áreas médicas complejas, ayudando a transformar predicciones de caja negra en socios colaborativos en la toma de decisiones clínicas.

Cita: He, H., Ying, Z., Li, B. et al. Explainable deep learning framework incorporating medical knowledge for insulin titration in diabetes. Commun Med 6, 192 (2026). https://doi.org/10.1038/s43856-026-01449-1

Palabras clave: diabetes tipo 2, dosificación de insulina, IA explicable, soporte a la decisión clínica, historias clínicas electrónicas