Clear Sky Science · fr

Cadre d’apprentissage profond explicable intégrant des connaissances médicales pour l’ajustement de l’insuline dans le diabète

Pourquoi des décisions d’insuline plus intelligentes comptent

Pour des millions de personnes vivant avec un diabète de type 2, trouver la bonne dose d’insuline est un exercice d’équilibre quotidien. À l’hôpital, les médecins doivent ajuster en permanence les doses en fonction de l’évolution de la glycémie, des analyses et des traitements—c’est chronophage et mentalement exigeant, en particulier lorsque le personnel est peu nombreux. Des systèmes puissants d’intelligence artificielle (IA) peuvent aider, mais la plupart fonctionnent comme des boîtes noires : ils fournissent un chiffre sans en exposer le raisonnement. Cette étude décrit un nouveau cadre d’IA qui non seulement recommande des doses d’insuline, mais explique aussi ses choix d’une manière qui concorde avec la façon de penser des spécialistes expérimentés du diabète.

Donner du sens à un assistant boîte noire

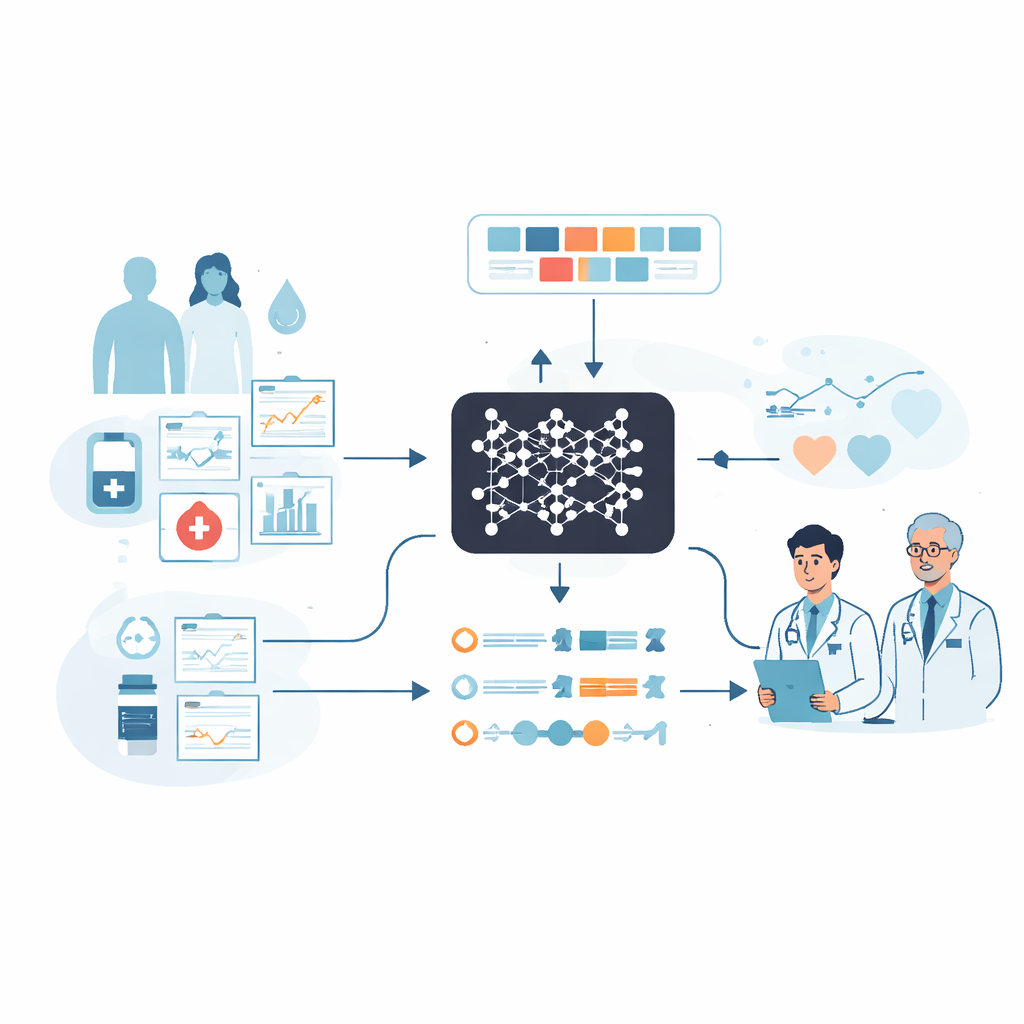

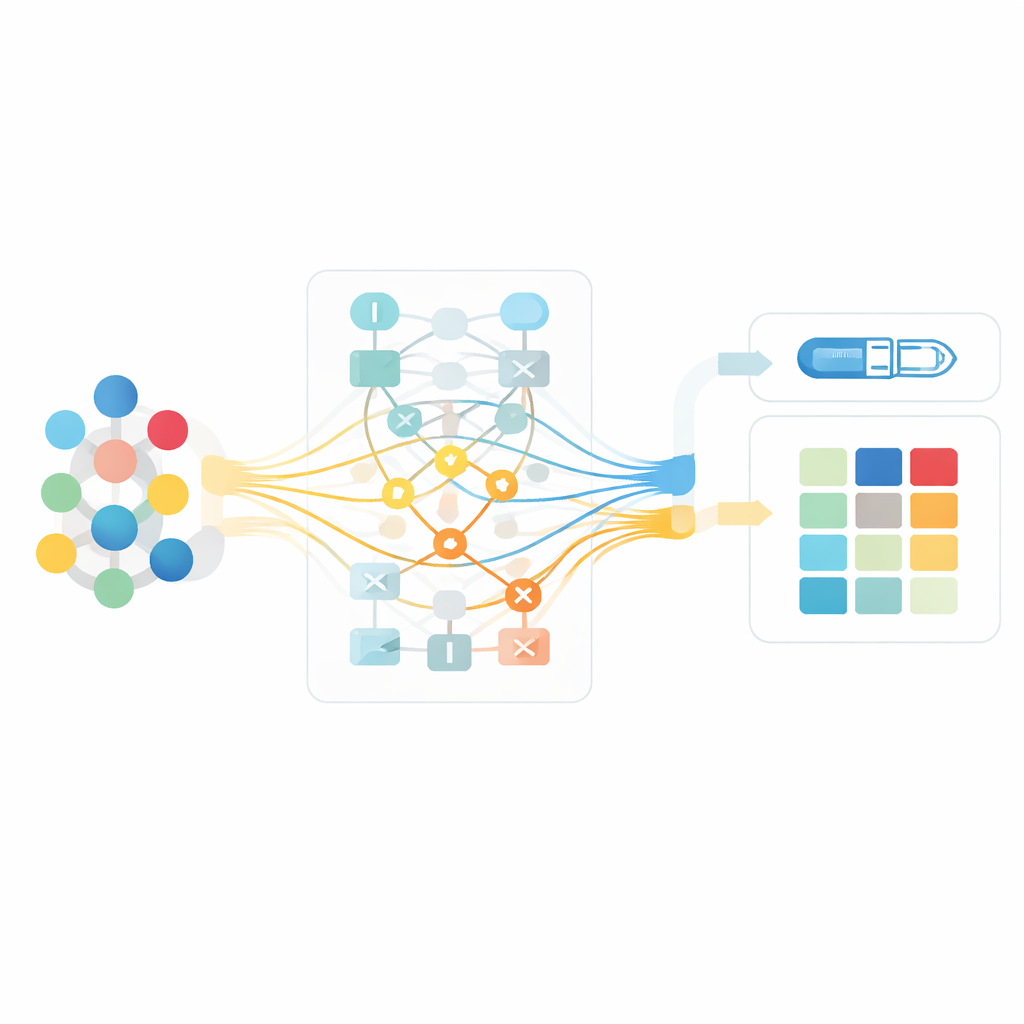

Les chercheurs se sont appuyés sur un système d’apprentissage profond préexistant qui prédit les doses d’insuline pour des patients hospitalisés atteints de diabète de type 2, en utilisant des données issues des dossiers de santé électroniques. Ces dossiers comprennent des informations démographiques de base, des mesures de glycémie tout au long de la journée, l’insuline et d’autres médicaments antidiabétiques, ainsi que les résultats d’analyses biologiques. Le modèle original obtenait de bonnes performances mais ne pouvait pas expliquer pourquoi il privilégiait une dose plutôt qu’une autre, ce qui rendait de nombreux cliniciens réticents à s’y fier. Pour combler cette lacune, l’équipe a conçu une couche d’« IA explicable » qui s’intercale au‑dessus du modèle boîte noire et traduit son fonctionnement interne en éléments compréhensibles par des humains, tels que quelles valeurs de glycémie, quelles injections d’insuline antérieures ou quelles caractéristiques du patient ont le plus influencé une recommandation donnée.

Examiner les facteurs en combinaison, pas isolément

La plupart des outils d’explication existants se concentrent sur l’impact d’un seul facteur à la fois—par exemple l’âge ou une valeur unique de glycémie—sur la prédiction du modèle. Cela peut induire en erreur en soin du diabète, où la dose sûre d’insuline dépend généralement de la façon dont plusieurs facteurs interagissent, tels que les tendances récentes de la glycémie, la fonction rénale, le poids corporel et les doses précédentes. Le nouveau cadre utilise une méthode capable de saisir à la fois les effets individuels et les interactions par paires entre facteurs. Cela lui permet de mettre en évidence, par exemple, comment une glycémie élevée après le déjeuner combinée à une récente diminution de l’insuline de midi envoie un signal fort pour augmenter la dose suivante, alors que la même glycémie dans un autre contexte pourrait nécessiter un ajustement moindre.

Apprendre à l’IA à respecter le jugement médical

Même une méthode d’explication sophistiquée peut entrer en conflit avec le bon sens médical si elle se contente de reproduire des motifs présents dans les données. Pour y remédier, les chercheurs ont introduit un processus de « médecin dans la boucle ». Un panel d’endocrinologues expérimentés a examiné à plusieurs reprises les explications de l’IA, vérifiant si les caractéristiques mises en avant, ainsi que la direction et l’amplitude de leurs effets, étaient en accord avec les recommandations cliniques établies. Leurs retours ont été traduits en contraintes explicites, telles que : les doses d’insuline ne doivent pas diminuer lorsque la glycémie augmente, ou lorsqu’un autre médicament hypoglycémiant est réduit. Ces contraintes ont été intégrées au moteur d’explication et affinées sur plusieurs itérations jusqu’à ce que les experts jugent que le raisonnement du système correspondait à une pratique sûre et acceptée. Des tests statistiques ont montré qu’après ce processus, les explications s’alignaient beaucoup mieux sur les principes connus de la prise en charge du diabète et évitaient des erreurs évidentes.

Comment le système influence les décisions en pratique

Pour évaluer si de meilleures explications aident réellement les cliniciens, l’équipe a mené une étude impliquant huit médecins—la moitié juniors et la moitié plus expérimentés—qui ont examiné des cas réels de patients dans trois conditions : seuls, en voyant uniquement la suggestion de dose de l’IA, et en voyant à la fois la dose et son explication. Chez l’ensemble des participants, la consultation de l’explication de l’IA a réduit l’écart moyen entre la dose choisie et une référence d’expert et a augmenté le pourcentage de décisions qui concordaient dans la bonne direction avec l’expert et restaient dans une plage acceptable. Le bénéfice a été particulièrement marqué pour les médecins juniors, dont la précision et la confiance se sont le plus améliorées. Les médecins seniors obtenaient déjà de bonnes performances, mais ont néanmoins déclaré se sentir plus confiants lorsqu’ils pouvaient voir pourquoi l’IA recommandait une certaine dose.

Pourquoi la qualité des explications importe

Les chercheurs ont aussi testé ce qui se passerait si les explications de l’IA étaient erronées, en présentant aux médecins un raisonnement synthétique et délibérément biaisé en parallèle de suggestions de dose pourtant valables. Dans ces situations, les performances se sont souvent dégradées, notamment chez les cliniciens juniors, et les bénéfices habituels du soutien IA ont disparu voire se sont inversés. Ce résultat souligne que les explications ne sont pas un simple ornement : si elles induisent en erreur, elles peuvent nuire aux soins en éloignant les cliniciens de leur propre jugement supérieur. Des explications de haute qualité, solidement ancrées médicalement, sont donc essentielles pour un usage sûr de l’IA.

Ce que cela signifie pour les patients et les cliniciens

En termes concrets, l’étude montre qu’un système d’IA peut être entraîné non seulement pour recommander des doses d’insuline, mais aussi pour « montrer son raisonnement » d’une manière qui résonne avec la façon dont les spécialistes du diabète réfléchissent aux soins. En intégrant les connaissances médicales directement dans son moteur d’explication et en impliquant les médecins tout au long du développement, le cadre rend les suggestions de l’IA plus fiables et plus faciles à examiner. Pour les patients, cela pourrait se traduire par des ajustements d’insuline plus sûrs et plus cohérents, en particulier lorsque des cliniciens moins expérimentés sont de garde. Plus largement, l’approche offre un modèle pour construire des outils d’IA transparents dans d’autres domaines médicaux complexes, transformant des prédictions en boîte noire en partenaires collaboratifs pour la prise de décision clinique.

Citation: He, H., Ying, Z., Li, B. et al. Explainable deep learning framework incorporating medical knowledge for insulin titration in diabetes. Commun Med 6, 192 (2026). https://doi.org/10.1038/s43856-026-01449-1

Mots-clés: diabète de type 2, posologie de l’insuline, IA explicable, aide à la décision clinique, dossiers de santé électroniques