Clear Sky Science · sv

Förklarbart djupinlärningsramverk som införlivar medicinsk kunskap för insulinjustering vid diabetes

Varför smartare insulinbeslut är viktiga

För miljontals människor som lever med typ 2‑diabetes är det en daglig balansakt att få insulindosen rätt. På sjukhus måste läkare ständigt justera doserna utifrån skiftande blodsockernivåer, laboratorietester och läkemedel. Det tar tid och är mentalt krävande, särskilt där personalen är knappt tilltagen. Kraftfulla system för artificiell intelligens (AI) kan hjälpa, men de flesta fungerar som slutna lådor: de ger ett tal utan att visa sitt resonemang. Denna studie beskriver ett nytt AI‑ramverk som inte bara rekommenderar insulindoser utan också förklarar sina val på ett sätt som ligger i linje med hur erfarna diabetespecialister resonerar.

Att göra en svart låda begriplig

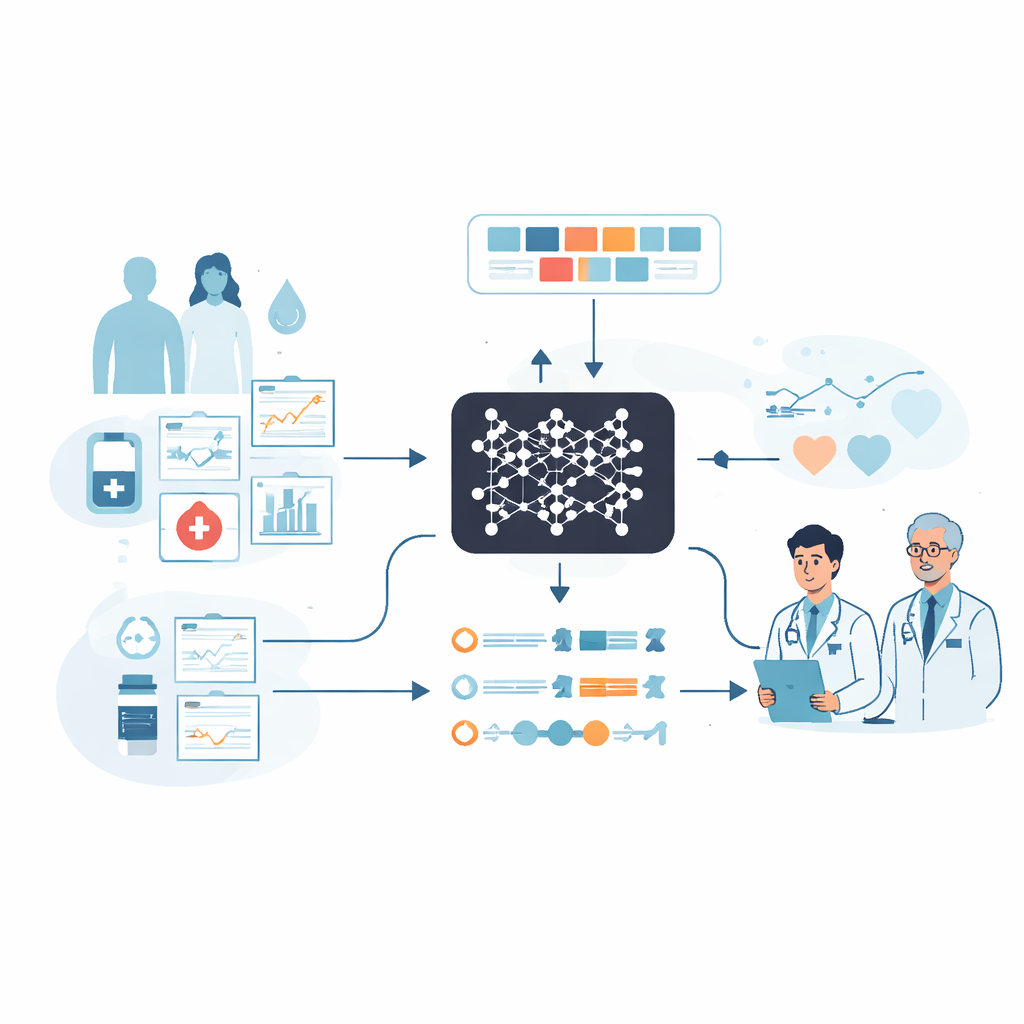

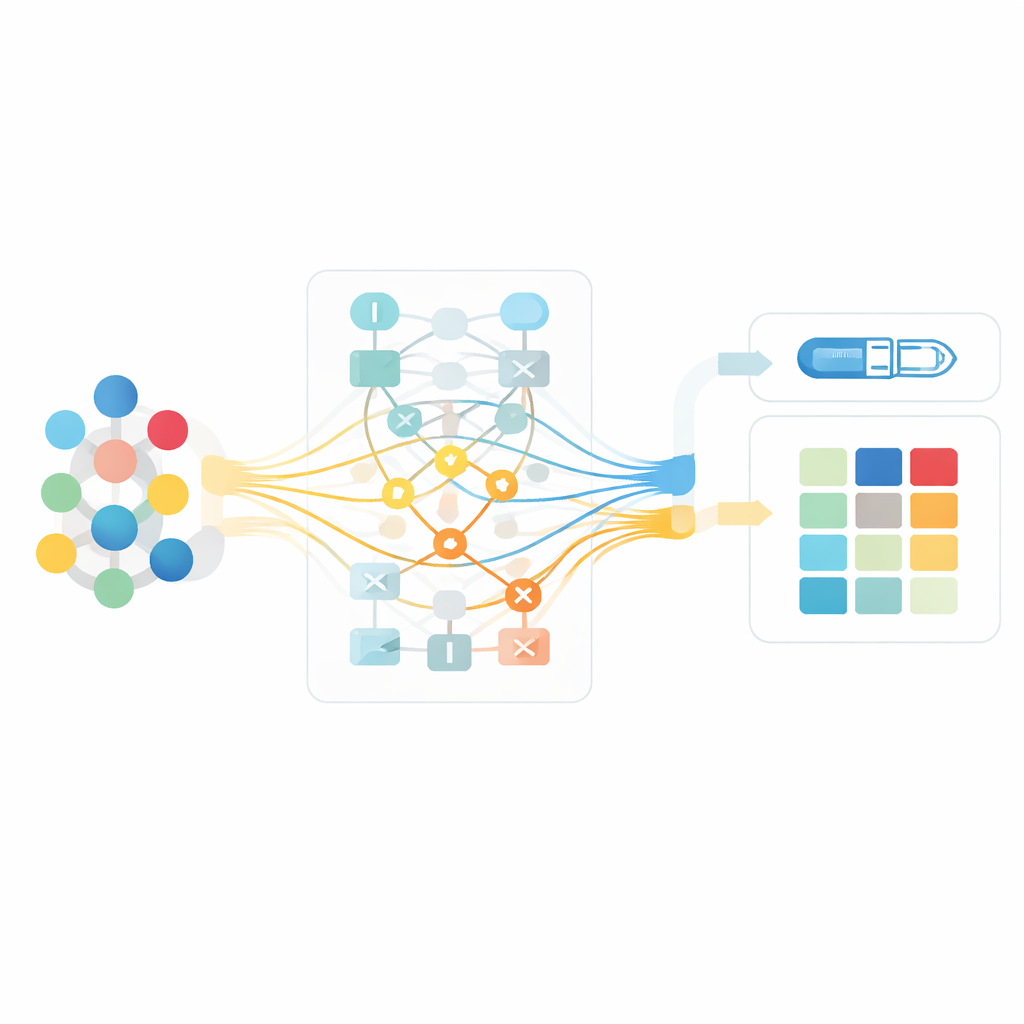

Forskarna byggde vidare på ett tidigare utvecklat djupinlärningssystem som förutsäger insulindoser för inneliggande patienter med typ 2‑diabetes, med data från elektroniska journaler. Dessa journaler innehåller grundläggande patientuppgifter, blodsockermätningar under dagen, insulin och andra diabetesläkemedel samt laboratorieresultat. Den ursprungliga modellen presterade bra men kunde inte visa varför den föredrog en dos framför en annan, vilket gjorde många kliniker tveksamma till att förlita sig på den. För att överbrygga detta gap designade teamet ett "förklarbart AI"‑lager som ligger ovanpå den svarta lådemodellen och översätter dess inre arbete till mänskligt begripliga delar, såsom vilka blodsocksregistreringar, tidigare insulininjektioner eller patientegenskaper som mest påverkade en viss rekommendation.

Titta på faktorer i kombination, inte var för sig

De flesta befintliga förklaringsverktyg fokuserar på påverkan av en faktor i taget—till exempel ålder eller ett enskilt blodsockervärde—på modellens förutsägelse. Det kan vara missvisande inom diabetesvården, där en säker insulindos oftast beror på hur flera faktorer samverkar, som senaste blodsockertrender, njurfunktion, kroppsvikt och tidigare doser. Det nya ramverket använder en metod som kan fånga både individuella effekter och parvisa interaktioner mellan faktorer. Det gör det möjligt att lyfta fram, till exempel, hur ett högt blodsocker efter lunch tillsammans med en nylig minskning av lunchinsulinet ger en stark signal att öka nästa dos, medan samma blodsocker i ett annat sammanhang kan kräva en mindre förändring.

Att lära AI att respektera medicinskt omdöme

Även en avancerad förklaringsmetod kan stå i konflikt med medicinsk sund förnuft om den bara drivs av mönster i data. För att hantera detta införde forskarna en "doktor‑i‑slingan"‑process. En panel av erfarna endokrinologer granskade upprepade gånger AI:ns förklaringar och kontrollerade om de funktioner som lyftes fram samt riktningen och storleken på deras effekter överensstämde med etablerade kliniska riktlinjer. Deras återkoppling översattes till explicita begränsningar, till exempel: insulindoser bör inte minska när blodsockret stiger, eller när andra blodsockersänkande läkemedel minskas. Dessa begränsningar byggdes in i förklaringsmotorn och förfinades över flera omgångar tills experterna bedömde att systemets resonemang överensstämde med säker och accepterad praxis. Statistiska tester visade att förklaringarna efter denna process stämde betydligt bättre överens med kända principer för diabetesvård och undvek uppenbara misstag.

Hur systemet påverkar beslut i verkligheten

För att se om bättre förklaringar faktiskt hjälper kliniker genomförde teamet en studie med åtta läkare—hälften yngre och hälften mer erfarna—som granskade verkliga patientfall under tre förhållanden: att arbeta ensam, att endast se AI:ns dosförslag och att se både dosen och dess förklaring. Bland alla deltagare minskade visningen av AI‑förklaringen den genomsnittliga skillnaden mellan deras valda dos och en expertreferens och ökade andelen beslut som matchade expertens riktning och låg inom ett acceptabelt intervall. Vinsten var särskilt stark för yngre läkare, vars noggrannhet och självförtroende förbättrades mest. Seniora läkare presterade redan väl, men rapporterade ändå ökat förtroende när de kunde se varför AI rekommenderade en viss dos.

Varför förklaringskvalitet spelar roll

Forskarna testade också vad som skulle hända om AI:ns förklaringar var felaktiga, genom att ge läkare syntetiskt, avsiktligt felaktigt resonemang tillsammans med annars bra dosförslag. I dessa fall försämrades prestationen ofta, särskilt bland yngre kliniker, och de vanliga fördelarna med AI‑stöd försvann eller vändes till och med. Denna iakttagelse understryker att förklaringar inte bara är en kosmetisk detalj: om de vilseleder kan de skada vården genom att styra kliniker bort från deras eget bättre omdöme. Förklaringar av hög kvalitet, förankrade i medicinsk kunskap, är därför avgörande för säker AI‑användning.

Vad detta betyder för patienter och kliniker

Enkelt uttryckt visar studien att ett AI‑system kan tränas inte bara för att rekommendera insulindoser utan också för att "visa sitt arbete" på ett sätt som stämmer överens med hur diabetespecialister resonerar om vård. Genom att väva in medicinsk kunskap direkt i förklaringsmotorn och involvera läkare genom hela utvecklingen gör ramverket AI‑förslag mer tillförlitliga och enklare att granska. För patienter kan detta innebära säkrare och mer konsekventa insulinjusteringar, särskilt när mindre erfarna kliniker är i tjänst. Mer generellt erbjuder tillvägagångssättet en mall för att bygga transparenta AI‑verktyg inom andra komplexa områden av medicinen, och hjälper till att förvandla svartlådeförutsägelser till samarbetspartners i kliniskt beslutsfattande.

Citering: He, H., Ying, Z., Li, B. et al. Explainable deep learning framework incorporating medical knowledge for insulin titration in diabetes. Commun Med 6, 192 (2026). https://doi.org/10.1038/s43856-026-01449-1

Nyckelord: typ 2‑diabetes, insulindosering, förklarbar AI, kliniskt beslutsstöd, elektroniska journaler