Clear Sky Science · it

Framework di deep learning spiegabile che incorpora conoscenze mediche per la titolazione dell’insulina nel diabete

Perché decisioni più intelligenti sull’insulina sono importanti

Per milioni di persone con diabete di tipo 2, ottenere la dose corretta di insulina è un equilibrio quotidiano. Negli ospedali, i medici devono regolare costantemente le dosi in base all’andamento della glicemia, agli esami di laboratorio e ai farmaci in uso. È un compito che richiede tempo e impegno mentale, soprattutto dove il personale è ridotto. Potenti sistemi di intelligenza artificiale (IA) possono aiutare, ma la maggior parte funziona come scatole nere: producono un numero senza mostrare il ragionamento. Questo studio descrive un nuovo framework di IA che non solo suggerisce dosi di insulina, ma spiega anche le sue scelte in modo coerente con il modo di pensare degli specialisti esperti di diabete.

Far capire un aiuto a scatola nera

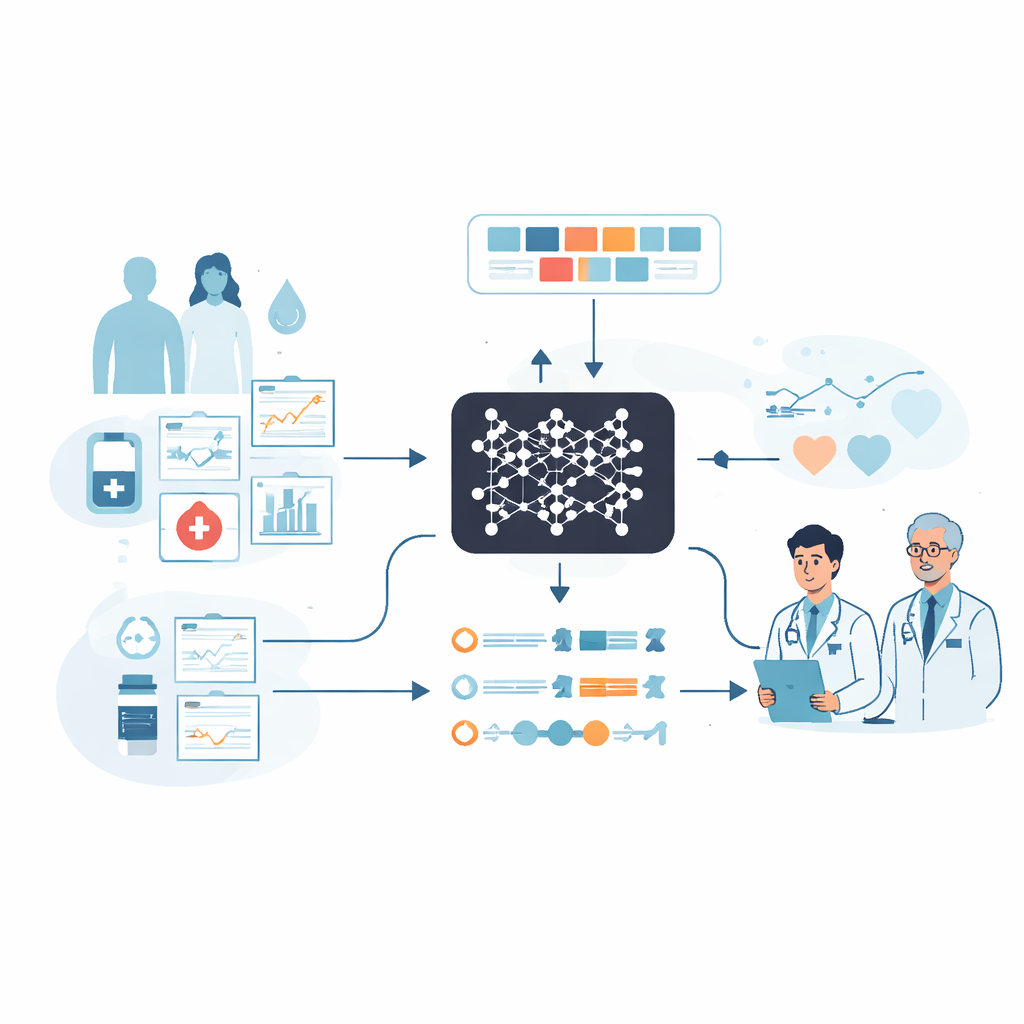

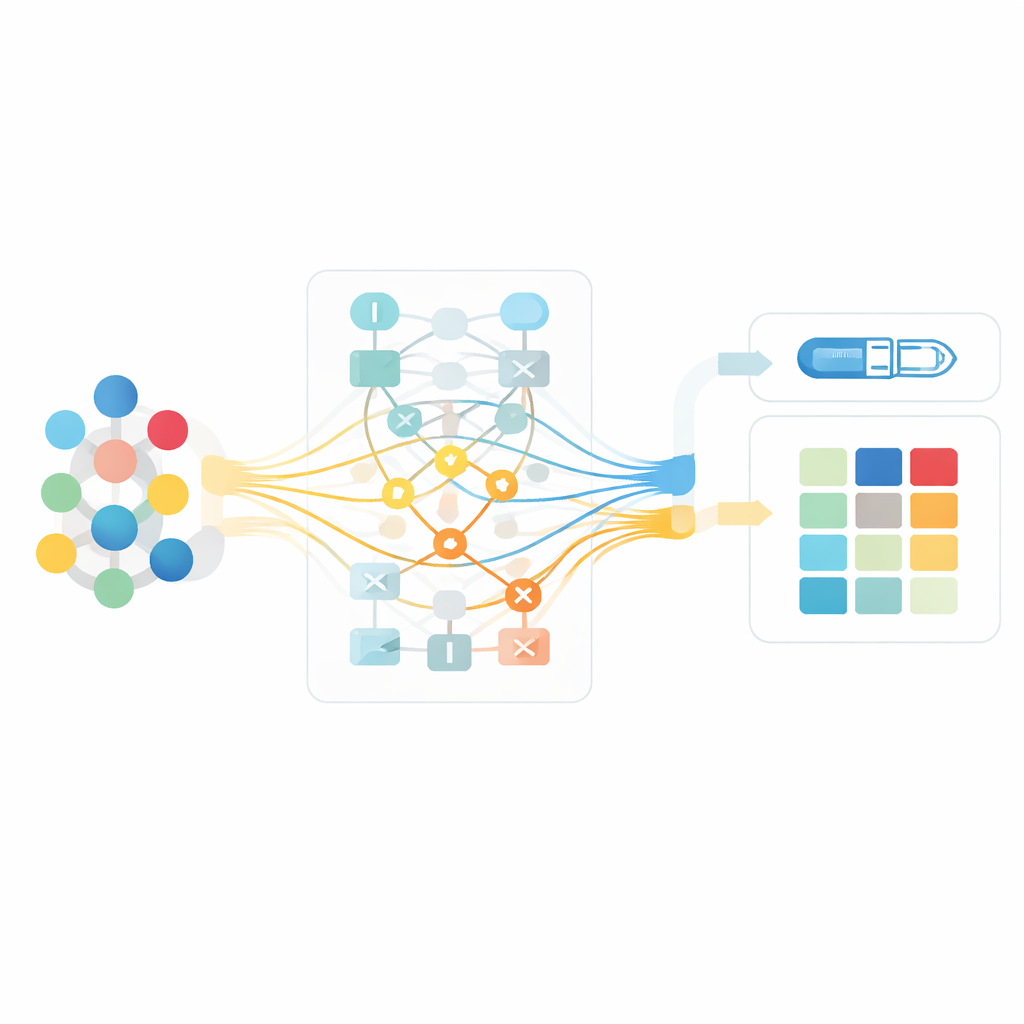

I ricercatori hanno costruito su un sistema di deep learning precedentemente sviluppato che predice le dosi di insulina per pazienti ricoverati con diabete di tipo 2, utilizzando dati delle cartelle cliniche elettroniche. Queste cartelle includono dati anagrafici di base, misurazioni della glicemia nel corso della giornata, insulina e altri farmaci antidiabetici e risultati di esami di laboratorio. Il modello originale aveva buone prestazioni ma non poteva mostrare perché preferisse una dose rispetto a un’altra, rendendo molti clinici esitanti a fidarsi. Per colmare questo divario, il team ha progettato un livello di “IA spiegabile” che si sovrappone al modello a scatola nera e traduce il suo funzionamento interno in elementi comprensibili all’uomo, come quali valori di glicemia, iniezioni di insulina precedenti o caratteristiche del paziente hanno maggiormente influenzato una specifica raccomandazione.

Considerare i fattori in combinazione, non isolatamente

La maggior parte degli strumenti di spiegazione esistenti si concentra sull’impatto di un fattore alla volta — per esempio l’età o un singolo valore di glicemia — sulla previsione del modello. Questo può essere fuorviante nella cura del diabete, dove la dose sicura di insulina dipende spesso da come più fattori interagiscono, come le tendenze recenti della glicemia, la funzione renale, il peso corporeo e le dosi precedenti. Il nuovo framework utilizza un metodo in grado di catturare sia gli effetti individuali sia le interazioni a coppie tra fattori. Ciò consente di evidenziare, per esempio, come una glicemia alta dopo il pranzo insieme a una recente diminuzione dell’insulina a pranzo costituisca un forte segnale per aumentare la dose successiva, mentre la stessa glicemia in un altro contesto potrebbe richiedere una modifica minore.

Insegnare all’IA a rispettare il giudizio medico

Anche un metodo di spiegazione sofisticato può scontrarsi con il buon senso medico se è guidato solo da schemi presenti nei dati. Per affrontare questo problema, i ricercatori hanno introdotto un processo di “medico nel circuito”. Un panel di endocrinologi esperti ha ripetutamente rivisto le spiegazioni dell’IA, verificando se le caratteristiche evidenziate e la direzione e l’entità dei loro effetti fossero coerenti con le linee guida cliniche consolidate. Il loro feedback è stato tradotto in vincoli espliciti, come: le dosi di insulina non dovrebbero diminuire quando la glicemia aumenta, o quando altri farmaci ipoglicemizzanti vengono ridotti. Questi vincoli sono stati integrati nel motore di spiegazione e affinati in più round fino a quando gli esperti hanno giudicato che il ragionamento del sistema corrispondesse a una pratica sicura e accettata. I test statistici hanno mostrato che, dopo questo processo, le spiegazioni si allineavano molto meglio con i principi noti della cura del diabete ed evitavano errori evidenti.

Come il sistema incide sulle decisioni nel mondo reale

Per verificare se spiegazioni migliori aiutassero effettivamente i clinici, il team ha condotto uno studio con otto medici — metà giovani e metà più esperti — che hanno valutato casi clinici reali in tre condizioni: lavorare da soli, vedere solo il suggerimento di dose dell’IA e vedere sia la dose che la sua spiegazione. Tra tutti i partecipanti, la visualizzazione della spiegazione dell’IA ha ridotto la differenza media tra la dose scelta e il riferimento degli esperti e ha aumentato la percentuale di decisioni che corrispondevano alla direzione indicata dall’esperto rimanendo entro un intervallo accettabile. Il beneficio è stato particolarmente marcato per i medici junior, la cui accuratezza e fiducia sono migliorate maggiormente. I medici senior avevano già buone prestazioni, ma hanno comunque riportato maggiore fiducia quando potevano vedere perché l’IA raccomandava una data dose.

Perché la qualità della spiegazione conta

I ricercatori hanno anche testato cosa accadesse se le spiegazioni dell’IA fossero sbagliate, fornendo ai medici ragionamenti sintetici e deliberatamente errati insieme a suggerimenti di dose altrimenti validi. In questi casi, le prestazioni spesso peggioravano, soprattutto tra i clinici meno esperti, e i benefici abituali del supporto IA scomparivano o addirittura si invertivano. Questo risultato sottolinea che le spiegazioni non sono un semplice abbellimento: se fuorvianti, possono danneggiare la cura deviando i clinici dal proprio giudizio migliore. Spiegazioni di alta qualità e radicate nella medicina sono quindi essenziali per un uso sicuro dell’IA.

Cosa significa per pazienti e clinici

In termini pratici, lo studio mostra che un sistema di IA può essere addestrato non solo a raccomandare dosi di insulina, ma anche a “mostrare il proprio lavoro” in modo coerente con il ragionamento degli specialisti del diabete. Integrando conoscenze mediche direttamente nel motore di spiegazione e coinvolgendo i medici durante tutto lo sviluppo, il framework rende i suggerimenti dell’IA più affidabili e più facili da verificare. Per i pazienti, ciò potrebbe tradursi in aggiustamenti dell’insulina più sicuri e coerenti, specialmente quando sono di turno clinici meno esperti. Più in generale, l’approccio offre un modello per costruire strumenti di IA trasparenti in altre aree complesse della medicina, aiutando a trasformare previsioni a scatola nera in partner collaborativi nel processo decisionale clinico.

Citazione: He, H., Ying, Z., Li, B. et al. Explainable deep learning framework incorporating medical knowledge for insulin titration in diabetes. Commun Med 6, 192 (2026). https://doi.org/10.1038/s43856-026-01449-1

Parole chiave: diabete di tipo 2, dosaggio dell’insulina, IA spiegabile, supporto decisionale clinico, cartelle cliniche elettroniche