Clear Sky Science · ja

医療知識を組み込んだ説明可能な深層学習フレームワーク:糖尿病におけるインスリン用量調整

なぜインスリンの判断を賢くすることが重要なのか

2型糖尿病で生活する何百万人もの人々にとって、インスリン量を適切にすることは日々の綱渡りです。病院では、医師が血糖値の変動、検査値、併用薬の変化に応じて投与量を絶えず調整する必要があり、これは時間と精神的負担が大きく、特に人手が不足している現場では深刻です。強力な人工知能(AI)システムは支援になり得ますが、多くは内部が見えない“ブラックボックス”のように動作し、根拠を示さず数値だけを出します。本研究は、インスリン投与量を推奨するだけでなく、経験ある糖尿病専門医の思考と整合する形でその判断を説明する新しいAIフレームワークを示します。

ブラックボックス型支援の論理を可視化する

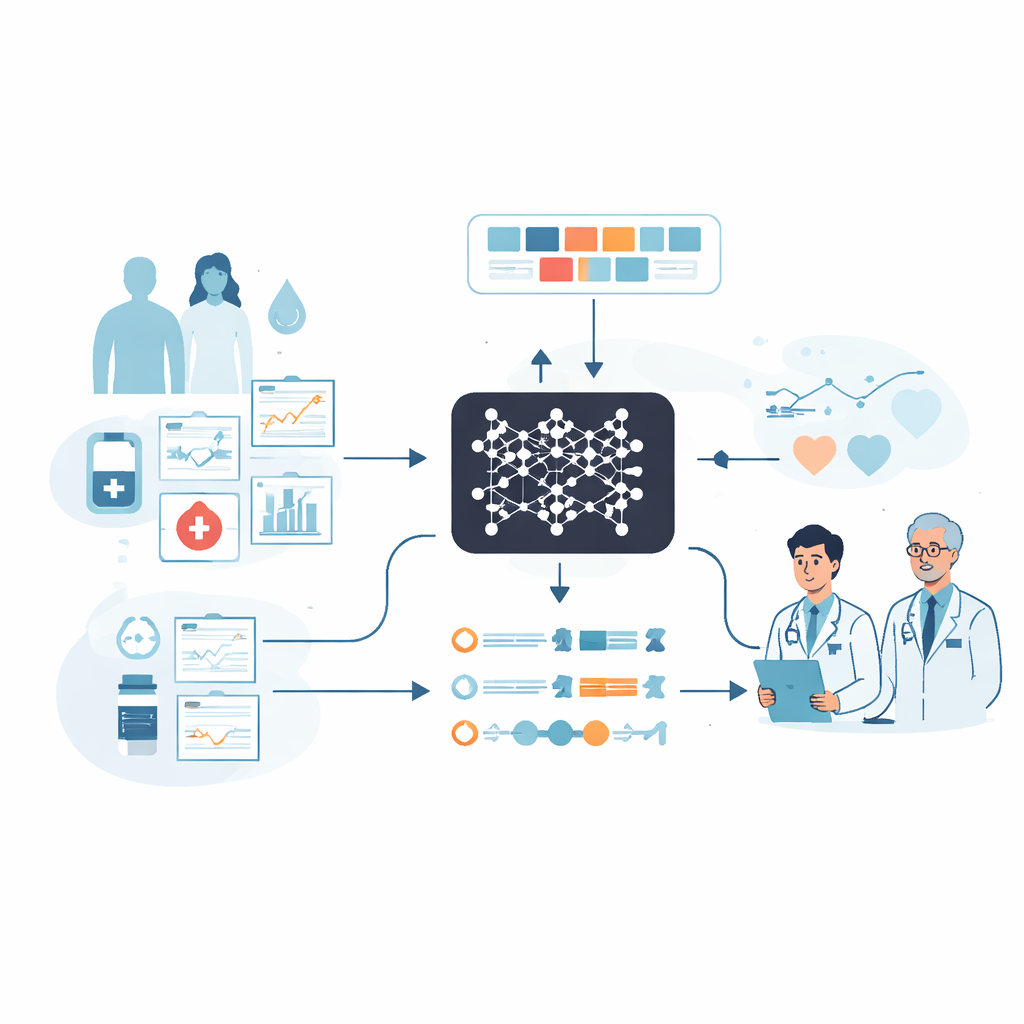

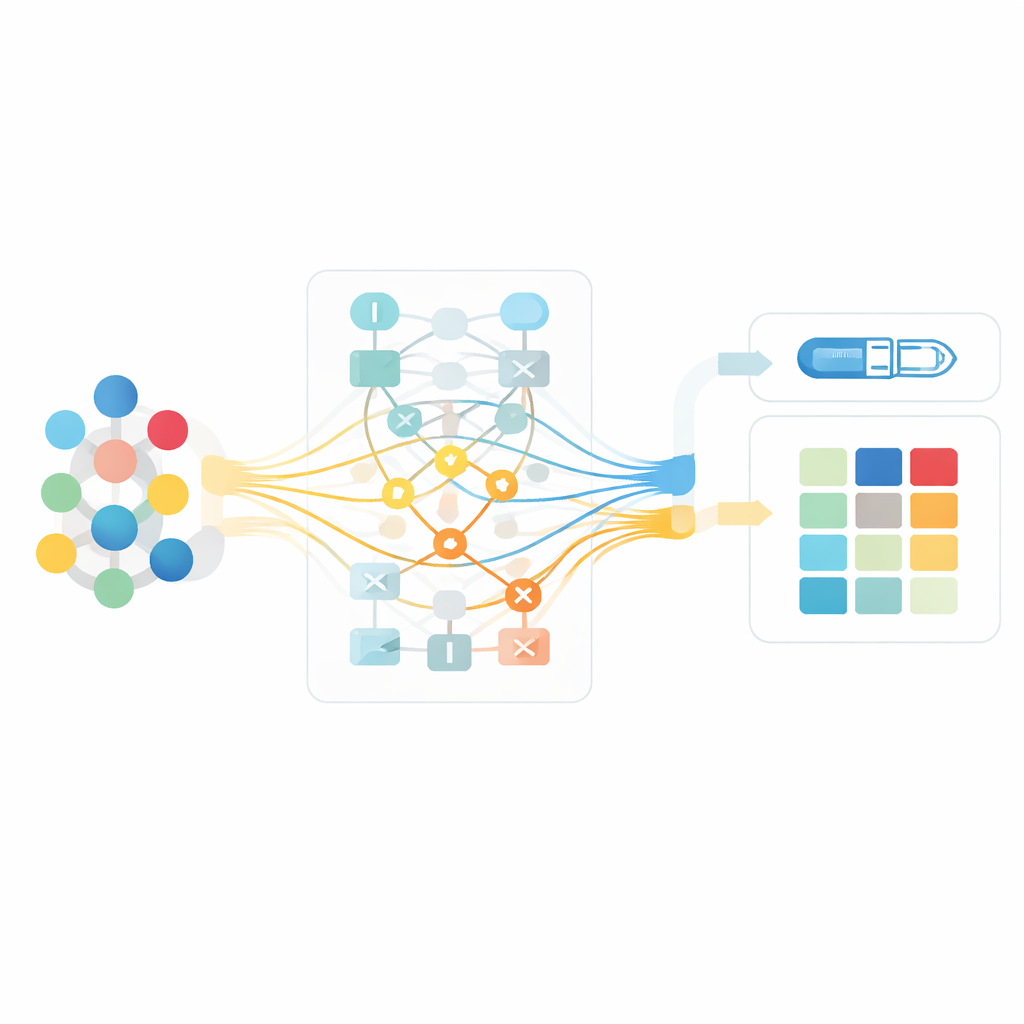

研究チームは、電子カルテのデータを用いて入院患者のインスリン投与量を予測する既存の深層学習システムを基盤に構築しました。これらの記録には患者の基本情報、1日を通した血糖測定値、インスリンやその他の糖尿病薬、検査結果が含まれます。元のモデルは性能が良かったものの、なぜある投与量を選んだのかを示せなかったため、多くの臨床医がそれを信頼して使うことにためらいを感じました。このギャップを埋めるため、チームはブラックボックスモデルの上に位置する「説明可能なAI」層を設計し、内部の働きを人間に理解できる要素、たとえばどの血糖記録や過去の注射、患者の特徴が特定の推奨に影響を与えたか、のような形で翻訳します。

要因を単独ではなく組み合わせで見る

既存の多くの説明手法は、年齢や単一の血糖値のように一つの因子の影響に焦点を当てます。しかし糖尿病管理では、安全なインスリン量は通常、直近の血糖動向、腎機能、体重、過去の投与量など複数の因子の相互作用に依存するため、単独の因子のみを注目するのは誤解を招きかねません。新しいフレームワークは、個々の効果と因子間の二者相互作用の両方を捉えられる手法を用います。これにより、たとえば昼食後の高い血糖と昼のインスリン量の最近の減少が組み合わさると次回の増量を強く示唆する、といった文脈依存の影響を強調できます。逆に同じ血糖値でも別の状況では小さな変更を示すことも可能です。

AIに医療的判断を尊重させる

高度な説明手法であっても、データのパターンのみで駆動されると医療常識と矛盾することがあります。これに対処するため、研究者たちは「医師を巻き込む」プロセスを導入しました。経験豊富な内分泌科医のパネルが繰り返しAIの説明をレビューし、AIが強調した特徴やその影響の方向性・大きさが確立された臨床ガイドラインと一致するかどうかを確認しました。彼らのフィードバックは、血糖が上がっているときに投与量が減るべきではない、あるいは他の血糖降下薬が減量されたときに投与量を下げてはならない、などの明示的な制約に翻訳されました。これらの制約は説明エンジンに組み込まれ、専門家が系の推論を安全で受け入れられる臨床実践に一致すると判断するまで数ラウンドで洗練されました。統計的検定により、このプロセス後は説明が既知の糖尿病ケア原則と遥かに整合し、明白な誤りを避けられることが示されました。

システムが現場の判断に与える影響

説明が臨床医に実際に役立つかを確かめるため、チームは8人の医師(半数が若手、半数が経験者)を対象に、3つの条件で実際の患者症例をレビューする研究を行いました:単独で判断する場合、AIの用量提案のみを提示される場合、用量とその説明の両方を見る場合です。参加者全体で、AIの説明を見た際には彼らの選んだ用量と専門家参照値との平均差が減少し、専門家の方向性と許容範囲内に一致した決定の割合が増加しました。効果は特に若手医師で強く、精度と自信が最も向上しました。上級医師はすでに成績が良かったものの、AIが特定の用量を推奨した理由を見られることでより自信を持てると報告しました。

説明の質が重要な理由

研究者らは、AIの説明が誤っている場合に何が起きるかも検証しました。具体的には、その他の点で適切な用量提案に対して、わざと欠陥のある合成的な推論を付けて医師に示しました。この場合、特に若手臨床医の成績が悪化し、AI支援の通常の利点が消えたり逆転したりすることがしばしば見られました。この結果は、説明が単なる化粧にすぎないものではないことを強調します。誤解を招く説明は、臨床医を自らのより良い判断から逸らし、医療を害する可能性があります。したがって、高品質で医学的に裏付けられた説明は安全なAI利用に不可欠です。

患者と臨床医にとっての意義

日常的な観点から、この研究はAIシステムがインスリン用量を推奨するだけでなく、糖尿病専門医のケアに対する考え方と共鳴する形で「作業過程を示す」ように訓練できることを示しています。説明エンジンに医療知識を直接織り込み、開発の過程で医師を関与させることで、AIの提案はより信頼でき、吟味しやすくなります。患者にとっては、特に経験の浅い臨床医が当直している場合に、より安全で一貫したインスリン調整につながる可能性があります。より広くは、このアプローチは医学の他の複雑な領域でも透明なAIツールを構築するためのモデルを提供し、ブラックボックス的な予測を臨床判断の協働的パートナーへと変える助けになります。

引用: He, H., Ying, Z., Li, B. et al. Explainable deep learning framework incorporating medical knowledge for insulin titration in diabetes. Commun Med 6, 192 (2026). https://doi.org/10.1038/s43856-026-01449-1

キーワード: 2型糖尿病, インスリン投与量, 説明可能なAI, 臨床意思決定支援, 電子カルテ