Clear Sky Science · pt

Estrutura de aprendizado profundo explicável que incorpora conhecimento médico para titulação de insulina no diabetes

Por que decisões de insulina mais inteligentes importam

Para milhões de pessoas que vivem com diabetes tipo 2, acertar a dose de insulina é um exercício diário de equilíbrio. Em hospitais, os médicos precisam ajustar constantemente as doses com base nas variações da glicemia, em exames laboratoriais e em medicamentos. Isso consome tempo e exige esforço mental, especialmente quando a equipe é reduzida. Poderosos sistemas de inteligência artificial (IA) podem ajudar, mas a maioria funciona como caixas-pretas: produzem um número sem expor seu raciocínio. Este estudo descreve uma nova estrutura de IA que não só recomenda doses de insulina, como também explica suas escolhas de forma alinhada ao modo de pensar de especialistas experientes em diabetes.

Dando sentido a um assistente caixa-preta

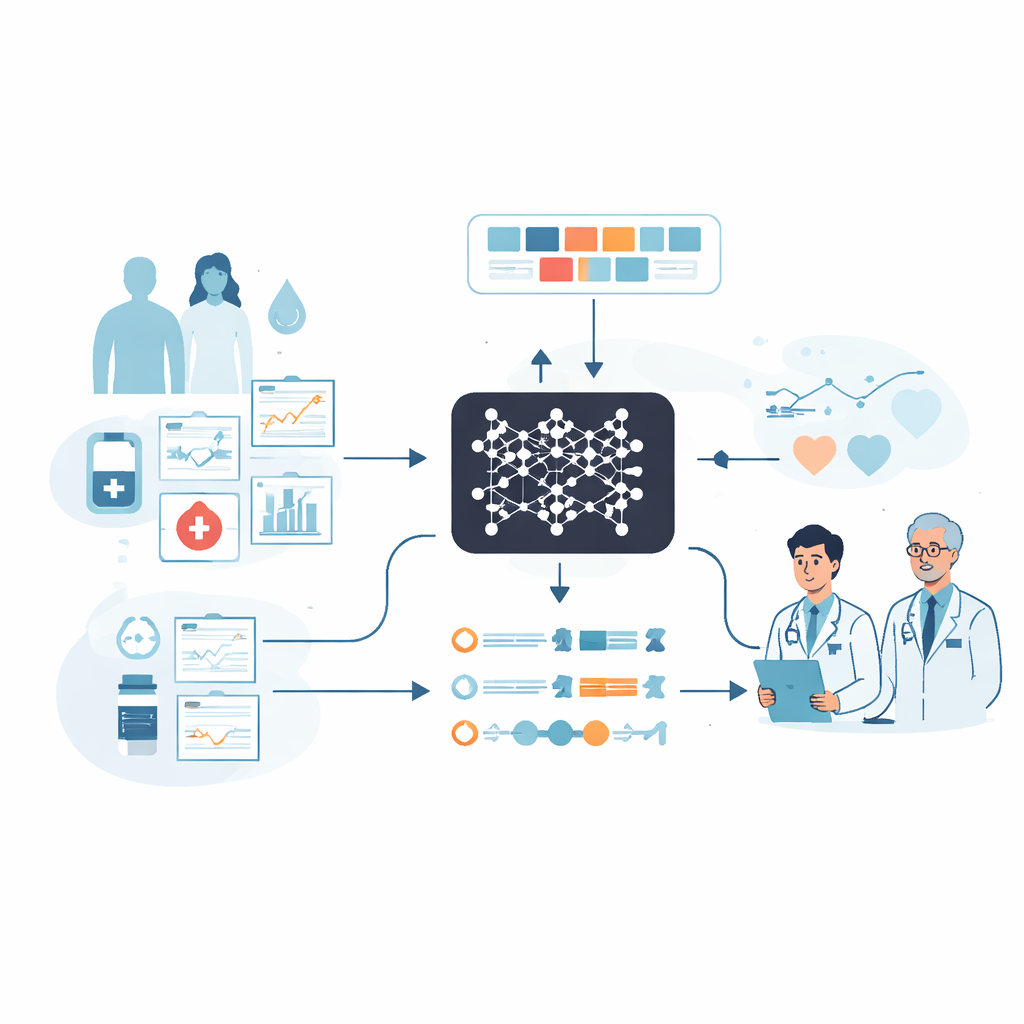

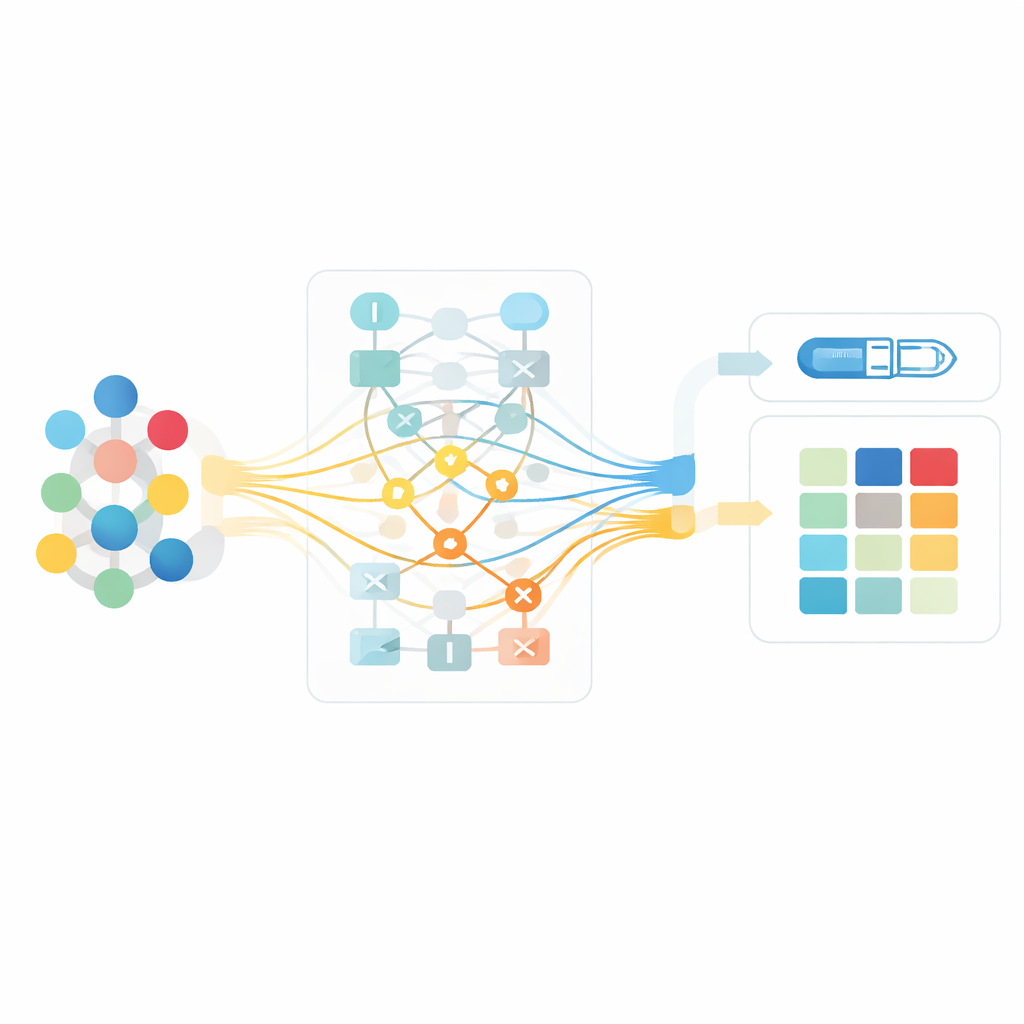

Os pesquisadores partiram de um sistema de aprendizado profundo previamente desenvolvido que prevê doses de insulina para pacientes hospitalizados com diabetes tipo 2, usando dados de prontuários eletrônicos. Esses registros incluem informações básicas do paciente, medições de glicemia ao longo do dia, insulina e outros medicamentos para diabetes, além de resultados de exames laboratoriais. O modelo original teve bom desempenho, mas não conseguia mostrar por que favorecia uma dose em detrimento de outra, o que deixou muitos clínicos relutantes em confiá‑lo. Para preencher essa lacuna, a equipe projetou uma camada de “IA explicável” que se sobrepõe ao modelo caixa‑preta e traduz seu funcionamento interno em peças compreensíveis ao ser humano, por exemplo quais registros de glicemia, injeções anteriores de insulina ou características do paciente mais influenciaram uma recomendação específica.

Olhando fatores em combinação, não isoladamente

A maioria das ferramentas de explicação existentes foca no impacto de um fator por vez — por exemplo, a idade ou um único valor de glicemia — sobre a predição do modelo. Isso pode ser enganoso no cuidado do diabetes, onde a dose segura de insulina geralmente depende de como vários fatores interagem, como tendências recentes da glicemia, função renal, peso corporal e doses anteriores. A nova estrutura usa um método capaz de capturar tanto efeitos individuais quanto interações par a par entre fatores. Isso permite destacar, por exemplo, como uma glicemia alta após o almoço em conjunto com uma redução recente na dose de insulina do almoço envia um sinal forte para aumentar a próxima dose, enquanto a mesma glicemia em outro contexto pode demandar uma alteração menor.

Ensinando a IA a respeitar o julgamento médico

Mesmo um método de explicação sofisticado pode entrar em conflito com o bom senso médico se for guiado apenas por padrões nos dados. Para enfrentar isso, os pesquisadores introduziram um processo de “médico no circuito”. Um painel de endocrinologistas experientes revisou repetidamente as explicações da IA, verificando se as características destacadas e a direção e magnitude de seus efeitos concordavam com diretrizes clínicas estabelecidas. O feedback deles foi traduzido em restrições explícitas, como: as doses de insulina não devem diminuir quando a glicemia aumenta, ou quando outros medicamentos hipoglicemiantes são reduzidos. Essas restrições foram incorporadas ao mecanismo de explicação e refinadas em várias rodadas até que os especialistas julgassem que o raciocínio do sistema correspondia a uma prática segura e aceita. Testes estatísticos mostraram que, após esse processo, as explicações ficaram muito mais alinhadas com princípios conhecidos do cuidado do diabetes e evitaram erros evidentes.

Como o sistema afeta decisões no mundo real

Para avaliar se explicações melhores realmente ajudam os clínicos, a equipe conduziu um estudo com oito médicos — metade juniores e metade mais experientes — que analisaram casos reais de pacientes em três condições: trabalhando sozinhos, vendo apenas a sugestão de dose da IA e vendo tanto a dose quanto sua explicação. Entre todos os participantes, ver a explicação da IA reduziu a diferença média entre a dose escolhida por eles e uma referência de especialista e aumentou a porcentagem de decisões que coincidiam com a direção do especialista e permaneciam dentro de uma faixa aceitável. O benefício foi especialmente forte para médicos juniores, cuja precisão e confiança melhoraram mais. Médicos seniores já apresentavam bom desempenho, mas ainda relataram sentir-se mais confiantes quando podiam ver por que a IA recomendava determinada dose.

Por que a qualidade da explicação importa

Os pesquisadores também testaram o que aconteceria se as explicações da IA estivessem erradas, fornecendo aos médicos um raciocínio sintético e deliberadamente falho junto com sugestões de dose que, por outro lado, eram boas. Nesses casos, o desempenho frequentemente piorou, particularmente entre clínicos juniores, e os benefícios habituais do suporte por IA desapareceram ou até se inverteram. Essa constatação ressalta que as explicações não são apenas um acessório cosmético: se forem enganosas, podem prejudicar o cuidado ao desviar os clínicos de seu próprio julgamento mais acertado. Explicações de alta qualidade e fundamentadas medicamente são, portanto, essenciais para o uso seguro da IA.

O que isso significa para pacientes e clínicos

Em termos práticos, o estudo mostra que um sistema de IA pode ser treinado não só para recomendar doses de insulina, mas também para “mostrar seu raciocínio” de modo que ressoe com a forma como especialistas em diabetes pensam sobre o cuidado. Ao incorporar conhecimento médico diretamente ao mecanismo de explicação e envolver médicos ao longo do desenvolvimento, a estrutura torna as sugestões da IA mais confiáveis e mais fáceis de escrutinar. Para os pacientes, isso pode se traduzir em ajustes de insulina mais seguros e consistentes, especialmente quando clínicos menos experientes estão de plantão. De forma mais ampla, a abordagem oferece um modelo para construir ferramentas de IA transparentes em outras áreas complexas da medicina, ajudando a transformar predições de caixa‑preta em parceiros colaborativos na tomada de decisão clínica.

Citação: He, H., Ying, Z., Li, B. et al. Explainable deep learning framework incorporating medical knowledge for insulin titration in diabetes. Commun Med 6, 192 (2026). https://doi.org/10.1038/s43856-026-01449-1

Palavras-chave: diabetes tipo 2, dosagem de insulina, IA explicável, suporte à decisão clínica, prontuários eletrônicos