Clear Sky Science · pl

Wyjaśnialna struktura głębokiego uczenia uwzględniająca wiedzę medyczną do doboru dawek insuliny w cukrzycy

Dlaczego lepsze decyzje dotyczące insuliny mają znaczenie

Dla milionów osób z cukrzycą typu 2 właściwe dobranie dawki insuliny to codzienne balansowanie. W szpitalach lekarze muszą nieustannie korygować dawki na podstawie zmiennych poziomów glukozy, wyników badań i stosowanych leków. To zajmuje dużo czasu i jest obciążające psychicznie, szczególnie tam, gdzie personelu brakuje. Potężne systemy sztucznej inteligencji (AI) mogą pomóc, ale większość działa jak czarne skrzynki: podają liczbę bez ujawniania swojego rozumowania. W badaniu opisano nową ramę AI, która nie tylko rekomenduje dawki insuliny, lecz także wyjaśnia swoje wybory w sposób zgodny z myśleniem doświadczonych specjalistów diabetologii.

Rozszyfrowanie pomocnika‑czarnej skrzynki

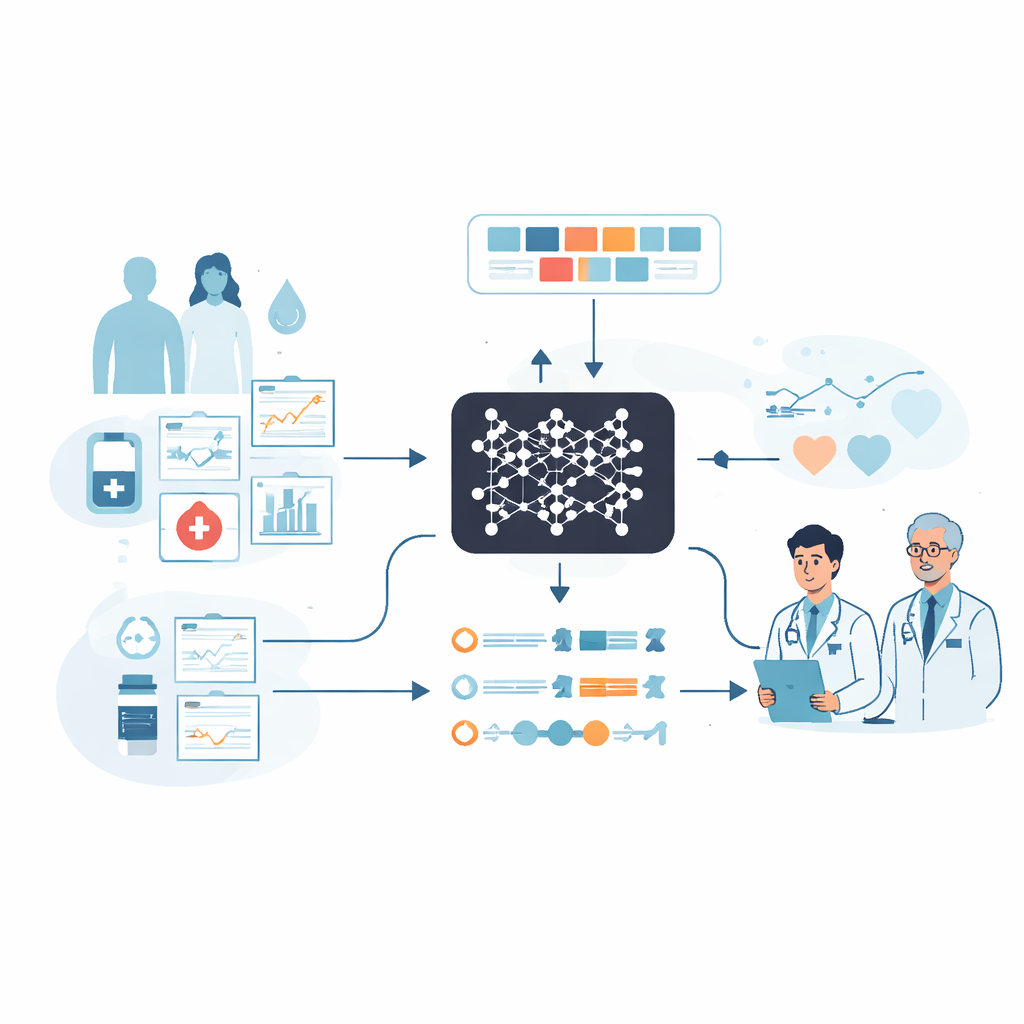

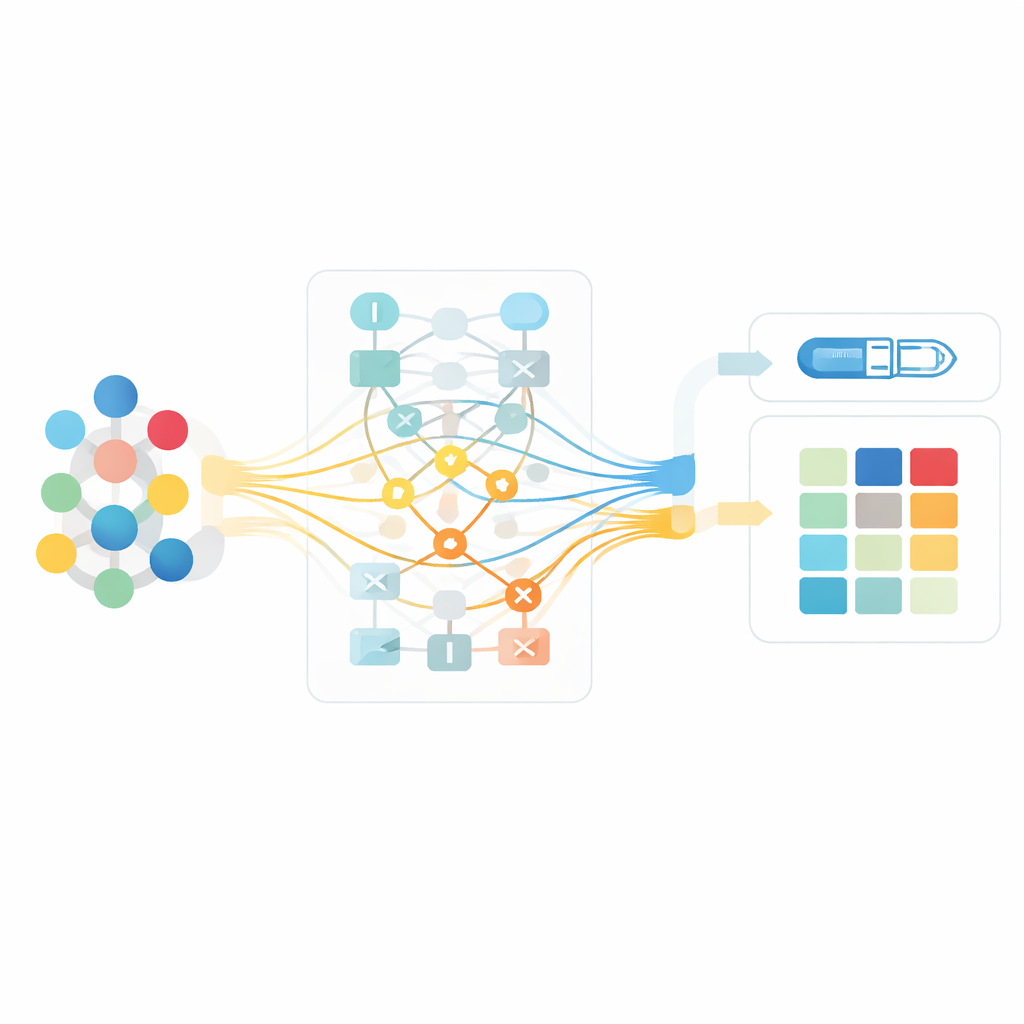

Naukowcy rozwinęli istniejący wcześniej system głębokiego uczenia, który przewiduje dawki insuliny dla hospitalizowanych pacjentów z cukrzycą typu 2, korzystając z danych z elektronicznych dokumentów medycznych. Zapisy te zawierają podstawowe dane pacjenta, pomiary glikemii w ciągu dnia, podawane dawki insuliny i inne leki przeciwcukrzycowe oraz wyniki badań laboratoryjnych. Oryginalny model działał dobrze, ale nie potrafił wyjaśnić, dlaczego faworyzował jedną dawkę nad inną, co zniechęcało wielu klinicystów do polegania na nim. Aby wypełnić tę lukę, zespół zaprojektował warstwę „wyjaśnialnej AI”, która nakłada się na model‑czarną skrzynkę i tłumaczy jego wewnętrzne mechanizmy na zrozumiałe dla ludzi elementy, takie jak które zapisy glikemii, wcześniejsze zastrzyki insuliny czy cechy pacjenta najbardziej wpłynęły na daną rekomendację.

Uwzględnianie czynników w kombinacji, a nie pojedynczo

Większość istniejących narzędzi wyjaśniających skupia się na wpływie jednego czynnika — na przykład wieku czy pojedynczej wartości glikemii — na predykcję modelu. To może wprowadzać w błąd w opiece nad cukrzycą, gdzie bezpieczna dawka insuliny zwykle zależy od interakcji kilku czynników, takich jak ostatnie trendy glikemii, czynność nerek, masa ciała i poprzednie dawki. Nowa rama wykorzystuje metodę, która uchwyca zarówno efekty indywidualne, jak i interakcje par czynników. Pozwala to na przykład podkreślić, jak wysoki poziom glukozy po obiedzie razem z ostatnim zmniejszeniem dawki insuliny na lunch wysyła silny sygnał do zwiększenia kolejnej dawki, podczas gdy ta sama wartość glikemii w innym kontekście może wymagać mniejszej korekty.

Nauczanie AI, by respektowała osąd medyczny

Nawet zaawansowana metoda wyjaśniania może kłócić się ze zdrowym rozsądkiem medycznym, jeśli opiera się wyłącznie na wzorcach w danych. Aby temu zapobiec, badacze wprowadzili proces „lekarz w pętli”. Panel doświadczonych endokrynologów wielokrotnie przeglądał wyjaśnienia AI, sprawdzając, czy cechy, które model wyróżniał, oraz kierunek i wielkość ich wpływu zgadzają się z ustalonymi wytycznymi klinicznymi. Ich opinie zostały przełożone na jawne ograniczenia, na przykład: dawki insuliny nie powinny maleć, gdy rośnie poziom glikemii, lub gdy zmniejszane są inne leki obniżające glukozę. Ograniczenia te wbudowano w silnik wyjaśnień i dopracowywano w kilku rundach, aż eksperci uznali, że rozumowanie systemu odpowiada bezpiecznej i akceptowanej praktyce. Testy statystyczne wykazały, że po tym procesie wyjaśnienia były znacznie bardziej zgodne ze znanymi zasadami opieki nad cukrzycą i unikały oczywistych błędów.

Jak system wpływa na decyzje w praktyce

Aby sprawdzić, czy lepsze wyjaśnienia rzeczywiście pomagają klinicystom, zespół przeprowadził badanie z ośmioma lekarzami — połowa mniej doświadczeni, połowa bardziej doświadczeni — którzy oceniali rzeczywiste przypadki pacjentów w trzech warunkach: pracując samodzielnie, widząc tylko sugestię dawki AI oraz widząc zarówno dawkę, jak i jej wyjaśnienie. Wśród wszystkich uczestników oglądanie wyjaśnienia AI zmniejszyło średnią różnicę między wybraną przez nich dawką a referencją ekspertów i zwiększyło odsetek decyzji zgodnych co do kierunku i mieszczących się w akceptowalnym zakresie. Korzyść była szczególnie widoczna u młodszych lekarzy, których dokładność i pewność siebie najbardziej się poprawiły. Starsi lekarze już radzili sobie dobrze, ale również raportowali większą pewność, gdy mogli zobaczyć, dlaczego AI rekomenduje daną dawkę.

Dlaczego jakość wyjaśnień ma znaczenie

Badacze przetestowali także, co się stanie, jeśli wyjaśnienia AI będą błędne, podając lekarzom syntetyczne, celowo wadliwe rozumowanie obok w przeciwnym razie poprawnych sugestii dawek. W takich przypadkach wydajność często ulegała pogorszeniu, szczególnie wśród młodszych klinicystów, a zwykłe korzyści wsparcia AI znikały lub nawet się odwracały. To odkrycie podkreśla, że wyjaśnienia nie są jedynie powierzchowną poprawką: jeśli wprowadzają w błąd, mogą szkodzić opiece, odciągając lekarzy od ich własnego lepszego osądu. Wysokiej jakości, medycznie ugruntowane wyjaśnienia są zatem niezbędne dla bezpiecznego stosowania AI.

Co to oznacza dla pacjentów i klinicystów

Mówiąc prosto, badanie pokazuje, że system AI można wyszkolić nie tylko do rekomendowania dawek insuliny, ale też do „pokazywania swojej pracy” w sposób rezonujący z rozumowaniem specjalistów diabetologii. Poprzez wplecenie wiedzy medycznej bezpośrednio w silnik wyjaśnień i angażowanie lekarzy na etapie rozwoju, rama ta sprawia, że sugestie AI są bardziej godne zaufania i łatwiejsze do zweryfikowania. Dla pacjentów może to przełożyć się na bezpieczniejsze i bardziej spójne dostosowania insuliny, szczególnie gdy na dyżurze są mniej doświadczeni klinicyści. Szerzej rzecz biorąc, podejście to stanowi wzór budowy przejrzystych narzędzi AI w innych złożonych obszarach medycyny, pomagając przekształcić predykcje czarnych skrzynek w partnerów współpracujących przy podejmowaniu decyzji klinicznych.

Cytowanie: He, H., Ying, Z., Li, B. et al. Explainable deep learning framework incorporating medical knowledge for insulin titration in diabetes. Commun Med 6, 192 (2026). https://doi.org/10.1038/s43856-026-01449-1

Słowa kluczowe: cukrzyca typu 2, dawkowanie insuliny, wyjaśnialna sztuczna inteligencja, wsparcie decyzji klinicznych, elektroniczne dokumenty medyczne