Clear Sky Science · zh

用于遥感图像中小目标检测的轻量级模型 LMW-YOLO

从太空观察微小目标

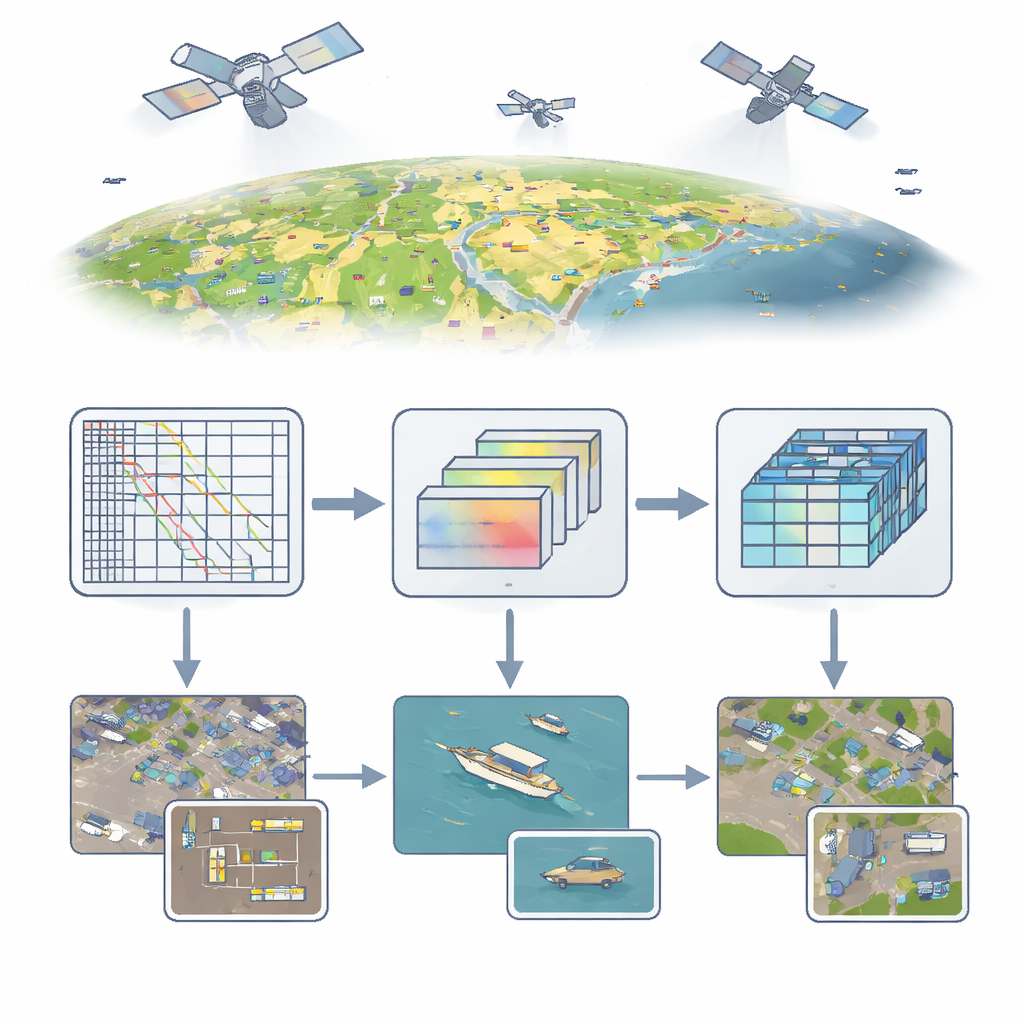

从城市交通到港口中的船舶,地球上许多重要事物在航拍和卫星影像中都只是微小的斑点。然而,要让计算机可靠地识别这些微小目标却出奇地困难,尤其是在无人机或小型卫星等资源受限的设备上。本文提出了 LMW-YOLO,一种紧凑但高效的视觉系统,专为在大尺度、背景复杂的遥感图像中检测极小目标而设计,同时不依赖高昂的计算资源。

为什么微小目标难以被发现

遥感影像从高空采集,因此汽车、船只和行人常常仅占据几像素宽。常见的目标检测器(例如流行的 YOLO 系列)通过逐层下采样来加速处理并捕捉高层次语义,但对于仅有 5–10 像素尺寸的目标,这种降采样可能在网络“看到”之前就将其抹去。以往为解决该问题的尝试通常依赖更深的网络、注意力机制或类 Transformer 模型。这些方法可以提升精度,但往往对无人机、卫星或内存与功耗受限的边缘设备来说太重。保持模型小巧与保留识别微小目标所需细节之间存在张力,尤其是在建筑、树木和水域等复杂背景中。

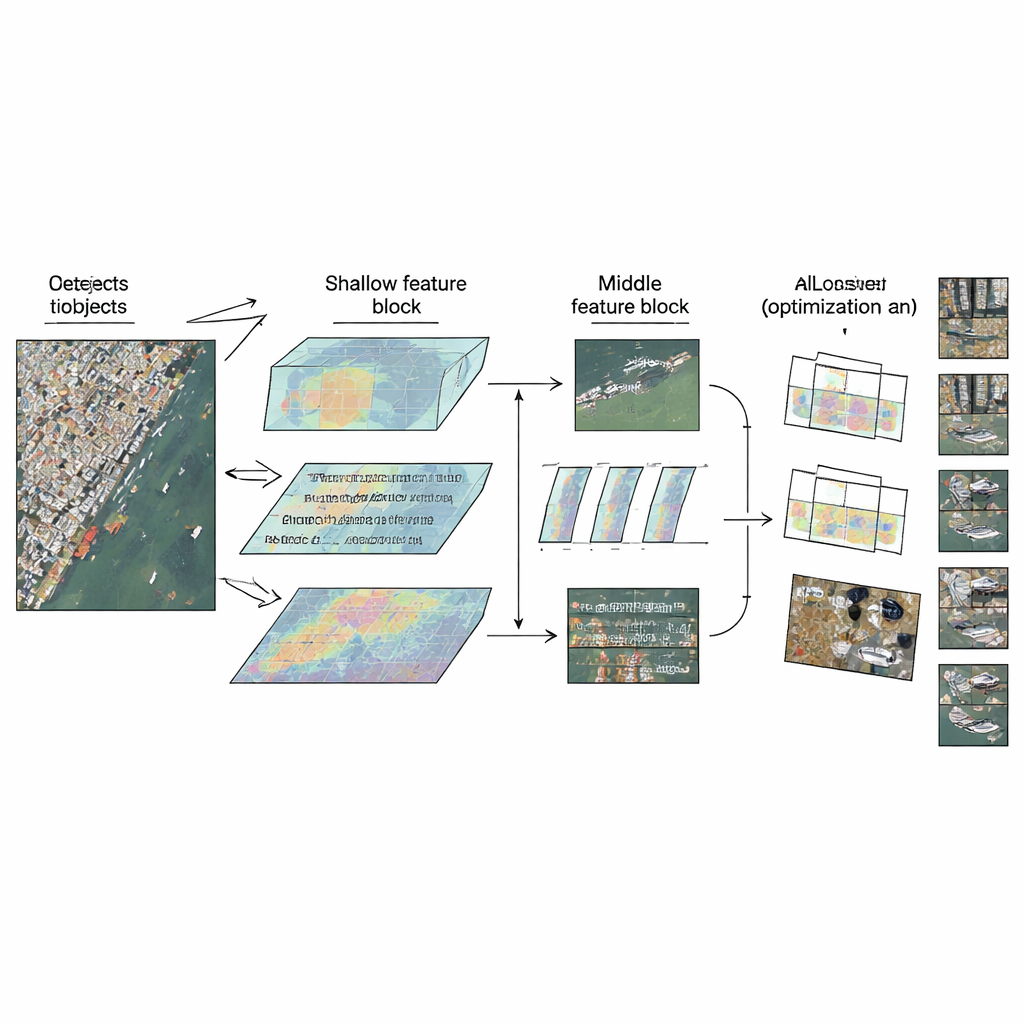

为不同层级量身定制网络

LMW-YOLO 以现代轻量级 YOLO 主干为起点,但打破了常见的统一层设计习惯:不是在所有位置使用相同的模块,作者提出了“上下文-尺度解耦(Context-Scale Decoupled)”策略,使网络各部分承担专门的角色。在浅层阶段,图像仍然较大,网络难以在足够大的视野中理解微小目标的语境。为此,作者引入了大核上下文聚合(LKCA)模块,通过组合若干更小且高效的卷积来模拟大感受野的滤波窗口。这样网络可以在保留对微小车辆或船只等细节敏感性的同时观察更广的区域。在中间层,挑战转为如何在不丢失空间清晰度的前提下处理尺寸差异极大的目标。

同时观察多尺度信息

为应对这种多样性,作者在更深的特征图中引入了多尺度扩张感知(MSDP)模块。该模块将信息分为两条路径:一条保持不变,保留清晰的位置细节;另一条通过一组并行卷积分支,每个分支采用不同膨胀率的过滤器以“看到”不同范围,从非常局部到更广泛的区域。通过重新组合这些流,网络获得了丰富的多尺度视角:它能够区分密集排列的小型车辆、更大的船舶以及像桥梁这样的延伸结构,同时在参数和计算代价上保持极低。LKCA 与 MSDP 的协同使网络在各自关键的层级上既能关注局部细节也能关注更广的上下文。

从不完美数据中更聪明地学习

即便特征更好,用真实航拍数据训练仍然具有挑战性。遥感数据集往往包含噪声标签、部分遮挡的目标或奇怪的形状,这会扰乱传统的训练损失。许多 YOLO 风格的模型采用固定规则同等对待所有训练样本,这可能使少数错误样本产生误导性的更新,减慢或不稳定训练。LMW-YOLO 用一种称为 Wise-IoU v3 的方案替代了这一做法,该方案根据样本当前拟合程度动态调整其在训练中的影响力:对于已经很好或明显很差的样本降低权重,而强调“困难但有用”的案例。这种动态聚焦有助于模型更快收敛,并提高对小型、拥挤目标的框回归精度。

在真实场景中验证效果

团队在三个具有挑战性的基准上测试了 LMW-YOLO:高分辨率卫星数据集(NWPU VHR-10)、一个专门收集的极小目标数据集(RS-STOD)和一个包含严重拥挤与遮挡的大型无人机影像集(VisDrone2019)。在这三项测试中,新模型均优于多种近期检测器,包括若干更大且更复杂的系统,同时仅使用约 260 万参数并保持适度的计算量。它还可在标准 CPU 上实时或近实时运行,表明它适合部署在无人机和小型平台上,而不仅限于强大的数据中心。

对未来的意义

对读者而言,关键结论是:在从高处识别微小目标时,我们不再需要在精度与效率之间做极端抉择。通过精心设计网络不同层级处理细节与上下文的方式,并用能忽略误导性样本的损失函数进行训练,LMW-YOLO 在保持小巧体量的同时提供了更清晰、更可靠的检测性能。这使其成为交通监测、港口安防、灾情响应与环境调查等应用的有希望的构建模块——在这些场景中,一幅巨量图像中的每一个微小目标都可能包含重要信息。

引用: Qiu, Y., Lin, Z. Lightweight model LMW-YOLO for small object detection in remote sensing images. Sci Rep 16, 11644 (2026). https://doi.org/10.1038/s41598-026-45055-6

关键词: 遥感, 小目标检测, 轻量级深度学习, 航拍影像, YOLO 架构