Clear Sky Science · nl

Lichtgewichtmodel LMW-YOLO voor detectie van kleine objecten in beelden uit remote sensing

De kleine dingen vanuit de ruimte waarnemen

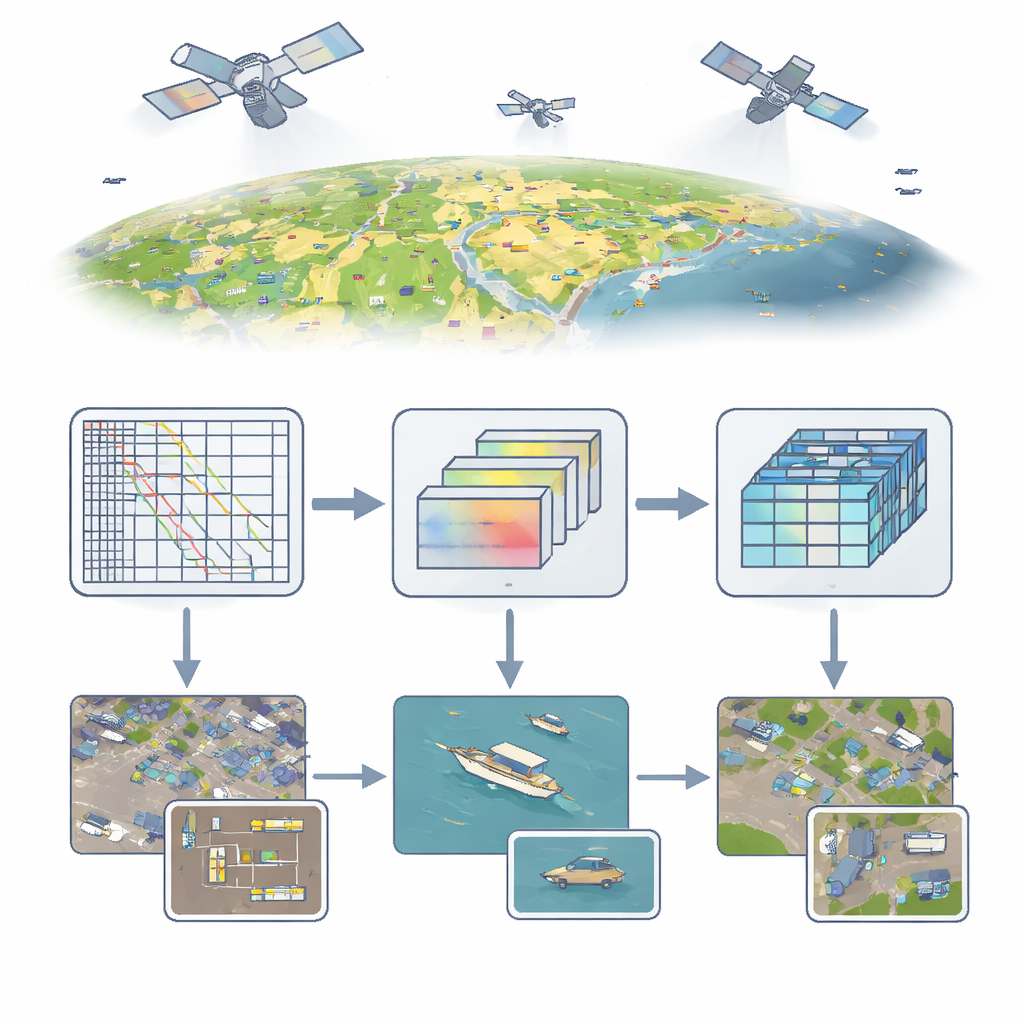

Van stedelijk verkeer tot schepen in een haven: veel van wat op aarde van belang is verschijnt als piepkleine stippen in lucht- en satellietfoto’s. Computers betrouwbaar leren zulke kleine objecten te vinden blijkt echter verrassend lastig, zeker op lichtgewicht apparaten zoals drones of kleine satellieten. Dit artikel introduceert LMW-YOLO, een compacte maar krachtige visiesysteem dat specifiek is ontworpen om zeer kleine objecten te vinden in grote, rommelige remote sensing-beelden zonder zware rekencapaciteit te vereisen.

Waarom kleine doelen moeilijk te vinden zijn

Remote sensing-beelden worden van grote hoogte gemaakt, waardoor auto’s, boten en mensen vaak slechts enkele pixels breed zijn. Standaard objectdetectoren, zoals de populaire YOLO-familie, verkleinen beelden laag voor laag om de verwerking te versnellen en hogere-orde patronen vast te leggen. Voor objecten van slechts 5–10 pixels kan die downsampling ze echter uitwissen voordat het netwerk ze ooit „ziet”. Eerdere pogingen om dit probleem aan te pakken vertrouwen vaak op diepere netwerken, attentiemechanismen of Transformer-achtige modellen. Deze benaderingen kunnen de nauwkeurigheid verbeteren, maar zijn doorgaans te zwaar voor drones, satellieten of edge-apparaten met beperkte geheugen- en stroomcapaciteit. Er bestaat een spanning tussen het klein houden van modellen en het behouden van voldoende detail om piepkleine doelen te herkennen in complexe achtergronden van gebouwen, bomen en water.

Het netwerk per niveau afstemmen

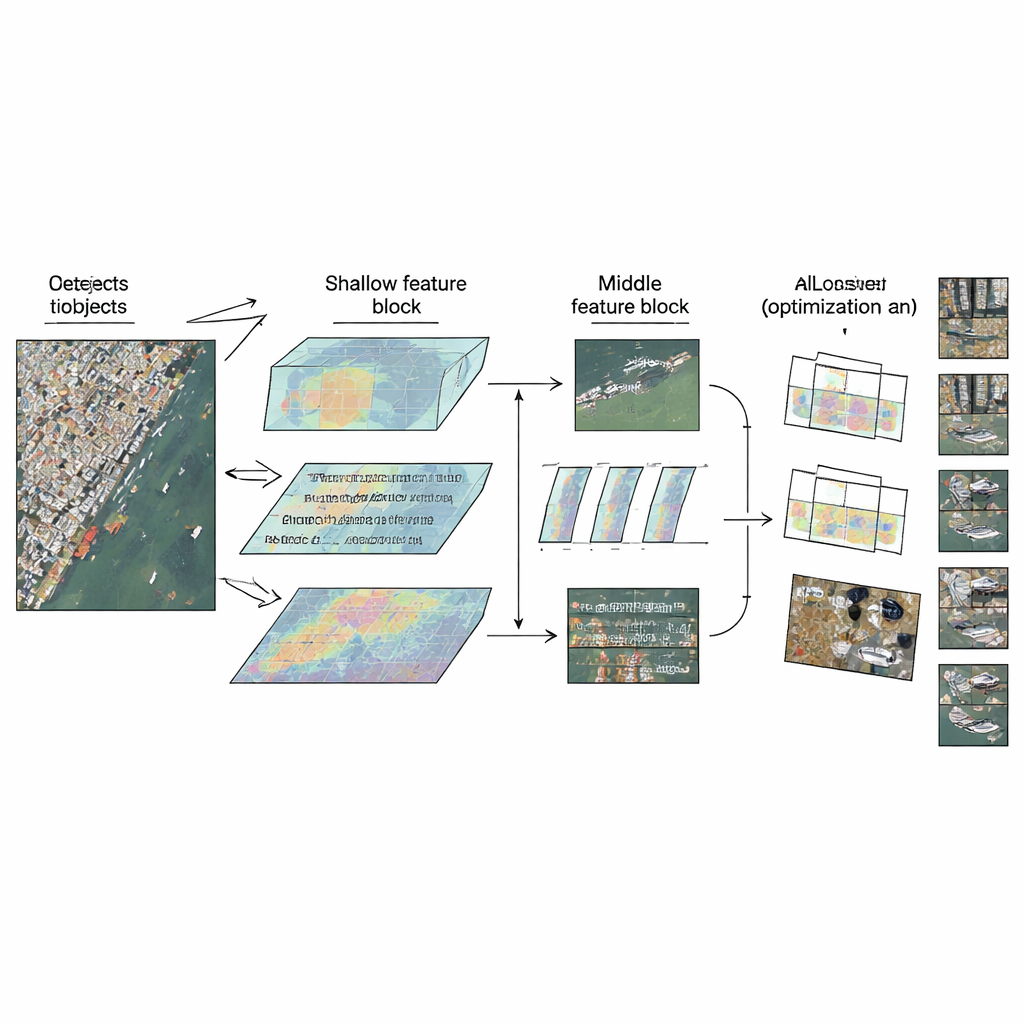

LMW-YOLO vertrekt van een moderne lichtgewicht YOLO-backbone en doorbreekt vervolgens een veelvoorkomende ontwerpgewoonte: alle lagen hetzelfde behandelen. In plaats van overal één uniform bouwblok te gebruiken, stellen de auteurs een "Context-Scale Decoupled"-strategie voor die ieder deel van het netwerk een gespecialiseerde rol geeft. In de ondiepe fase, waar beelden nog relatief groot zijn, heeft het model moeite om ver genoeg te kijken om piepkleine objecten in context te interpreteren. Hier voegen de auteurs een Large-Kernel Context Aggregation (LKCA)-module toe die enorme filtervensters nabootst door meerdere kleinere, efficiënte convoluties te combineren. Dit stelt het netwerk in staat een groter gebied te overzien terwijl fijne details belangrijk voor kleine auto’s of schepen behouden blijven. In de middenfase verschuift de uitdaging: het model moet omgaan met objecten van zeer verschillende formaten zonder ruimtelijke scherpte te verliezen.

Meerdere schalen tegelijk bekijken

Om met die variëteit om te gaan introduceren de auteurs een Multi-Scale Dilated Perception (MSDP)-module in de diepere feature-mappen. Deze module splitst de informatie in twee paden. Het ene pad loopt onveranderd door en behoudt scherpe positionele details. Het andere pad gaat door een set parallelle convolutiebranches die elk op verschillende bereiken "zien", van zeer lokaal tot bredere regio’s, dankzij gedilateerde filters met verschillende openingen. Door deze stromen weer te combineren krijgt het netwerk een rijke multischalige blik: het kan onderscheid maken tussen dicht opeengepakte kleine voertuigen, grotere schepen en uitgestrekte structuren zoals bruggen, terwijl het aantal parameters en berekeningen extreem laag blijft. Samen laten LKCA en MSDP het netwerk zowel lokale details als bredere context volgen in de lagen waar dat het meest relevant is.

Slimmer leren van imperfecte data

Zelfs met betere features is trainen op echte luchtbeelden gecompliceerd. Remote sensing-datasets bevatten vaak ruisende labels, gedeeltelijk verborgen objecten of vreemde vormen die conventionele trainingsverliezen verwarren. Veel YOLO-achtige modellen gebruiken vaste regels die alle trainingsvoorbeelden gelijk behandelen, waardoor een paar slechte voorbeelden misleidende updates kunnen veroorzaken en het leren kunnen vertragen of destabiliseren. LMW-YOLO vervangt dit door een schema genaamd Wise-IoU v3, dat aanpast hoe sterk elk voorbeeld het leren beïnvloedt op basis van hoe goed het momenteel past. Voorbeelden die al erg goed of duidelijk slecht zijn worden minder zwaar gewogen, terwijl de "moeilijke maar nuttige" gevallen worden benadrukt. Deze dynamische focus helpt het model sneller te convergeren en verbetert hoe nauwkeurig het kaders rond kleine, drukke objecten tekent.

Aantonen dat het in de echte wereld werkt

Het team test LMW-YOLO op drie veeleisende benchmarks: een hoge-resolutie satellietdataset (NWPU VHR-10), een gespecialiseerde verzameling van extreem kleine doelen (RS-STOD) en een grote dronebeeldenreeks met zware drukte en occlusie (VisDrone2019). Over alle drie heen presteert het nieuwe model beter dan een reeks recente detectoren, waaronder meerdere grotere en complexere systemen, terwijl het slechts ongeveer 2,6 miljoen parameters en bescheiden rekenwerk gebruikt. Het draait ook realtime of nabij-realtime op standaard CPU’s, wat aangeeft dat het praktisch inzetbaar is op drones en kleine platforms, niet alleen in krachtige datacenters.

Wat dit verder betekent

Voor lezers is de kernboodschap dat we niet langer zo scherp hoeven te kiezen tussen nauwkeurigheid en efficiëntie bij het detecteren van piepkleine objecten van bovenaf. Door zorgvuldig af te stemmen hoe verschillende lagen van een netwerk omgaan met detail en context, en door het te trainen met een verliesfunctie die leert misleidende voorbeelden te negeren, levert LMW-YOLO scherpere, betrouwbaardere detecties terwijl het klein genoeg blijft voor echte lucht- en satelliettoepassingen. Dit maakt het een veelbelovend bouwblok voor toepassingen variërend van verkeersmonitoring en havenbeveiliging tot hulp bij rampen en milieutoezicht, waar elk klein object in een enorm beeld belangrijke informatie kan bevatten.

Bronvermelding: Qiu, Y., Lin, Z. Lightweight model LMW-YOLO for small object detection in remote sensing images. Sci Rep 16, 11644 (2026). https://doi.org/10.1038/s41598-026-45055-6

Trefwoorden: remote sensing, detectie van kleine objecten, lichtgewicht deep learning, luchtbeelden, YOLO-architectuur