Clear Sky Science · zh

无需反向传播的脉冲神经网络与前向—前向算法

教计算机用脉冲思考

当今许多最聪明的机器使用的数学方法,与大脑中的真实处理方式相去甚远。本文探讨了一种在不依赖传统反向传播方案的情况下训练“脉冲”神经网络的新方法——这些网络用短暂的电脉冲进行通信,类似真实神经元的工作方式。作者展示了一种受大脑启发的方法,即前向—前向算法,能够教会这些脉冲网络识别图像和声音,其准确率接近并有时优于现有最佳方法,同时更适合低功耗的类神经形态硬件。

为何脉冲大脑难以训练

脉冲神经网络通过随时间发生的离散突发(或称峰值)来处理信息,而不是平滑连续的数值。这使它们在节能计算以及模拟生物大脑方面具有吸引力。但这也给常规学习算法带来难题:反向传播需要平滑的梯度来调整神经元之间的连接,而脉冲是全或无的事件。虽有变通手段——例如在学习时用代理梯度把脉冲当作平滑信号——但反向传播仍然需要存储大量中间活动并将精确的误差信号向后传递到每一层,这些假设既计算代价高又不符合生物现实。

另一条路径:用两次前向传播学习

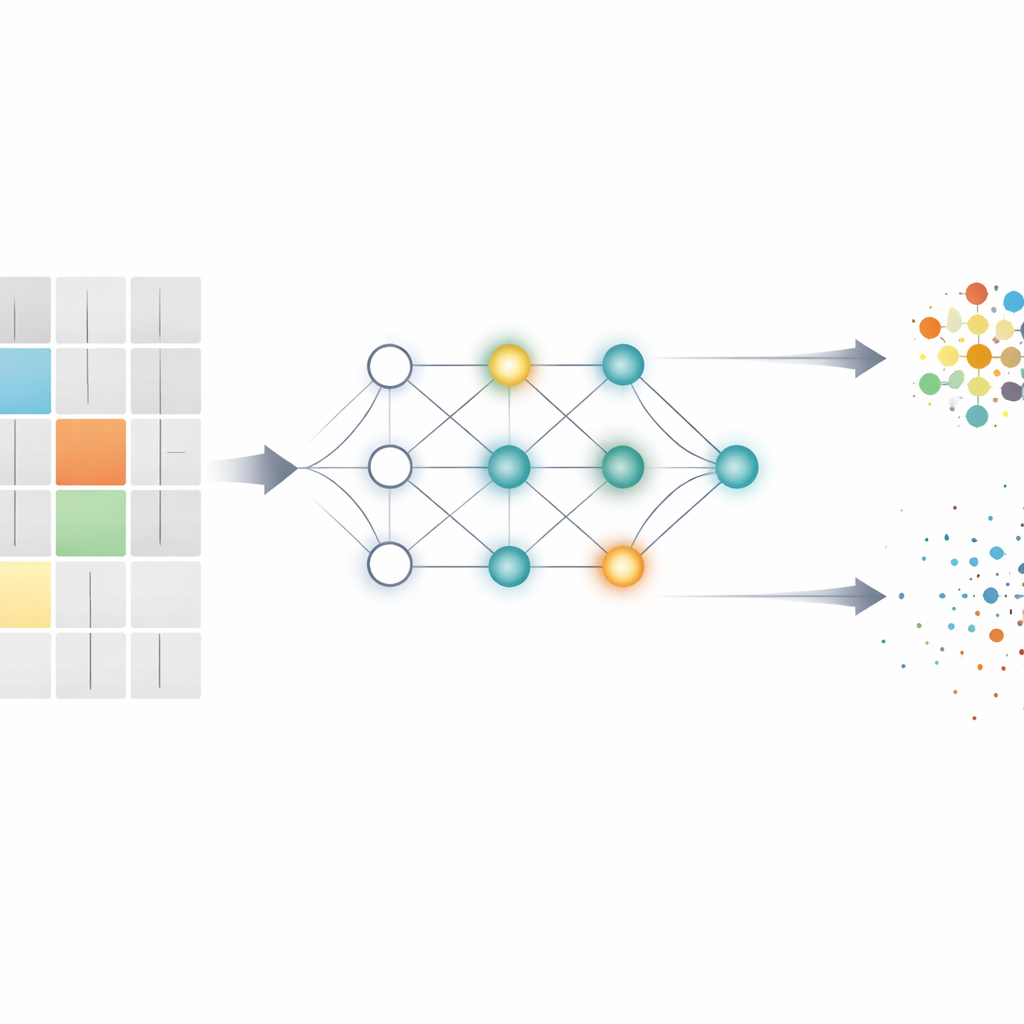

前向—前向算法提供了不同的思路。它不再是一次正向传播后进行反向误差回传,而是对网络的每一层仅用两次前向传播来训练:一次使用与正确类别匹配的“正例”,一次使用以受控方式构造的“负例”。对每层,网络测量一个简单的分数称为“良度”,基于神经元的响应强度。目标是使正例的良度高、负例的良度低。由于每层仅利用自身的活动来更新连接,不需要将误差信号传回整个网络,算法因此更加局部、模块化且更利于硬件实现。

让前向—前向在脉冲网络上可行

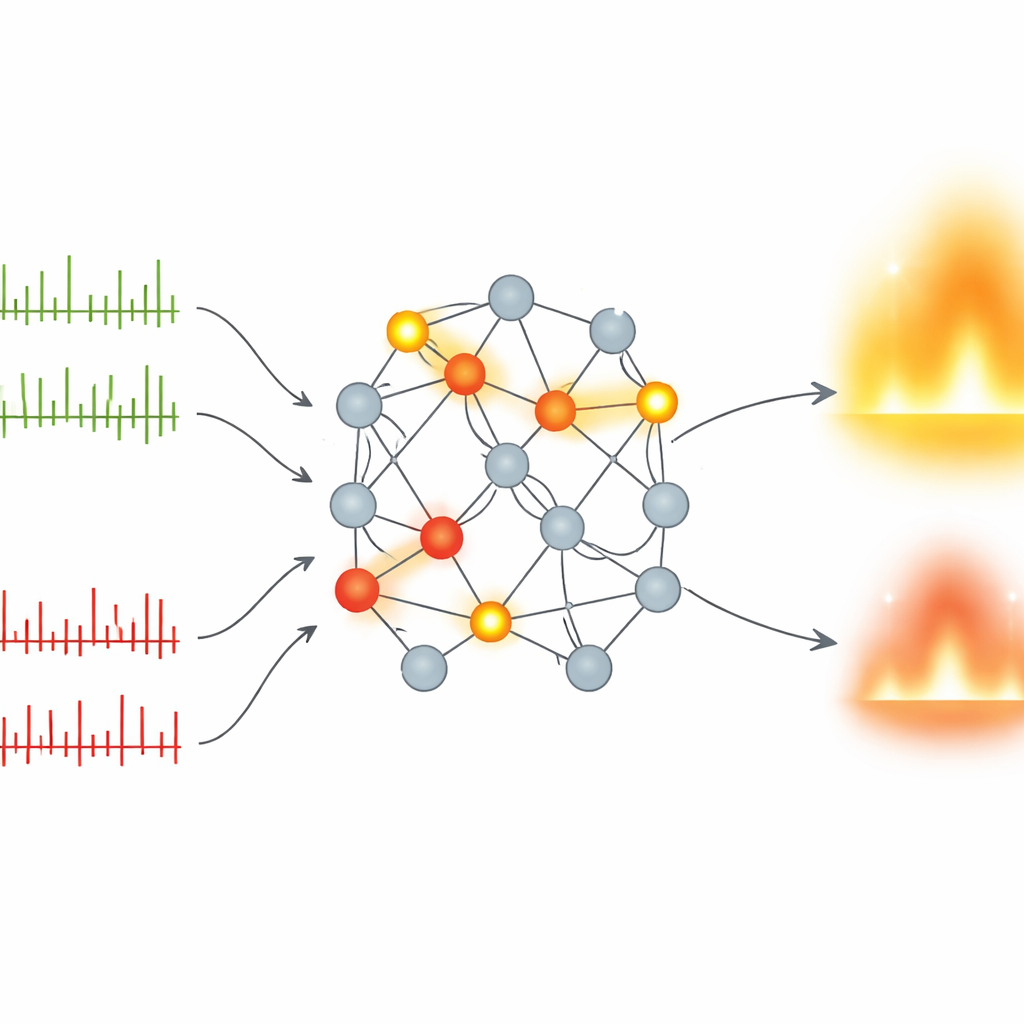

作者通过精心设计输入与标签的编码方式以及良度的度量,将该思想应用到脉冲网络中。首先,图像或声音模式用速率编码转换为脉冲序列——更强的输入在一段短时间内产生更多脉冲。标签直接嵌入到输入的一部分,因此单个向量同时携带数据与候选类别。正样本使用正确标签;负样本使用有意选取的“困难”错误标签,来自那些网络容易混淆的类别。当脉冲在泄漏积分-触发(leaky integrate-and-fire)神经元层间传递时,模型统计每个神经元在正负两次传播中发放脉冲的次数。某层的良度由总体脉冲计数定义,平滑的损失函数鼓励正例良度比负例良度高出足够的边际,同时保持梯度稳定。

这种脉冲方法表现如何?

为验证方法,作者在若干标准视觉基准上训练了紧凑的脉冲网络,包括手写数字(MNIST)、服饰图像、日文字符和彩色物体图像(CIFAR-10),以及那些输入本身已为脉冲的类神经形态数据集,如事件驱动的数字记录(N-MNIST)和以脉冲形式编码的语音数字(SHD)。尽管仅使用两层隐藏层和少至10个时间步,他们的前向—前向脉冲模型在准确率上与其他前向—前向脉冲系统相当或更好,并接近最佳的反向传播训练脉冲网络。在像SHD这样的更具时间性挑战的任务上,他们的方法甚至优于若干基于反向传播的脉冲模型,而且所用参数更少,更容易映射到事件驱动硬件上。

这对未来类脑机器意味着什么

对非专业读者而言,关键信息是:现在出现了一种有前景的方法,可以在不依赖反向传播这一沉重工具的情况下训练受大脑启发的脉冲网络。通过比较每层对好例与坏例的响应强度并完全依赖前向传播,前向—前向方法使学习保持局部与模块化,同时仍能取得有竞争力的准确率。尽管某些成分——如代理梯度和显式标签嵌入——并非严格生物化,但该框架使机器学习更接近真实神经系统可能的适应方式,并为更高效、低功耗且能从流式感官数据实时学习的智能设备打开了道路。

引用: Ghader, M., Kheradpisheh, S.R., Farahani, B. et al. Backpropagation-free spiking neural networks with the forward–forward algorithm. Sci Rep 16, 14294 (2026). https://doi.org/10.1038/s41598-026-41671-4

关键词: 脉冲神经网络, 前向—前向学习, 类神经形态计算, 生物启发的人工智能, 反向传播替代方案