Clear Sky Science · fr

Réseaux de neurones à pointes sans rétropropagation avec l’algorithme forward–forward

Apprendre aux ordinateurs à penser en impulsions

Beaucoup des machines les plus intelligentes d’aujourd’hui apprennent en utilisant des mathématiques qui ne ressemblent en rien à ce qui se passe dans le cerveau. Cet article explore une nouvelle façon d’entraîner des réseaux de neurones « à pointes » — des modèles informatiques qui communiquent par de brèves impulsions électriques, un peu comme les neurones réels — sans recourir à la procédure standard de rétropropagation. Les auteurs montrent qu’une méthode inspirée du cerveau, appelée algorithme forward–forward, peut apprendre à ces réseaux à reconnaître des images et des sons avec une précision proche, et parfois supérieure, aux meilleures méthodes existantes, tout en étant plus compatible avec le matériel neuromorphique à faible consommation d’énergie.

Pourquoi les cerveaux à pointes sont difficiles à entraîner

Les réseaux de neurones à pointes traitent l’information en rafales discrètes, ou pointes, au fil du temps plutôt qu’avec des nombres continus et lisses. Cela les rend attractifs pour un calcul économe en énergie et pour mimer les cerveaux biologiques. Mais cela pose aussi un problème aux algorithmes d’apprentissage classiques : la rétropropagation nécessite des gradients lisses pour ajuster les connexions entre neurones, alors que les pointes sont des événements tout-ou-rien. Des solutions existent — comme les gradients de substitution qui font comme si les pointes étaient lisses pendant l’apprentissage — mais la rétropropagation exige toujours de stocker de grandes quantités d’activité intermédiaire et d’envoyer des signaux d’erreur précis en arrière à travers chaque couche, des hypothèses à la fois coûteuses en calcul et peu réalistes biologiquement.

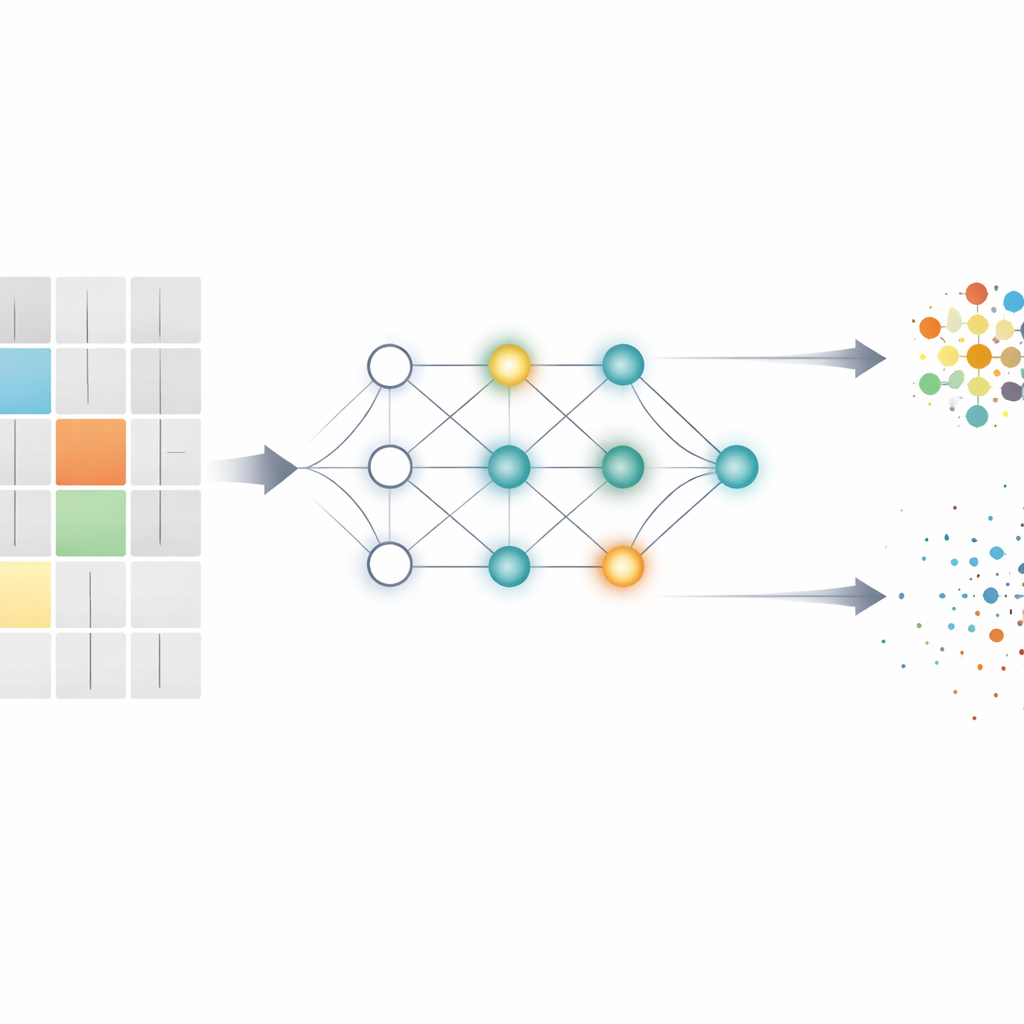

Une voie différente : apprendre avec deux passages vers l’avant

L’algorithme forward–forward propose une approche contrastée. Au lieu d’un passage vers l’avant suivi d’un balayage arrière de signaux d’erreur, chaque couche du réseau est entraînée à l’aide de deux passages vers l’avant seulement : l’un avec des exemples « positifs » correspondant au bon label, et l’autre avec des exemples « négatifs » construits pour être faux de manière contrôlée. Pour chaque couche, le réseau mesure un score simple appelé « bienveillance » (goodness), basé sur l’intensité de la réponse de ses neurones. L’objectif est d’obtenir une bienveillance élevée pour les entrées positives et faible pour les négatives. Comme chaque couche n’utilise que sa propre activité pour mettre à jour ses connexions, il n’est pas nécessaire d’envoyer des signaux d’erreur à travers tout le réseau, et l’algorithme devient plus local, modulaire et adapté au matériel.

Adapter le forward–forward aux pointes

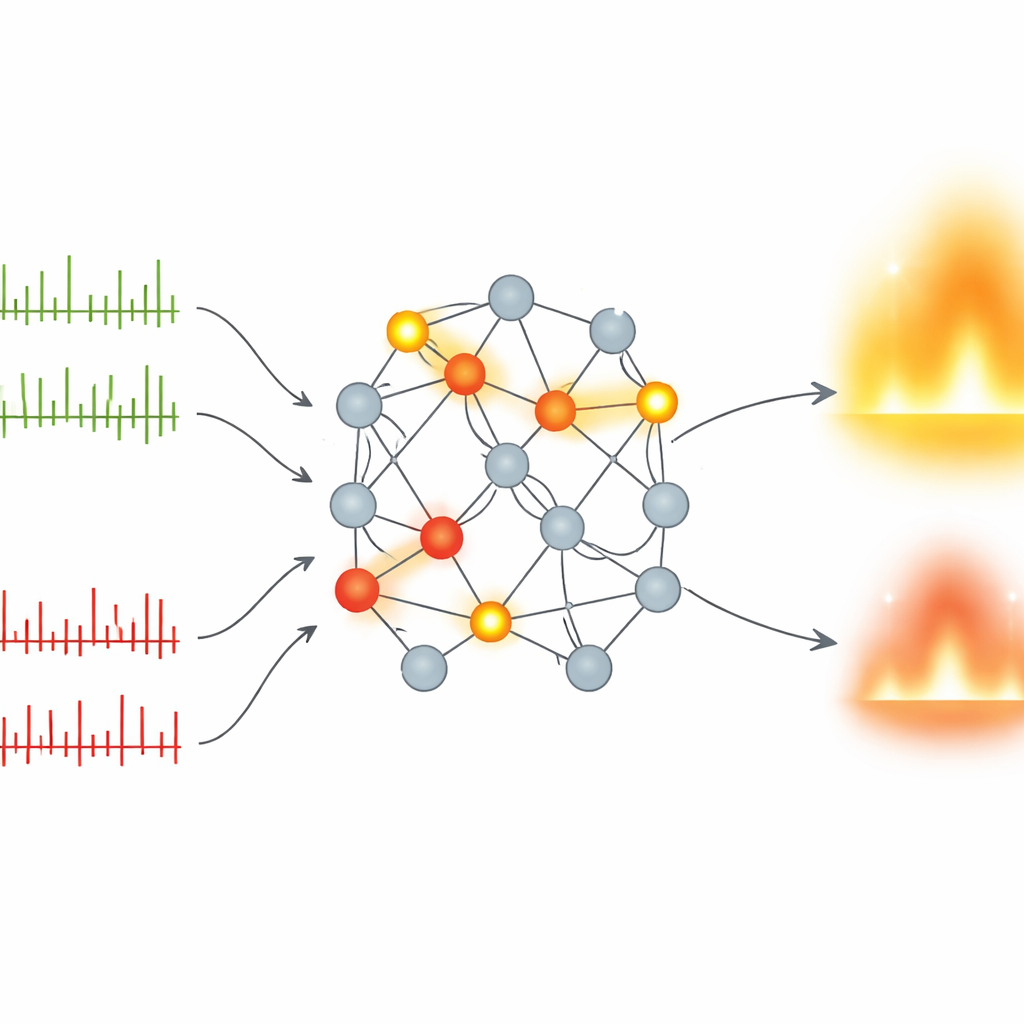

Les auteurs adaptent cette idée aux réseaux à pointes en concevant soigneusement l’encodage des entrées et des étiquettes et la manière de mesurer la bienveillance. D’abord, les images ou motifs sonores sont convertis en trains de pointes par codage en taux : des entrées plus intenses produisent plus de pointes sur une courte série d’instants. Les labels sont intégrés directement dans une partie de l’entrée, de sorte qu’un même vecteur porte à la fois les données et une classe candidate. Les échantillons positifs utilisent le label correct ; les échantillons négatifs utilisent un label incorrect volontairement « difficile », choisi parmi des classes que le réseau a tendance à confondre. Au fur et à mesure que les pointes traversent des couches de neurones à fuite et intégrateurs, le modèle compte la fréquence d’événements de chaque neurone pour les passages positifs et négatifs. La bienveillance d’une couche est alors définie par le total des comptages de pointes, et une fonction de perte lisse encourage la bienveillance positive à dépasser la négative d’une marge confortable tout en gardant des gradients stables.

Quelle est la performance de cette méthode à pointes ?

Pour tester leur approche, les auteurs entraînent des réseaux à pointes compacts sur plusieurs benchmarks visuels standard, y compris des chiffres manuscrits (MNIST), des articles de mode, des caractères japonais et des images d’objets en couleur (CIFAR-10), ainsi que des jeux de données neuromorphiques où les entrées arrivent déjà sous forme de pointes, comme des enregistrements d’événements de chiffres (N-MNIST) et des chiffres parlés codés en trains de pointes (SHD). Malgré l’utilisation d’à peine deux couches cachées et d’aussi peu que 10 pas temporels, leurs modèles forward–forward à pointes égalent ou surpassent d’autres systèmes forward–forward à pointes et se rapprochent des meilleurs réseaux à pointes entraînés par rétropropagation. Sur des tâches temporelles plus exigeantes comme SHD, leur méthode dépasse même plusieurs modèles à pointes basés sur la rétropropagation, tout en utilisant moins de paramètres et en restant plus facile à mapper sur du matériel événementiel.

Que signifie cela pour les machines inspirées du cerveau ?

Pour un lecteur non spécialiste, le message clé est qu’il existe désormais une voie prometteuse pour entraîner des réseaux inspirés du cerveau, basés sur des pointes, sans dépendre de la lourde machinerie de la rétropropagation. En évaluant chaque couche sur la base de sa réaction aux bons et aux mauvais exemples, et en travaillant uniquement avec des passages vers l’avant, l’approche forward–forward maintient l’apprentissage local et modulaire tout en atteignant une précision compétitive. Bien que certains ingrédients — comme les gradients de substitution et l’intégration explicite des labels — ne soient pas strictement biologiques, ce cadre rapproche l’apprentissage machine de la façon dont les systèmes nerveux réels pourraient s’adapter, et ouvre la voie à des dispositifs intelligents plus efficaces et à faible consommation qui apprennent à partir de flux sensoriels en temps réel.

Citation: Ghader, M., Kheradpisheh, S.R., Farahani, B. et al. Backpropagation-free spiking neural networks with the forward–forward algorithm. Sci Rep 16, 14294 (2026). https://doi.org/10.1038/s41598-026-41671-4

Mots-clés: réseaux de neurones à pointes, apprentissage forward–forward, informatique neuromorphique, IA inspirée biologiquement, alternatives à la rétropropagation