Clear Sky Science · sv

Spikfria spikande neurala nätverk med forward–forward-algoritmen

Lära datorer att tänka i spikar

Många av dagens mest avancerade maskiner lär sig med matematik som knappt liknar vad som sker i hjärnan. Den här artikeln undersöker ett nytt sätt att träna ”spikande” neurala nätverk — datoriserade modeller som kommunicerar med korta elektriska pulser, ungefär som riktiga neuroner — utan att förlita sig på den vanliga backpropagation-receptet. Författarna visar att en hjärninspirerad metod kallad forward–forward-algoritmen kan lära dessa spikande nätverk att känna igen bilder och ljud med noggrannhet nära, och ibland bättre än, de bästa befintliga metoderna, samtidigt som den är mer förenlig med energieffektiv neuromorf hårdvara.

Varför spikande nät är svåra att träna

Spikande neurala nätverk bearbetar information med diskreta utbrott, eller spikar, över tid i stället för mjuka, kontinuerliga värden. Det gör dem attraktiva för energieffektiv beräkning och för att efterlikna biologiska hjärnor. Men det skapar också problem för konventionella inlärningsalgoritmer: backpropagation behöver släta gradienter för att justera kopplingarna mellan neuroner, medan spikar är allt-eller-inget-händelser. Det finns lösningar — såsom surrogate gradients som låtsas att spikar är släta under inlärning — men backpropagation kräver fortfarande att stora mängder mellanliggande aktivitet lagras och att precisa fel-signaler skickas bakåt genom varje lager, antaganden som både är beräkningsmässigt tunga och biologiskt orealistiska.

En annan väg: inlärning med två framåtriktade pass

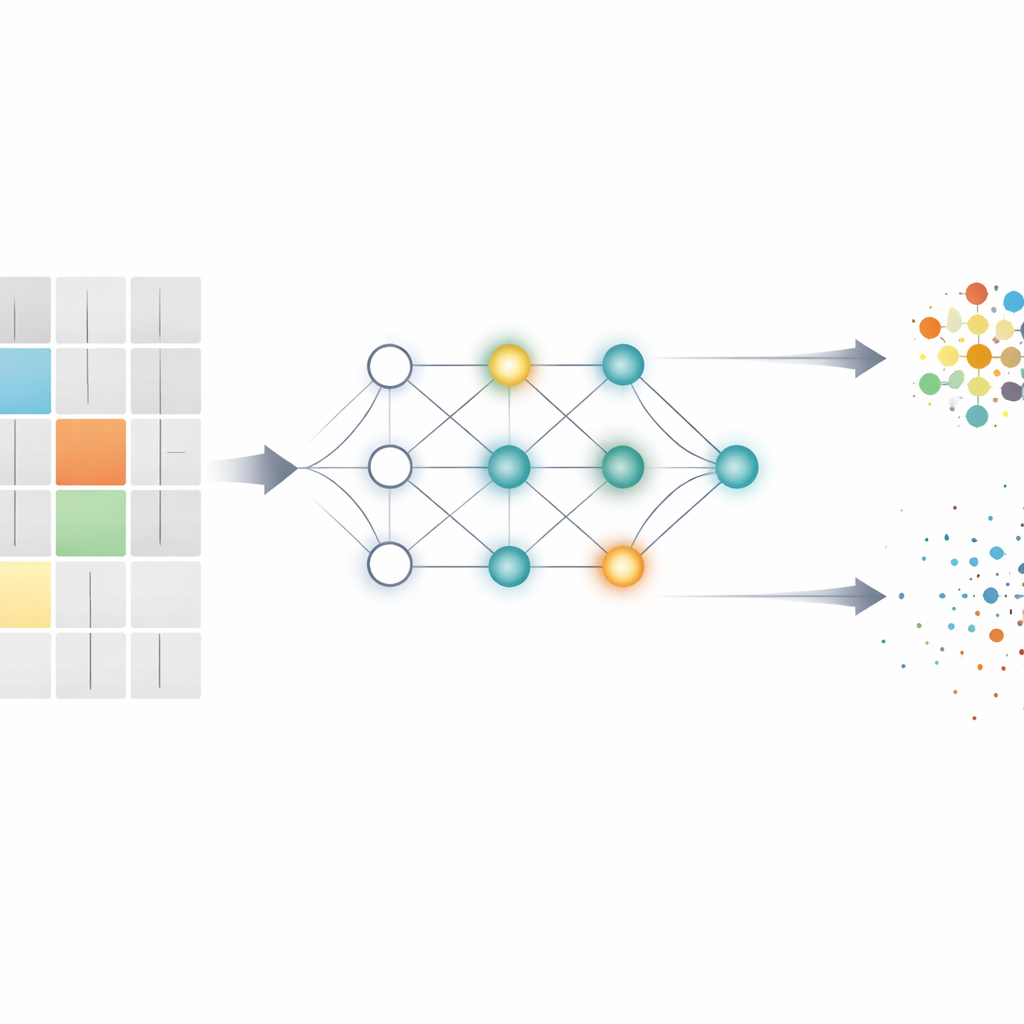

Forward–forward-algoritmen erbjuder ett kontrasterande angreppssätt. I stället för ett framåtriktat pass följt av en bakåtsvepning av fel-signaler tränas varje lager i nätverket med endast två framåtriktade pass: ett med ”positiva” exempel som stämmer överens med rätt etikett, och ett med ”negativa” exempel konstruerade för att vara fel på ett kontrollerat sätt. För varje lager mäter nätverket en enkel poäng kallad ”godhet”, baserad på hur starkt dess neuroner svarar. Målet är att göra godheten hög för positiva indata och låg för negativa. Eftersom varje lager endast använder sin egen aktivitet för att uppdatera sina kopplingar behövs inga fel-signaler skickade tillbaka genom hela nätverket, och algoritmen blir mer lokal, modulär och hårdvaruvänlig.

Få forward–forward att fungera med spikar

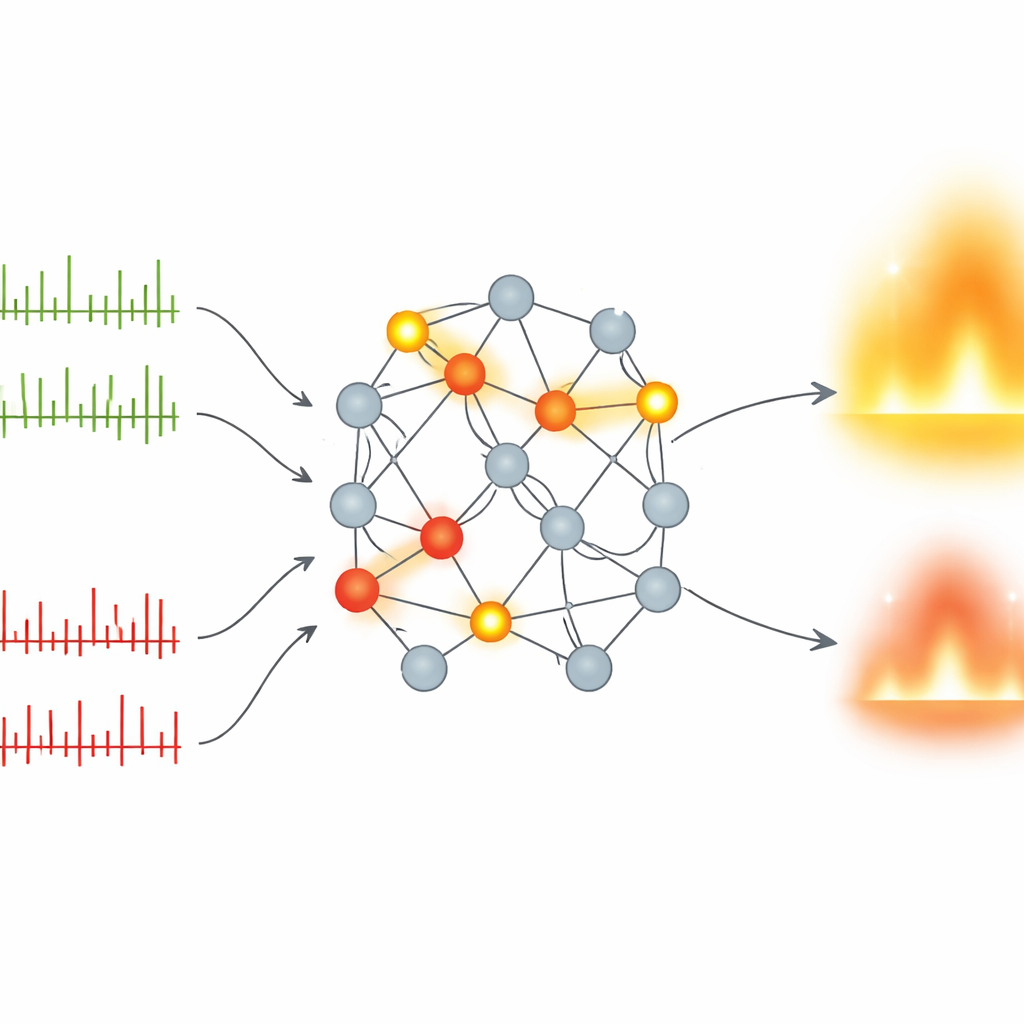

Författarna anpassar idén till spikande nätverk genom att noggrant utforma hur indata och etiketter kodas och hur godhet mäts. Först omvandlas bilder eller ljudmönster till spikströmmar med hjälp av rate coding — intensivare indata ger fler spikar över en kort serie tidssteg. Etiketter bäddas in direkt i en del av indatan, så att en enda vektor innehåller både data och en kandidatklass. Positiva prov använder korrekt etikett; negativa prov använder en avsiktligt ”svår” felaktig etikett vald från klasser som nätverket tenderar att förväxla. När spikar flödar genom lager av leaky integrate-and-fire-neuroner räknar modellen hur ofta varje neuron avfyrar för positiva respektive negativa pass. Ett lags godhet definieras sedan av de totala spikantalet, och en slät förlustfunktion uppmuntrar att positiv godhet överstiger negativ godhet med en trygg marginal samtidigt som gradienterna hålls stabila.

Hur bra fungerar denna spikmetod?

För att testa sin metod tränar författarna kompakta spikande nätverk på flera standardiserade vision-benchmarks, inklusive handskrivna siffror (MNIST), modeartiklar, japanska tecken och färgade objektbilder (CIFAR-10), liksom neuromorfa dataset där indata redan ankommer som spikar, som händelsebaserade digitinspelningar (N-MNIST) och talade siffror kodade som spikströmmar (SHD). Trots att de använder endast två dolda lager och så få som 10 tidssteg matchar deras forward–forward-spikmodeller eller överträffar andra forward–forward-spiksystem och kommer nära de bästa backpropagation-tränade spiknäten. I mer krävande temporala uppgifter som SHD överträffar deras metod till och med flera backpropagation-baserade spikmodeller, samtidigt som den använder färre parametrar och är lättare att kartlägga på händelsedriven hårdvara.

Vad detta innebär för framtida hjärnliknande maskiner

För en allmän läsare är huvudbudskapet att det nu finns ett lovande sätt att träna hjärninspirerade, spikbaserade nätverk utan att förlita sig på den tunga backpropagation-mekaniken. Genom att bedöma varje lager utifrån hur starkt det svarar på bra respektive dåliga exempel, och genom att arbeta helt med framåtriktade pass, håller forward–forward-ansatsen inlärningen lokal och modulär samtidigt som den uppnår konkurrenskraftig noggrannhet. Även om vissa ingredienser — som surrogate gradients och explicit etikettinbäddning — inte är strikt biologiska, flyttar detta ramverk maskininlärning ett steg närmare hur verkliga nervsystem kan anpassa sig, och öppnar en väg mot mer effektiva, lågströms intelligenta enheter som lär sig från strömmande sensoriska data i realtid.

Citering: Ghader, M., Kheradpisheh, S.R., Farahani, B. et al. Backpropagation-free spiking neural networks with the forward–forward algorithm. Sci Rep 16, 14294 (2026). https://doi.org/10.1038/s41598-026-41671-4

Nyckelord: spikande neurala nätverk, forward-forward-inlärning, neuromorf datorarkitektur, biologiskt inspirerad AI, alternativ till backpropagation