Clear Sky Science · pt

Redes neurais pulsantes sem retropropagação com o algoritmo forward–forward

Ensinando computadores a pensar em pulsos

Muitas das máquinas mais inteligentes de hoje aprendem usando matemática que não se parece com o que acontece no cérebro. Este artigo explora uma nova forma de treinar redes neurais “pulsantes” — modelos computacionais que se comunicam por breves pulsos elétricos, assim como neurônios reais — sem depender da receita padrão da retropropagação. Os autores mostram que um método inspirado no cérebro, chamado algoritmo forward–forward, pode ensinar essas redes pulsantes a reconhecer imagens e sons com precisão próxima, e às vezes superior, às melhores abordagens existentes, ao mesmo tempo em que é mais compatível com hardware neuromórfico de baixo consumo.

Por que cérebros pulsantes são difíceis de treinar

Redes neurais pulsantes processam informação usando explosões discretas, ou pulsos, ao longo do tempo em vez de números contínuos e suaves. Isso as torna atraentes para computação energeticamente eficiente e para imitar cérebros biológicos. Mas também cria um problema para algoritmos de aprendizado convencionais: a retropropagação precisa de gradientes suaves para ajustar as conexões entre neurônios, enquanto os pulsos são eventos tudo-ou-nada. Existem soluções paliativas — como gradientes substitutos que fingem que os pulsos são suaves durante o aprendizado —, mas a retropropagação ainda exige armazenar grandes quantidades de atividade intermediária e enviar sinais de erro precisos para trás em cada camada, pressupostos que são computacionalmente pesados e biologicamente pouco realistas.

Um caminho diferente: aprender com duas passagens para frente

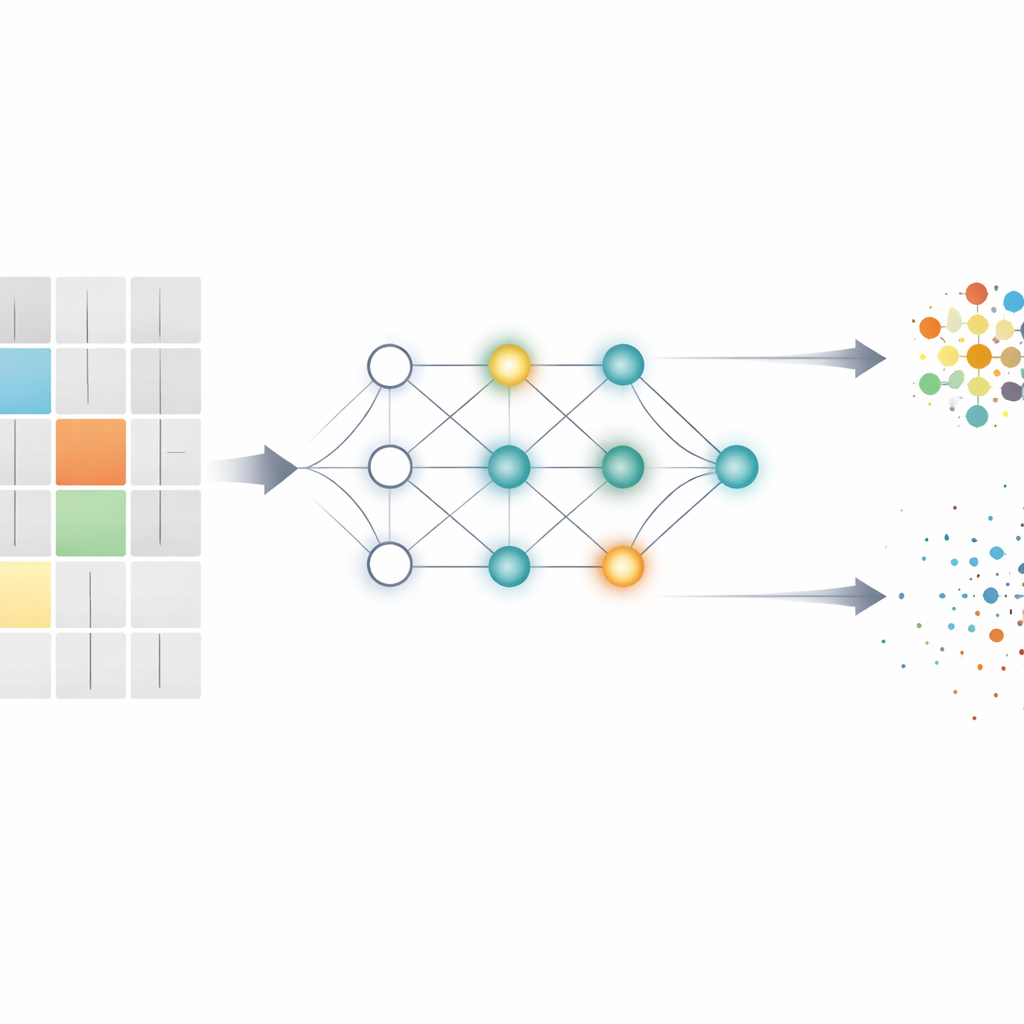

O algoritmo forward–forward oferece uma abordagem contrastante. Em vez de uma passagem para frente seguida por uma varredura para trás de sinais de erro, cada camada da rede é treinada usando apenas duas passagens para frente: uma com exemplos “positivos” que correspondem ao rótulo correto e outra com exemplos “negativos” construídos para estar errados de forma controlada. Para cada camada, a rede mede uma pontuação simples chamada “bondade”, baseada em quão fortemente seus neurônios respondem. O objetivo é tornar a bondade elevada para entradas positivas e baixa para as negativas. Como cada camada usa apenas sua própria atividade para atualizar suas conexões, não há necessidade de enviar sinais de erro por toda a rede, e o algoritmo se torna mais local, modular e favorável ao hardware.

Fazendo o forward–forward funcionar com pulsos

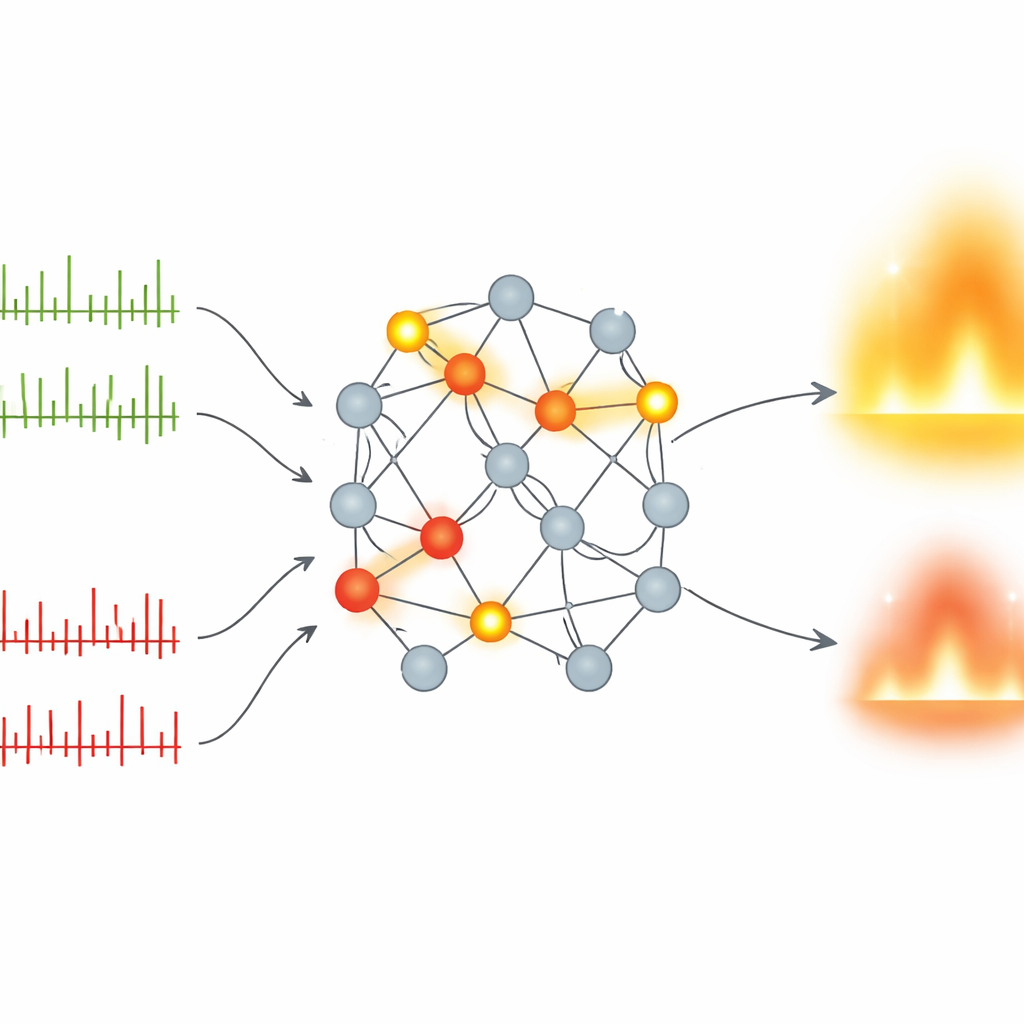

Os autores adaptam essa ideia para redes pulsantes ao projetar cuidadosamente como entradas e rótulos são codificados e como a bondade é medida. Primeiro, imagens ou padrões sonoros são transformados em trens de pulsos usando codificação por taxa — entradas mais intensas geram mais pulsos ao longo de uma curta sequência de passos de tempo. Rótulos são embutidos diretamente em parte da entrada, de modo que um único vetor carrega tanto os dados quanto uma classe candidata. Amostras positivas usam o rótulo correto; amostras negativas usam um rótulo incorreto deliberadamente “difícil”, escolhido entre classes que a rede tende a confundir. À medida que os pulsos atravessam camadas de neurônios do tipo leaky integrate-and-fire, o modelo conta com que frequência cada neurônio dispara nas passagens positivas e negativas. A bondade de uma camada é então definida pelas contagens globais de pulsos, e uma função de perda suave incentiva que a bondade positiva supere a negativa por uma margem confortável, mantendo os gradientes estáveis.

Quão bem esse método pulsante performa?

Para testar sua abordagem, os autores treinam redes pulsantes compactas em vários benchmarks visuais padrão, incluindo dígitos manuscritos (MNIST), itens de moda, caracteres japoneses e imagens coloridas de objetos (CIFAR-10), bem como conjuntos neuromórficos em que as entradas já chegam como pulsos, como gravações baseadas em eventos de dígitos (N-MNIST) e dígitos falados codificados como trens de pulsos (SHD). Apesar de usar apenas duas camadas ocultas e tão pouco quanto 10 passos de tempo, seus modelos pulsantes forward–forward igualam ou superam outros sistemas pulsantes forward–forward e se aproximam dos melhores modelos pulsantes treinados por retropropagação. Em tarefas temporais mais exigentes como SHD, o método deles chega a superar vários modelos pulsantes baseados em retropropagação, tudo isso usando menos parâmetros e permanecendo mais fácil de mapear para hardware orientado a eventos.

O que isso significa para máquinas futuras semelhantes ao cérebro

Para um leitor leigo, a mensagem principal é que agora existe um caminho promissor para treinar redes inspiradas no cérebro e baseadas em pulsos sem depender da pesada maquinaria da retropropagação. Ao julgar cada camada pela força de sua resposta a exemplos bons versus ruins, e ao trabalhar inteiramente com passagens para frente, a abordagem forward–forward mantém o aprendizado local e modular, ao mesmo tempo em que alcança precisão competitiva. Embora alguns ingredientes — como gradientes substitutos e incorporação explícita de rótulos — não sejam estritamente biológicos, essa estrutura aproxima o aprendizado de máquina de como sistemas nervosos reais podem se adaptar e abre um caminho para dispositivos inteligentes mais eficientes e de baixo consumo que aprendem com dados sensoriais em fluxo contínuo, em tempo real.

Citação: Ghader, M., Kheradpisheh, S.R., Farahani, B. et al. Backpropagation-free spiking neural networks with the forward–forward algorithm. Sci Rep 16, 14294 (2026). https://doi.org/10.1038/s41598-026-41671-4

Palavras-chave: redes neurais pulsantes, aprendizado forward-forward, computação neuromórfica, IA inspirada biologicamente, alternativas à retropropagação