Clear Sky Science · nl

Spikende neurale netwerken zonder backpropagation met het forward–forward-algoritme

Computers leren denken in spikes

Veel van de slimste machines van vandaag leren met wiskunde die weinig lijkt op wat er in het brein gebeurt. Dit artikel verkent een nieuwe manier om "spikende" neurale netwerken te trainen—computermodellen die communiceren met korte elektrische pulsen, vergelijkbaar met echte neuronen—zonder te vertrouwen op het gebruikelijke backpropagation-recept. De auteurs tonen aan dat een hersengeïnspireerde methode genaamd het forward–forward-algoritme deze spikende netwerken kan leren beelden en geluiden te herkennen met een nauwkeurigheid die dicht bij, en soms beter is dan, de beste bestaande methoden, terwijl het tevens beter compatibel is met energiezuinige, neuromorfe hardware.

Waarom spikende netwerken moeilijk te trainen zijn

Spikende neurale netwerken verwerken informatie met discrete pulsen, of spikes, over de tijd in plaats van met vloeiende, continue waarden. Dat maakt ze aantrekkelijk voor energiezuinige berekeningen en voor het nabootsen van biologische hersenen. Maar het veroorzaakt ook problemen voor conventionele leeralgoritmen: backpropagation heeft vloeiende gradiënten nodig om de verbindingen tussen neuronen aan te passen, terwijl spikes alles-of-niets-gebeurtenissen zijn. Er bestaan omwegen—zoals surrogate-gradiënten die tijdens het leren doen alsof spikes vloeiend zijn—maar backpropagation vereist nog steeds het opslaan van grote hoeveelheden tussenliggende activiteit en het terugsturen van precieze foutsignalen door elke laag heen, veronderstellingen die zowel rekenkundig zwaar als biologisch onrealistisch zijn.

Een andere weg: leren met twee forward-passes

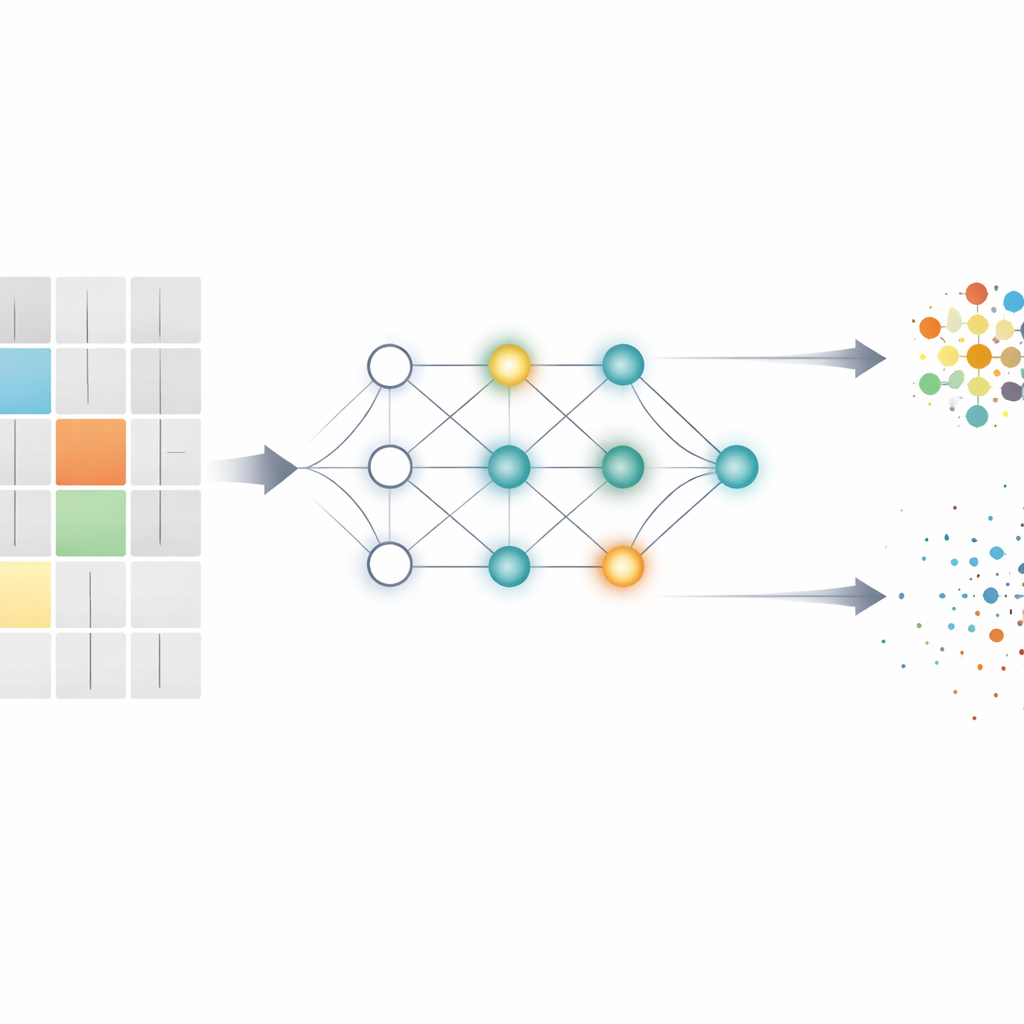

Het forward–forward-algoritme biedt een contrasterende benadering. In plaats van één forward-pass gevolgd door een backward-sweep met foutsignalen, wordt elke laag van het netwerk alleen getraind met twee forward-passes: één met "positieve" voorbeelden die bij het juiste label horen, en één met "negatieve" voorbeelden die op een gecontroleerde manier fout zijn geconstrueerd. Voor elke laag meet het netwerk een eenvoudige score, genaamd "goodness", gebaseerd op hoe sterk de neuronen reageren. Het doel is om de goodness hoog te maken voor positieve inputs en laag voor negatieve. Omdat elke laag alleen zijn eigen activiteit gebruikt om zijn verbindingen bij te werken, is er geen behoefte aan het terugsturen van foutsignalen door het hele netwerk, en wordt het algoritme lokaal, modulair en hardwarevriendelijker.

Forward–forward toepassen op spikes

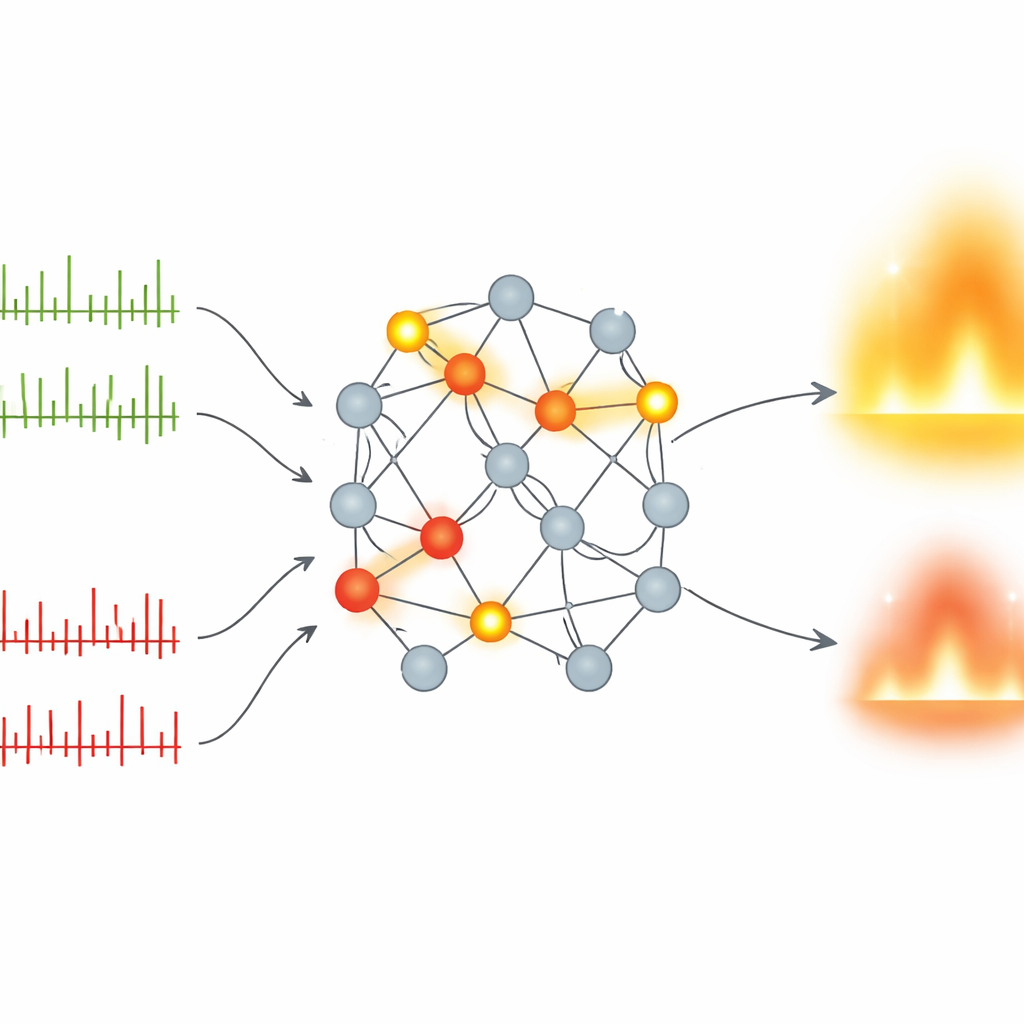

De auteurs passen dit idee toe op spikende netwerken door zorgvuldig te ontwerpen hoe inputs en labels worden gecodeerd en hoe goodness wordt gemeten. Ten eerste worden beelden of geluidspatronen omgezet in spike-treinen met behulp van rate coding—intensievere inputs produceren meer spikes over een korte reeks tijdstappen. Labels worden direct ingebed in een deel van de input, zodat één vector zowel de data als een kandidaatklasse draagt. Positieve voorbeelden gebruiken het juiste label; negatieve voorbeelden gebruiken opzettelijk een "moeilijk" fout label, gekozen uit klassen die het netwerk geneigd is te verwisselen. Terwijl spikes door lagen van leaky integrate-and-fire-neuronen stromen, telt het model hoe vaak elk neuron vuurt tijdens positieve en negatieve passen. De goodness van een laag wordt vervolgens gedefinieerd door de totale spike-aantallen, en een vloeiende verliesfunctie stimuleert dat positieve goodness de negatieve met een comfortabele marge overschrijdt terwijl de gradiënten stabiel blijven.

Hoe goed presteert deze spikende methode?

Om hun benadering te testen trainen de auteurs compacte spikende netwerken op verschillende standaard visuele benchmarks, waaronder handgeschreven cijfers (MNIST), modeartikelen, Japanse karakters en gekleurde objectbeelden (CIFAR-10), evenals neuromorfe datasets waarbij inputs al binnenkomen als spikes, zoals event-gebaseerde cijferopnames (N-MNIST) en gesproken cijfers gecodeerd als spike-treinen (SHD). Ondanks het gebruik van slechts twee verborgen lagen en zo weinig als 10 tijdstappen, evenaren of overtreffen hun forward–forward spikende modellen andere forward–forward spikende systemen en benaderen ze de beste met backpropagation getrainde spikende netwerken. Bij meer veeleisende temporele taken zoals SHD presteert hun methode zelfs beter dan verschillende op backpropagation gebaseerde spikende modellen, terwijl ze minder parameters gebruiken en eenvoudiger te mappen zijn naar event-gedreven hardware.

Wat betekent dit voor toekomstige hersenachtige machines?

Voor een algemeen publiek is de kernboodschap dat er nu een veelbelovende manier bestaat om hersengeïnspireerde, spike-gebaseerde netwerken te trainen zonder te steunen op de zware werktuigen van backpropagation. Door elke laag te beoordelen op hoe sterk deze reageert op goede versus slechte voorbeelden, en door geheel met forward-passes te werken, houdt de forward–forward-benadering leren lokaal en modulair terwijl het toch concurrerende nauwkeurigheid bereikt. Hoewel sommige ingrediënten—zoals surrogate-gradiënten en expliciete label-embedding—niet strikt biologisch zijn, brengt dit raamwerk machine learning dichter bij hoe echte zenuwstelsels zich mogelijk aanpassen, en opent het een pad naar efficiëntere, energiezuinigere intelligente apparaten die in real time leren van doorlopende sensorische data.

Bronvermelding: Ghader, M., Kheradpisheh, S.R., Farahani, B. et al. Backpropagation-free spiking neural networks with the forward–forward algorithm. Sci Rep 16, 14294 (2026). https://doi.org/10.1038/s41598-026-41671-4

Trefwoorden: spikende neurale netwerken, forward-forward leren, neuromorfe computing, biologisch geïnspireerde AI, alternatieven voor backpropagation