Clear Sky Science · pl

Sieci neuronowe z impulsami bez wstecznej propagacji z algorytmem forward–forward

Nauczanie komputerów myślenia w impulsach

Wiele z dziś najinteligentniejszych maszyn uczy się przy użyciu matematyki, która niewiele ma wspólnego z tym, co dzieje się w mózgu. W artykule badano nowy sposób trenowania „impulsowych” sieci neuronowych — modeli komputerowych komunikujących się krótkimi impulsami elektrycznymi, podobnie jak prawdziwe neurony — bez polegania na standardowym przepisie wstecznej propagacji. Autorzy pokazują, że inspirowana mózgiem metoda zwana algorytmem forward–forward potrafi nauczyć takie sieci rozpoznawania obrazów i dźwięków z dokładnością zbliżoną, a czasem lepszą, od najlepszych istniejących metod, przy jednoczesnej lepszej zgodności ze sprzętem neuromorficznym o niskim poborze energii.

Dlaczego trudno szkolić impulsowe mózgi

Sieci neuronowe z impulsami przetwarzają informacje za pomocą dyskretnych wybuchów, czyli impulsów, rozłożonych w czasie, zamiast gładkich, ciągłych wartości. Czyni to je atrakcyjnymi dla energooszczędnych obliczeń i do naśladowania mózgów biologicznych. Jednocześnie stwarza to problemy dla konwencjonalnych algorytmów uczenia: wsteczna propagacja potrzebuje gładkich gradientów do korekty połączeń między neuronami, podczas gdy impulsy są zjawiskami typu wszystko-albo-nic. Istnieją obejścia — na przykład zastępcze gradienty, które udają gładkość impulsów podczas uczenia — lecz wsteczna propagacja nadal wymaga przechowywania dużych ilości pośredniej aktywności i przesyłania precyzyjnych sygnałów błędu wstecz przez każdą warstwę, co jest zarówno obciążające obliczeniowo, jak i biologicznie nierealistyczne.

Inna droga: uczenie dwoma przejściami w przód

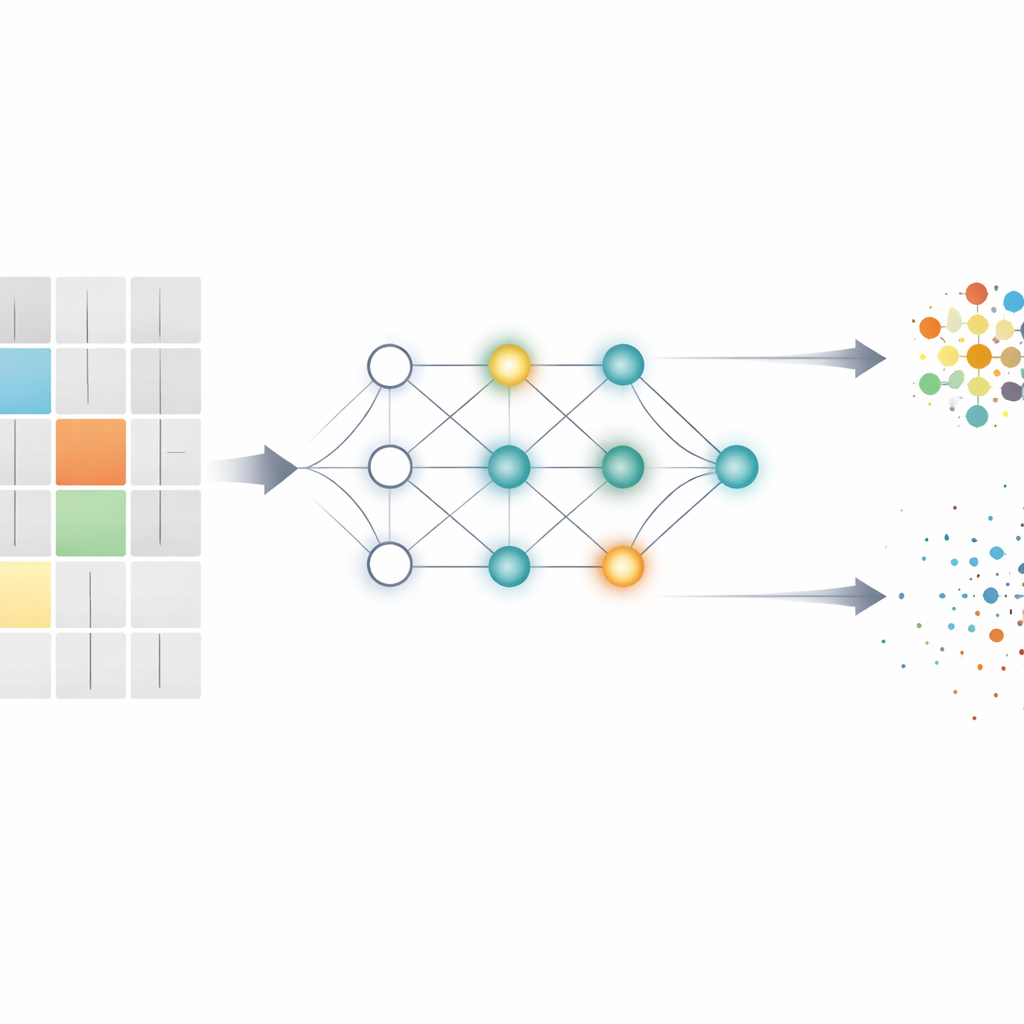

Algorytm forward–forward proponuje przeciwstawne podejście. Zamiast jednego przejścia w przód, po którym następuje wsteczne rozpropagowanie błędów, każda warstwa sieci jest trenowana wyłącznie przy użyciu dwóch przejść w przód: jednego z przykładami „pozytywnymi”, odpowiadającymi właściwej etykiecie, i jednego z przykładami „negatywnymi” skonstruowanymi celowo jako błędne w kontrolowany sposób. Dla każdej warstwy sieć mierzy prosty wskaźnik zwany „dobrocią”, oparty na tym, jak mocno reagują jej neurony. Celem jest uzyskanie wysokiej dobroci dla wejść pozytywnych i niskiej dla negatywnych. Ponieważ każda warstwa aktualizuje połączenia tylko na podstawie własnej aktywności, nie ma potrzeby przesyłania sygnałów błędu przez całą sieć, a algorytm staje się bardziej lokalny, modułowy i przyjazny dla sprzętu.

Jak sprawić, by forward–forward działało z impulsami

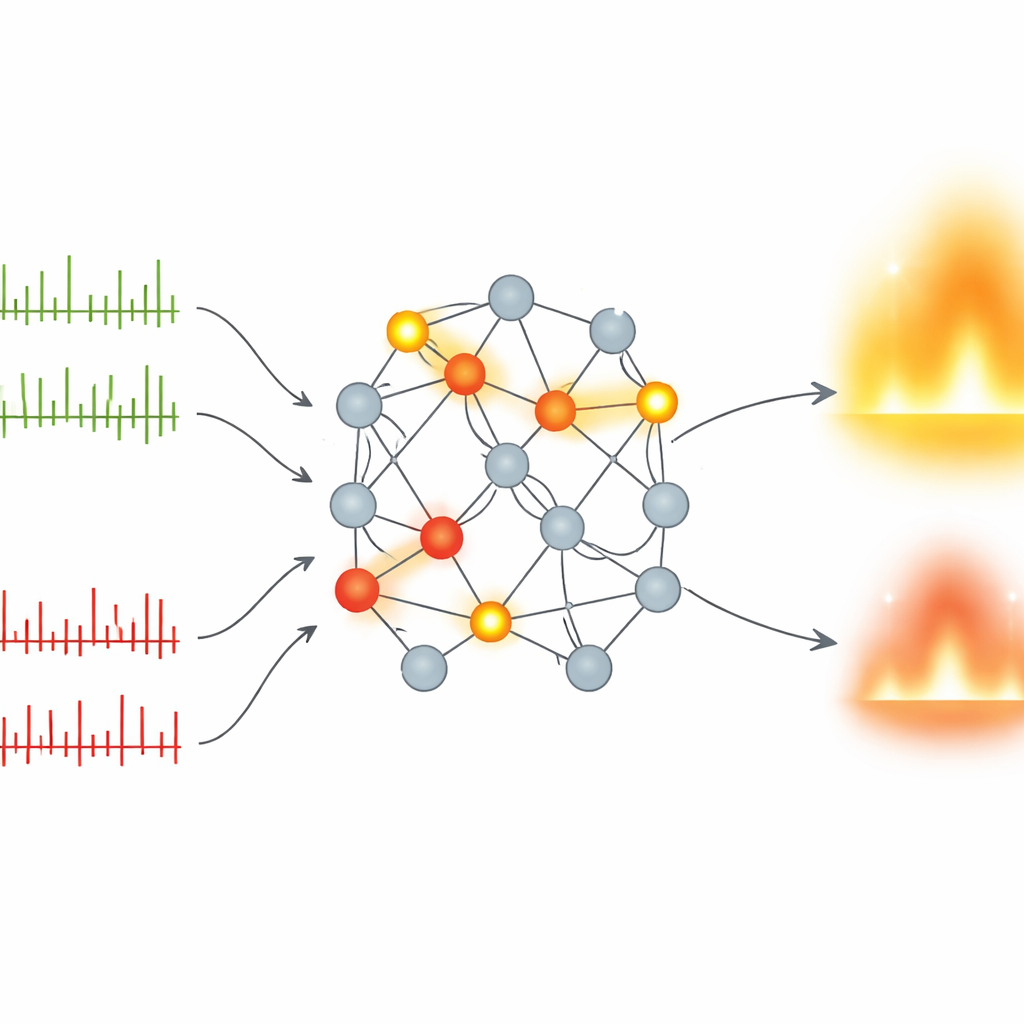

Autorzy adaptują ten pomysł do sieci impulsowych przez staranne zaprojektowanie sposobu kodowania wejść i etykiet oraz pomiaru dobroci. Po pierwsze obrazy lub wzorce dźwiękowe zamieniane są na ciągi impulsów przy użyciu kodowania częstościowego — silniejsze sygnały generują więcej impulsów w krótkiej sekwencji kroków czasowych. Etykiety są osadzone bezpośrednio w części wejścia, tak że pojedynczy wektor zawiera zarówno dane, jak i kandydującą klasę. Próbki pozytywne używają poprawnej etykiety; próbki negatywne używają celowo „trudnej” niepoprawnej etykiety wybranej spośród klas, które sieć ma tendencję mylić. Gdy impulsy przepływają przez warstwy neuronów typu leaky integrate-and-fire, model zlicza, jak często każdy neuron wystrzelił w przebiegu pozytywnym i negatywnym. Dobroć warstwy definiuje się więc przez sumaryczne liczby impulsów, a gładka funkcja straty zachęca, by dobroć dla pozytywnych przykładów przewyższała dobroć dla negatywnych o bezpieczny margines, przy jednoczesnym utrzymaniu stabilnych gradientów.

Jak dobrze działa ta metoda impulsowa?

Aby przetestować podejście, autorzy trenują kompaktowe sieci impulsowe na kilku standardowych zestawach danych wizualnych, w tym odręcznych cyfrach (MNIST), przedmiotach modowych, japońskich znakach oraz kolorowych obrazach obiektów (CIFAR-10), a także na zestawach neuromorficznych, gdzie wejścia już występują jako impulsy, takich jak rejestracje zdarzeniowe cyfr (N-MNIST) i mówione cyfry zakodowane jako ciągi impulsów (SHD). Mimo użycia tylko dwóch warstw ukrytych i zaledwie kilkunastu (a nawet 10) kroków czasowych, ich impulsywne modele forward–forward dorównują lub przewyższają inne systemy forward–forward dla sieci impulsowych i zbliżają się do najlepszych sieci impulsowych trenowanych metodą wstecznej propagacji. W trudniejszych zadaniach czasowych, takich jak SHD, ich metoda przewyższa nawet kilka modeli opartych na wstecznej propagacji, przy czym używa mniej parametrów i łatwiej mapuje się ją na sprzęt sterowany zdarzeniami.

Co to oznacza dla przyszłych maszyn podobnych do mózgu

Dla czytelnika bez specjalistycznego przygotowania najważniejszym wnioskiem jest to, że pojawił się obiecujący sposób trenowania inspirowanych mózgiem sieci opartych na impulsach bez polegania na ciężkiej maszynerii wstecznej propagacji. Ocena każdej warstwy na podstawie tego, jak mocno reaguje na dobre i złe przykłady, oraz praca wyłącznie w trybie przejść w przód sprawiają, że podejście forward–forward utrzymuje uczenie lokalnym i modułowym, zachowując jednocześnie konkurencyjną dokładność. Chociaż niektóre składniki — takie jak zastępcze gradienty i jawne osadzanie etykiet — nie są ściśle biologiczne, ramy te przybliżają uczenie maszynowe do sposobu, w jaki mogą adaptować się rzeczywiste układy nerwowe, i otwierają drogę do bardziej efektywnych, niskomocowych urządzeń inteligentnych uczących się z przepływających w czasie danych sensorycznych w czasie rzeczywistym.

Cytowanie: Ghader, M., Kheradpisheh, S.R., Farahani, B. et al. Backpropagation-free spiking neural networks with the forward–forward algorithm. Sci Rep 16, 14294 (2026). https://doi.org/10.1038/s41598-026-41671-4

Słowa kluczowe: sieci neuronowe z impulsami, uczenie forward-forward, komputery neuromorficzne, sztuczna inteligencja inspirowana biologicznie, alternatywy dla wstecznej propagacji